概率统计

Posted

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了概率统计相关的知识,希望对你有一定的参考价值。

概率统计

欢迎关注我的博客:http://blog.csdn.NET/hit2015spring

条件概率

设 和

和 是任意两个事件,且

是任意两个事件,且 ,则称

,则称 为事件

为事件 在事件

在事件 发生的条件下发生的条件概率。记作:

发生的条件下发生的条件概率。记作:

\\begin{equation}

P(A|B)=\\frac{P(AB)}{P(B)}

\\end{equation}

这里可以理解是,在事件 发生的情况里面去寻找事件

发生的情况里面去寻找事件 也在的例子,就是条件概率,有一种归一化的感觉,也有一种找出全局,再去挑局部的概念。

也在的例子,就是条件概率,有一种归一化的感觉,也有一种找出全局,再去挑局部的概念。

引入一个定理:

(两个事件的积的概率)=(其中一个事件的概率) (另一个事件在前面一个事件发生条件下的条件概率)即:

(另一个事件在前面一个事件发生条件下的条件概率)即:

\\begin{equation}

P(AB)=P(A|B)P(B)=P(B|A)P(A)

\\end{equation}

推广:

\\begin{equation}

P(A_1A_2 \\cdots A_n)=P(A_1)P(A_2|A_1)P(A_3|A_1A_2)P(A_4|A_1A_2A_3)\\cdots P(A_n|A_1A_2A_3\\cdots,A_n)

\\end{equation}

例子:

全概率公式

贝叶斯公式

\\begin{equation} P(A_i|B)=\\frac{P(A_iB)}{P(B)}=\\frac{P(B|A_i)P(A_i)}{P(B)}=\\frac{P(B|A_i)P(A_i)}{\\sum\\limits_{i=1}^{n}P(B|A_i)P(A_i)} \\end{equation}

其中用一个条件概率的公式

\\begin{equation}

P(B|A_i)=\\frac{P(A_iB)}{P(A_i)}

\\end{equation}

是先验概率,一般是经验的总结。

是先验概率,一般是经验的总结。 是后验概率,表示实验之后各种原因发生的可能性

是后验概率,表示实验之后各种原因发生的可能性

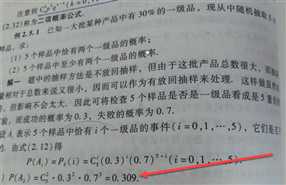

重复独立实验、二项概率公式

一个实验里面有两个结果, 和

和 ,这个实验称为伯努利实验。它的重复n次的独立实验就叫做:n重伯努利实验。

,这个实验称为伯努利实验。它的重复n次的独立实验就叫做:n重伯努利实验。

设在每次实验中成功的概率是 ,则在

,则在 重伯努利实验中,成功恰好发生

重伯努利实验中,成功恰好发生 次的概率是

次的概率是

\\begin{equation}

P_n(k)=C_n^kp^k(1-p)^{n-k}

\\end{equation}

例子:

当实验次数很大的时候 的时候,公式可变为

的时候,公式可变为 ,这时为二项泊松分布

,这时为二项泊松分布

\\begin{equation}

C_n^k p^k(1-p)^{n-k}\\to \\frac{\\lambda^k}{k!}e^{-\\lambda}

\\end{equation}

数学期望和方差

几个结论

| 0-1分布 | 泊松分布 | 几何分布 | ||

|---|---|---|---|---|

| 期望 |  |

|

|

|

| 方差 |  |

|

|

|

切比雪夫不等式

\\begin{equation} P[|X-E(X)| \\geq \\varepsilon ]\\leq \\frac{D(X)}{\\varepsilon^2} \\end{equation}

一个随机变量偏移它中心的概率是与距离和它的方差有关的不等式

伯努利大数定律

在 重伯努利实验中,成功的次数为

重伯努利实验中,成功的次数为 ,而每次成功的概率为

,而每次成功的概率为 ,则对任意的

,则对任意的 有

有

\\begin{equation}

\\lim\\limits_{n \\to \\infty} P(|\\frac{Y_n}{n}-p|\\geq \\varepsilon)=0

\\end{equation}

当实验次数 足够大的时候,成功的频率与成功的概率之差的绝对值不小于任意一个指定的正数

足够大的时候,成功的频率与成功的概率之差的绝对值不小于任意一个指定的正数 的概率可以小于任意一个预先指定的正数,这就是频率稳定性的一种确切的解释。根据伯努利大数定律在实际应用中,当实验次数

的概率可以小于任意一个预先指定的正数,这就是频率稳定性的一种确切的解释。根据伯努利大数定律在实际应用中,当实验次数 很大时,可以用事件的频率来近似得代替事件的概率。

很大时,可以用事件的频率来近似得代替事件的概率。

辛钦大数定律

设随机变量序列  是独立同分布的随机变量,具有有限的数学期望和方差

是独立同分布的随机变量,具有有限的数学期望和方差 则对任意的

则对任意的 有

有

\\begin{equation}

\\lim\\limits_{n \\to \\infty} P(|\\frac{1}{n}\\sum\\limits_{i=1}^{n}X_i-\\mu|\\geq \\varepsilon)=0

\\end{equation}

是随机变量

是随机变量 的

的 个观测值的算术平均值,而

个观测值的算术平均值,而 ,当实验次数足够大的时候平均值与数学期望之差的绝对值不小于任一指定的正数

,当实验次数足够大的时候平均值与数学期望之差的绝对值不小于任一指定的正数 的概率小于任意一个预先指定的正数,这就是算术平均值稳定性的解释

的概率小于任意一个预先指定的正数,这就是算术平均值稳定性的解释

中心极限定理

被研究的随机变量是大量独立随机变量的和,其中每一个随机变量对于总和只起微小的作用,则可以认为这个随机变量近似服从于正态分布。

Lindeberg-levi 中心极限定理

如果随机变量序列 独立同分布,并且具有有限的数学期望和方差

独立同分布,并且具有有限的数学期望和方差 则对一切的

则对一切的

\\begin{equation} \\lim\\limits_{n \\to \\infty} P(\\frac{1}{\\sqrt n \\sigma}(\\sum \\limits_{i=1}^{m}X_i-n\\mu)\\geq 0)=\\int _{- \\infty}^{x} \\frac{1}{\\sqrt{2\\pi}}e^{-\\frac{t^2}{2}}dt \\end{equation}

在 重伯努利实验中,成功的次数为

重伯努利实验中,成功的次数为 而在每次实验中成功的概率是

而在每次实验中成功的概率是 则对一切的

则对一切的 有

有

\\begin{equation}

\\lim\\limits_{n \\to \\infty} P(\\frac{Y_n-np}{\\sqrt{npq}} \\geq x)=\\int _{- \\infty}^{x} \\frac{1}{\\sqrt{2\\pi}}e^{-\\frac{t^2}{2}}dt=\\Phi(x)

\\end{equation}

以上是关于概率统计的主要内容,如果未能解决你的问题,请参考以下文章