[Papers-Image fusion]2017-10-16

Posted

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了[Papers-Image fusion]2017-10-16相关的知识,希望对你有一定的参考价值。

本周完成情况:

1.论文阅读:

1)论文标题:《Multi-focus image fusion with dense SIFT》

2)论文作者:刘羽-中国科学技术大学 (链接:http://www.escience.cn/people/liuyu1/index.html)

3)论文内容:本论文详细的融合算法包括以下四步:

①计算每个源图像的128维SIFT图像,并且通过累积非标准化SIFT描述子的所有元素来形成包含焦点信息的活动度图(activity level map),同时通过归一化规则 获得归一化SIFT图像。

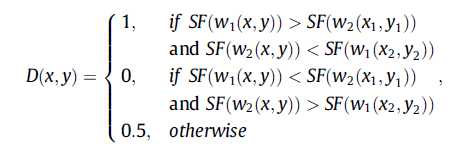

②然后,将两个活动级别图中的焦点信息组合在一起,以产生由第一源图像的确定聚焦区域,第二源图像的确定聚焦区域和不确定区域组成的初始判定图。

③接下来,通过特征匹配和局部焦点测量比较来改进初始决策图。

④最后,利用最终决策图获得融合图像。

4)论文结论:所提出的算法DSIFT在所有的六个度量方面都优于另外九种比较方法。

5)论文创新:这表明一些图像局部特征如密集SIFT可以构建图像融合的有效特征空间。 特别地,本地特征描述符不仅可以被用作活动级别测量,而且可以用于匹配多个源图像 之间的错误注册的像素,以减少对象运动区域和对象边缘的融合质量。通俗的讲,由于对象可能发生微小运动,这些不确定位置处的多个源图像的内容通常不完全相同,所 以我们需要把两幅(多幅)源图像进行特征点匹配,找到其相对应的像素位置,这样可以达到更好的融合效果。

6)论文问题:①在本文的实验中,在特征匹配步骤中消耗了大约53%的运行时间,导致不能有很好的实时性。

②最终判定图始终还保留一些不确定的像素。

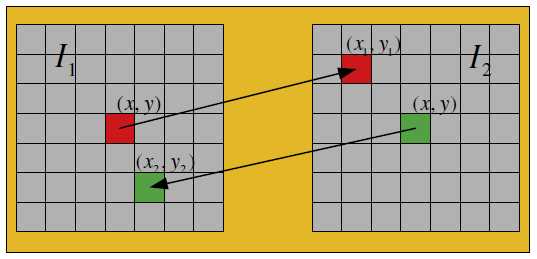

7)特征匹配结构:

其中,w1(x,y)和w2(x, y)分别表示在I1和I2图像中以x为中心的局部窗口。

2.学习:

深度学习框架Tensorflow (链接:https://zhuanlan.zhihu.com/p/29822763)

3.项目:

深度学习Tensorflow,Python+OpenCV (链接:http://www.cnblogs.com/wmr95/)

下周计划:

1.结合上篇论文,分析其源代码。

2.看论文《Dense SIFT for ghost-free multi-exposure fusion》

3.学习相关机器学习及深度学习知识。

以上是关于[Papers-Image fusion]2017-10-16的主要内容,如果未能解决你的问题,请参考以下文章