logistic回归模型

Posted gaowenxingxing

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了logistic回归模型相关的知识,希望对你有一定的参考价值。

logistic 回归算法

一种常见的分类算法,输出值在0,1之间

是:1

否:0

即找到满足下面条件的最优参数

(0 leq h_{ heta}(x) leq 1)

假设函数的表示方法:

(h_{ heta}(x)=gleft( heta^{T} x

ight))

其中:

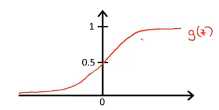

(g(z)=frac{1}{1+e^{-z}})

因此,(g(z))带入假设函数之后,假设函数的表示为

(h_{ heta}(x)=frac{1}{1+e^{- heta^{T} x}})

如果我们想要结果总是在0到1之间,那么就可以使用sigmoid函数,它能保证数据在0-1之间。并且越趋近于无穷大,数据越趋近于1。

sigmoid函数==logistic函数

其函数图像如下:

注意到z趋向于负无穷大时,值越接近0;z趋向于正无穷大时,值越接近1。这样就可以使输出值在0到1之间。有了这个假设函数,就可以拟合数据了,根据给定的θ参数值,假设会做出预测

假设一个问题,如果肿瘤是依赖于大小来判断良性恶性,如果超过0.7*平均值,就判断是恶性的,那么平均来算30%的是恶性的,70%是良性的,他们相加总会是100%。再来看看上面的sigmoid的图像,每个点都表示它属于1的概率是x,属于0的概率是1-x。这样一个分类的问题,就变成了曲线值得问题了。

如果想让y=1,即g(z)的值要大于0.5,那么z的值就需要大于0;相反,y=0,就是z的值小于0。因此整个分类问题,就变成了寻找决策边界的问题了。

那么如何确定逻辑回归的损失函数呢?如果使用均方误差,由于最终的值都是0和1,就会产生震荡,此时是无法进行求导的。

因此需要寻找一个方法,使得代价函数变成凸函数,从而易于求解。

以上是关于logistic回归模型的主要内容,如果未能解决你的问题,请参考以下文章