在线学习和在线凸优化(online learning and online convex optimization)—FTL算法5

Posted wzdly

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了在线学习和在线凸优化(online learning and online convex optimization)—FTL算法5相关的知识,希望对你有一定的参考价值。

最自然的学习规则是使用任何在过去回合中损失最小的向量。 这与Consistent算法的精神相同,它在在线凸优化中通常被称为Follow-The-Leader,最小化累积损失。

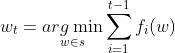

对于任何t:

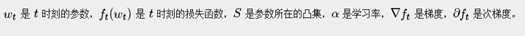

我们谈到了能最小化累计损失不能说明此算法在在线学习场景是有效,我们需要探究算法的 Regret bound:

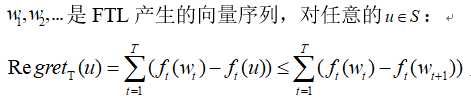

采用归纳法证明:

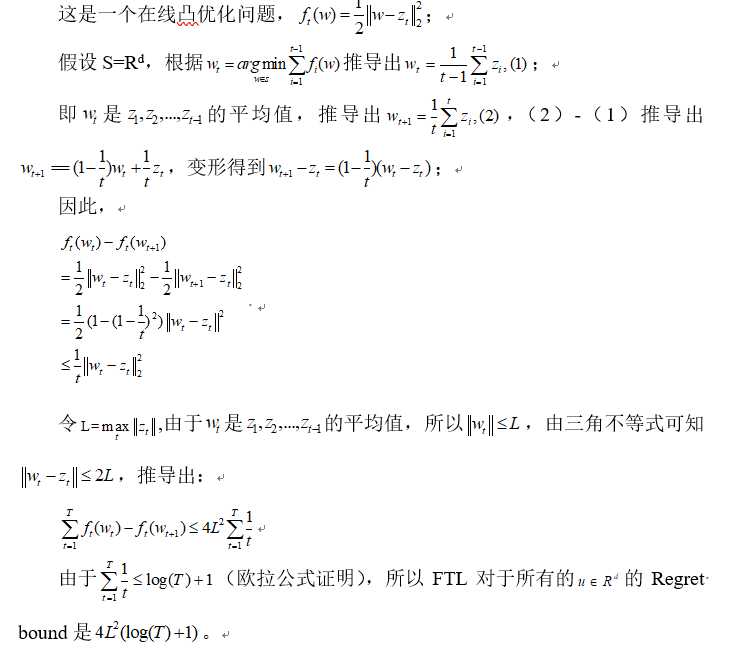

例子1:Online Quadratic Optimization

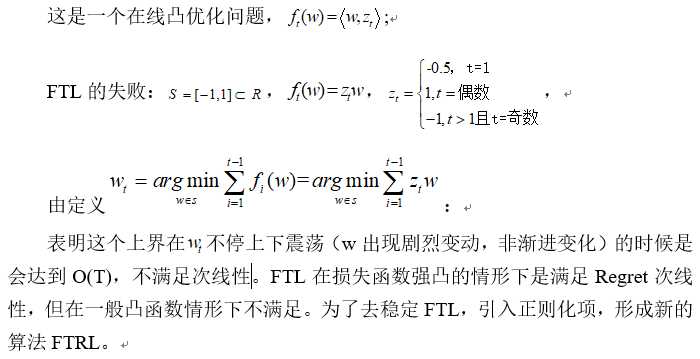

例子2:Online Linear Optimization

未完,待续。。。。。。

下一节将讲述FTRL算法

以上是关于在线学习和在线凸优化(online learning and online convex optimization)—FTL算法5的主要内容,如果未能解决你的问题,请参考以下文章