阿里云服务器器上Centos7搭建伪分布式HADOOP详细教程

Posted eglhit

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了阿里云服务器器上Centos7搭建伪分布式HADOOP详细教程相关的知识,希望对你有一定的参考价值。

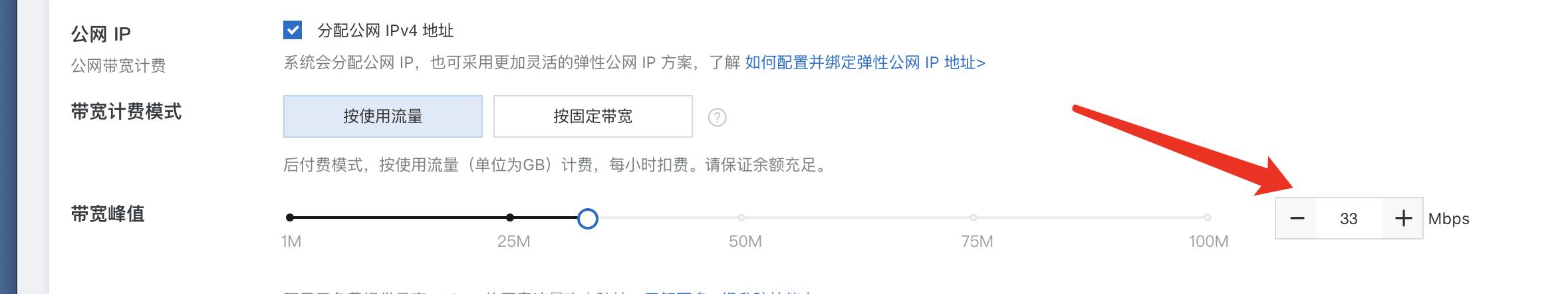

一、购置服务器并且创建实例

1.一个服务器只能创建一个实例,如果是做实验可以直接购买抢占式的非常便宜,如果是学生认证做完题之后可以免费领7个月服务器;

2.选择CPU数量和内存,不必太大够用就行(要什么自行车);

3.选择操作系统centos;

4.配置网络;

5.创建实例用户和密码(尽量简单一些)。

ps:可以修改实例名字,可以更直观

二、连接虚拟管理环境

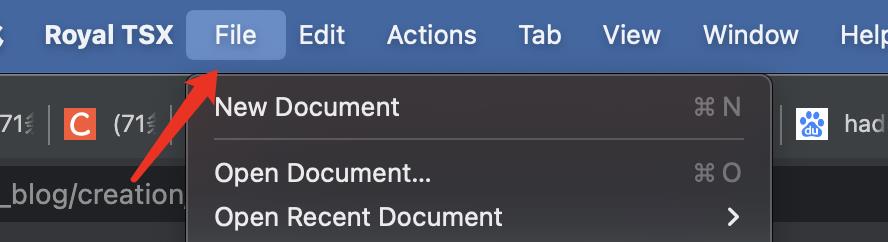

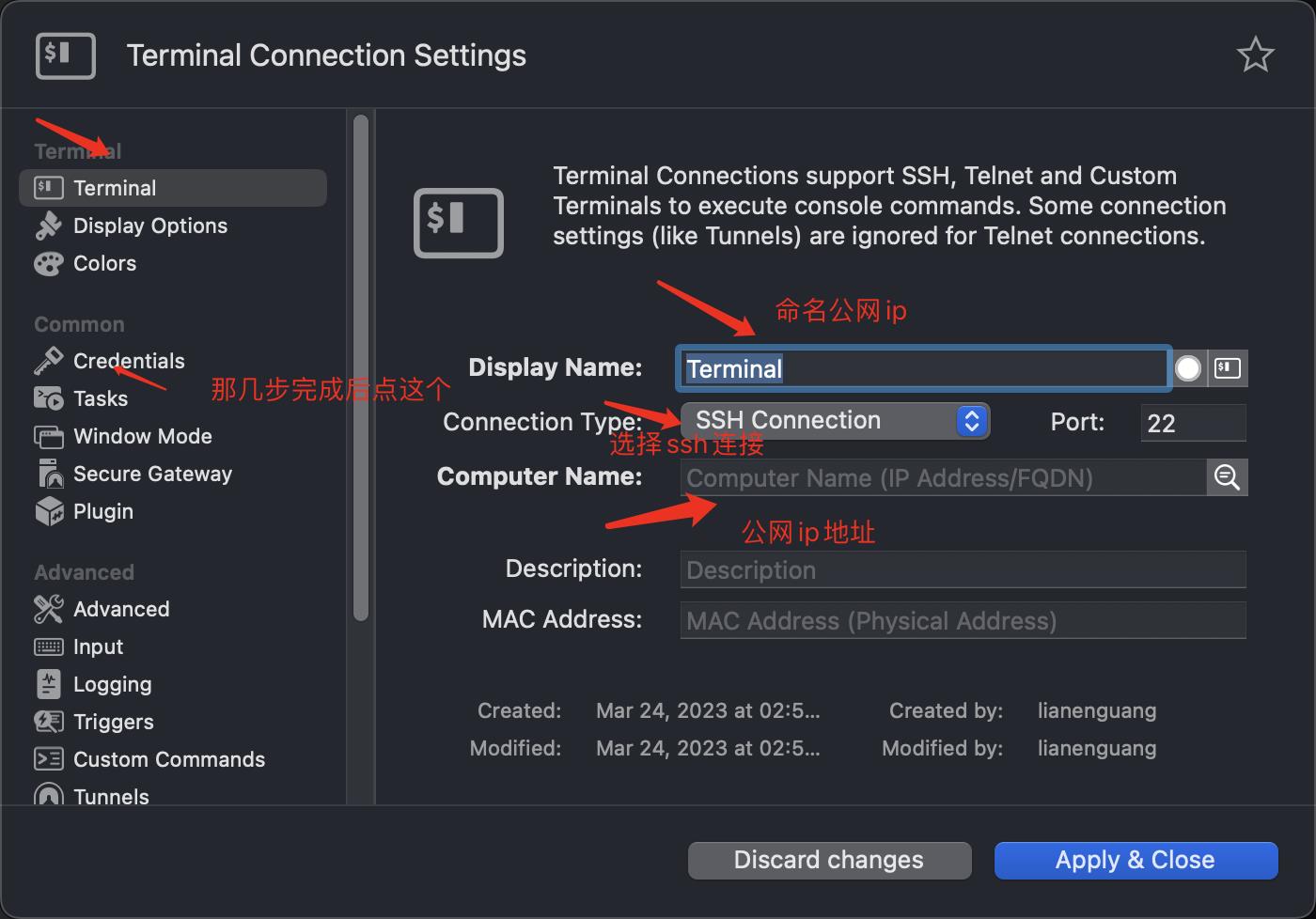

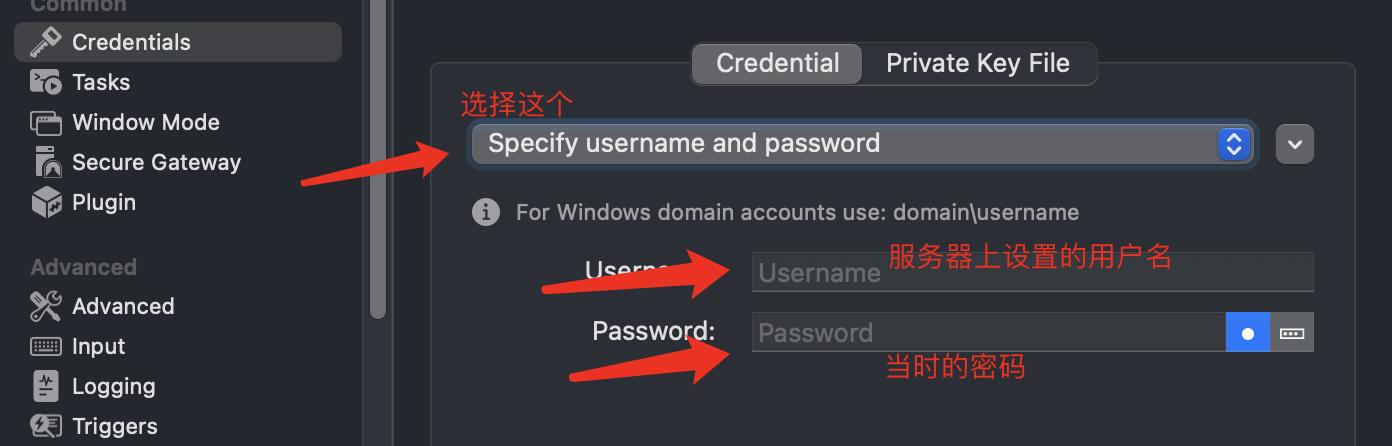

我在苹果电脑上所用到的虚拟环境管理工具是Royal TSX,用起来还是挺不错的,方便快捷。

下载安装好该软件之后,首先到页面顶端找到File,点击New Document

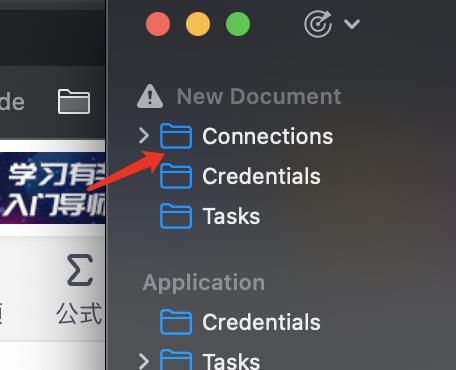

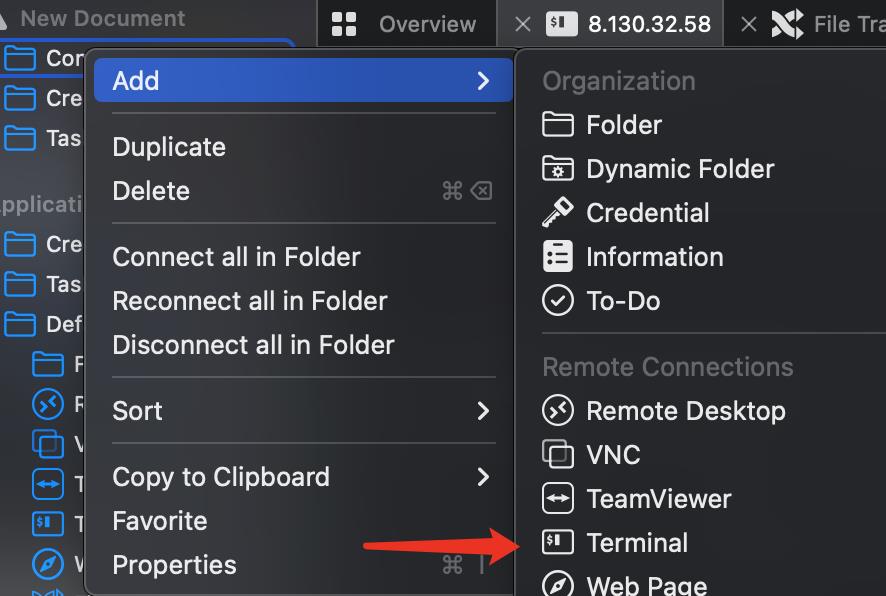

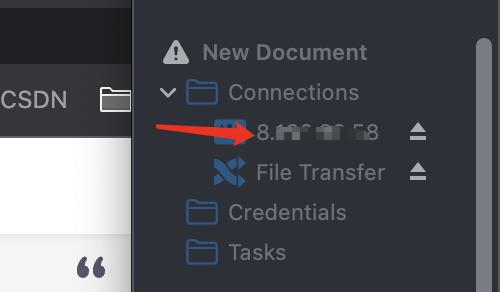

会出现一个Connections的文件夹,接着在文件上右键鼠标点击Add,点击Terminal

Apply之后,退出双击你建好的项目,等待链接,如果出现错误请仔细核对用户名密码及链接方式

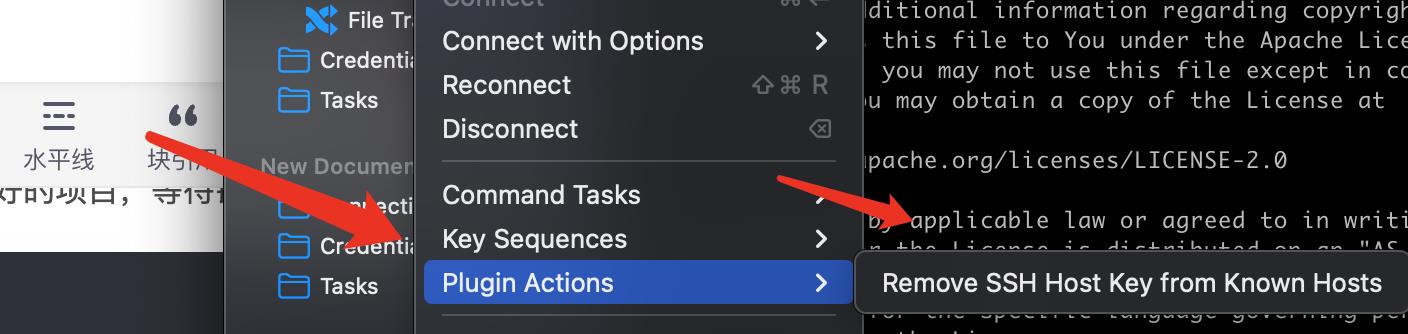

如果重置过服务器,在该软件上会有遗留,在重置服务器后,需要按照下图操作重置key

链接成功后,开始准备环境:

对于已有的centos环境可以直接安装java,通过以下的指令:

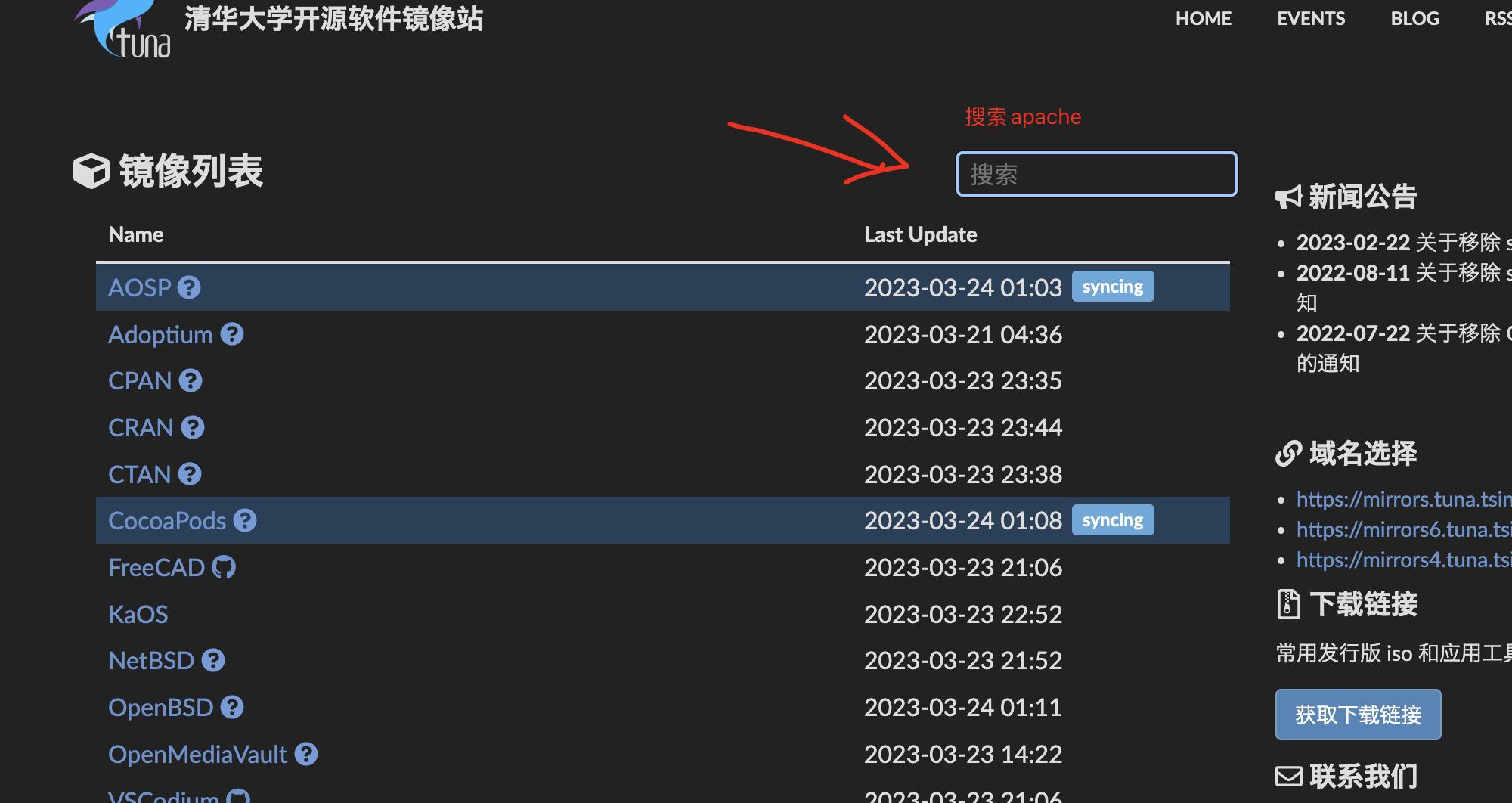

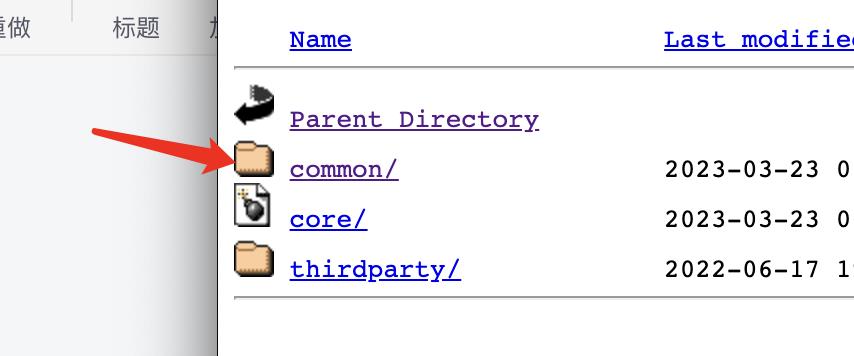

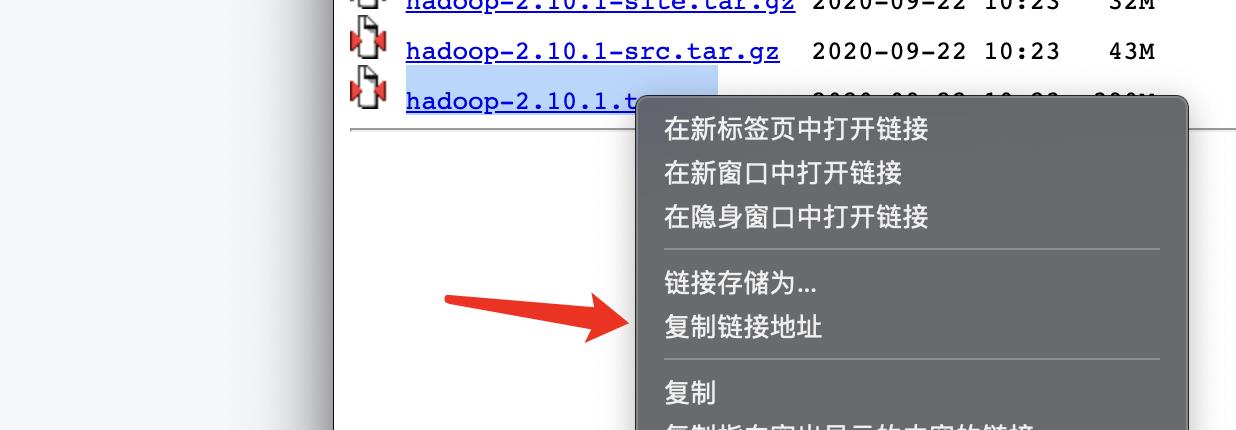

yum install java -y然后安装hadoop,这里为了提升下载速度可以从清华镜像下载,地址是:

清华大学开源软件镜像站 | Tsinghua Open Source Mirror

然后在Royal TSX中输入下面这段代码等待下载完成:

然后在Royal TSX中输入下面这段代码等待下载完成:

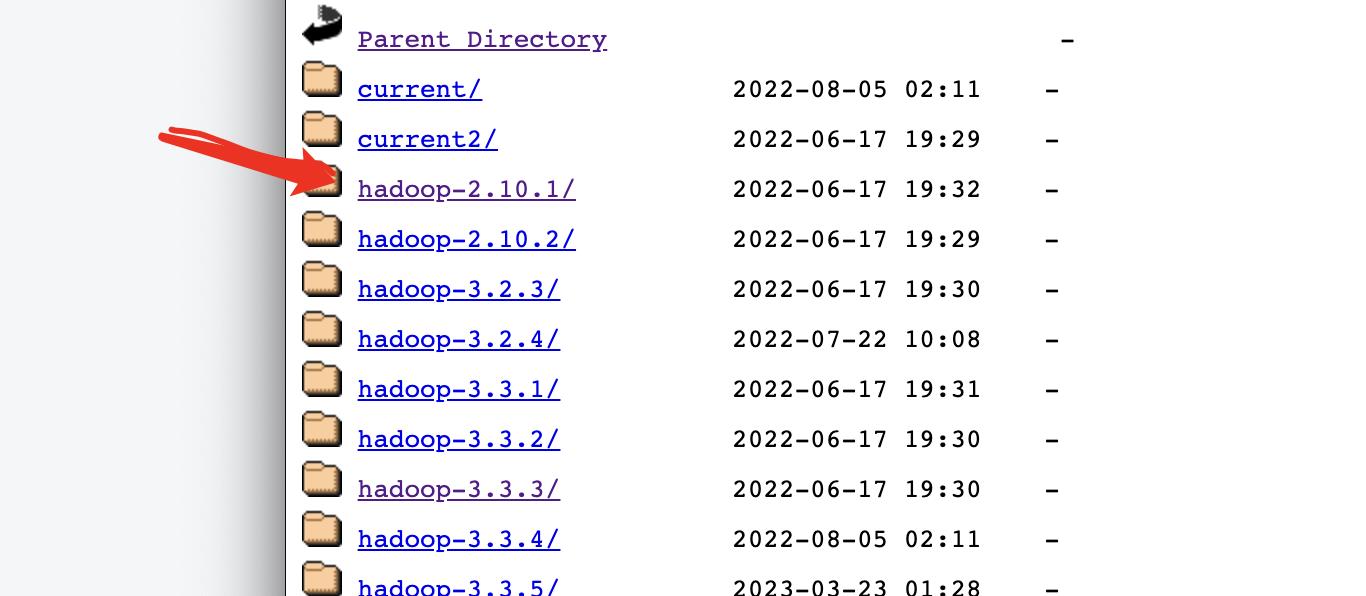

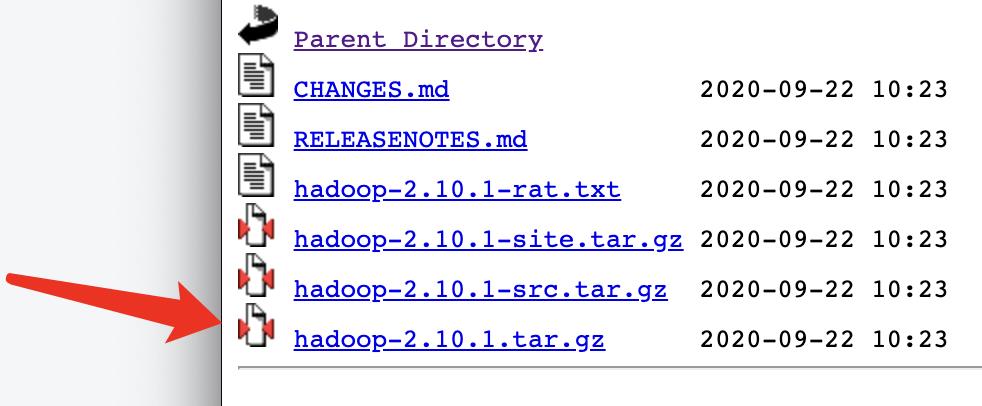

wget https://mirrors.tuna.tsinghua.edu.cn/apache/hadoop/common/hadoop-2.10.1/hadoop-2.10.1.tar.gz完成之后解压

tar -zxvf hadoop-2.10.1.tar.gzps:这里可以直接解压到usr/local当中更方便,但是我当时没有那么做,我直接重复我的过程。

解压完成后,先确认自己有没有SSH服务, 进入服务器中,输入如下命令,查看是否已经安装好ssh服务,若没有,则使用如下命令进行安装:

sudo apt-get install ssh openssh-server

创建ssh-key,这里采用rsa方式,使用如下命令:

ssh-keygen -t rsa -P ""

出现的图形就是密码,接着执行以下命令

cat ~/.ssh/id_rsa.pub >> authorized_keys最后执行ssh localhost进行测试,成功后会提示如下的信息:

[root@HackerSM hadoop -2.10.1]#ssh localhost Last login : Mon Nov 29 16:28:07 2021 from 112.64.1.83

Welcome to Alibaba ctoud Elastic Compute Service !接着开始配置环境变量:

注意:此时hadoop的目录位置是在root下

通过如下命令将其转移到/usr/local/下:

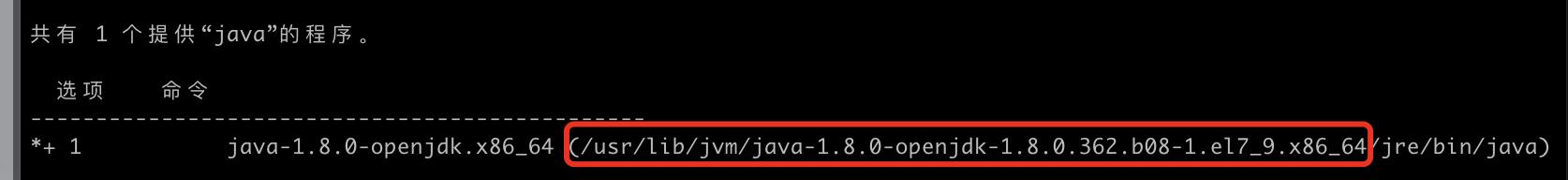

sudo mv /root/hadoop-2.10.1 /usr/local/hadoop-2.10.1然后看一下java的安装目录通过该指令:

sudo update-alternatives --config java

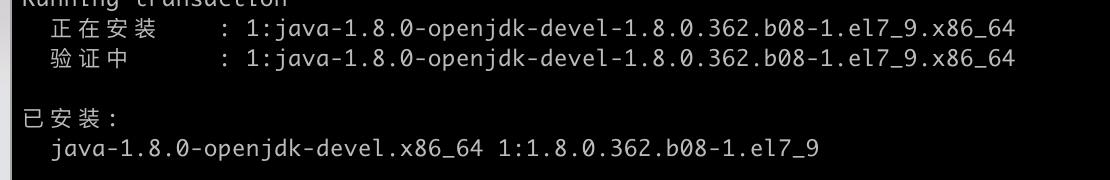

注意此处应该将java安装完全:

yum -y install java-1.8.0-openjdk-devel.x86_64

接着执行:

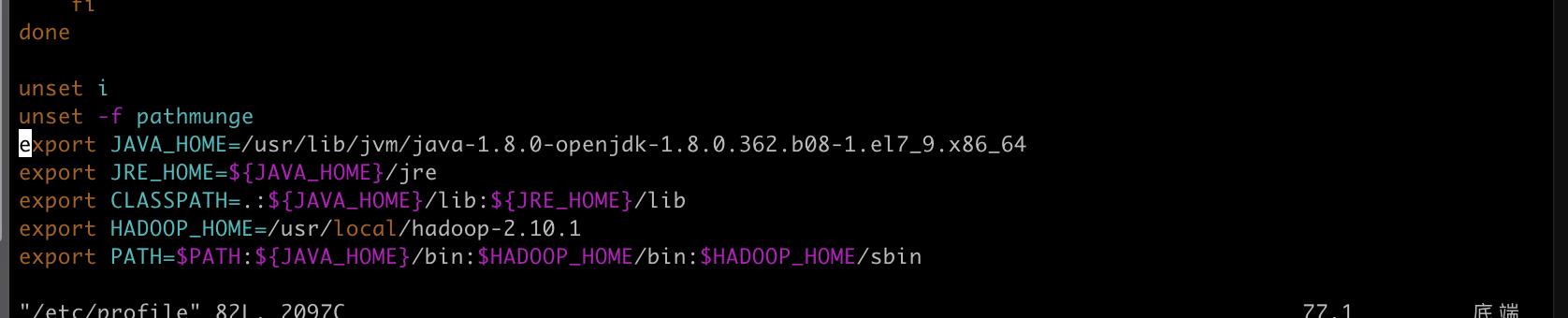

vim /etc/profile

按下文配置即可:

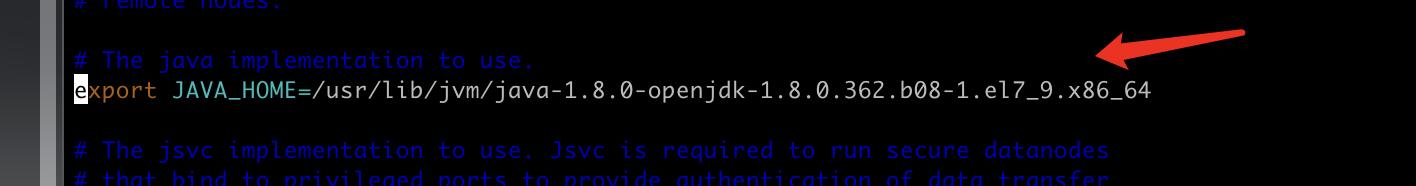

export JAVA_HOME=/usr/lib/jvm/java-1.8.0-openjdk-1.8.0.362.b08-1.el7_9.x86_64

export JRE_HOME=$JAVA_HOME/jre

export CLASSPATH=.:$JAVA_HOME/lib:$JRE_HOME/lib

export HADOOP_HOME=/usr/local/hadoop-2.10.1

export PATH=$PATH:$JAVA_HOME/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

一定注意按照我上面方法搞清楚JAVA_HOME和HADOOP_HOME的安装路径并且正确替换后执行

source /etc/profile

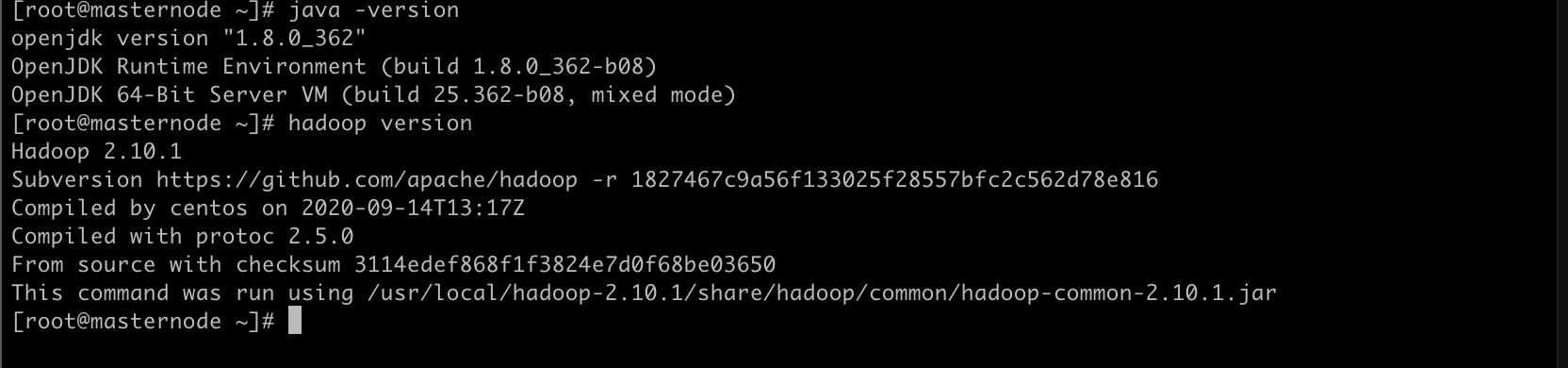

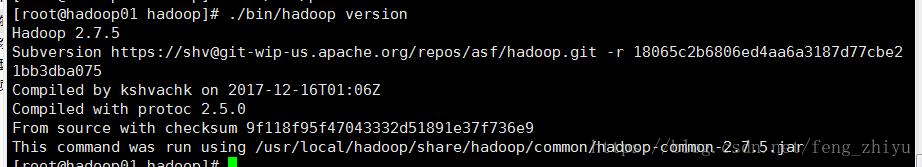

配置文件生效后,分别运行java -version 和hadoop version查看jdk和hadoop是否安装配置成功,如下图所示

接着开始配置集群:

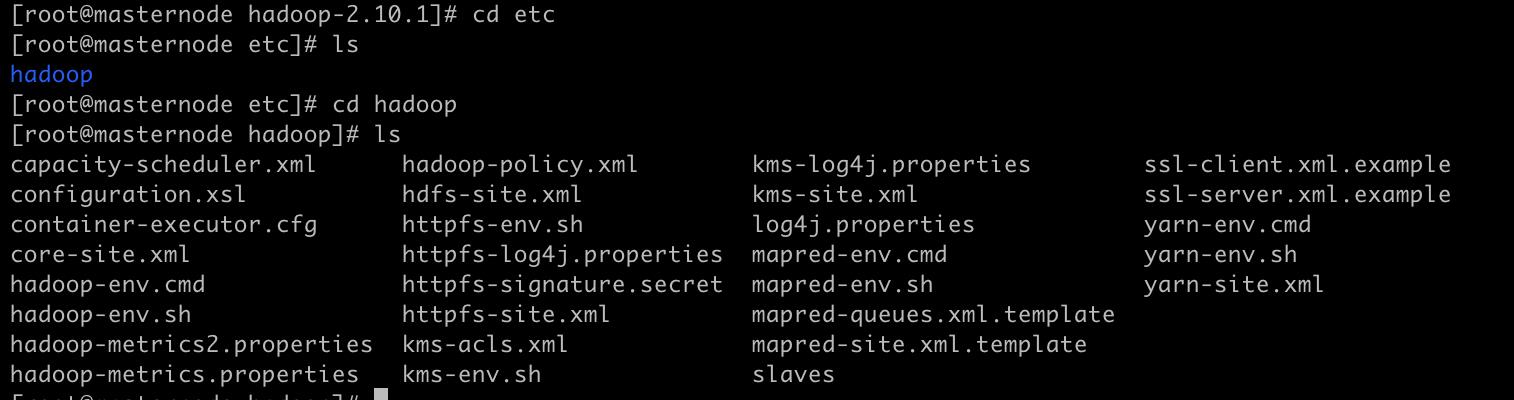

首先进入hadoop安装目录下,此时是在\\usr/local目录下找到hadoop-2.10.1,进入

然后进入etc文件夹,所有的配置文件均在该文件夹中

然后开始配置hadoop-env.sh,将其中的JAVA_HOME修改为自己的。

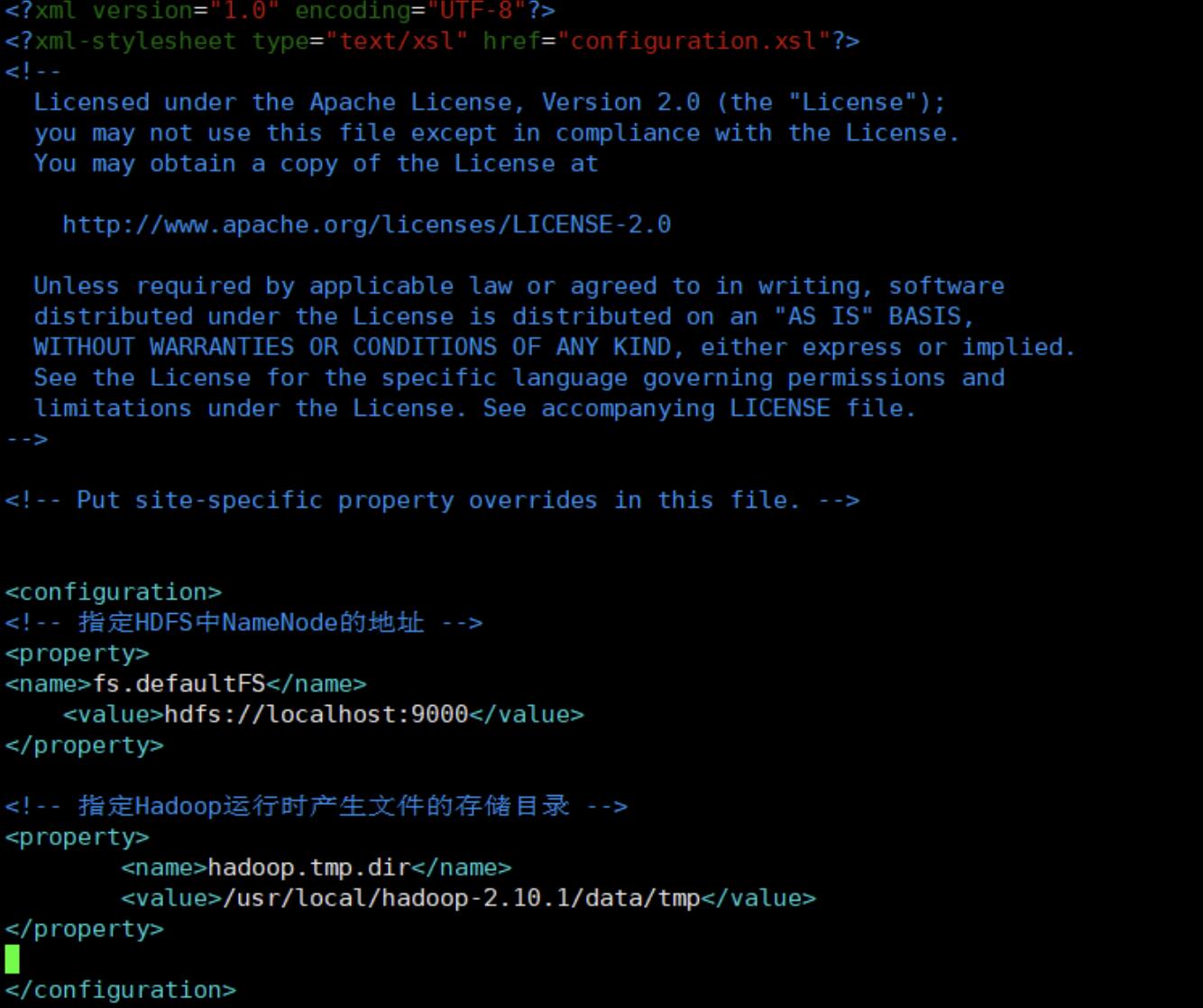

配置core-site.xml,将如下代码复制进去即可。hadoop.tmp.dir的目录可根据自己的喜好来配置

<!-- 指定HDFS中NameNode的地址 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

<!-- 指定Hadoop运行时产生文件的存储目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/local/hadoop-2.10.1/data/tmp</value>

</property>

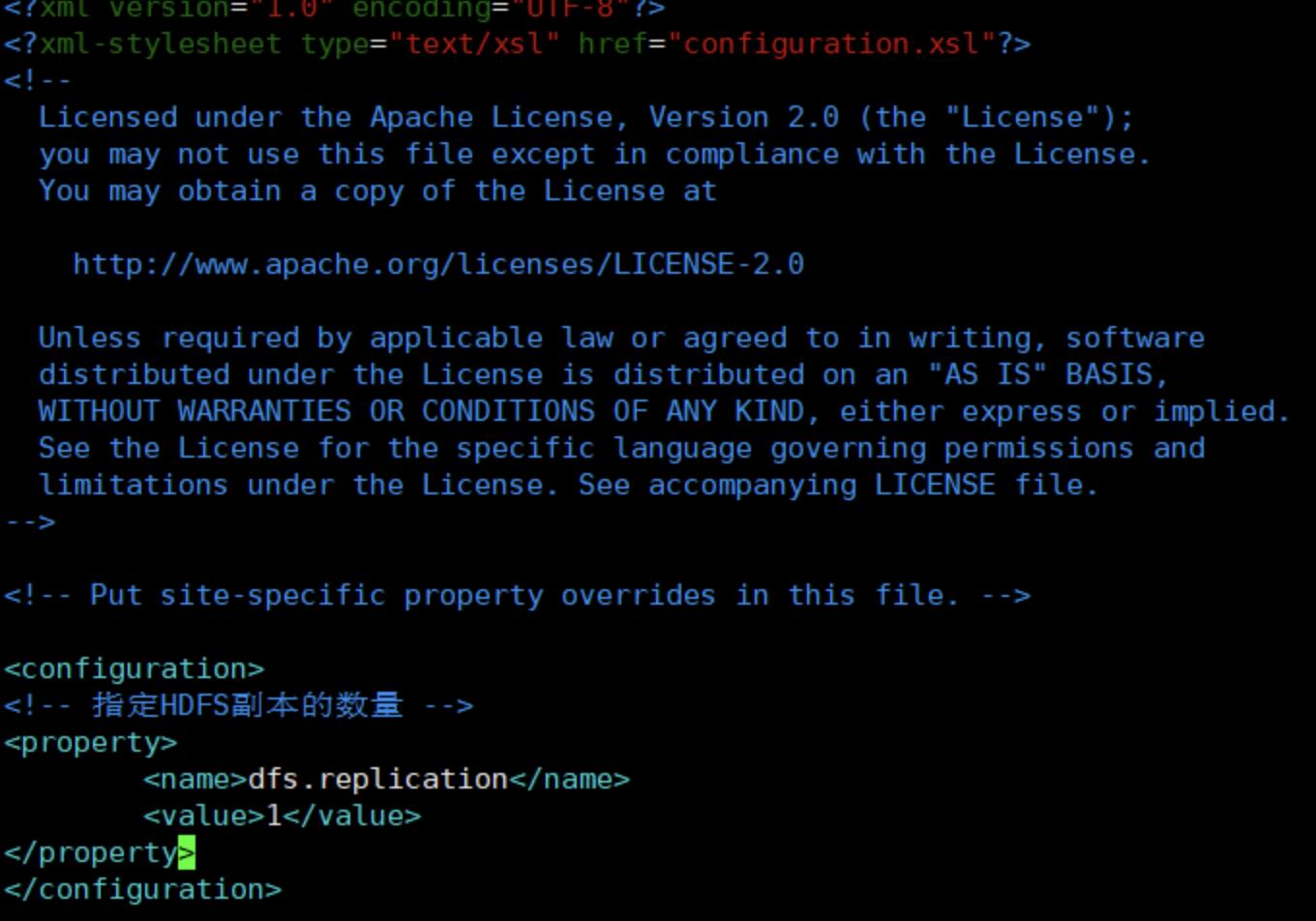

配置hdfs-site.xml,添加如下代码即可

<!-- 指定HDFS副本的数量 -->

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

然后就可以启动集群了

但是必须注意在hadoop安装目录下(此时是在/usr/local/hadoophadoop-2.10.1)执行下面的命令

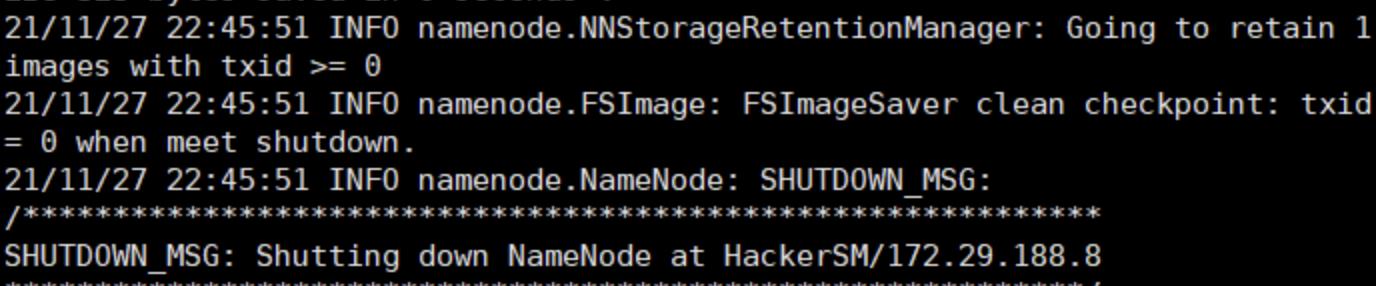

bin/hdfs namenode -format

格式化NameNode(第一次启动格式化就行了,如果没有特殊情况以后都不要再格式化了)

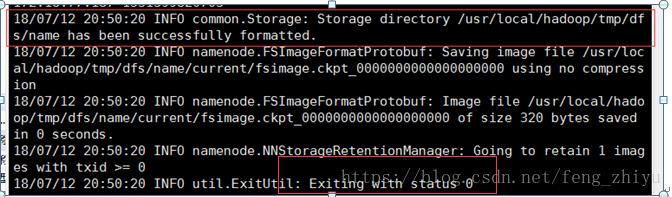

执行成功的话:

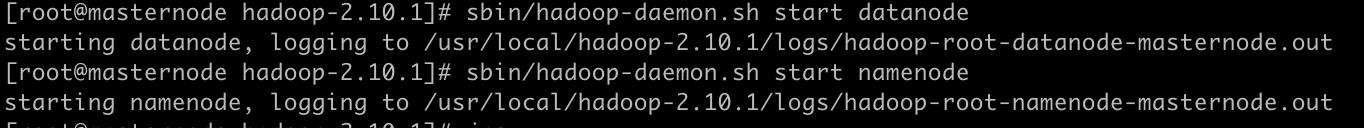

启动NameNode和DataNode:

sbin/hadoop-daemon.sh start namenodesbin/hadoop-daemon.sh start datanode

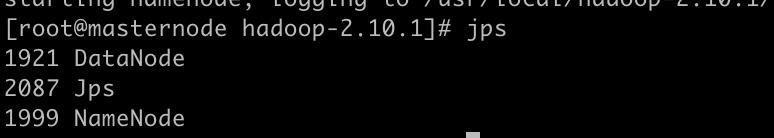

查看集群是否启动成功:

在hadoop安装目录下执行jps命令查看进程,如果NameNode和DataNode启动成功如下图所示

接着到阿里云中,点击你的实例名称再点安全组,然后点击手动添加

打开端口8088和50070,输入端口范围设置为0.0.0.0,保存

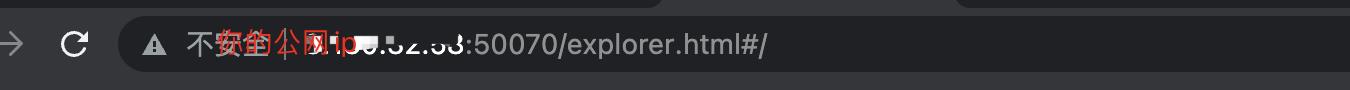

接着在浏览器中可以查看web页面,端口为50070

接下来开始操作集群:

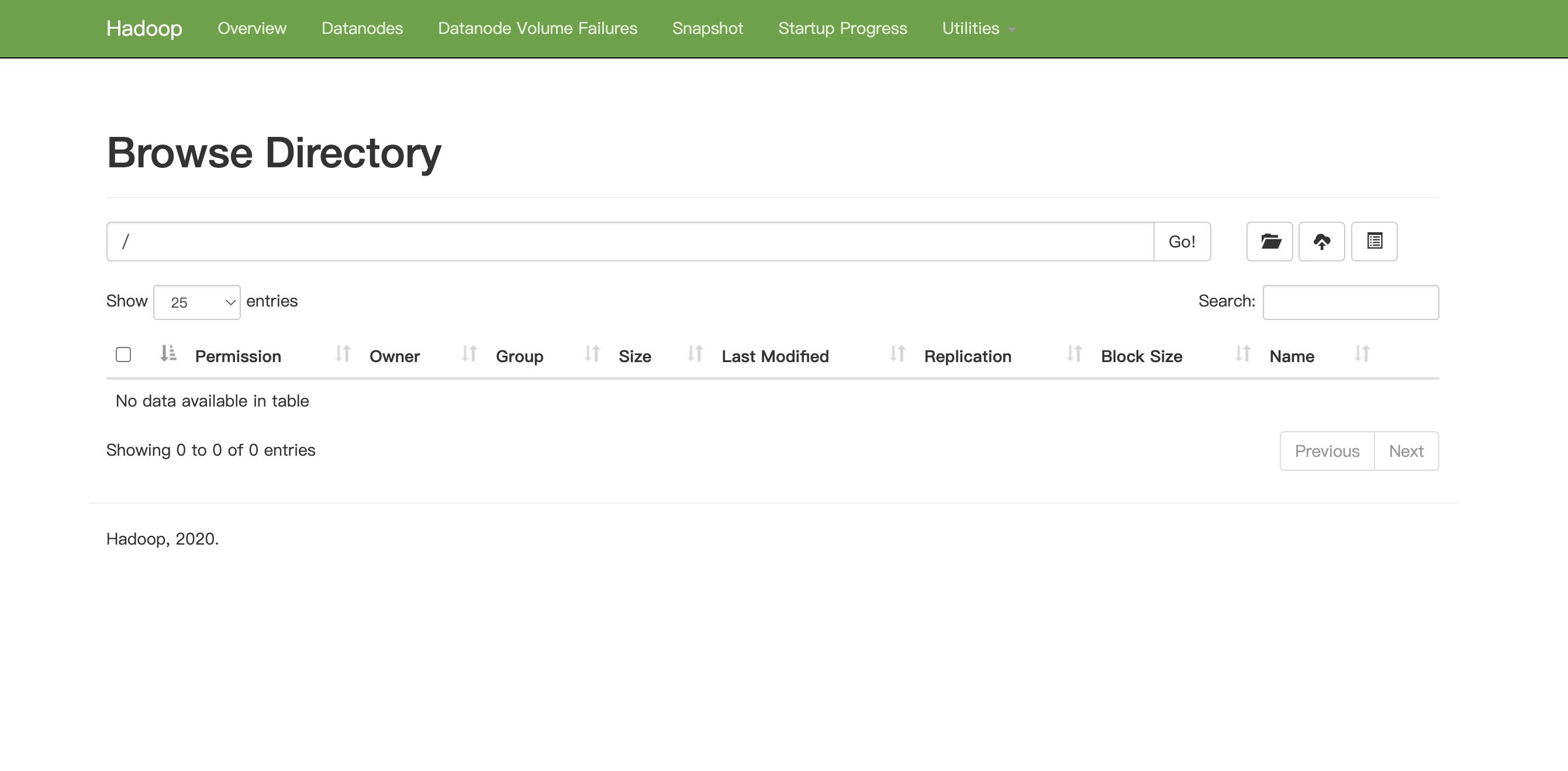

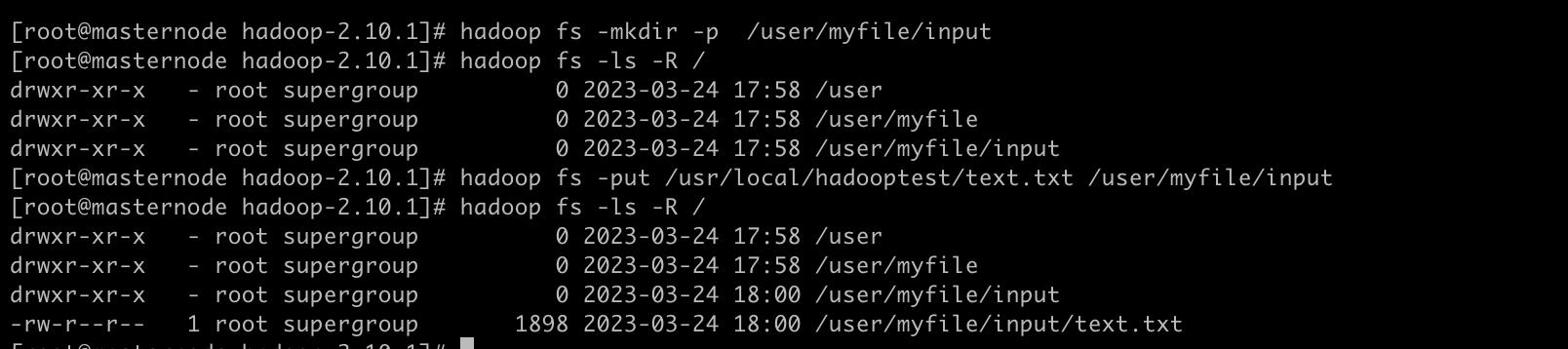

在HDFS上创建一个input文件夹:在HDFS上使用参数-p创建多级目录input文件夹:

hadoop fs -mkdir -p user/myfile/input查看文件夹是否创建成功,执行命令bin/hdfs dfs -ls -R /,结果如下图所示,可以看到已经创建成功:

hadoop fs -ls -R /

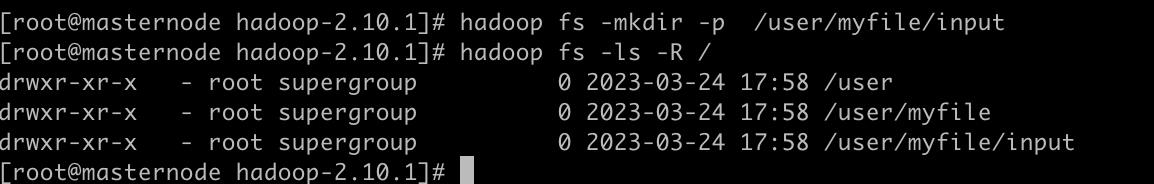

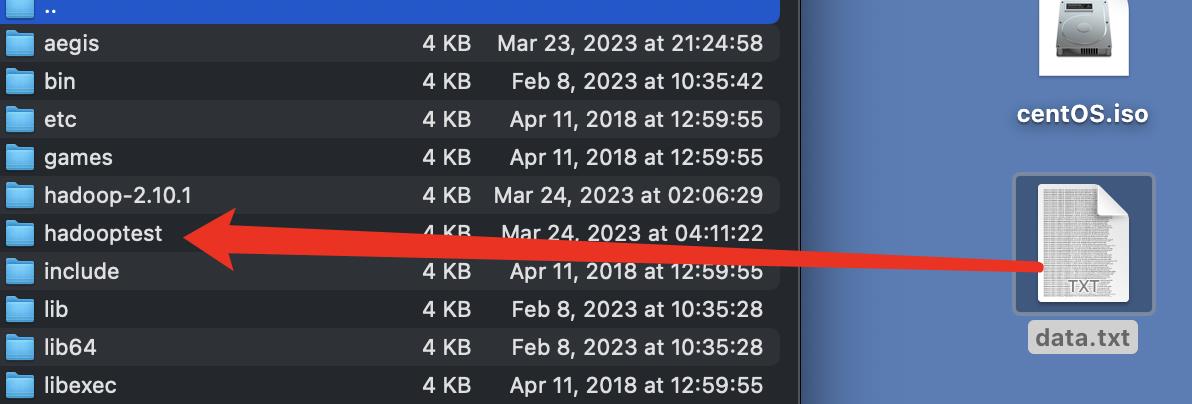

利用Royal TSX工具当中的 可以方便的使用文件系统

可以方便的使用文件系统

其配置方法和刚才配置终端是一样的,不再赘述。

打开该工具,在/usr/local/目录下创建一个名为hadooptest的文件夹,将本地文件拖拽即可上传

更名为test文件,并将该文件上传到刚才HDFS上新建的文件夹当中:

hadoop fs -put /usr/local/hadooptest/test.txt /input/file运行下面的命令查看文件是否上传成功:

bin/hdfs dfs -ls /input/file

阿里云服务器centos7.3下搭建hadoop伪分布式环境

一、软硬件环境

CentOS 7.2 64位

OpenJDK-1.8.0

Hadoop-2.7

二、安装SSH客户端

安装ssh:

yum install openssh-clients openssh-server

(如果系统中没有yum命令使用 sudo apt install yum安装 如有lock问题参看如下解决方法)

当我的Ubuntu install某个东西时,给出下面提示 E: Could not get lock /var/lib/dpkg/lock-frontend - open (11: Resource temporarly unavailable) E: Unable to acquire the dpkg frontend lock (/var/lib/dpkg/lock-frontend), is an other process using it? 删除锁定文件,行了 sudo rm /var/lib/dpkg/lock-frontend sudo rm /var/lib/dpkg/lock

安装完成后,使用以下命令测试:

①查看是否安装成功:

rpm -qa | grep ssh

②启动SSH服务。

systemctl restart sshd

ssh localhost

输入 root 账户的密码,如果可以正常登录,则说明SSH安装没有问题。

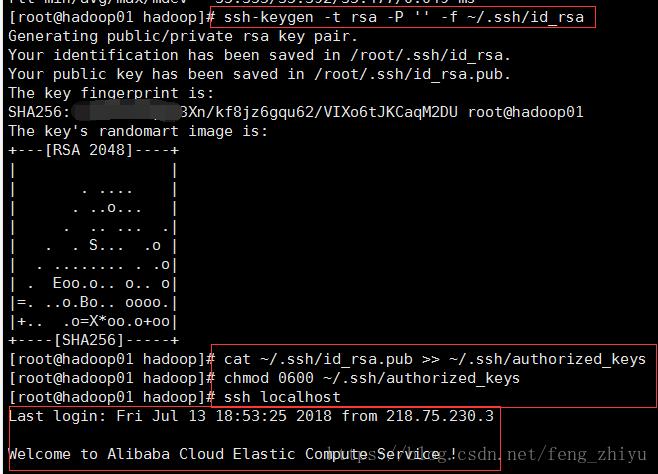

配置SSH免key登陆

hadoop是一个分布式系统,节点间通过ssh通信,为了避免在连接过程中人工输入密码,需要进行ssh免key登陆的配置,由于本例是在单机上模拟分布式过程,因此需要针对本机(localhost)进行免key登陆的配置。 依此输入如下命令进行配置:

ssh-keygen -t rsa -P \'\' -f ~/.ssh/id_rsa cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys chmod 0600 ~/.ssh/authorized_keys

完成后尝试用SSH连接本机,如果不需要输入密码就能登陆,说明配置成功: ssh localhost

结果显示:

三、配置Java环境

安装jdk

使用 yum 来安装1.8版本 OpenJDK:

yum install java-1.8.0-openjdk java-1.8.0-openjdk-devel

(如果之前已经安装了jdk,可以通过which java找到安装的路径,我之前已经安装好了)

安装完成后,键入java和javac,如果能输出对应的命令帮助,则表明jdk已正确安装。

配置java环境变量

执行命令:

vim ~/.bashrc

在结尾追加:(jvm中java-1.8.0.???具体是多少自己看一下可能版本换了)

export JAVA_HOME=/usr/lib/jvm/java-1.8.0-openjdk-1.8.0.252.b09-2.el7_8.x86_64

保存文件后执行下面命令使 JAVA_HOME 环境变量生效:

source ~/.bashrc

为了检测系统中java环境是否已经正确配置并生效,可以分别执行以下命令:

java -version $JAVA_HOME/bin/java -version

若两条命令输出的结果一致,且都为我们前面安装的 openjdk-1.8.0 的版本,则表明 JDK 环境已经正确安装并配置。

四.安装hadoop

下载 Hadoop

本教程使用 hadoop-2.7 版本,使用 wget 工具在线下载

wget http://archive.apache.org/dist/hadoop/core/hadoop-2.7.5/hadoop-2.7.5.tar.gz

(这种下载方式可能比较慢)

建议从别处(百度云或者其他镜像)下载好了拷贝过来

安装 Hadoop

将 Hadoop 安装到 /usr/local 目录下:

tar -zxf hadoop-2.7.5.tar.gz -C /usr/local

对安装的目录进行重命名,便于后续操作方便:

mv ./hadoop-2.7.5/ ./hadoop

提示No such file or directory:需要先切换到local路径下再执行

在hadoop中配置环境变量

检查Hadoop是否已经正确安装:

/usr/local/hadoop/bin/hadoop version

Error:

JAVA_HOME is not set and could not be found.

echo $java_home 为空

注意区分大小写:echo $JAVA_HOME即可输出正确路径

如果成功输出hadoop的版本信息,表明hadoop已经成功安装。

五.hadoop伪分布式环境配置

(1)设置 Hadoop 的环境变量

编辑 ~/.bashrc,在结尾追加如下内容:

vim ~/.bashrc

export HADOOP_HOME=/usr/local/hadoop export HADOOP_INSTALL=$HADOOP_HOME export HADOOP_MAPRED_HOME=$HADOOP_HOME export HADOOP_COMMON_HOME=$HADOOP_HOME export HADOOP_HDFS_HOME=$HADOOP_HOME export YARN_HOME=$HADOOP_HOME exportHADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native export PATH=$PATH:$HADOOP_HOME/sbin:$HADOOP_HOME/bin

使Hadoop环境变量配置生效:

source ~/.bashrc

修改 Hadoop 的配置文件

Hadoop的配置文件位于安装目录的 /etc/hadoop目录下,在本教程中即位于 /usr/local/hadoop/etc/hadoop 目录下,需要修改的配置文件为如下两个:

/usr/local/hadoop/etc/hadoop/hdfs-site.xml

(2)编辑core-site.xml,修改<configuration></configuration>节点的内容为如下所示:

<configuration> <property> <name>hadoop.tmp.dir</name> <value>file:/usr/local/hadoop/tmp</value> <description>location to store temporary files</description> </property> <property> <name>fs.defaultFS</name> <value>hdfs://localhost:9000</value> </property> </configuration>

(3)配置HDFS文件,编辑 hdfs-site.xml,修改<configuration></configuration>节点的内容为如下所示:

<configuration> //设置HDFS文件副本数

<property> <name>dfs.replication</name> <value>1</value> </property>

//设置HDFS元数据文件存放路径 <property> <name>dfs.namenode.name.dir</name> <value>file:/usr/local/hadoop/tmp/dfs/name</value> </property>

<property> <name>dfs.datanode.data.dir</name> <value>file:/usr/local/hodoop/tmp/dfs/data</value> </property>

//设置其他用户执行操作是会提醒没有权限的问题

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

</configuration>

(4)(5)的xml位置没找到,未进行配置

(4)配置MapReduce文件mapred-site.xml

<property> <name>mapreduce.framework</name> <value>yarn</value> </property>

(5)配置YARN文件yarn-site.xml

<property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property>

(6)从节点配置文件slaves

hadoop000

格式化NameNode:

/usr/local/hadoop/bin/hdfs namenode -format

输出以下信息表示格式化成功:

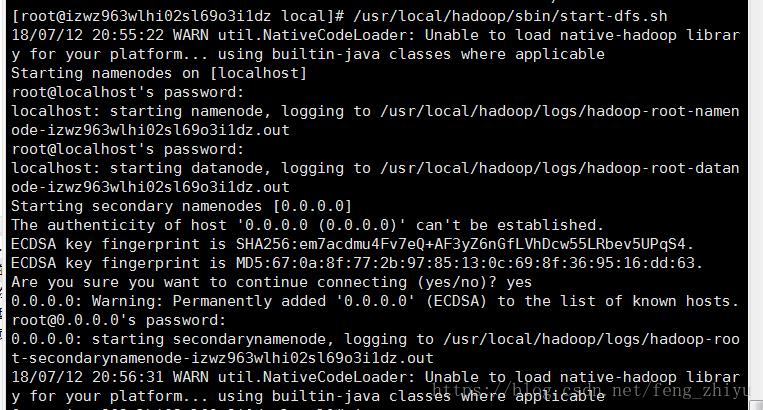

启动NameNode和DataNode进程:

/usr/local/hadoop/sbin/start-dfs.sh

执行过程中会提示输入用户密码,输入 root 用户密码即可。另外,启动时ssh会显示警告提示是否继续连接,输入 yes 即可

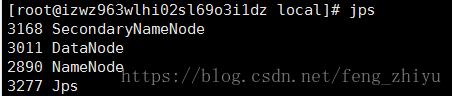

检查NameNode和DateNode是否正常启动。

jps

如果NameNode和DataNode已经正常启动,会显示NameNode、DataNode和SecondaryNameNode的进程信息:

如果jps命令后只显示jps的进程无其余三个进程信息,处理措施:

检查xml文件修改的是否正确

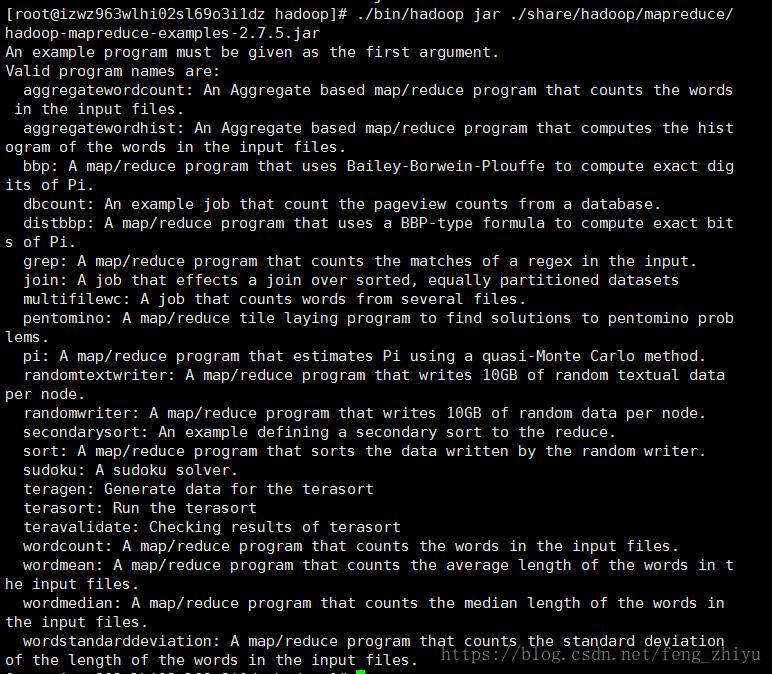

六、运行伪分布式实例

查看Hadoop自带的例子

Hadoop附带了丰富的例子,执行以下命令查看:

cd /usr/local/hadoop ./bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.5.jar

在HDFS中创建用户目录hadoop:

准备实验数据

本教程中,我们将以 Hadoop 所有的 xml 配置文件作为输入数据来完成实验。执行下面命令在 HDFS 中新建一个 input 文件夹并将 hadoop 配置文件上传到该文件夹下:

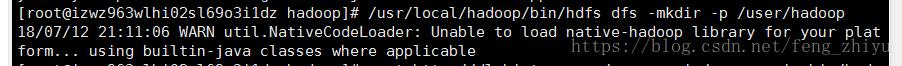

/usr/local/hadoop/bin/hdfs dfs -mkdir -p /user/hadoop

此时会出现警告:

原因:

Apache提供的hadoop本地库是32位的,而在64位的服务器上就会有问题,因此需要自己编译64位的版本。

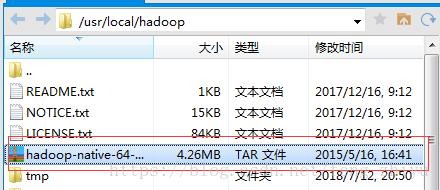

1、首先找到对应自己hadoop版本的64位的lib包,可以自己手动去编译,但比较麻烦,也可以去网上找,好多都有已经编译好了的。

2、可以去网站:http://dl.bintray.com/sequenceiq/sequenceiq-bin/ 下载对应的编译版本

3、将准备好的64位的lib包解压到已经安装好的hadoop安装目录的lib/native 和 lib目录下:

下载hadoop版本2.7.5对应的64位的lib包:

[root@izwz963wlhi02sl69o3i1dz hadoop]#

wget http://dl.bintray.com/sequenceiq/sequenceiq-bin/hadoop-native-64-2.7.0.tar

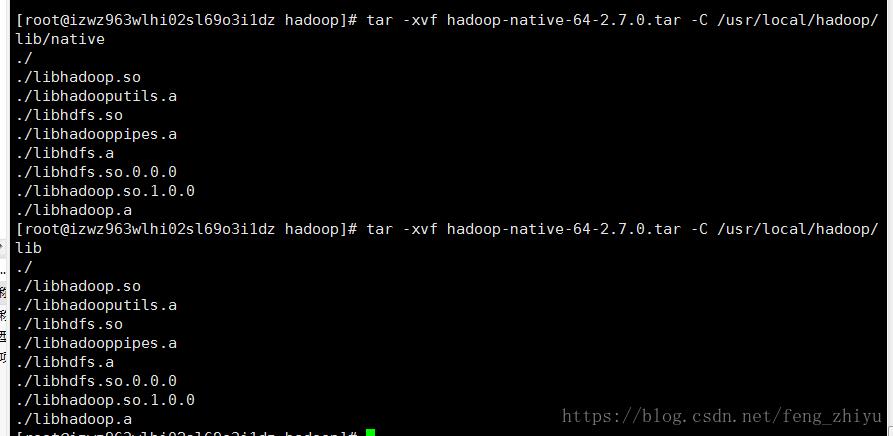

解压到已经安装好的hadoop安装目录的lib/native 和 lib目录下:

[root@izwz963wlhi02sl69o3i1dz hadoop]# tar -xvfhadoop-native-64-2.7.0.tar -C /usr/local/hadoop/lib/native [root@izwz963wlhi02sl69o3i1dz hadoop]# tar -xvfhadoop-native-64-2.7.0.tar -C /usr/local/hadoop/lib

4、添加环境变量

[root@izwz963wlhi02sl69o3i1dz hadoop]# vim /etc/profile

5、添加以下内容

export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native export HADOOP_OPTS="-Djava.library.path=$HADOOP_HOME/lib"

6、让环境变量生效

[root@izwz963wlhi02sl69o3i1dz hadoop]# source /etc/profile

source 后边有空格

7、自检hadoop checknative –a 指令检查

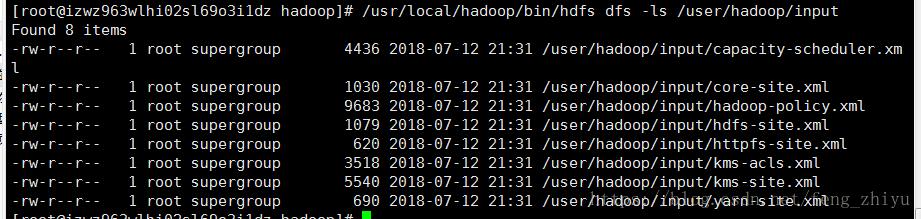

再次在HDFS 中创建用户目录 hadoop:

/usr/local/hadoop/bin/hdfs dfs -mkdir -p /user/hadoop

![]()

不再出现警告。

准备实验数据

本教程中,我们将以 Hadoop 所有的 xml 配置文件作为输入数据来完成实验。执行下面命令在 HDFS 中新建一个 input 文件夹并将 hadoop 配置文件上传到该文件夹下:

[root@izwz963wlhi02sl69o3i1dz hadoop]# cd /usr/local/hadoop

[root@izwz963wlhi02sl69o3i1dz hadoop]# ./bin/hdfs dfs -mkdir /user/hadoop/input

[root@izwz963wlhi02sl69o3i1dz hadoop]# ./bin/hdfs dfs -put ./etc/hadoop/*.xml /user/hadoop/input

使用下面命令可以查看刚刚上传到 HDFS 的文件:

/usr/local/hadoop/bin/hdfs dfs -ls /user/hadoop/input

运行实验:

[root@izwz963wlhi02sl69o3i1dz hadoop]# cd /usr/local/hadoop

[root@izwz963wlhi02sl69o3i1dz hadoop]# ./bin/hadoopjar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.5.jar grep/user/hadoop/input /user/hadoop/output \'dfs[a-z.]+\'

[root@izwz963wlhi02sl69o3i1dz hadoop]# cd/usr/local/hadoop [root@izwz963wlhi02sl69o3i1dz hadoop]# ./bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.5.jar grep /user/hadoop/input /user/hadoop/output \'dfs[a-z.]+\'

上述命令以 HDFS 文件系统中的 input 为输入数据来运行 Hadoop 自带的 grep 程序,提取其中符合正则表达式 dfs[a-z.]+ 的数据并进行次数统计,将结果输出到 HDFS 文件系统的 output 文件夹下。

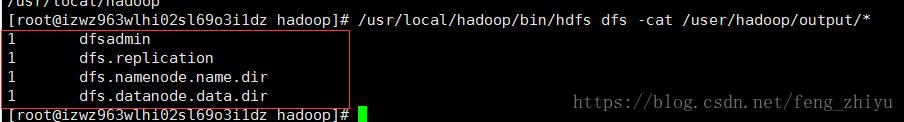

查看运行结果

上述例子完成后的结果保存在 HDFS 中,通过下面命令查看结果:

红色圈出的部分是运行成功的结果:

/usr/local/hadoop/bin/hdfs dfs -cat /user/hadoop/output/*

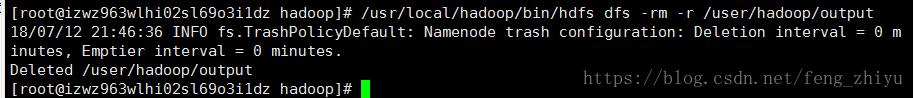

删除HDFS 中的结果目录:

/usr/local/hadoop/bin/hdfs dfs -rm -r /user/hadoop/output

运行Hadoop 程序时,为了防止覆盖结果,程序指定的输出目录不能存在,否则会提示错误,因此在下次运行前需要先删除输出目录。

(一)HDFS操作

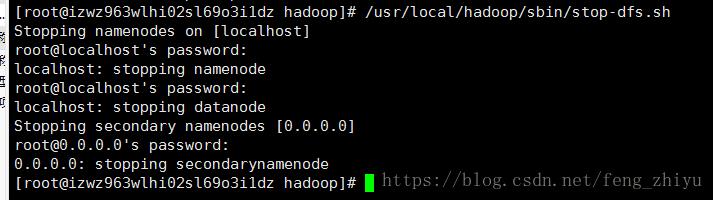

关闭Hadoop进程:

/usr/local/hadoop/sbin/stop-dfs.sh

再次启动Hadoop进程的命令:

①一次性启动所有进程:

[root@izwz963wlhi02sl69o3i1dz hadoop]#/usr/local/hadoop/sbin/start-dfs.sh

②单独启动某个进程

hadoop-daemon.sh start namenode/datanode/secondarynode

七、部署完成

参考:

官方文档

https://blog.csdn.net/feng_zhiyu/article/details/81018869

以上是关于阿里云服务器器上Centos7搭建伪分布式HADOOP详细教程的主要内容,如果未能解决你的问题,请参考以下文章

Hadoop集群搭建记录 | 云计算[CentOS7] | 伪分布式集群 Java环境配置(Oracle JDK)

我用免费白拿的服务器搭建了一台基于CentOS7的Hadoop3.x伪分布式环境

我用免费白拿的服务器搭建了一台基于CentOS7的Hadoop3.x伪分布式环境

我用免费白拿的服务器搭建了一台基于CentOS7的Hadoop3.x伪分布式环境