时隔两年,CV大神何恺明最新一作:视觉预训练新范式MAE!大道至简!

Posted 机器学习算法与Python学习-公众号

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了时隔两年,CV大神何恺明最新一作:视觉预训练新范式MAE!大道至简!相关的知识,希望对你有一定的参考价值。

点击 机器学习算法与Python学习 ,选择加星标

精彩内容不迷路

新智元报道

CV大神何恺明又出力作!团队提出MAE模型,将NLP领域大获成功的自监督预训练模式用在了计算机视觉任务上,效果拔群,在NLP和CV两大领域间架起了一座更简便的桥梁。

CV大神何恺明又出力作!

这次,何大神让BERT式预训练在CV上也能训的很好。

论文「Masked Autoencoders Are Scalable Vision Learners」证明了 masked autoencoders(MAE) 是一种可扩展的计算机视觉自监督学习方法。

目前,该论文已于11月11日提交在arxiv上。论文地址:https://arxiv.org/abs/2111.06377

论文成果简介

此文最大的贡献,可能是在NLP和CV两大领域之间架起了一座更简便的桥梁。

此前,大名鼎鼎的GPT和BERT已经将大型自然语言处理(NLP)模型的性能提升到了一个新的高度。

直观点讲,就是事先遮住一些文本片段,让AI模型通过自监督学习,通过海量语料库的预训练,逐步掌握上下文语境,把这些被遮住的片段,用尽可能合乎逻辑的方式填回去。

这和我们做「完形填空」的方式有些类似。经过海量数据的学习和训练,AI模型慢慢学会了自己生成自然文本。目前,随着GPT及其后续改进模型的不断进步,生成的自然文本几乎可以乱真。

现在,何恺明的这篇文章把NLP领域已被证明极其有效的方式,用在了计算机视觉(CV)领域,而且模型更简单。

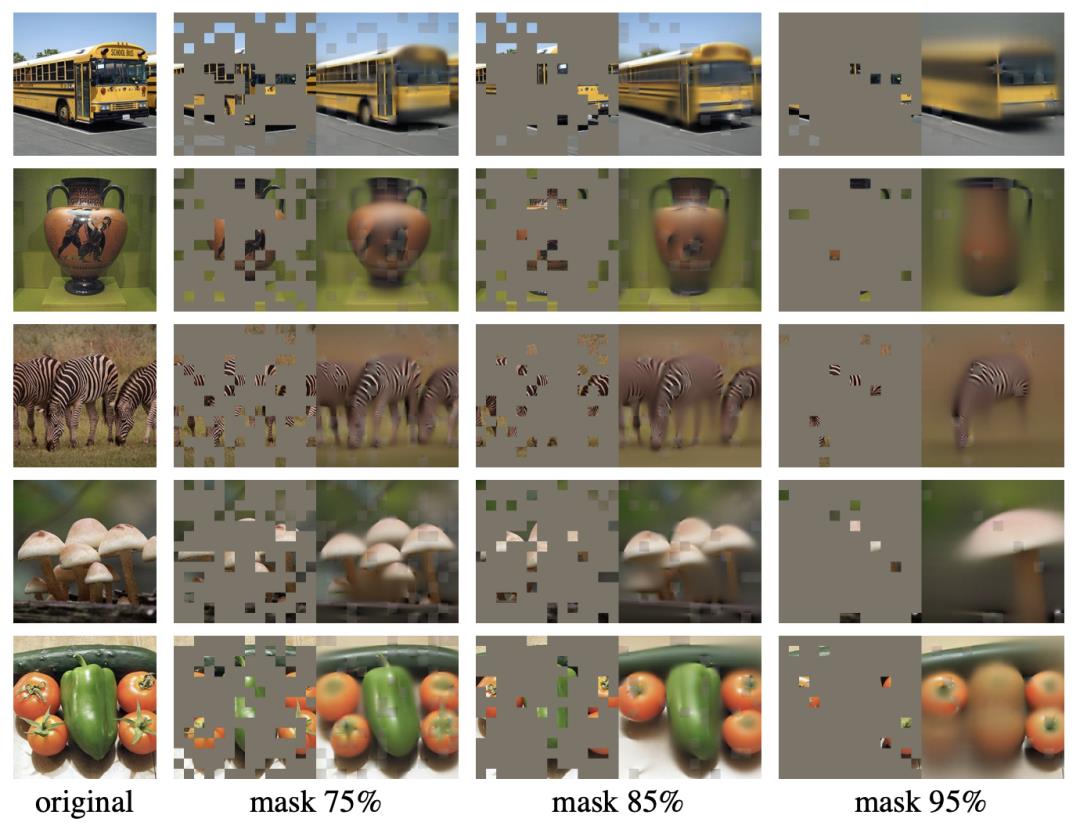

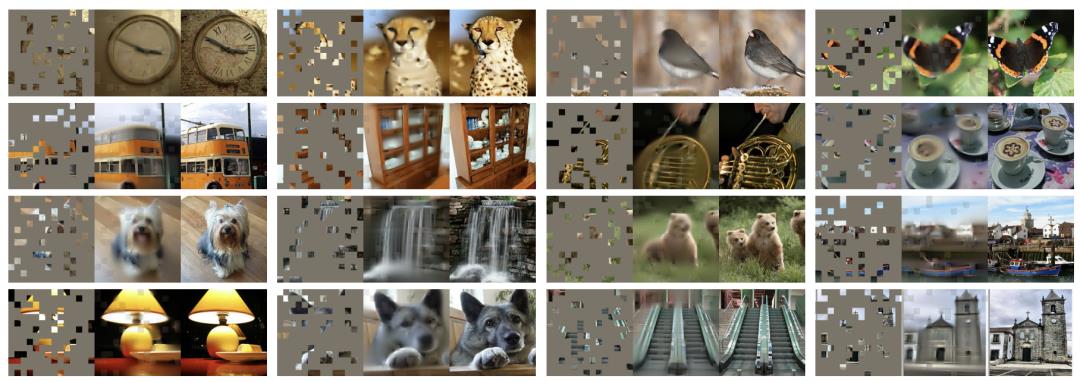

一起先来看下效果:

遮住95%的像素后,仍能还原出物体的轮廓,这居然还能work!

本文提出了一种掩膜自编码器 (MAE)架构,可以作为计算机视觉的可扩展自监督学习器使用,而且效果拔群。

实现方法很简单:先将输入图像的随机部分予以屏蔽(Mask),再重建丢失的像素。

MAE模型结构与实现

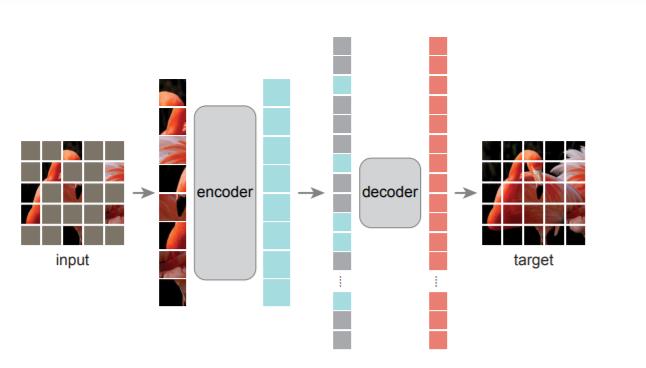

本文提出的MAE架构如下:

在预训练期间,大比例的随机的图像块子集(如 75%)被屏蔽掉。编码器用于可见patch的小子集。在编码器之后引入掩码标记,并且完整的编码块和掩码标记集由一个小型解码器处理,该解码器以像素为单位重建原始图像。

预训练后,解码器被丢弃,编码器应用于未损坏的图像以生成识别任务的表示。

MAE 是一种简单的自编码方法,可以在给定部分观察的情况下重建原始信号。由编码器将观察到的信号映射到潜在表示,再由解码器从潜在表示重建原始信号。

与经典的自动编码器不同,MAE采用非对称设计,允许编码器仅对部分观察信号(无掩码标记)进行操作,并采用轻量级解码器从潜在表示和掩码标记中重建完整信号。

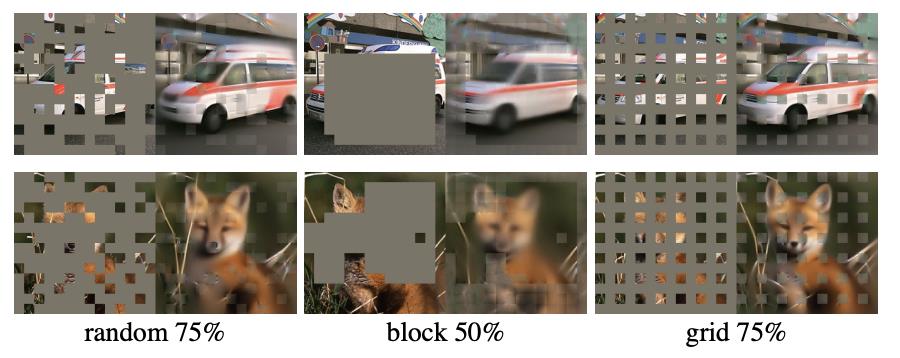

掩膜

将图像划分为规则的非重叠patch。对patch的子集进行采样并屏蔽剩余patch。我们的采样策略很简单:均匀分布,简单称为“随机抽样”。

MAE 编码器

编码器仅适用于可见的、未屏蔽的patch。编码器通过添加位置嵌入的线性投影嵌入patch,然后通过一系列 Transformer 块处理结果集。编码器只对整个集合的一小部分(如 25%)进行操作。

被屏蔽的patch会被移除;不使用掩码令牌。这样可以节约计算资源,使用一小部分计算和内存来训练非常大的编码器。

MAE解码器

解码器的输入是完整的令牌集。每个掩码标记代表一个共享的、学习过的向量,表示存在要预测的缺失patch。

解码器仅在预训练期间用于执行图像重建任务。因此,它的设计可以独立于编码器。实验中使用的解码器更加轻量级。通过这种非对称设计,显著减少了预训练时间。

图像目标的重建

MAE 通过预测每个掩码块的像素值来重建输入图像。

解码器输出中的每个元素都是一个表示补丁的像素值向量。解码器的最后一层是线性投影,其输出通道的数量等于补丁中像素值的数量。解码器的输出被重新整形以形成重建的图像。

MAE 预训练实施效率高,实现方式简单,而且不需要任何专门的稀疏操作。

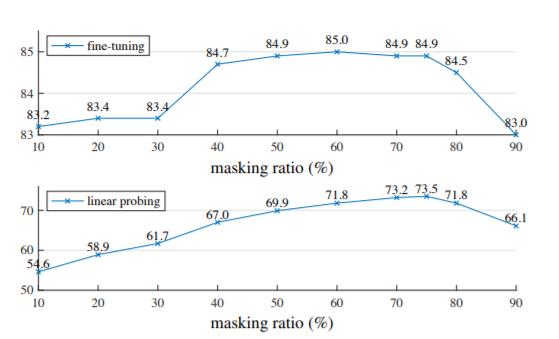

从上图可以看出,随着输入图像被遮住的比例升高,MAE的性能迅速上升,在75%左右达到最佳效果。

性能惊艳:ImageNet-1K最高87.8%

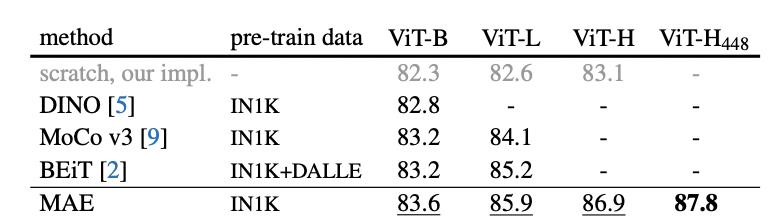

与当前SOTA自监督预训练方法相比,对于 ViT-B 的表现结果都很接近。对于 ViT-L不同方法的结果就存在很大差距,这表明更大模型的挑战是减少过度拟合。

再看最后一列,仅使用ImageNet-1K数据时,ViT-Huge模型的最高精确度为87.8%,这明显超过了所有在ImageNet-21K 预训练的ViT变种模型。

作者总结道,与 BEiT方法相比,MAE更准确、更简单、更高效。

作者介绍

何恺明,本科就读于清华大学,博士毕业于香港中文大学多媒体实验室。

2011年加入微软亚洲研究院(MSRA)工作,主要研究计算机视觉和深度学习。2016年,加入Facebook AI Research(FAIR)担任研究科学家。

2020年1月11日,荣登AI全球最具影响力学者榜单。

参考资料:

https://arxiv.org/abs/2111.06377

https://www.zhihu.com/question/498364155/answers/updated

https://www.zhihu.com/question/498364155/answer/2219622610

觉得不错,请点个在看呀以上是关于时隔两年,CV大神何恺明最新一作:视觉预训练新范式MAE!大道至简!的主要内容,如果未能解决你的问题,请参考以下文章

何恺明时隔2年再发一作论文:为视觉大模型开路,“CVPR 2022最佳论文候选预定”...

何恺明等最新突破:视频识别快慢结合,取得人体动作AVA数据集最佳水平

《Video MAE》何恺明团队提出视频版本的MAE,进行高效视频预训练!Mask Ratio高达90%时效果很好!...