论文泛读191简化的多模态预训练模型上的多阶段预训练

Posted 及时行樂_

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了论文泛读191简化的多模态预训练模型上的多阶段预训练相关的知识,希望对你有一定的参考价值。

贴一下汇总贴:论文阅读记录

论文链接:《Multi-stage Pre-training over Simplified Multimodal Pre-training Models》

一、摘要

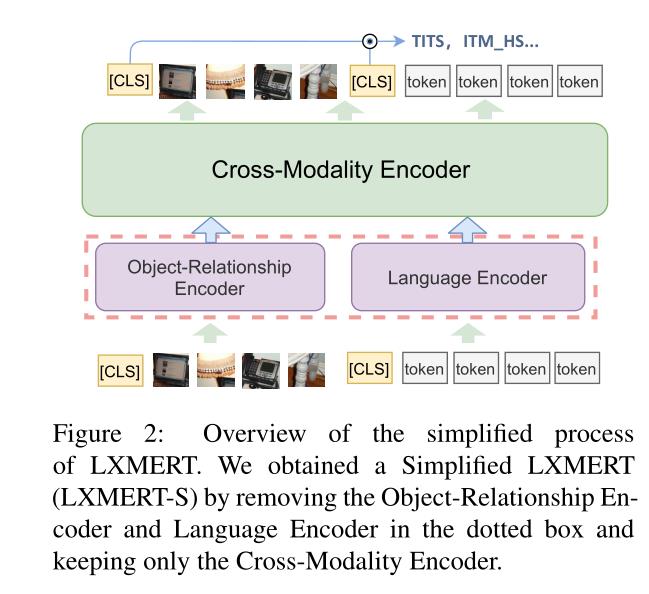

LXMERT 等多模态预训练模型在下游任务中取得了优异的成绩。然而,当前的预训练模型需要大量的训练数据,并且模型规模庞大,这使得它们难以应用于资源匮乏的情况。如何在预训练数据较少、模型尺寸较小的前提下,获得与较大模型相似甚至更好的性能成为一个重要问题。在本文中,我们提出了一种新的多阶段预训练 (MSP) 方法,该方法使用文本和图像中从单词、短语到句子的不同粒度的信息来分阶段预训练模型。我们还设计了适合不同阶段信息粒度的几种不同的预训练任务,以便从有限的语料库中有效地捕获不同的知识。我们采用一个简化的 LXMERT (LXMERT-S) 作为我们 MSP 方法的测试平台,它只有原始 LXMERT 模型的 45.9% 的参数和原始预训练数据的 11.76%。实验结果表明,我们的方法在所有下游任务中都达到了与原始 LXMERT 模型相当的性能,甚至在图像文本检索任务中优于原始模型。

二、结论

本文受课程学习思想的启发,提出了一种MSP方法,该方法利用文本和图像中从单词、短语到句子不同粒度的信息分阶段对模型进行预训练,并设计了适合预训练各阶段的预训练任务,基于单词的预训练采用IFRS任务,基于短语的预训练采用TITP任务,基于句子的预训练采用山雀任务。在多个VQA数据集和一个跨模态检索数据集上的实验结果表明,在模型参数减少54.1%和训练数据集减少88.24%的前提下,我们的方法在所有下游任务中的准确率都达到了与更大模型相似甚至更好的性能。在今后的工作中,我们将把上述训练方法加入到其他简化的预训练模型中,进一步探索MSP方法的有效性。

三、model

LXMERT简化流程概述:

以上是关于论文泛读191简化的多模态预训练模型上的多阶段预训练的主要内容,如果未能解决你的问题,请参考以下文章

论文泛读200通过适配器使用预训练语言模型进行稳健的迁移学习