论文解读丨空洞卷积框架搜索

Posted 华为云开发者社区

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了论文解读丨空洞卷积框架搜索相关的知识,希望对你有一定的参考价值。

摘要:在通用目标检测算法,空洞卷积能有效地提升网络的感受野,进而提升算法的性能。本次解读的文章提出了一种空洞卷积变体及对应的空洞卷积搜索方法,充分探索空洞卷积的潜力,进一步提升网络模型的性能。

本文分享自华为云社区《论文解读系列十:空洞卷积框架搜索》,原文作者:我想静静 。

空洞卷积是标准卷积神经网络算子的一种变体,可以控制有效的感受野并处理对象的大尺度方差,而无需引入额外的计算。但是,在文献中很少讨论针对不同的数据,如何设计调整空洞卷积使其得到更好的感受野,进而提升模型性能。为了充分挖掘其潜力,本文提出了一种新的空洞卷积变体,即inception (dilated)卷积,其中卷积在不同轴,通道和层之间具有独立的空洞。

同时,本文提出了一种基于统计优化的简单而高效的空洞搜索算法(EDO,effective dilation search),自适应搜索对训练数据友好的空洞卷积配置方法。该搜索方法以零成本方式运行,该方法极其快速地应用于大规模数据集。

方法

在不同任务中对于输入图像的大小和目标对象的不同,有效感受野(effictive reveptive field,ERF)的要求也有所不同。图像分类输入的尺寸比较小,目标检测中输入的size而比较大,目标的范围也很大。即使对于固定网络的同一任务,某一层卷积的最优解ERF也和标注卷积不一定一样,于是为了适应不同ERF的要求,需要针对不同任务提供一种通用的ERF算法。

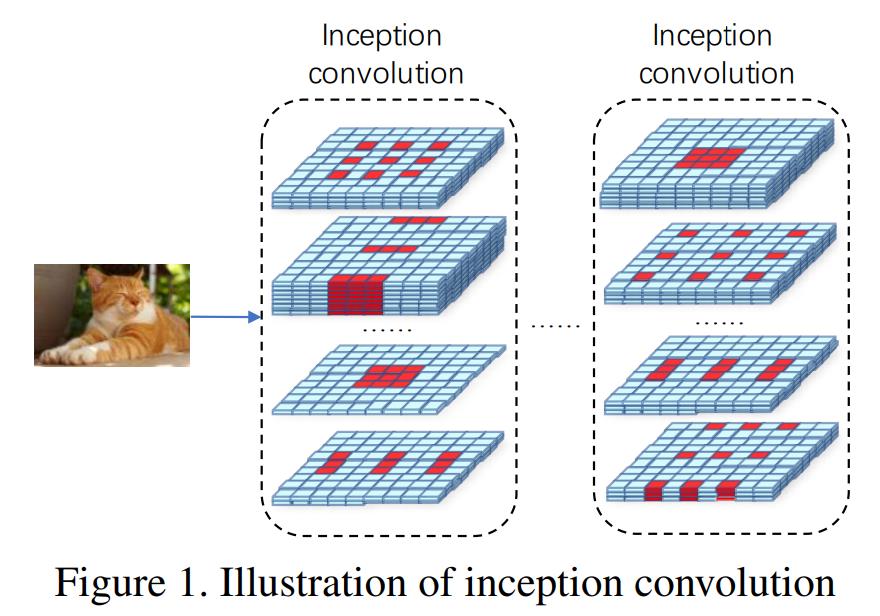

本文提出一种膨胀卷积的变体,Inception卷积,他包含多种膨胀模式如下图:

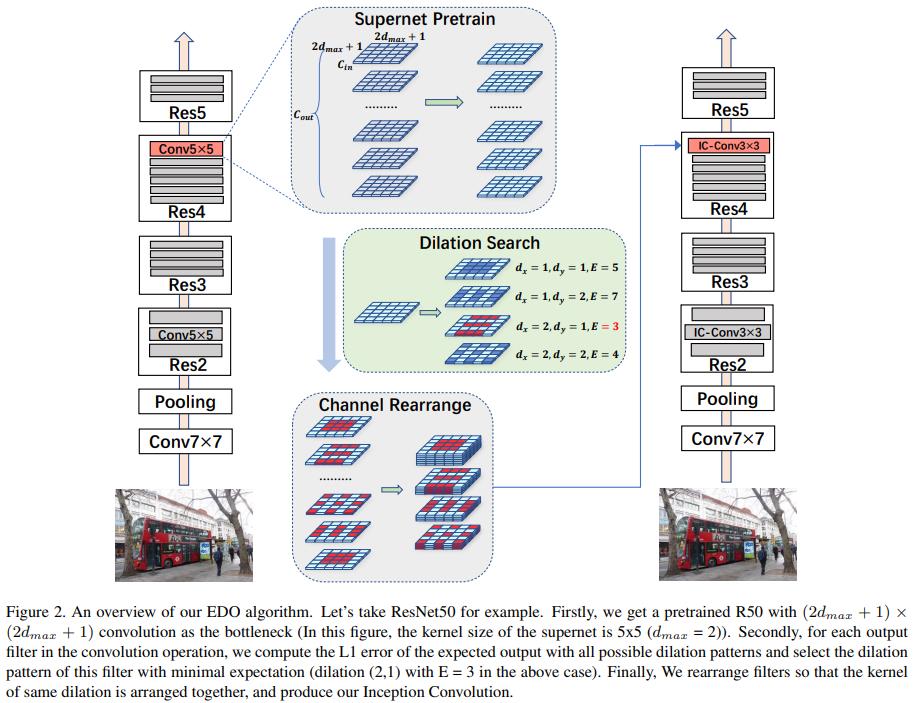

Incetption 卷积提供了一个密集可能的ERF范围,该文提供了一种高效的膨胀优化算法(EOD),其中超网络的每层都是一个标准的卷积操作,该卷积包含了所有可能的膨胀模式。对每一层的选择,通过最小化原始卷积层和与所选膨胀模式的卷积的期望误差,使用一个预训练的权值解决选择问题。具体流程如下图所示:

上图为EDO的算法概述,以resnet50为例,我们先在训练数据上训练获得一个bottleneck卷积内核为(2dmax + 1) × (2dmax + 1)的res50。这个例子里,supernet的内核为5*5,所以dmax=2。然后对于卷积运算的每个filter的输出,我们要计算与预期输出的L1误差,选择最小的(这个例子里是E=3)。最后重新安排filter使相同的空洞卷积排在一起,就成为了我们的inception convolution。

实验结果

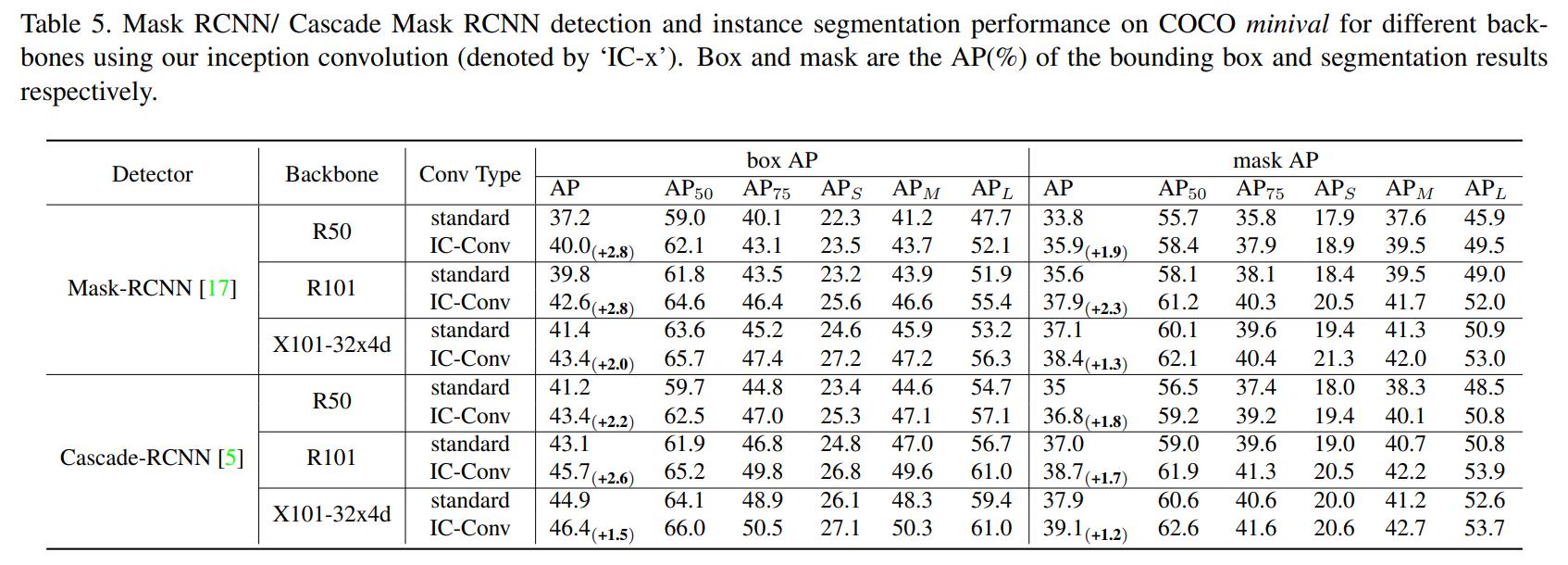

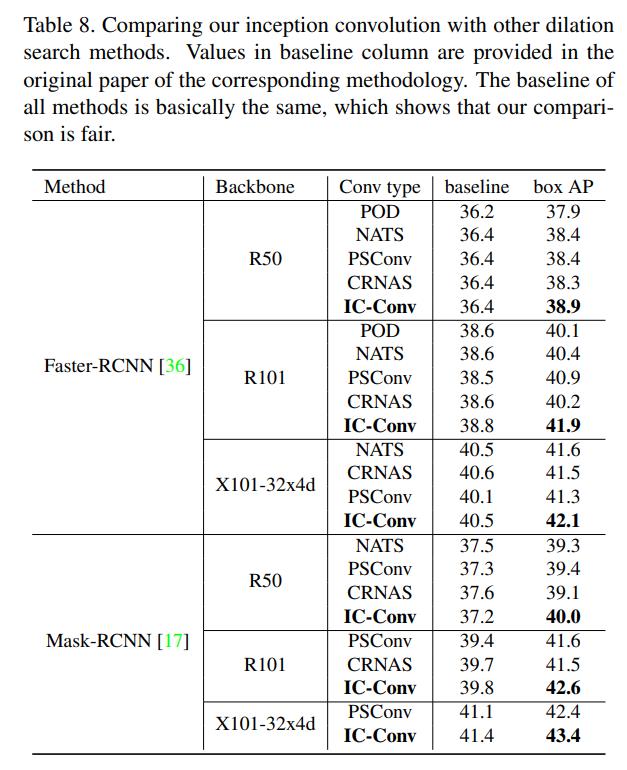

实证结果表明,本文方法在广泛的Baseline测试中获得了一致的性能提升。例如,通过简单地将ResNet-50主干中的3x3标准卷积替换为Inception Conv,将Faster-RCNN在MS-COCO上的mAP从36.4%提高到39.2%。此外,在ResNet-101骨干网中使用相同的替代方法,在自下而上的人体姿势估计上将AP得分从COCO val2017的AP得分从60.2%大幅提高到68.5%。

以上是关于论文解读丨空洞卷积框架搜索的主要内容,如果未能解决你的问题,请参考以下文章