支持向量机

Posted

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了支持向量机相关的知识,希望对你有一定的参考价值。

参考技术A 本文主要参考了李航的《统计学习方法》。是本人学习支持向量机的学习笔记。

首先对支持向量机做简单介绍,然后分别介绍以下三个模型:

(1)线性可分支持向量机: 又称为硬间隔支持向量机,通过硬间隔最大化来学习一个线性分类器。适合 数据线性可分 情况;

(2)线性支持向量机: 又称为软间隔支持向量机,通过软间隔最大化来学习一个线性分类器。适合 数据近似线性可分 情况;

(3)非线性支持向量机: 通过核技巧和软间隔最大化来学一个非线性分类器。适合 数据非线性可分 情况

本文将对三个模型的介绍,从原始问题导出对偶问题。得到对偶问题以后,通过SMO算法对模型参数进行求解。最后,如果有机会再介绍以下支持向量机模型参数是如何利用SMO算法学习和训练的。

两堆数据怎么样才是线性可分就不再赘述,否则请出门左拐百度“线性可分”。支持向量机学习的目的是找到一个将两类数据分离的超平面,这个超平面可以描述为:

但实际上,我们通过给定的线性可分数据集能够拟合出来的模型为:

其中带了星号的 和 是超平面模型的参数,表示是从数据集中学习得到的经验值或者说是估计值。与理论上的模型差别就在于这两个参数。如果数据足够多,那么经验值与理论值就近似相等了。

为什么要引入间隔呢?为什么还有除了函数间隔之外还有个几何间隔?

什么是间隔,间隔就是样本点与分离超平面之间的距离。支持向量机学习的目标就是将间隔最大化。

支持向量机在学习过程中最终目的是找到一个能将数据分离的超平面。但将数据分离完成后还不够完美,还需要使得这个分离超平面具有足够的正确性和确信度。

假设我们得到了一个超平面 ,如果有一个点 ,则我们可以采用 来表示分类的正确性和确信度。 的正负取值描述正确性; 的取值描述确信度。

我们用变量 来表示第i个样本与超平面之间的函数间隔描述式:

在定义和寻找超平面的时候就是在训练集 中寻找最小的函数间隔,即:

先不废话,直接给出几何间隔的描述式,然后再解释要引入几何间隔。免得看一堆字看的懵逼。

可以看到函数间隔和集合间隔相比,参数 和 的分母上多了个 ,为什么要这样做呢?因为我们需要对参数 和 进行约束。如果不进行约束,求出来的超平面 与不加约束是相同的(毕竟 和 前面的系数可以约掉),但 和 的实际可能会大个好几倍,会导致超平面的确信度 变得十分不可靠。因此,我们对函数间隔加以约束,引入几何间隔的概念。

在定义和寻找超平面的时候就是在训练集 中寻找最小的几何间隔,即:

函数间隔和几何间隔的关系:

支持向量机学习的目的是找到一个几何间隔最大的、能正确划分数据集 的分离超平面。有目标,有约束,那么就可以表示为一个有约束的最优化问题,用几何间隔描述:

用函数间隔描述:

为了方便转换为最优化问题,我们将约束项 保留的同时,对 积分得到 ,使得最大化 问题等价转换为最小化 ;令 ; 利用两个数学技巧得到最终的最优化问题:

线性可分支持向量机最优化问题

我们求出最优解 后,可以得到分离超平面:

对新样本进行决策分类函数为:

决策分类函数的意思就是将新样本的特征值 带入式子 中,根据得出正负取值来进行分类。

其中, 函数:

原始问题:线性可分支持向量机最优化问题

为了导出它的对偶问题,我们构造一个拉格朗日函数:

根据拉格朗日对偶性,原始问题的对偶问题是极大极小问题

先求极小化问题,再求极大化问题。

(1)求极小化问题 :

将 对 和 求偏导并令其等于0

将上面两个式子得出的结果代回到 :

于是就求得:

(2)求极大化问题 :

我们把上一步的结果带入第二步中,再加上约束条件可以得到:

再把负号去掉,使得最大化问题等价转化为最小化问题

这样就得到了对偶问题的最优化问题,然后采用如SMO这种参数估计方法来对参数进行求解。

原始问题的解

假设我们求出了对偶最优化问题的解 ,则存在一个下标j使得 ,我们就可以根据关系推导出原始最优化问题的解 ( 这是一个定理,证明请参考李航的《统计学习方法》 ):

正如本文开篇所说的,线性支持向量机用来解决近似线性可分的数据分类问题。我们在线性可分支持向量机的基础对数据集 中的每一个样本都引入一个松弛变量 ,并对目标函数引入一个惩罚项,改变原来的目标函数和约束条件,使得线性支持向量机的 原始问题 为:

根据原始问题构造拉格朗日函数:

根据拉格朗日对偶性,原始问题的对偶问题是极大极小问题

(1)求极小化问题

将 对 求偏导并令其等于0:

将上面的结果代回拉格朗日函数得到:

(2)求极大化问题

通过上一步我们求解得到了极小化问题的表达式,接下来我们求解极大化问题:

实际上,通过约束条件中的非零关系,可以进一步将约束条件简化为 .我们可以得到最终的 线性支持向量机的对偶最优化问题:

原始问题的解

原始问题的解与前面的线性可分支持向量机一样,假设我们求出了对偶最优化问题的解 ,则存在一个下标j使得 ,我们就可以根据关系推导出原始最优化问题的解 ( 这也是一个定理,证明请参考李航的《统计学习方法》 ):

对新样本进行决策分类函数的对偶形式为:

决策分类函数的意思就是将新样本的特征值 带入式子 中,根据得出正负取值来进行分类。

其中, 函数:

非线性支持向量机中用一个核函数来替代输入实例向量之间的内积,从而实现了把线性不可分的低维数据映射成线性可分的高维数据,然后再用超平面对高维空间内的数据进行分类。

其实,可以看到上面的最优化问题和分类决策函数中只涉及到了输入实例# 的内积,因此我们可以通过核函数代替输入实例之间的内积。从而达到用核函数把数据映射到高维空间的目的。

我们用核函数 来代替实例之间的内积 后可以写出 非线性支持向量机的对偶最优化问题 和 分类决策函数:

最优化问题:

分类决策函数:

当核函数 是正定核函数时,最优化问题是凸二次规划问题,解存在。

为了搞清楚这个问题,首先要想想提出核函数的动机什么?提出核函数的目的是为了把低维数据映射成高维数据啊,然后好用一个分类超平面对这些数据分类。但是映射完成后的高维空间是什么样的我们并不清楚,好像目前只能保证哪些函数可以作为核函数使用,而不能为每种输入数据分布巧妙地设计出一个个核函数。而实际应用中也是在尝试使用各种各样的核函数,如高斯核函数、多项式核函数、线性核函数、sigmoid核函数、拉普拉斯核函数、字符串核函数等。

既然不能对每次的输入数据设计出合适的核函数,我们总能讨论一下什么样的函数才有资格成为核函数,因此我们退而求其次,有空去了解一下为什么核函数 必须要是正定核函数?虽然在实际应用中我们直接就采用几种常见的核函数进行尝试。

参考: https://blog.csdn.net/jiangjieqazwsx/article/details/51418681

支持向量机原理 线性支持向量机的软间隔最大化模型

? ? ? ? ? ?支持向量机原理(一) 线性支持向量机

在支持向量机原理(一) 线性支持向量机中,我们对线性可分SVM的模型和损失函数优化做了总结。最后我们提到了有时候不能线性可分的原因是线性数据集里面多了少量的异常点,由于这些异常点导致了数据集不能线性可分,本篇就对线性支持向量机如何处理这些异常点的原理方法做一个总结。

一、线性分类SVM面临的问题

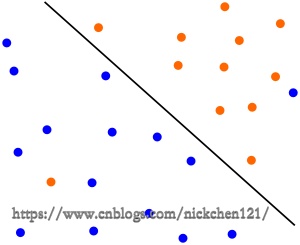

有时候本来数据的确是可分的,也就是说可以用?线性分类SVM的学习方法来求解,但是却因为混入了异常点,导致不能线性可分,比如下图,本来数据是可以按下面的实线来做超平面分离的,可以由于一个橙色和一个蓝色的异常点导致我们没法按照上一篇线性支持向量机中的方法来分类。

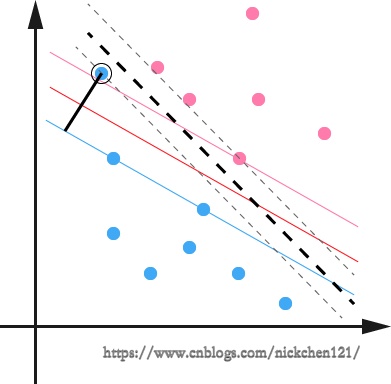

另外一种情况没有这么糟糕到不可分,但是会严重影响我们模型的泛化预测效果,比如下图,本来如果我们不考虑异常点,SVM的超平面应该是下图中的红色线所示,但是由于有一个蓝色的异常点,导致我们学习到的超平面是下图中的粗虚线所示,这样会严重影响我们的分类模型预测效果。

如何解决这些问题呢?SVM引入了软间隔最大化的方法来解决。

二、2.?线性分类SVM的软间隔最大化

所谓的软间隔,是相对于硬间隔说的,我们可以认为上一篇线性分类SVM的学习方法属于硬间隔最大化。

回顾下硬间隔最大化的条件:

\\[

min\\;\\; \\frac12|w|_2^2? \\;\\; s.t \\;\\; y_i(w^Tx_i + b) ?\\geq 1 (i =1,2,...m)

\\]

接着我们再看如何可以软间隔最大化呢?

SVM对训练集里面的每个样本\\((x_i,y_i)\\)引入了一个松弛变量\\(\\xi_i \\geq 0\\),使函数间隔加上松弛变量大于等于1,也就是说:

\\[

y_i(w\\bullet x_i +b) \\geq 1- \\xi_i

\\]

对比硬间隔最大化,可以看到我们对样本到超平面的函数距离的要求放松了,之前是一定要大于等于1,现在只需要加上一个大于等于0的松弛变量能大于等于1就可以了。当然,松弛变量不能白加,这是有成本的,每一个松弛变量\\(\\xi_i\\), 对应了一个代价\\(\\xi_i\\),这个就得到了我们的软间隔最大化的SVM学习条件如下:

\\[

min\\;\\; \\frac12|w|_2^2 +C\\sum\\limits_i=1^m\\xi_i

\\]

\\[ s.t. ?\\;\\; y_i(w^Tx_i + b) ?\\geq 1 - \\xi_i \\;\\;(i =1,2,...m) \\]

\\[ \\xi_i \\geq 0 \\;\\;(i =1,2,...m) \\]

这里,\\(C>;0\\)为惩罚参数,可以理解为我们一般回归和分类问题正则化时候的参数。\\(C\\)越大,对误分类的惩罚越大,\\(C\\)越小,对误分类的惩罚越小。

也就是说,我们希望\\(\\frac12|w|_2^2\\)尽量小,误分类的点尽可能的少。C是协调两者关系的正则化惩罚系数。在实际应用中,需要调参来选择。

这个目标函数的优化和上一篇的线性可分SVM的优化方式类似,我们下面就来看看怎么对线性分类SVM的软间隔最大化来进行学习优化。

三、线性分类SVM的软间隔最大化目标函数的优化

和线性可分SVM的优化方式类似,我们首先将软间隔最大化的约束问题用拉格朗日函数转化为无约束问题如下:

\\[

L(w,b,\\xi,\\alpha,\\mu) = \\frac12|w|_2^2 +C\\sum\\limits_i=1^m\\xi_i - \\sum\\limits_i=1^m\\alpha_i[y_i(w^Tx_i + b) - 1 + \\xi_i] - \\sum\\limits_i=1^m\\mu_i\\xi_i

\\]

其中 \\(\\mu_i \\geq 0, \\alpha_i \\geq 0\\),均为拉格朗日系数。

也就是说,我们现在要优化的目标函数是:

\\[

\\underbracemin_w,b,\\xi\\; \\underbracemax_\\alpha_i \\geq 0, \\mu_i \\geq 0, L(w,b,\\alpha, \\xi,\\mu)

\\]

这个优化目标也满足KKT条件,也就是说,我们可以通过拉格朗日对偶将我们的优化问题转化为等价的对偶问题来求解如下:

\\[

\\underbracemax_\\alpha_i \\geq 0, \\mu_i \\geq 0, \\; \\underbracemin_w,b,\\xi\\; L(w,b,\\alpha, \\xi,\\mu)

\\]

我们可以先求优化函数对于$w, b, \\xi \\(的极小值, 接着再求拉格朗日乘子\\)\\alpha$和 \\(\\mu\\)的极大值。

首先我们来求优化函数对于$w, b, \\xi $的极小值,这个可以通过求偏导数求得:

\\[

\\frac\\partial L\\partial w = 0 \\;\\Rightarrow w = \\sum\\limits_i=1^m\\alpha_iy_ix_i

\\]

\\[ \\frac\\partial L\\partial b = 0 \\;\\Rightarrow \\sum\\limits_i=1^m\\alpha_iy_i = 0 \\]

\\[ \\frac\\partial L\\partial \\xi = 0 \\;\\Rightarrow C- \\alpha_i - \\mu_i = 0 \\]

好了,我们可以利用上面的三个式子去消除\\(w\\)和\\(b\\)了。

\\[ \\beginalign L(w,b,\\xi,\\alpha,\\mu) & = \\frac12|w|_2^2 +C\\sum\\limits_i=1^m\\xi_i - \\sum\\limits_i=1^m\\alpha_i[y_i(w^Tx_i + b) - 1 + \\xi_i] - \\sum\\limits_i=1^m\\mu_i\\xi_i \\\\&= \\frac12|w|_2^2 - \\sum\\limits_i=1^m\\alpha_i[y_i(w^Tx_i + b) - 1 + \\xi_i] + \\sum\\limits_i=1^m\\alpha_i\\xi_i \\\\& = \\frac12|w|_2^2 - \\sum\\limits_i=1^m\\alpha_i[y_i(w^Tx_i + b) - 1] \\\\& = \\frac12w^Tw-\\sum\\limits_i=1^m\\alpha_iy_iw^Tx_i - \\sum\\limits_i=1^m\\alpha_iy_ib + \\sum\\limits_i=1^m\\alpha_i \\\\& = \\frac12w^T\\sum\\limits_i=1^m\\alpha_iy_ix_i -\\sum\\limits_i=1^m\\alpha_iy_iw^Tx_i - \\sum\\limits_i=1^m\\alpha_iy_ib + \\sum\\limits_i=1^m\\alpha_i \\\\& = \\frac12w^T\\sum\\limits_i=1^m\\alpha_iy_ix_i - w^T\\sum\\limits_i=1^m\\alpha_iy_ix_i - \\sum\\limits_i=1^m\\alpha_iy_ib + \\sum\\limits_i=1^m\\alpha_i \\\\& = - \\frac12w^T\\sum\\limits_i=1^m\\alpha_iy_ix_i - \\sum\\limits_i=1^m\\alpha_iy_ib + \\sum\\limits_i=1^m\\alpha_i \\\\& = - \\frac12w^T\\sum\\limits_i=1^m\\alpha_iy_ix_i - b\\sum\\limits_i=1^m\\alpha_iy_i + \\sum\\limits_i=1^m\\alpha_i \\\\& = -\\frac12(\\sum\\limits_i=1^m\\alpha_iy_ix_i)^T(\\sum\\limits_i=1^m\\alpha_iy_ix_i) - b\\sum\\limits_i=1^m\\alpha_iy_i + \\sum\\limits_i=1^m\\alpha_i \\\\& = -\\frac12\\sum\\limits_i=1^m\\alpha_iy_ix_i^T\\sum\\limits_i=1^m\\alpha_iy_ix_i - b\\sum\\limits_i=1^m\\alpha_iy_i + \\sum\\limits_i=1^m\\alpha_i \\\\& = -\\frac12\\sum\\limits_i=1^m\\alpha_iy_ix_i^T\\sum\\limits_i=1^m\\alpha_iy_ix_i + \\sum\\limits_i=1^m\\alpha_i \\\\& = -\\frac12\\sum\\limits_i=1,j=1^m\\alpha_iy_ix_i^T\\alpha_jy_jx_j + \\sum\\limits_i=1^m\\alpha_i \\\\& = \\sum\\limits_i=1^m\\alpha_i - \\frac12\\sum\\limits_i=1,j=1^m\\alpha_i\\alpha_jy_iy_jx_i^Tx_j \\endalign \\]

其中,(1)式到(2)式用到了\\(C- \\alpha_i - \\mu_i = 0\\), (2)式到(3)式合并了同类项,(3)式到(4)式用到了范数的定义\\(|w|_2^2 =w^Tw\\), (4)式到(5)式用到了上面的\\(w = \\sum\\limits_i=1^m\\alpha_iy_ix_i\\), (5)式到(6)式把和样本无关的\\(w^T\\)提前,(6)式到(7)式合并了同类项,(7)式到(8)式把和样本无关的\\(b\\)提前,(8)式到(9)式继续用到\\(w = \\sum\\limits_i=1^m\\alpha_iy_ix_i\\),(9)式到(10)式用到了向量的转置。由于常量的转置是其本身,所有只有向量\\(x_i\\)被转置,(10)式到(11)式用到了上面的\\(\\sum\\limits_i=1^m\\alpha_iy_i = 0\\),(11)式到(12)式使用了\\((a+b+c+…)(a+b+c+…)=aa+ab+ac+ba+bb+bc+…\\)的乘法运算法则,(12)式到(13)式仅仅是位置的调整。

仔细观察可以发现,这个式子和我们上一篇线性可分SVM的一样。唯一不一样的是约束条件。现在我们看看我们的优化目标的数学形式:

\\[

\\underbrace max _\\alpha \\sum\\limits_i=1^m\\alpha_i - \\frac12\\sum\\limits_i=1,j=1^m\\alpha_i\\alpha_jy_iy_jx_i^Tx_j

\\]

\\[ s.t. \\; \\sum\\limits_i=1^m\\alpha_iy_i = 0 \\]

\\[ C- \\alpha_i - \\mu_i = 0 \\]

\\[ \\alpha_i \\geq 0 \\;(i =1,2,...,m) \\]

\\[ \\mu_i \\geq 0 \\;(i =1,2,...,m) \\]

? 对于$ C- \\alpha_i - \\mu_i = 0 , \\alpha_i \\geq 0 ,\\mu_i \\geq 0 \\(这3个式子,我们可以消去\\)\\mu_i\\(,只留下\\)\\alpha_i$,也就是说\\(0 \\leq \\alpha_i \\leq C\\)。 同时将优化目标函数变号,求极小值,如下:

\\[

\\underbrace min _\\alpha ?\\frac12\\sum\\limits_i=1,j=1^m\\alpha_i\\alpha_jy_iy_jx_i^Tx_j - \\sum\\limits_i=1^m\\alpha_i

\\]

\\[ s.t. \\; \\sum\\limits_i=1^m\\alpha_iy_i = 0 \\]

\\[ 0 \\leq \\alpha_i \\leq C \\]

这就是软间隔最大化时的线性可分SVM的优化目标形式,和上一篇的硬间隔最大化的线性可分SVM相比,我们仅仅是多了一个约束条件\\(0 \\leq \\alpha_i \\leq C\\)。我们依然可以通过SMO算法来求上式极小化时对应的\\(\\alpha\\)向量就可以求出\\(w和b\\)了。

四、软间隔最大化时的支持向量

在硬间隔最大化时,支持向量比较简单,就是满足\\(y_i(w^Tx_i + b) -1 =0\\)就可以了。根据KKT条件中的对偶互补条件\\(\\alpha_i^*(y_i(w^Tx_i + b) - 1) = 0\\),如果\\(\\alpha_i^*>;0\\)则有\\(y_i(w^Tx_i + b) =1\\) 即点在支持向量上,否则如果\\(\\alpha_i^*=0\\)则有\\(y_i(w^Tx_i + b) \\geq 1\\),即样本在支持向量上或者已经被正确分类。

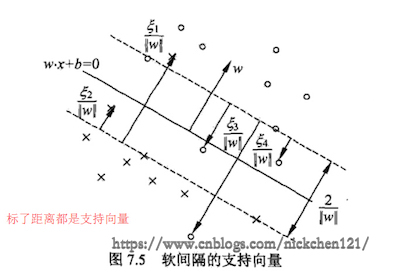

在软间隔最大化时,则稍微复杂一些,因为我们对每个样本\\((x_i,y_i)\\)引入了松弛变量\\(\\xi_i\\)。我们从下图来研究软间隔最大化时支持向量的情况,第i个点到对应类别支持向量的距离为\\(\\frac\\xi_i|w|_2\\)。根据软间隔最大化时KKT条件中的对偶互补条件\\(\\alpha_i^*(y_i(w^Tx_i + b) - 1 + \\xi_i^*) = 0\\)我们有:

a) 如果\\(\\alpha = 0\\),那么\\(y_i(w^Tx_i + b) - 1 \\geq 0\\),即样本在间隔边界上或者已经被正确分类。如图中所有远离间隔边界的点。

b)?如果\\(0 <; \\alpha <; C\\),那么\\(\\xi_i = 0 ,\\;\\; y_i(w^Tx_i + b) - 1 = ?0\\),即点在间隔边界上。

c) 如果\\(\\alpha = C\\),说明这是一个可能比较异常的点,需要检查此时\\(\\xi_i\\)

i)如果\\(0 \\leq \\xi_i \\leq 1\\),那么点被正确分类,但是却在超平面和自己类别的间隔边界之间。如图中的样本2和4.

ii)如果\\(\\xi_i =1\\),那么点在分离超平面上,无法被正确分类。

iii)如果\\(\\xi_i >; 1\\),那么点在超平面的另一侧,也就是说,这个点不能被正常分类。如图中的样本1和3.

五、软间隔最大化的线性可分SVM的算法过程

这里我们对软间隔最大化时的线性可分SVM的算法过程做一个总结。

输入是线性可分的m个样本\\((x_1,y_1), (x_2,y_2), ..., (x_m,y_m),\\),其中x为n维特征向量。y为二元输出,值为1,或者-1.

输出是分离超平面的参数\\(w^*和b^*\\)和分类决策函数。

算法过程如下:

1)选择一个惩罚系数\\(C>;0\\), 构造约束优化问题

\\[

\\underbrace min _\\alpha ?\\frac12\\sum\\limits_i=1,j=1^m\\alpha_i\\alpha_jy_iy_jx_i^Tx_j - \\sum\\limits_i=1^m\\alpha_i

\\]

\\[ s.t. \\; \\sum\\limits_i=1^m\\alpha_iy_i = 0 \\]

\\[ 0 \\leq \\alpha_i \\leq C \\]

2)用SMO算法求出上式最小时对应的\\(\\alpha\\)向量的值\\(\\alpha^*\\)向量.

3) 计算\\(w^* = \\sum\\limits_i=1^m\\alpha_i^*y_ix_i\\)

4) 找出所有的S个支持向量对应的样本\\((x_s,y_s)\\),通过?\\(y_s(\\sum\\limits_i=1^S\\alpha_iy_ix_i^Tx_s+b) = 1\\),计算出每个支持向量\\((x_x, y_s)\\)对应的\\(b_s^*\\),计算出这些\\(b_s^* = y_s - \\sum\\limits_i=1^S\\alpha_iy_ix_i^Tx_s\\). 所有的\\(b_s^*\\)对应的平均值即为最终的\\(b^* = \\frac1S\\sum\\limits_i=1^Sb_s^*\\)

? 这样最终的分类超平面为:$w^ \\bullet x + b^ = 0 \\(,最终的分类决策函数为:\\)f(x) = sign(w^ \\bullet x + b^)$

?

六、合页损失函数

线性支持向量机还有另外一种解释如下:

\\[

\\underbrace min_w, b[1-y_i(w \\bullet x + b)]_+ + \\lambda |w|_2^2

\\]

其中\\(L(y(w \\bullet x + b)) = [1-y_i(w \\bullet x + b)]_+\\)称为合页损失函数(hinge loss function),下标+表示为:

\\[

[z]_+=

\\begincases

z & z >;0\\0& z\\leq 0

\\endcases

\\]

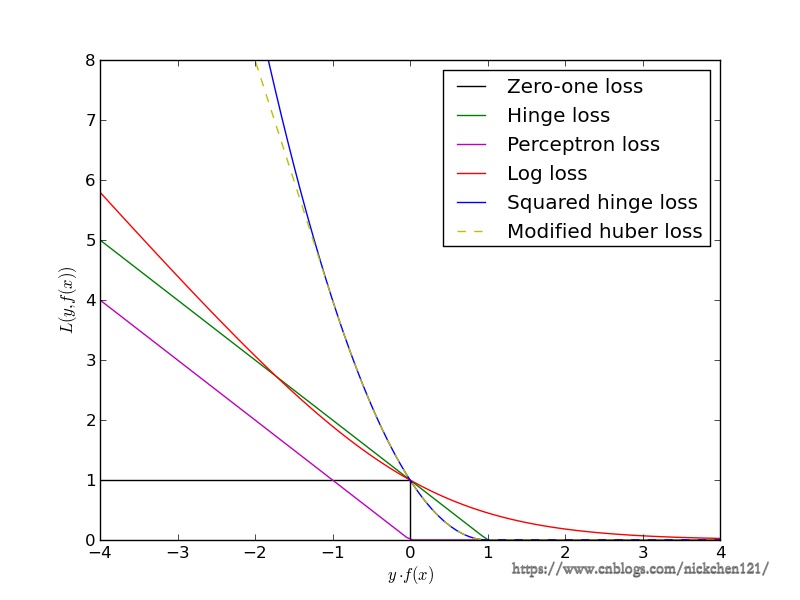

也就是说,如果点被正确分类,且函数间隔大于1,损失是0,否则损失是\\(1-y(w \\bullet x + b)\\),如下图中的绿线。我们在下图还可以看出其他各种模型损失和函数间隔的关系:对于0-1损失函数,如果正确分类,损失是0,误分类损失1, 如下图黑线,可见0-1损失函数是不可导的。对于感知机模型,感知机的损失函数是\\([-y_i(w \\bullet x + b)]_+\\),这样当样本被正确分类时,损失是0,误分类时,损失是\\(-y_i(w \\bullet x + b)\\),如下图紫线。对于逻辑回归之类和最大熵模型对应的对数损失,损失函数是\\(log[1+exp(-y(w \\bullet x + b))]\\), 如下图红线所示。

? 线性可分SVM通过软间隔最大化,可以解决线性数据集带有异常点时的分类处理,但是现实生活中的确有很多数据不是线性可分的,这些线性不可分的数据也不是去掉异常点就能处理这么简单。那么SVM怎么能处理中这样的情况呢?我们在下一篇就来讨论线性不可分SVM和核函数的原理。

?

(欢迎转载,转载请注明出处。欢迎沟通交流: 微信:nickchen121)?

以上是关于支持向量机的主要内容,如果未能解决你的问题,请参考以下文章