论文泛读113对话不平坦:模拟对话话语之间的动态信息流

Posted 及时行樂_

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了论文泛读113对话不平坦:模拟对话话语之间的动态信息流相关的知识,希望对你有一定的参考价值。

贴一下汇总贴:论文阅读记录

论文链接:《Conversations Are Not Flat: Modeling the Dynamic Information Flow across Dialogue Utterances》

一、摘要

如今,开放域对话模型可以根据基于大规模预训练语言模型的历史上下文生成可接受的响应。然而,他们通常将对话历史直接连接为模型输入来预测响应,我们将其命名为平面模式,并忽略了对话话语之间的动态信息流。在这项工作中,我们提出了 DialoFlow 模型,在该模型中,我们引入了一种动态流机制来对上下文流进行建模,并设计了三个训练目标,通过解决每个话语带来的语义影响来捕获跨对话话语的信息动态:规模预训练。在多参考 Reddit 数据集和 DailyDialog 数据集上的实验表明,我们的 DialoFlow 在对话生成任务上明显优于 DialoGPT。此外,我们提出了 Flow 分数,这是一种基于预训练的 DialoFlow 用于评估交互式人机对话质量的有效自动指标,它具有聊天机器人级别的高相关性(r = 0.9) 在 11 个聊天机器人中进行人工评分。代码和预训练模型将公开。github地址

二、结论

在这项工作中,我们提出了对话流模型,通过处理每个话语带来的语义影响来模拟跨对话话语的动态信息流。具体来说,我们使用单向流模块来模拟上下文流,并设计了三个培训目标来优化对话流模型。此外,在对话流的基础上,我们提出了流评分,这是一种用于交互式对话评估的自动无参考评估指标,具有预先训练的对话流。反应生成和对话评价实验都表明,我们的方法能够有效地捕捉跨话语的动态信息流。对于未来的工作,我们希望将对话流应用到任务型对话中,并探索其在长文本生成中的应用,如故事生成。

三、model

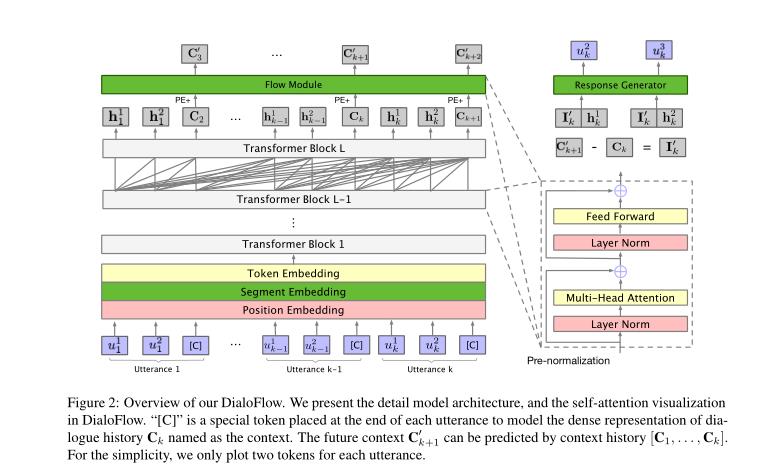

DialoFlow框架:

- input embeddings

- transformer blocks

- uni-directional Flow module

- response generator.

以上是关于论文泛读113对话不平坦:模拟对话话语之间的动态信息流的主要内容,如果未能解决你的问题,请参考以下文章

论文泛读111DialogueCRN:对话中情绪识别的上下文推理网络