python爬虫获取浏览器payload?

Posted

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了python爬虫获取浏览器payload?相关的知识,希望对你有一定的参考价值。

如何通过代码获取浏览器的payload,

参考技术A 上面的代码将会生成30个1到20之间的随机整数,并依次输出。需要注意的是,在Python中,random.randint() 函数生成的随机整数是包含边界值的。所以,上面的代码中,生成的随机整数可能包含1和100,也可能包含1和20。

总之,你可以使用 random.randint() 函数来随机生成指定范围内的整数。

pip install beautifulsoup4

然后,您可以使用以下代码来获取网页中的payload数据:

=================

from bs4 import BeautifulSoup

# 获取网页数据

html = "<html><body>payload data</body></html>"

soup = BeautifulSoup(html, 'html.parser')

# 获取payload

payload = soup.body.get_text()

print(payload)

=================

在这段代码中,我们首先使用BeautifulSoup解析网页数据,然后通过soup.body.get_text()来获取网页中的payload数据。

希望这些信息能够帮助您。

Python爬虫--初识爬虫

Python爬虫

一、爬虫的本质是什么?

模拟浏览器打开网页,获取网页中我们想要的那部分数据

浏览器打开网页的过程:

当你在浏览器中输入地址后,经过DNS服务器找到服务器主机,向服务器发送一个请求,服务器经过解析后发送给用户浏览器结果,包括html,js,css等文件内容,浏览器解析出来最后呈现给用户在浏览器上看到的结果

所以用户看到的浏览器的结果就是由HTML代码构成的,我们爬虫就是为了获取这些内容,通过分析和过滤html代码,从中获取我们想要资源(文本,图片,视频.....)

二、爬虫的基本流程

- 发起请求:通过HTTP库向目标站点发起请求,也就是发送一个Request,请求可以包含额外的header等信息,等待服务器响应

- 获取响应内容:如果服务器能正常响应,会得到一个Response,Response的内容便是所要获取的页面内容,类型可能是HTML,Json字符串,二进制数据(图片或者视频)等类型

- 解析内容:得到的内容可能是HTML,可以用正则表达式,页面解析库进行解析,可能是Json,可以直接转换为Json对象解析,可能是二进制数据,可以做保存或者进一步的处理

- 保存数据:保存形式多样,可以存为文本,也可以保存到数据库,或者保存特定格式的文件

三、Request、Response的分析:

浏览器发送消息给网址所在的服务器,这个过程就叫做HTPP Request,服务器收到浏览器发送的消息后,能够根据浏览器发送消息的内容,做相应的处理,然后把消息回传给浏览器,这个过程就是HTTP Response

1、Request 分析:

1.1、请求方式:

""" 主要有:GET/POST两种类型常用,另外还有HEAD/PUT/DELETE/OPTIONS GET和POST的区别就是:请求的数据GET是在url中,POST则是存放在头部 GET:向指定的资源发出“显示”请求。使用GET方法应该只用在读取数据,而不应当被用于产生“副作用”的操作中,例如在Web Application中。其中一个原因是GET可能会被网络蜘蛛等随意访问 POST:向指定资源提交数据,请求服务器进行处理(例如提交表单或者上传文件)。数据被包含在请求本文中。这个请求可能会创建新的资源或修改现有资源,或二者皆有。 HEAD:与GET方法一样,都是向服务器发出指定资源的请求。只不过服务器将不传回资源的本文部分。它的好处在于,使用这个方法可以在不必传输全部内容的情况下,就可以获取其中“关于该资源的信息”(元信息或称元数据)。 PUT:向指定资源位置上传其最新内容。 OPTIONS:这个方法可使服务器传回该资源所支持的所有HTTP请求方法。用\'*\'来代替资源名称,向Web服务器发送OPTIONS请求,可以测试服务器功能是否正常运作。 DELETE:请求服务器删除Request-URI所标识的资源。 """

1.2、请求的url

""" URL,即统一资源定位符,也就是我们说的网址,统一资源定位符是对可以从互联网上得到的资源的位置和访问方法的一种简洁的表示,是互联网上标准资源的地址。互联网上的每个文件都有一个唯一的URL,它包含的信息指出文件的位置以及浏览器应该怎么处理它。 URL的格式由三个部分组成: 第一部分是协议(或称为服务方式)。 第二部分是存有该资源的主机IP地址(有时也包括端口号)。 第三部分是主机资源的具体地址,如目录和文件名等。 爬虫爬取数据时必须要有一个目标的URL才可以获取数据,因此,它是爬虫获取数据的基本依据。 """

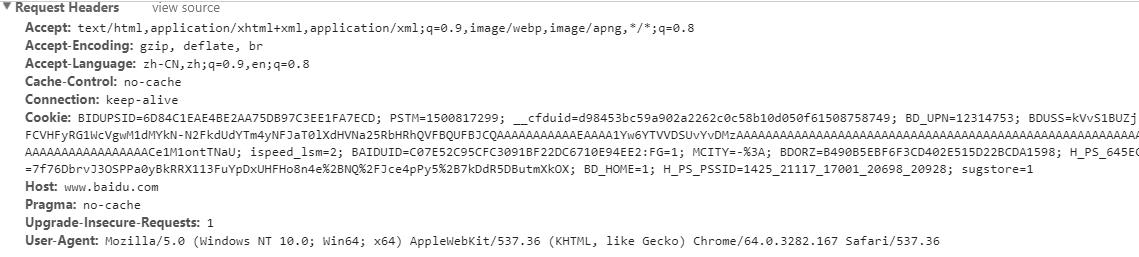

1.3、请求头

百度首页请求头:

请求头字段释义:

""" Accept 设置接受的内容类型 Accept-Charset 设置接受的字符编码 Accept-Encoding 设置接受的编码格式 Accept-Datetime 设置接受的版本时间 Accept-Language 设置接受的语言 Authorization 设置HTTP身份验证的凭证 Cache-Control 设置请求响应链上所有的缓存机制必须遵守的指令 Connection 设置当前连接和hop-by-hop协议请求字段列表的控制选项 Content-Length 设置请求体的字节长度 Content-MD5 设置基于MD5算法对请求体内容进行Base64二进制编码 Content-Type 设置请求体的MIME类型(适用POST和PUT请求) Cookie 设置服务器使用Set-Cookie发送的http cookie Date 设置消息发送的日期和时间 Expect 标识客户端需要的特殊浏览器行为 Forwarded 披露客户端通过http代理连接web服务的源信息 From 设置发送请求的用户的email地址 Host 设置服务器域名和TCP端口号,如果使用的是服务请求标准端口号,端口号可以省略 """

1.4、请求体

请求是携带的数据,如提交表单数据时候的表单数据(POST)

2、Response 分析:

2.1、响应状态:

有多种响应状态,如:200代表成功,301跳转,404找不到页面,502服务器错误

- 1xx消息——请求已被服务器接收,继续处理

- 2xx成功——请求已成功被服务器接收、理解、并接受

- 3xx重定向——需要后续操作才能完成这一请求

- 4xx请求错误——请求含有词法错误或者无法被执行

- 5xx服务器错误——服务器在处理某个正确请求时发生错误 常见代码: 200 OK 请求成功 400 Bad Request 客户端请求有语法错误,不能被服务器所理解 401 Unauthorized 请求未经授权,这个状态代码必须和WWW-Authenticate报头域一起使用 403 Forbidden 服务器收到请求,但是拒绝提供服务 404 Not Found 请求资源不存在,eg:输入了错误的URL 500 Internal Server Error 服务器发生不可预期的错误 503 Server Unavailable 服务器当前不能处理客户端的请求,一段时间后可能恢复正常 301 目标永久性转移 302 目标暂时性转移

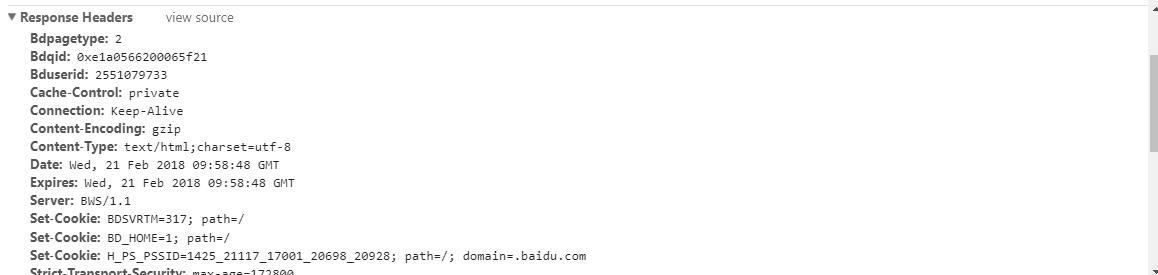

2.2、相应头:

2.3、响应体:

包含请求资源的内容,如网页HTMl,图片,二进制数据等

四、爬取数据的解析与储存

1、解析方式:

- 直接处理

- Json解析

- 正则表达式处理

- BeautifulSoup解析处理

- PyQuery解析处理

- XPath解析处理

2、储存方式:

- 文本:纯文本,Json,Xml等

- 关系型数据库:如mysql,oracle,sql server等结构化数据库

- 非关系型数据库:MongoDB,Redis等key-value形式存储

以上是关于python爬虫获取浏览器payload?的主要内容,如果未能解决你的问题,请参考以下文章