pyspark combineByKey的理解

Posted ivyharding

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了pyspark combineByKey的理解相关的知识,希望对你有一定的参考价值。

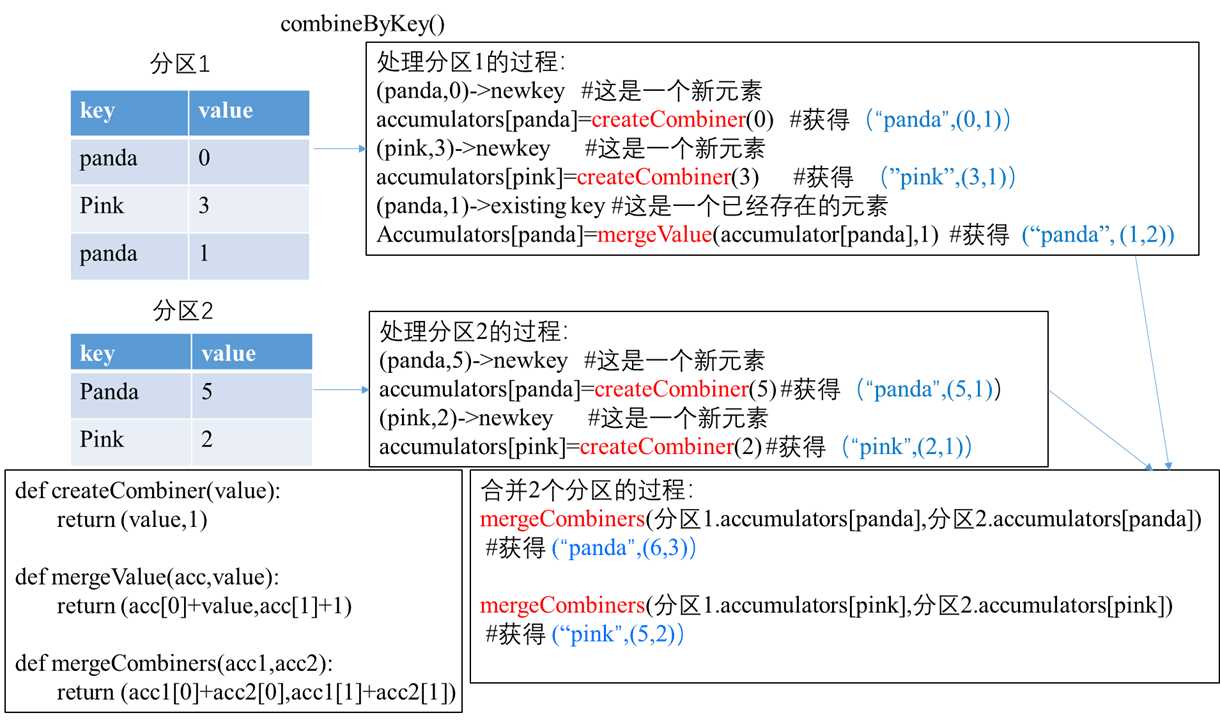

combineByKey(createCombiner,

mergeValue,

mergeCombiners,

numPartitions=None,

partitionFunc=<function portable_hash at 0x7f1ac7340578>)

它是一个泛型函数,主要完成聚合操作,将输入RDD[(K,V)]转化为结果RDD[(K,C)]输出

乍一看,感觉有些难理解,我们来一起探索下! 加油

pair RDD是键值对RDD 也就是包含key和value

我们对这样的数据做分组、聚合操作其实是将类型为RDD[(K,V)]的数据处理为RDD[(K,C)]

这里的V和C可以是相同类型,也可以是不同类型

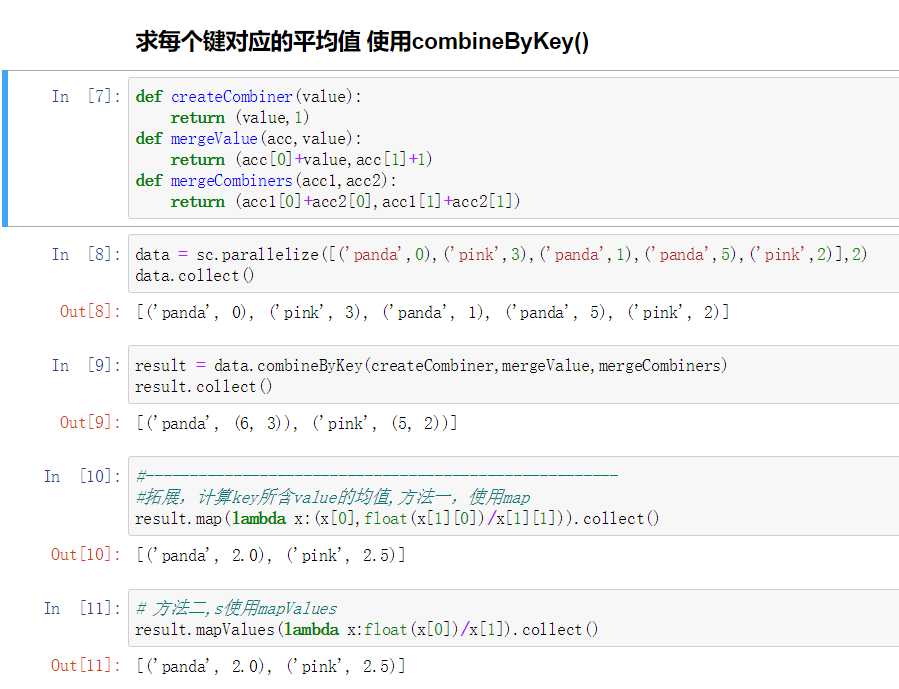

求每个键对应的平均值

具体的操作过程如下:

代码实现

以上是关于pyspark combineByKey的理解的主要内容,如果未能解决你的问题,请参考以下文章

Spark-->combineByKey请阅读Apache spark官网文档