11 K-Means 原理及案例

Posted hp-lake

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了11 K-Means 原理及案例相关的知识,希望对你有一定的参考价值。

11 K-Means 原理及案例

非监督学习

- unsupervised learning (非监督学习) ,只有特征值,没有目标值

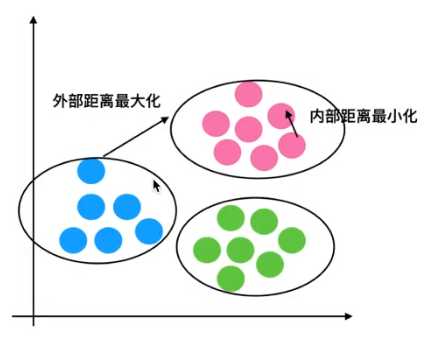

- 聚类: 主要方法 - k-means (K - 需要分成的类别数)

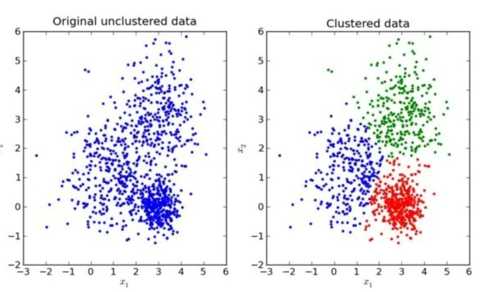

K-Means步骤

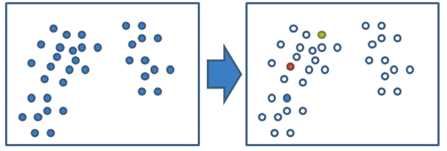

随机设置K个特征空间内的点作为初始的聚类中心 (红,绿,蓝) k=3 (给定)

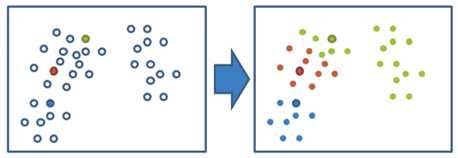

对于其他每个点计算到K个中心的距离,未知的点选择最近的一个聚类

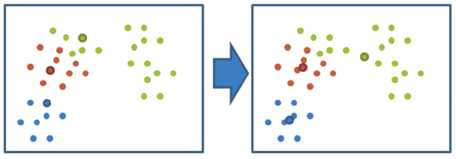

中心点作为标记类别,形成3个族群

分别计算这3个族群的平均值,把三个平均值与之前的三个旧中心进行比较。如果相同则结束聚类,如果不相同,把这三个平均点当做新的中心点,重复第二步。

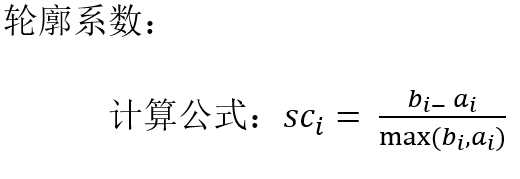

Kmeans性能评估指标

注:对于每个点?? 为已聚类数据中的样本 ,??_?? 为?? 到其它族群的所有样本的平均距离,??_?? 为?? 到本身簇的距离平均值,最终计算出所有的样本点的轮廓系数平均值。

sc_i 取值

- 当b_i >>a_i 时, 外部距离远大于内部距离,为1, 完美情况。

- 当b_i <<a_i 时,内部距离远大于外部距离,为-1, 最差情况。

- 因此 取值范围为[-1,1] ,实际情况中超过0,或者0.1就已经算是不错的情况。

K-Means API

- sklearn.cluster.KMeans

- n_cluster=8 (开始的聚类中心数量)

- labels: 默认的标记类型(不是值),可以和真实值比较。

- sklearn.metrics.silhouette_score

- sklearn.metrics.silhouette_score(X, labels)

- 计算所有样本的平均轮廓系数

- X:特征值

- labels:被聚类标记的目标值

算法案例

instacart 把用户分成几个类别

Instacart Market Basket Analysis

探究: 用户对物品类别的喜好细分降维

products.csv 商品信息

order_products_prior.csv 订单与商品信息

orders.csv 用户订单信息

aisles.csv 商品所属的具体物品类别

import pandas as pd

from sklearn.decomposition import PCA

from sklearn.cluster import KMeans

import matplotlib.pyplot as plt

from sklearn.metrics import silhouette_score

# 读取四张表的数据

prior = pd.read_csv("./data/instacart/order_products__prior.csv")

products = pd.read_csv("./data/instacart/products.csv")

orders = pd.read_csv("./data/instacart/orders.csv")

aisles = pd.read_csv("./data/instacart/aisles.csv")

# 合并四张表到一张表 (用户-物品类别)

_mg = pd.merge(prior, products, on=['product_id', 'product_id'])

_mg = pd.merge(_mg, orders, on=['order_id', 'order_id'])

mt = pd.merge(_mg, aisles, on=['aisle_id', 'aisle_id'])

# 交叉表(特殊的分组工具)

cross = pd.crosstab(mt['user_id'], mt['aisle'])

# 进行主成分分析

pca = PCA(n_components=0.9)

data = pca.fit_transform(cross)

# 把样本数量减少,减少运算量

x = data[:500]

print(x.shape) #样本维数过多,后面随机抽取2个特征仅用于画图

# 假设用户一共分为四个类别

km = KMeans(n_clusters=4)

km.fit(x)

predict = km.predict(x)

print(predict)

# 显示聚类的结果

plt.figure(figsize=(10,10))

# 建立四个颜色的列表

colored = ['orange', 'green', 'blue', 'purple']

clr = [colored[i] for i in predict]

plt.scatter(x[:, 1], x[:, 20], color=clr) # 随机抽取2个特征仅用于画图展示

plt.xlabel("1")

plt.ylabel("20")

plt.show()

# 评判聚类效果,轮廓系数

print('K-Means轮廓系数为:'silhouette_score(x, predict)) # 一般都不超过0.7以上是关于11 K-Means 原理及案例的主要内容,如果未能解决你的问题,请参考以下文章