python对dataframe进行操作?

Posted

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了python对dataframe进行操作?相关的知识,希望对你有一定的参考价值。

比方说这个dataframe,我要对它进行筛选,仅保留筛选后的数据。eg:我有一个列表ls1=['D','A'], listmesh是包含dataframe的mesh列的列表;我写一个循环:for i in ls1: for j in list_mesh: if i in j: ........就是想筛选出mesh列中含有ls1元素的那行数据,dataframe其他不属于的行就舍去。我想的是创建一个空的dataframe,如果循环中的if条件满足就向这个空dataframe写入对应的行数据。求求大佬们指点。!

建议参考一下dataframe文档,里面有相应的方法,不需要使用for循环遍历,for循环遍历会拖慢程序。对于dataframe中数据检索可以使用下面的方法。

【全部】df.values

【name列的数据】df['name'].values

【loc检索A列】df.loc['A']

【iloc进行行检索】df.iloc[0]

【直接使用名字进行列检索,但不适合行检索】df['name']

第一步:准备一些数据

根据你的描述生成的一堆数据

定义一些变量

TOPLST = ['A', 'B', 'C'] # top10

PATH = 'test.xls' # 我生成的Excel测试文件位置

第二步:根据描述,你需要对比两个序列之间是否有交集?

这里简单定义一个函数(当然也可以不这样做):

def checkLst(lst1, lst2):

# 如果两个列表中有相同值,则返回True

for item in lst1:

if item in lst2:

return True

return False

第三步:实现我们的需求:这里主要还是使用索引,掌握dataframe的函数基础上,如何使用这些接口函数很重要。这里简单几行实现数据清洗功能。

def clearData(path, toplst):

df = pandas.read_excel(path)

# 找到需要判断的mesh列

mesh = df['mesh']

# 清除队列

clearilst = []

# 遍历每一行数据mesh.index是RangeIndex实例

for index in mesh.index:

# 判断top10和mesh列中是否有交集,如果没有交集则将索引加入删除队列

if not checkLst(toplst, mesh.iloc[index].split(';')):

# 将没有交集的行索引添加至清洗列表

clearilst.append(index)

# 清洗结果赋值

result = df.drop(index=clearilst, axis=0)

return result

完整的代码截图如下:

程序源代码

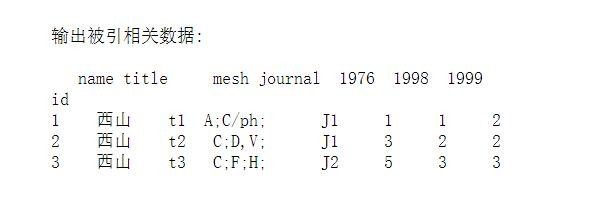

我们来看下运行效果:

运行效果展示

完美运行,不用操心索引+1的问题,也不用再创建一个DataFrame实例!

希望能够采纳!

我看过这些操作,但是我感觉都不想要的。我是有一个筛选条件的,就如那个ls1列表,实际上这个列表应该有10个元素;然后就是listmesh一般都有100个元素。我是想筛选ls1中的元素是否在listmehs列表中,不在就跳过,在的话就获取list_mesh.index(i)+1(这样就刚好等于id索引),然后我根据id索引把这一行数据提取出来写到一个新的空dataframe里面去,

参考技术A 用一个字符截取函数size就可以只读取其中的数字。 参考技术B 几乎所有的dataframe的操作都用不上for循环。但感觉你的描述不清晰,不明白你到底要做什么 参考技术C 筛选出mesh列中含有ls1元素的那行数据,dataframe其他不属于的行就舍去。我想的是创建一个空的dataframe,如果循环中的if条件满足就向这个空dataframe写入对应的行数据。求求大佬们指点。!追问emmmm....

参考技术D fetchall这个返回的是多个元组,你找到通过列表名称,获取信息了?不通过下标获取利用Python进行数据分析:Pandas(Series+DataFrame)

一、pandas简单介绍

1、pandas是一个强大的Python数据分析的工具包。

2、pandas是基于NumPy构建的。

3、pandas的主要功能

--具备对其功能的数据结构DataFrame、Series

--集成时间序列功能

--提供丰富的数学运算和操作

--灵活处理缺失数据

4、安装方法:pip install pandas

5、引用方法:import pandas as pd

二、Series

Series是一种类似于一位数组的对象,由一组数据和一组与之相关的数据标签(索引)组成。

创建方式:

--pd.Series([4,7,-5,3])

--pd.Series([4,7,-5,3],index=[\'a\',\'b\',\'c\',\'d\'])

--pd.Series({\'a\':1, \'b\':2})

--pd.Series(0, index=[\'a\',\'b\',\'c\',\'d’])

三、Series特性

Series支持数组的特性:

--从ndarray创建Series:Series(arr)

--与标量运算:sr*2

--两个Series运算:sr1+sr2

--索引:sr[0], sr[[1,2,4]]

--切片:sr[0:2](切片依然是视图形式)

--通用函数:np.abs(sr)

--布尔值过滤:sr[sr>0]

统计函数:

--mean() #求平均数

--sum() #求和

--cumsum() #累加

Series支持字典的特性(标签):

--从字典创建Series:Series(dic),

--in运算:’a’ in sr、for x in sr

--键索引:sr[\'a\'], sr[[\'a\', \'b\', \'d\']]

--键切片:sr[\'a\':\'c\']

--其他函数:get(\'a\', default=0)等

In [12]: s = pd.Series(0,index=[\'a\',\'b\',\'c\',\'d\']) In [13]: s.a Out[13]: 0 In [14]: v = pd.Series({\'a\':1,\'b\':2}) In [15]: v.a Out[15]: 1 In [16]: v.b Out[16]: 2 In [17]: v[0] Out[17]: 1 In [18]: s*2 Out[18]: a 0 b 0 c 0 d 0 dtype: int64 In [19]: v*2 Out[19]: a 2 b 4 dtype: int64

四、整数索引

整数索引的pandas对象往往会使新手抓狂。

例:

sr = np.Series(np.arange(4.))

sr[-1]

如果索引是整数类型,则根据整数进行数据操作时总是面向标签的。

--loc属性 以标签解释

--iloc属性 以下标解释

五、pandas:Series数据对齐

pandas在运算时,会按索引进行对齐然后计算。如果存在不同的索引,则结果的索引是两个操作数索引的并集。

例:

sr1 = pd.Series([12,23,34], index=[\'c\',\'a\',\'d\'])

sr2 = pd.Series([11,20,10], index=[\'d\',\'c\',\'a\',])

sr1+sr2

sr3 = pd.Series([11,20,10,14], index=[\'d\',\'c\',\'a\',\'b\'])

sr1+sr3

如何在两个Series对象相加时将缺失值设为0?

sr1.add(sr2, fill_value=0)

灵活的算术方法:add, sub, div, mul

六、pandas:Series缺失数据

1、缺失数据:使用NaN(Not a Number)来表示缺失数据。其值等于np.nan。内置的None值也会被当做NaN处理。

2、处理缺失数据的相关方法:

--dropna() 过滤掉值为NaN的行

--fillna() 填充缺失数据

--isnull() 返回布尔数组,缺失值对应为True

--notnull() 返回布尔数组,缺失值对应为False

3、过滤缺失数据:sr.dropna() 或 sr[data.notnull()]

4、填充缺失数据:fillna(0)

七、pandas:DataFrame

DataFrame是一个表格型的数据结构,含有一组有序的列。

DataFrame可以被看做是由Series组成的字典,并且共用一个索引。

创建方式:

--pd.DataFrame({\'one\':[1,2,3,4],\'two\':[4,3,2,1]})

--pd.DataFrame({\'one\':pd.Series([1,2,3],index=[\'a\',\'b\',\'c\']), \'two\':pd.Series([1,2,3,4],index=[\'b\',\'a\',\'c\',\'d\'])})

--……

csv文件读取与写入:

--df.read_csv(\'E:\\算法\\day110 Numpy、Pandas模块\\601318.csv\')

--df.to_csv()

八、pandas:DataFrame查看数据

查看数据常用属性及方法:

index 获取索引

T 转置

columns 获取列索引

values 获取值数组

describe() 获取快速统计

DataFrame各列name属性:列名

rename(columns={})

九、pandas:DataFrame索引和切片

1、DataFrame有行索引和列索引。

2、DataFrame同样可以通过标签和位置两种方法进行索引和切片。

3、DataFrame使用索引切片:

方法1:两个中括号,先取列再取行。 df[\'A\'][0]

方法2(推荐):使用loc/iloc属性,一个中括号,逗号隔开,先取行再取列。

loc属性:解释为标签

iloc属性:解释为下标

向DataFrame对象中写入值时只使用方法2

行/列索引部分可以是常规索引、切片、布尔值索引、花式索引任意搭配。(注意:两部分都是花式索引时结果可能与预料的不同)

通过标签获取: df[\'A\'] df[[\'A\', \'B\']] df[\'A\'][0] df[0:10][[\'A\', \'C\']] df.loc[:,[\'A\',\'B\']] #行是所有的行,列取是A和B的 df.loc[:,\'A\':\'C\'] df.loc[0,\'A\'] df.loc[0:10,[\'A\',\'C\']] 通过位置获取: df.iloc[3] df.iloc[3,3] df.iloc[0:3,4:6] df.iloc[1:5,:] df.iloc[[1,2,4],[0,3]]、 通过布尔值过滤: df[df[\'A\']>0] df[df[\'A\'].isin([1,3,5])] df[df<0] = 0

十、pandas:DataFrame数据对齐与缺失数据

DataFrame对象在运算时,同样会进行数据对齐,行索引与列索引分别对齐。

结果的行索引与列索引分别为两个操作数的行索引与列索引的并集。

DataFrame处理缺失数据的相关方法:

--dropna(axis=0,where=‘any’,…) 过滤掉值为NaN的行

--fillna() 填充缺失数据

--isnull() 返回布尔数组,缺失值对应为True

--notnull() 返回布尔数组,缺失值对应为False

十一、pandas:其他常用方法

- mean #求平均值 - sum #求和 - sort_index #按行或列索引排序 - sort_values #按值排序 - apply(func,axis=0) #axis=0指的是逐行,axis=1指的是逐列。 df.apply(lamada x:x.mean()) #按列求平均 df.apply(lamada x:x[\'high\']+x["low"])/2,axis=1) #按列求平均(最高价和最低价的平均) df.apply(lamada x:x[\'high\']+x["low"])/2,axis=1) #按列求平均(最高价和最低价的平均) - applymap(func) #将函数应用在DataFrame各个元素上 - map(func) #将函数应用在Series各个元素上

十二、pandas:时间对象处理

时间序列类型: 时间戳:特定时刻 固定时期:如2017年7月 时间间隔:起始时间-结束时间 Python标准库:datetime datetime.datetime.timedelta # 表示 时间间隔 dt.strftime() #f:format吧时间对象格式化成字符串 strptime() #吧字符串解析成时间对象p:parse 灵活处理时间对象:dateutil包 dateutil.parser.parse(\'2018/1/29\') 成组处理时间对象:pandas pd.to_datetime([\'2001-01-01\', \'2002-02-02\']) 产生时间对象数组:date_range --start 开始时间 --end 结束时间 --periods 时间长度 --freq 时间频率,默认为\'D\',可选H(our),W(eek),B(usiness),S(emi-)M(onth),(min)T(es), S(econd), A(year),…

十三、pandas:时间序列

1、时间序列就是以时间对象为索引的Series或DataFrame。

2、datetime对象作为索引时是存储在DatetimeIndex对象中的。

3、时间序列特殊功能:

--传入“年”或“年月”作为切片方式

--传入日期范围作为切片方式

--丰富的函数支持:resample(), strftime(), ……

--批量转换为datetime对象:to_pydatetime()

十四、pandas:从文件读取

1、时间序列就是以时间对象作为索引 --读取文件:从文件名、URL、文件对象中加载数据 --read_csv 默认分隔符为csv --read_table 默认分隔符为\\t --read_excel 读取excel文件 2、读取文件函数主要参数: --sep 指定分隔符,可用正则表达式如\'\\s+\' --header=None 指定文件无列名 --name 指定列名 --index_col 指定某列作为索引 --skip_row 指定跳过某些行 --na_values 指定某些字符串表示缺失值 --parse_dates 指定某些列是否被解析为日期,布尔值或列表 df = pd.read_csv("601318.csv") #默认以,为分隔符 - pd.read_csv("601318.csv",sep=\'\\s+\') #匹配空格,支持正则表达式 - pd.read_table("601318.csv",sep=\',\') #和df = pd.read_csv("601318.csv") 一样 - pd.read_excle("601318.xlsx") #读Excel文件 sep:指定分隔符 header = NOne,就会吧默认的表名去除 了 df.rename(column={0:\'a\',1:"b"}) #修改列名 pd.read_csv(index_col=0) #第0列 如果想让时间成为索引 pd.read_csv(index_col=\'date\') #时间列 pd.read_csv(index_col=\'date\',parse_datas=True) #时间列 parse_datas转换为时间对象,设为true是吧所有能转的都转 pd.read_csv(index_col=\'date\',parse_datas=[\'date\']) #知识吧date的那一列转换成时间对象 na_values=[\'None\'] #吧表里面为None的转换成NaN,是吧字符串转换成缺失值 na_rep() #是吧缺失值nan转换成字符串 cols #指定输出的列,传入列表

十五、pandas:写入到文件

1、写入到文件:

--to_csv

2、写入文件函数的主要参数:

--sep

--na_rep 指定缺失值转换的字符串,默认为空字符串

--header=False 不输出列名一行

--index=False 不输出行索引一列

--cols 指定输出的列,传入列表

3、其他文件类型:json, XML, HTML, 数据库

4、pandas转换为二进制文件格式(pickle):

--save

--load

十六、pandas:数据分组与聚合

【分组】 df = pd.DateFrame({ \'data1\':np.random.uniform(10,20,5), \'data2\':np.random.uniform(-10,10,5), \'key1\':list("sbbsb") \'key2\': }) df.groupby(\'key1\').mean() #做平均 df.groupby(\'key1\').sum() #做平均 df.groupby([\'key1\',\'key2\']).mean() #做平均 支持分层索引,按多列分组 df.groupby(len).mean() #传一个函数的时候,x是每一个行的索引 df.groupby(lambda x:len(x)).mean() #传一个函数的时候,x是每一个行的索引 df.groupby.groups() #取得多有的组 df.groupby.get_group() #取得一个组 【聚合】 df.groupby(\'key1\').max()[[\'data1\',\'data2\']] #去掉key2的data1,data2,花式索引 df.groupby(\'key1\').max()[[\'data1\',\'data2\']]- df.groupby(\'key1\').min()[[\'data1\',\'data2\']] #去掉key2 df.groupby(\'key1\').agg(lamada x:x.max()-x.min()) 既想看最大也可看最小 df.groupby(\'key1\').agg([np.max,np.min]) 不同的列不一样的聚合 df.groupby(\'key1\').agg({\'data1\':\'min\',\'data2\':\'max\'}) #键是列名,值是 a=_219 #219行的代码 a.resample(\'3D\'),mean() #3D 3天,3M就是三周 【数据合并】 - 数据拼接 df = df.copy() pd.concat([df,df2,df3],ignore_index=True) #不用之前的索引, pd.concat([df,df2,df3],axis=1) #列 pd.concat([df,df2,df3],keys=[\'a\',\'b\',\'c\']) #不用之前的索引, df2.appeng(df3) - 数据连接 如果不指定on,默认是行索引进行join pd.merge(df,df3,on=\'key1\') pd.merge(df,df3,on=\'[\'key1\',\'key2\'])

以上是关于python对dataframe进行操作?的主要内容,如果未能解决你的问题,请参考以下文章

python中,dataframe或series对象可以对列进行运算么(加减乘除)

python和R对dataframe的常用操作的差异:headtailshapedimnrowncoldescirbesummarystr

python中,dataframe或series对象可以对列进行运算么(加减乘除)?

使用python读取和保存为excelcsvtxt文件以及对DataFrame文件的基本操作

R语言对dataframe进行行数据筛选(row selection)多种方案:使用R原生方法data.tabledplyr等方案