人工智能实践:神经网络优化

Posted xiaojianliu

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了人工智能实践:神经网络优化相关的知识,希望对你有一定的参考价值。

损失函数

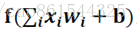

神经元模型:用数学公式表示为:

神经网络:是以神经元为基本单元构成的。

激活函数:引入非线性激活因素,提高模型的表达力。

常用的激活函数有relu、sigmoid、tanh等。

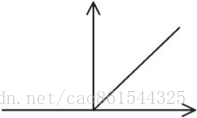

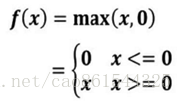

① 激活函数relu: 在Tensorflow中,用tf.nn.relu()表示

relu()数学表达式 relu()数学图形

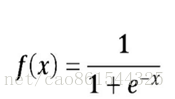

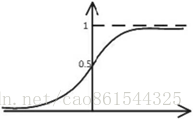

② 激活函数sigmoid:在Tensorflow中,用tf.nn.sigmoid()表示

sigmoid ()数学表达式 sigmoid()数学图形

以上是关于人工智能实践:神经网络优化的主要内容,如果未能解决你的问题,请参考以下文章