NNDL 实验六 卷积神经网络LeNet实现MNIST

Posted 刘先生TT

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了NNDL 实验六 卷积神经网络LeNet实现MNIST相关的知识,希望对你有一定的参考价值。

5.3 基于LeNet实现手写体数字识别实验

在本节中,我们实现经典卷积网络LeNet-5,并进行手写体数字识别任务。

5.3.1 数据

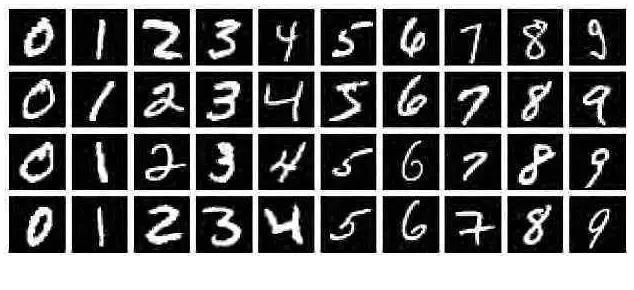

手写体数字识别是计算机视觉中最常用的图像分类任务,让计算机识别出给定图片中的手写体数字(0-9共10个数字)。由于手写体风格差异很大,因此手写体数字识别是具有一定难度的任务。

我们采用常用的手写数字识别数据集:MNIST数据集。MNIST数据集是计算机视觉领域的经典入门数据集,包含了60,000个训练样本和10,000个测试样本。这些数字已经过尺寸标准化并位于图像中心,图像是固定大小( 28 × 28 28\\times28 28×28像素)。图5.12给出了部分样本的示例。

图5.12:MNIST数据集示例

为了节省训练时间,本节选取MNIST数据集的一个子集进行后续实验,数据集的划分为:

- 训练集:1,000条样本

- 验证集:200条样本

- 测试集:200条样本

MNIST数据集分为train_set、dev_set和test_set三个数据集,每个数据集含两个列表分别存放了图片数据以及标签数据。比如train_set包含:

- 图片数据:[1 000, 784]的二维列表,包含1 000张图片。每张图片用一个长度为784的向量表示,内容是 28 × 28 28\\times 28 28×28 尺寸的像素灰度值(黑白图片)。

- 标签数据:[1 000, 1]的列表,表示这些图片对应的分类标签,即0~9之间的数字。

观察数据集分布情况,代码实现如下:

import json

import gzip

# 打印并观察数据集分布情况

train_set, dev_set, test_set = json.load(gzip.open('./mnist.json.gz'))

train_images, train_labels = train_set[0][:1000], train_set[1][:1000]

dev_images, dev_labels = dev_set[0][:200], dev_set[1][:200]

test_images, test_labels = test_set[0][:200], test_set[1][:200]

train_set, dev_set, test_set = [train_images, train_labels], [dev_images, dev_labels], [test_images, test_labels]

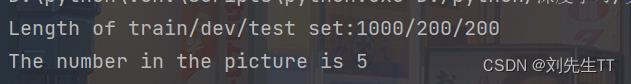

print('Length of train/dev/test set://'.format(len(train_set[0]), len(dev_set[0]), len(test_set[0])))

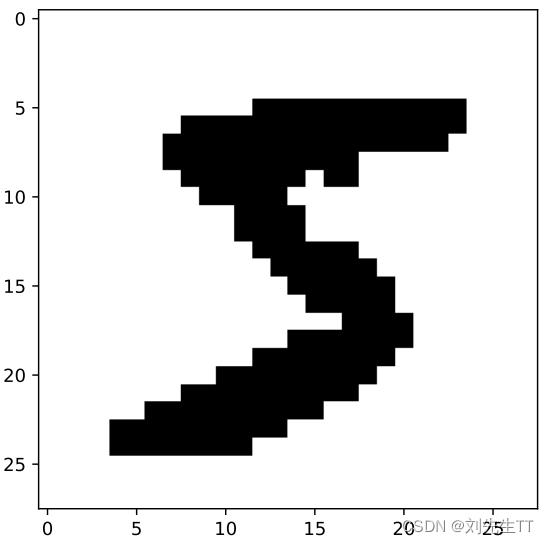

可视化观察其中的一张样本以及对应的标签,代码如下所示:

image, label = train_set[0][0], train_set[1][0]

image, label = np.array(image).astype('float32'), int(label)

# 原始图像数据为长度784的行向量,需要调整为[28,28]大小的图像

image = np.reshape(image, [28,28])

image = Image.fromarray(image.astype('uint8'), mode='L')

print("The number in the picture is ".format(label))

plt.figure(figsize=(5, 5))

plt.imshow(image)

plt.savefig('conv-number5.pdf')

5.3.1.1 数据预处理

图像分类网络对输入图片的格式、大小有一定的要求,数据输入模型前,需要对数据进行预处理操作,使图片满足网络训练以及预测的需要。本实验主要应用了如下方法:

- 调整图片大小:LeNet网络对输入图片大小的要求为 32 × 32 32\\times 32 32×32 ,而MNIST数据集中的原始图片大小却是 28 × 28 28\\times 28 28×28 ,这里为了符合网络的结构设计,将其调整为 32 × 32 32 \\times 32 32×32;

- 规范化: 通过规范化手段,把输入图像的分布改变成均值为0,标准差为1的标准正态分布,使得最优解的寻优过程明显会变得平缓,训练过程更容易收敛。

在飞桨中,提供了部分视觉领域的高层API,可以直接调用API实现简单的图像处理操作。通过调用torchvision.transforms.Resize调整大小;调用torchvision.transforms.Normalize进行标准化处理;使用torchvision.transforms.Compose将两个预处理操作进行拼接。

代码实现如下:

# 数据预处理

transforms = Compose([Resize(32), Normalize(mean=[127.5], std=[127.5])])

将原始的数据集封装为Dataset类,以便DataLoader调用。

class MNIST_dataset(torch.utils.data.Dataset):

def __init__(self, dataset, transforms, mode='train'):

self.mode = mode

self.transforms =transforms

self.dataset = dataset

def __getitem__(self, idx):

# 获取图像和标签

image, label = self.dataset[0][idx], self.dataset[1][idx]

image, label = np.array(image).astype('float32'), int(label)

image = np.reshape(image, [28,28])

image = Image.fromarray(image.astype('uint8'), mode='L')

image = self.transforms(image)

return image, label

def __len__(self):

return len(self.dataset[0])

# 固定随机种子

random.seed(0)

# 加载 mnist 数据集

train_dataset = MNIST_dataset(dataset=train_set, transforms=transforms, mode='train')

test_dataset = MNIST_dataset(dataset=test_set, transforms=transforms, mode='test')

dev_dataset = MNIST_dataset(dataset=dev_set, transforms=transforms, mode='dev')

5.3.2 模型构建

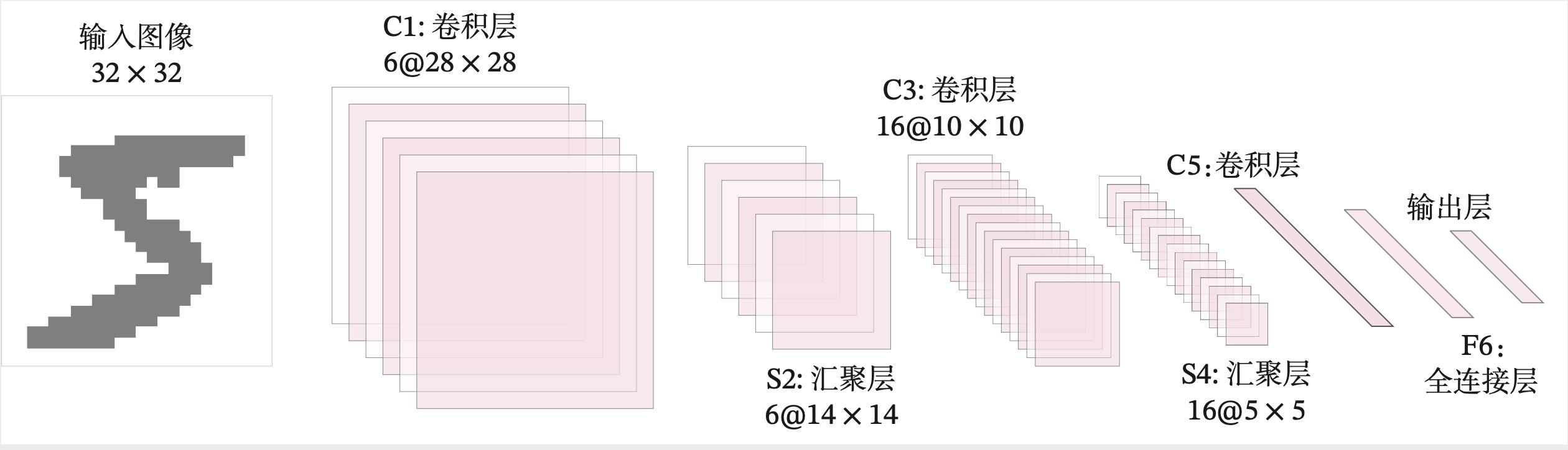

LeNet-5虽然提出的时间比较早,但它是一个非常成功的神经网络模型。基于LeNet-5的手写数字识别系统在20世纪90年代被美国很多银行使用,用来识别支票上面的手写数字。LeNet-5的网络结构如图5.13所示。

图5.13:LeNet-5网络结构

我们使用上面定义的卷积层算子和汇聚层算子构建一个LeNet-5模型。

这里的LeNet-5和原始版本有4点不同:

- C3层没有使用连接表来减少卷积数量。

- 汇聚层使用了简单的平均汇聚,没有引入权重和偏置参数以及非线性激活函数。

- 卷积层的激活函数使用ReLU函数。

- 最后的输出层为一个全连接线性层。

网络共有7层,包含3个卷积层、2个汇聚层以及2个全连接层的简单卷积神经网络接,受输入图像大小为

32

×

32

=

1

024

32\\times 32=1\\, 024

32×32=1024,输出对应10个类别的得分。

具体实现如下:

import torch.nn.functional as F

import torch.nn as nn

class Model_LeNet(nn.Module):

def __init__(self, in_channels, num_classes=10):

super(Model_LeNet, self).__init__()

# 卷积层:输出通道数为6,卷积核大小为5×5

self.conv1 = torch.conv2d(in_channels=in_channels, out_channels=6, kernel_size=5, weight_attr=paddle.ParamAttr())

# 汇聚层:汇聚窗口为2×2,步长为2

self.pool2 = torch.max_pool2d(size=(2,2), mode='max', stride=2)

# 卷积层:输入通道数为6,输出通道数为16,卷积核大小为5×5,步长为1

self.conv3 = torch.conv2d(in_channels=6, out_channels=16, kernel_size=5, stride=1, weight_attr=paddle.ParamAttr())

# 汇聚层:汇聚窗口为2×2,步长为2

self.pool4 = torch.max_pool2d(size=(2,2), mode='avg', stride=2)

# 卷积层:输入通道数为16,输出通道数为120,卷积核大小为5×5

self.conv5 = torch.conv2d(in_channels=16, out_channels=120, kernel_size=5, stride=1, weight_attr=paddle.ParamAttr())

# 全连接层:输入神经元为120,输出神经元为84

self.linear6 = nn.Linear(120, 84)

# 全连接层:输入神经元为84,输出神经元为类别数

self.linear7 = nn.Linear(84, num_classes)

def forward(self, x):

# C1:卷积层+激活函数

output = F.relu(self.conv1(x))

# S2:汇聚层

output = self.pool2(output)

# C3:卷积层+激活函数

output = F.relu(self.conv3(output))

# S4:汇聚层

output = self.pool4(output)

# C5:卷积层+激活函数

output = F.relu(self.conv5(output))

# 输入层将数据拉平[B,C,H,W] -> [B,CxHxW]

output = torch.squeeze(output, axis=[2,3])

# F6:全连接层

output = F.relu(self.linear6(output))

# F7:全连接层

output = self.linear7(output)

return output

下面测试一下上面的LeNet-5模型,构造一个形状为 [1,1,32,32]的输入数据送入网络,观察每一层特征图的形状变化。代码实现如下:

# 这里用np.random创建一个随机数组作为输入数据

inputs = np.random.randn(*[1,3,32,32])

inputs = inputs.astype('float32')

# 创建Model_LeNet类的实例,指定模型名称和分类的类别数目

model = Model_LeNet(in_channels=3, num_classes=10)

# 通过调用LeNet从基类继承的sublayers()函数,查看LeNet中所包含的子层

print(model.sublayers())

x = paddle.to_tensor(inputs)

for item in model.sublayers():

# item是LeNet类中的一个子层

# 查看经过子层之后的输出数据形状

try:

x = item(x)

except:

# 如果是最后一个卷积层输出,需要展平后才可以送入全连接层

x = paddle.reshape(x, [x.shape[0], -1])

x = item(x)

if len(item.parameters())==2:

# 查看卷积和全连接层的数据和参数的形状,

# 其中item.parameters()[0]是权重参数w,item.parameters()[1]是偏置参数b

print(item.full_name(), x.shape, item.parameters()[0].shape,

item.parameters()[1].shape)

else:

# 汇聚层没有参数

print(item.full_name(), x.shape)

从输出结果看,

- 对于大小为 32 × 32 32 \\times32 32×32的单通道图像,先用6个大小为 5 × 5 5 \\times5 5×5的卷积核对其进行卷积运算,输出为6个 28 × 28 28 \\times28 28×28大小的特征图;

- 6个 28 × 28 28 \\times28 28×28大小的特征图经过大小为 2 × 2 2 \\times2 2×2,步长为2的汇聚层后,输出特征图的大小变为 14 × 14 14 \\times14 14×14;

- 6个 14 × 14 14 \\times14 14×14大小的特征图再经过16个大小为 5 × 5 5 \\times5 5×5的卷积核对其进行卷积运算,得到16个 10 × 10 10 \\times10 10×10大小的输出特征图;

- 16个 10 × 10 10 \\times10 10×10大小的特征图经过大小为 2 × 2 2 \\times2 2×2,步长为2的汇聚层后,输出特征图的大小变为 5 × 5 5 \\times5 5×5;

- 16个 5 × 5 5 \\times5 5×5大小的特征图再经过120个大小为 5 × 5 5 \\times5 5×5的卷积核对其进行卷积运算,得到120个 1 × 1 1 \\times1 1×1大小的输出特征图;

- 此时,将特征图展平成1维,则有120个像素点,经过输入神经元个数为120,输出神经元个数为84的全连接层后,输出的长度变为84。

- 再经过一个全连接层的计算,最终得到了长度为类别数的输出结果。

考虑到自定义的Conv2D和Pool2D算子中包含多个for循环,所以运算速度比较慢。飞桨框架中,针对卷积层算子和汇聚层算子进行了速度上的优化,这里基于paddle.nn.Conv2D、paddle.nn.MaxPool2D和paddle.nn.AvgPool2D构建LeNet-5模型,对比与上边实现的模型的运算速度。代码实现如下:

class Paddle_LeNet(nn.Module):

def __init__(self, in_channels, num_classes=10):

super(Paddle_LeNet, self).__init__()

# 卷积层:输出通道数为6,卷积核大小为5*5

self.conv1 = nn.Conv2d(in_channels=in_channels, out_channels=6, kernel_size=5)

# 汇聚层:汇聚窗口为2*2,步长为2

self.pool2 = nn.MaxPool2d(kernel_size=2, stride=2)

# 卷积层:输入通道数为6,输出通道数为16,卷积核大小为5*5

self.conv3 = nn.Conv2d(in_channels=6, out_channels=16, kernel_size=5)

# 汇聚层:汇聚窗口为2*2,步长为2

self.pool4 = nn.AvgPool2d(kernel_size=2, stride=2)

# 卷积层:输入通道数为16,输出通道数为120,卷积核大小为5*5

self.conv5 = nn.Conv2d(in_channels=16, out_channels=120, kernel_size=5)

# 全连接层:输入神经元为120,输出神经元为84

self.linear6 = nn.Linear(in_features=120, out_features=84)

# 全连接层:输入神经元为84,输出神经元为类别数

self.linear7 = nn.Linear(in_features=84, out_features=num_classes)

def forward(self, x):

# C1:卷积层+激活函数

output = F.relu(self.conv1(x))

# S2:汇聚层

output = self.pool2(output)

# C3:卷积层+激活函数

output = F.relu(self.conv3(output))

# S4:汇聚层

output = self.pool4(output)

# C5:卷积层+激活函数

output = F.relu(self.conv5(output))

# 输入层将数据拉平[B,C,H,W] -> [B,CxHxW]

output = torch.squeeze(output)

# F6:全连接层

output = F.relu(self.linear6(output))

# F7:全连接层

output = self.linear7(output)

return output

测试两个网络的运算速度。

import time

# 这里用np.random创建一个随机数组作为测试数据

inputs = np.random.randn(*[1,1,32,32])

inputs = inputs.astype('float32')

x = torch.as_tensor(inputs)

# 创建Model_LeNet类的实例,指定模型名称和分类的类别数目

model = Model_LeNet(in_channels=1, num_classes=10)

# 创建Paddle_LeNet类的实例,指定模型名称和分类的类别数目

paddle_model = Paddle_LeNet(in_channels=1, num_classes=10)

# 计算Model_LeNet类的运算速度

model_time = 0

for i in range(60):

strat_time = time.time()

out = model(x)

end_time = time.time()以上是关于NNDL 实验六 卷积神经网络LeNet实现MNIST的主要内容,如果未能解决你的问题,请参考以下文章