机器学习回归树生成过程及举例理解

Posted Better Bench

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了机器学习回归树生成过程及举例理解相关的知识,希望对你有一定的参考价值。

1 基本概念

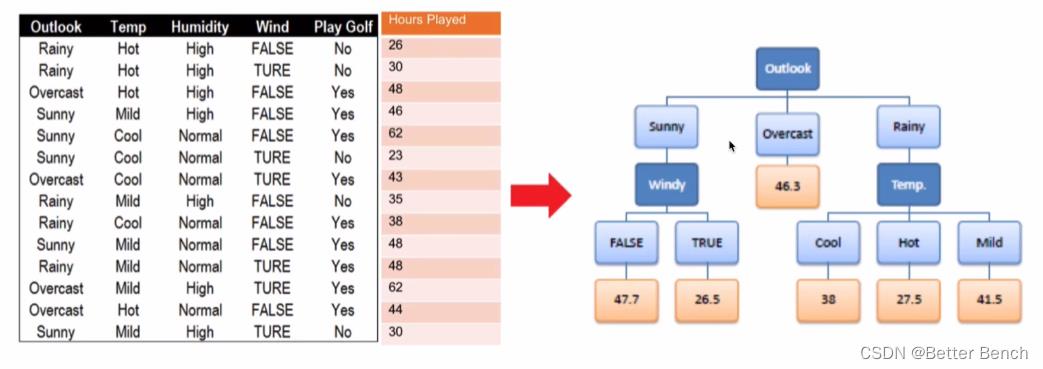

回归树(Regression Tree),就是用树模型做回归问题,每片叶子都输出一个预测值。预测值一般时叶子节点所含训练集元素输出的均值。(除了使用均值可以作为预测值,也可以使用其他方法,例如线性回归)

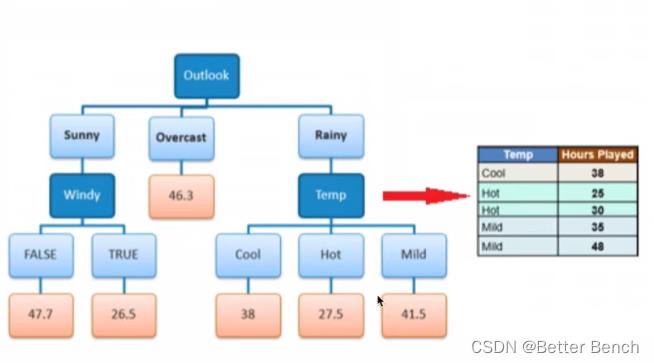

举例理解,以下是一个打高尔夫球的时间表。根据天气、适度、温度、风来预测打高尔夫的时间长短。

右边的回归树叶子节点值,就是取样本数的均值。

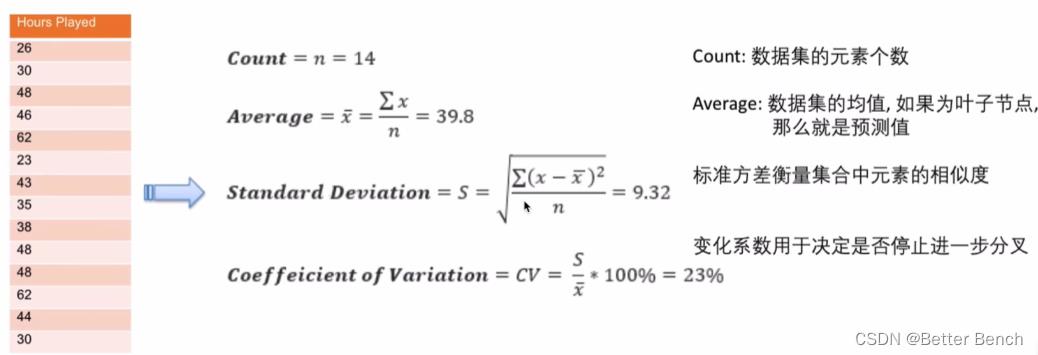

2 回归树分支标准

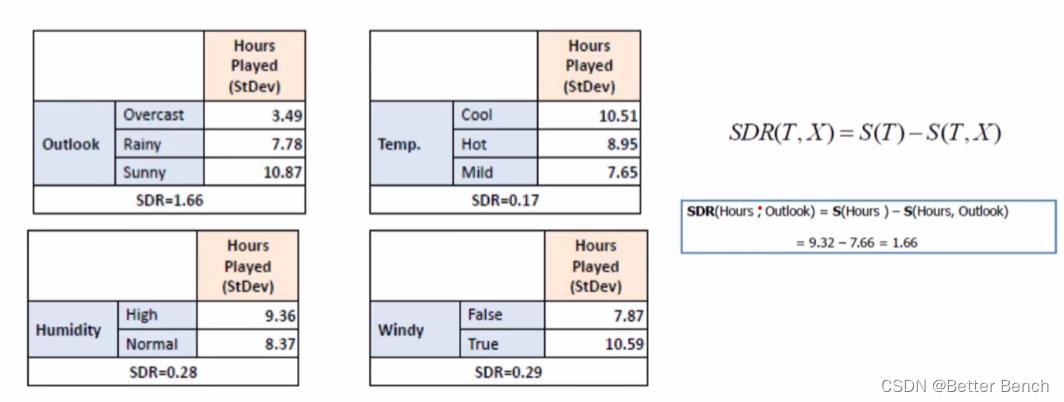

回归树的选择分支节点的评价指标是标准方差(Standard Deviation)。回归树使用某一种特征将原集合分为多个子集,用标准方差衡量子集中的元素是否相近,越小表示越相近。

第一步:首先计算根节点的标准方差

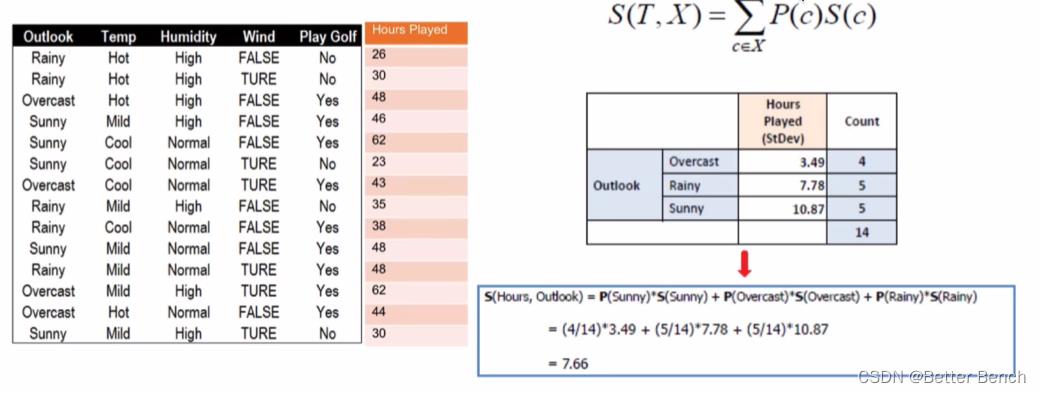

第二步:计算每个特征的条件标准方差,选择(根节点标准方差-特征的条件标准方差)最大的特征作为下一个分支节点

outlook的条件标准方差计算如下

同理计算其他特征的标准方差

第三步:计算根节点标准方差与特征的条件标准方差的差,选择差值最大的特征为下一个分支节点。重复以上工程,直到满足停止条件。停止条件包括

1、当某个分支的变化系数小于某个值

2、当前节点所包含的元素个数小于某个值

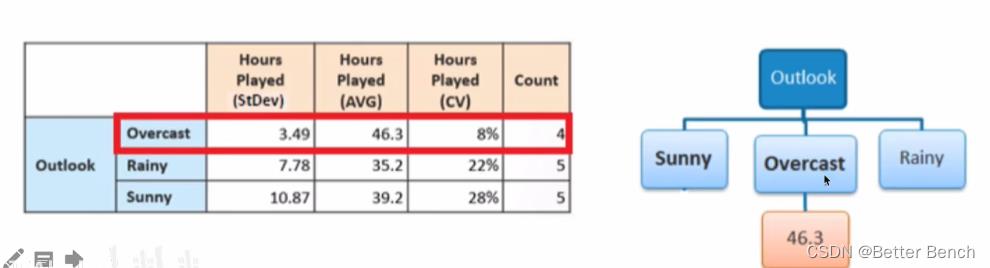

第四步:设定变化系数小于10%和所包含元素个数小于3个为停止条件

1、计算Outlook中Overcat的变化系数及所包含元素个数

Overcat的变化系数为8%。小于10%,即停止继续分支。

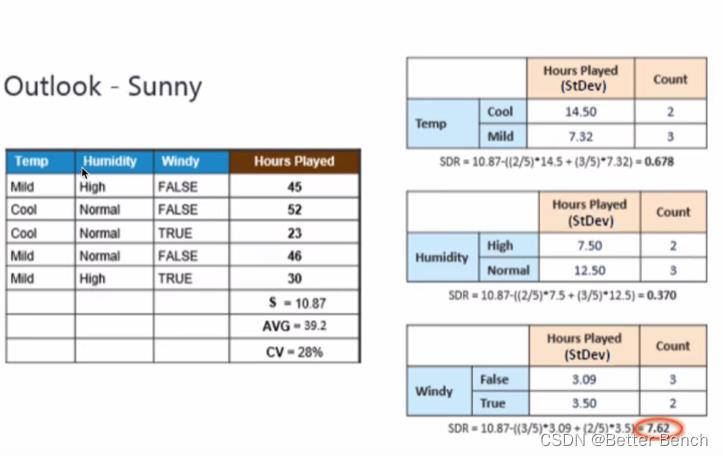

2、计算Outlook中Sunny的变化系数及所包含元素个数

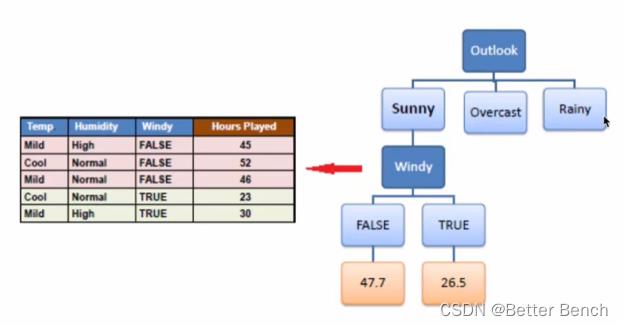

从左边的表i个中,知道变化系数为28%,且样本数为5个,则需要继续分支。再来计算下一个特征的(Sunny节点标准方差-特征的条件标准方差),从右边的表格知道,Windy这个特征的差值最大,则以Windy作为Sunny节点之后的新节点。分支得到以下的树结构。

此时Windy的True节点,只有两个样本数了,小于3个。满足了停止的条件。

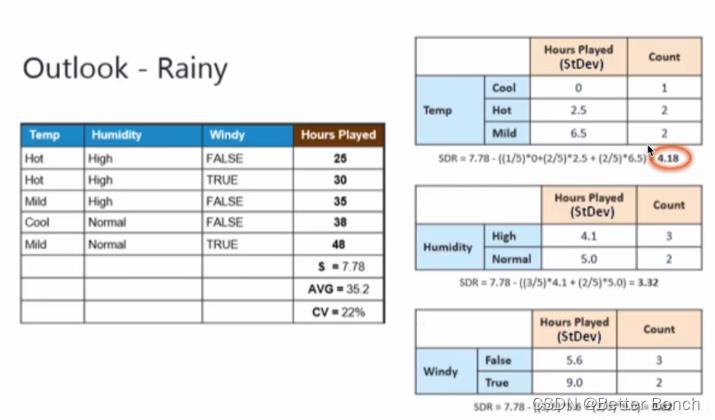

3、计算Outlook中Rainy的变化系数及所包含元素个数

从左边的表可知,Rainy分支的变化系数CV=22%,需要继续分支。再来计算下一个特征的(Rainy节点标准方差-特征的条件标准方差),从右边的表格知道,Temp这个特征的差值最大,则以Temp作为Rainy节点之后的新节点。分支得到以下的树结构。

使用Temp分支后,三个分支所包含是元素个数小于设定的3。则停止继续分支。叶子节点每条分支样本的均值,即为生成的回归树。

以上是关于机器学习回归树生成过程及举例理解的主要内容,如果未能解决你的问题,请参考以下文章