2022.11.06配置pytorch纪实

Posted LittleDragorse

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了2022.11.06配置pytorch纪实相关的知识,希望对你有一定的参考价值。

安装CUDA

查看显卡驱动

在终端键入命令

nvidia-smi

查看第二行CUDA Version,本机为12.0,意为最高支持使用12.0的CUDA版本

一般的,建议把显卡驱动升级后再进行后续安装。

下载安装器

前往CUDA下载地址,下载所需版本的CUDA toolkit。

CUDA于2022年10月出了11.8版本,目前pytorch只支持到11.7,因此要下载最新版请下载11.7的CUDA版本。

如果你是要安装论文的依赖包,请查看论文的具体依赖。

如需查看CUDA的细节,查看CUDA帮助文档。

检验CUDA安装情况

在命令行键入(区分大小写)

nvcc -V

安装正确可以查看到所需的版本号

安装cudnn

前往cudnn下载地址,选择对应版本。解压到

C:\\Program Files\\NVIDIA GPU Computing Toolkit\\CUDA\\v11.7

并将解压出的文件夹名称重命名为cudnn。

添加cudnn环境变量

C:\\Program Files\\NVIDIA GPU Computing Toolkit\\CUDA\\v11.7\\cudnn\\bin

- 不确定是否必要

安装Torch

从pytorch官网命令复制页面根据你的需要复制安装命令。

我是conda版本安装,因此打开anaconda终端输入

conda install pytorch torchvision torchaudio pytorch-cuda=11.7 -c pytorch -c nvidia

然后在可能出现的询问弹出键入y

- 如果使用一般的cmd终端,可能会出现CondaSSLError。改用conda自带的终端程序即可避免此问题。

- 其他方式官网安装助手

检查Torch可用性

import torch

x = torch.rand(5, 3)

print(x)

检查Torch.cuda可用性

import torch

torch.cuda.is_available()

cuda.is_available()为False情况

如果安装的是conda版本,查看是否将torch安装到了其他环境。

参考文档:

知乎:cuda 和 cudnn 库的卸载与安装

进阶篇全流程学习《20天掌握Pytorch实战》纪实 | Day03 | 文本数据建模流程范例

💖作者简介:大家好,我是车神哥,府学路18号的车神🥇

⚡About—>车神:从寝室到实验室最快3分钟,最慢3分半(那半分钟其实是等红绿灯)

📝个人主页:车手只需要车和手,压力来自论文_府学路18号车神_CSDN博客

🥇 官方认证:人工智能领域优质创作者

🎉点赞➕评论➕收藏 == 养成习惯(一键三连)😋⚡希望大家多多支持🤗~一起加油 😁

不定期学习《20天掌握Pytorch实战》,有兴趣就跟着专栏一起吧~

开源自由,知识无价~

图片数据建模流程范例

所用到的源代码及书籍+数据集以帮各位小伙伴下载放在文末,自取即可~

😁概览

一、 🎉准备数据(存在问题)

流程和之前都一样。

imdb数据集的目标是根据电影评论的文本内容预测评论的情感标签。

训练集有20000条电影评论文本,测试集有5000条电影评论文本,其中正面评论和负面评论都各占一半。

文本数据预处理较为繁琐,包括中文切词(本示例不涉及),构建词典,编码转换,序列填充,构建数据管道等等。

在torch中预处理文本数据一般使用torchtext或者自定义Dataset,torchtext功能非常强大,可以构建文本分类,序列标注,问答模型,机器翻译等NLP任务的数据集。

下面仅演示使用它来构建文本分类数据集的方法。

较完整的教程可以参考以下知乎文章:《pytorch学习笔记—Torchtext》

https://zhuanlan.zhihu.com/p/65833208

这个链接好像已经失效了,另外我找了C站的一个关于

Torchtext的讲解:

https://blog.csdn.net/nlpuser/article/details/88067167

关于torchtext常见API一览:

torchtext.data.Example: 用来表示一个样本,数据和标签torchtext.vocab.Vocab: 词汇表,可以导入一些预训练词向量torchtext.data.Datasets: 数据集类,`getitem`返回 Example实例, torchtext.data.TabularDataset是其子类。torchtext.data.Field: 用来定义字段的处理方法(文本字段,标签字段)创建 Example时的 预处理,batch 时的一些处理操作。torchtext.data.Iterator: 迭代器,用来生成 batchtorchtext.datasets: 包含了常见的数据集.

下面开始预处理数据(标准化的构建流程,自推自敲一遍较为适宜):

注意一点,这里用到了新的库函数,直接

pip即可

pip install torchtext

import torch

import string,re

import torchtext

MAX_WORDS = 10000 # 仅考虑最高频的10000个词

MAX_LEN = 200 # 每个样本保留200个词的长度

BATCH_SIZE = 20

#分词方法

tokenizer = lambda x:re.sub('[%s]'%string.punctuation,"",x).split(" ")

#过滤掉低频词

def filterLowFreqWords(arr,vocab):

arr = [[x if x<MAX_WORDS else 0 for x in example]

for example in arr]

return arr

#1,定义各个字段的预处理方法

TEXT = torchtext.data.Field(sequential=True, tokenize=tokenizer, lower=True,

fix_length=MAX_LEN,postprocessing = filterLowFreqWords)

LABEL = torchtext.data.Field(sequential=False, use_vocab=False)

#2,构建表格型dataset

#torchtext.data.TabularDataset可读取csv,tsv,json等格式

ds_train, ds_valid = torchtext.data.TabularDataset.splits(

path='./data/imdb', train='train.tsv',test='test.tsv', format='tsv',

fields=[('label', LABEL), ('text', TEXT)],skip_header = False)

#3,构建词典

TEXT.build_vocab(ds_train)

#4,构建数据管道迭代器

train_iter, valid_iter = torchtext.data.Iterator.splits(

(ds_train, ds_valid), sort_within_batch=True,sort_key=lambda x: len(x.text),

batch_sizes=(BATCH_SIZE,BATCH_SIZE))

#查看example信息

print(ds_train[0].text)

print(ds_train[0].label)

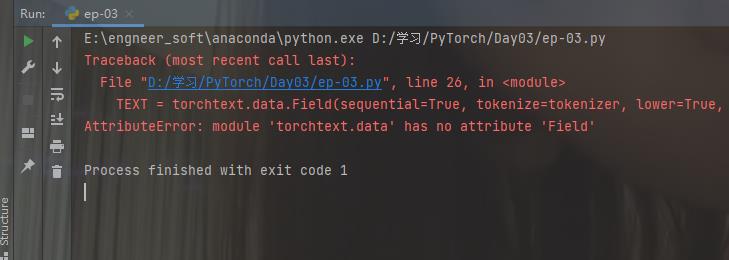

注意:这里会报错,好像是版本更新了,之前的用法已经不能用了

AttributeError: module 'torchtext.data' has no attribute 'Field'

解决方法:

将

from torchtext.data import Field替换为from torchtext.legacy.data import Field(但是这个方法对于torchtext 0.12.0版本不适用),在torchtext 0.11版本中field方法被移到了torchtext.legacy下,所以会看到其他博客的评论区里出现下面代码适用的情况,但是在torchtext 0.12.0版本中legacy目录和field方法都没了,所以上面的代码无法再适用,会报错。

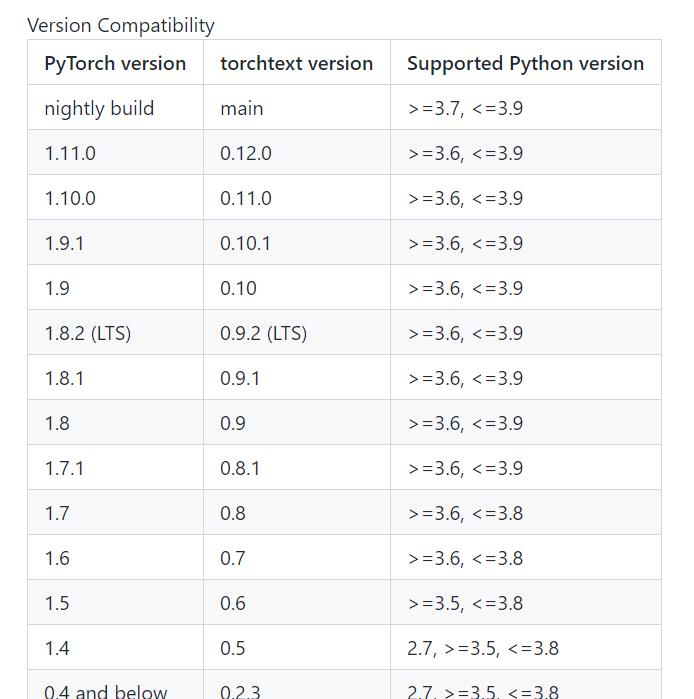

唯一的办法就是下载旧版本,哎~

下面是对应的版本,对照着更新吧

安装低版本的torchtext方法:

conda install -c pytorch torchtext==版本号

直接安装0.6或者0.8都行,然后就可以使用啦~

直接pip安装也行:

pip install torchtext==0.4

解决完上一个问题后,下一个问题又来啦

OverflowError: Python int too large to convert to C long

尝试了各种办法也没有解决,哎~

打印显示的文档结果为:

['it', 'really', 'boggles', 'my', 'mind', 'when', 'someone', 'comes', 'across', 'a', 'movie', 'like', 'this', 'and', 'claims', 'it', 'to', 'be', 'one', 'of', 'the', 'worst', 'slasher', 'films', 'out', 'there', 'this', 'is', 'by', 'far', 'not', 'one', 'of', 'the', 'worst', 'out', 'there', 'still', 'not', 'a', 'good', 'movie', 'but', 'not', 'the', 'worst', 'nonetheless', 'go', 'see', 'something', 'like', 'death', 'nurse', 'or', 'blood', 'lake', 'and', 'then', 'come', 'back', 'to', 'me', 'and', 'tell', 'me', 'if', 'you', 'think', 'the', 'night', 'brings', 'charlie', 'is', 'the', 'worst', 'the', 'film', 'has', 'decent', 'camera', 'work', 'and', 'editing', 'which', 'is', 'way', 'more', 'than', 'i', 'can', 'say', 'for', 'many', 'more', 'extremely', 'obscure', 'slasher', 'filmsbr', 'br', 'the', 'film', 'doesnt', 'deliver', 'on', 'the', 'onscreen', 'deaths', 'theres', 'one', 'death', 'where', 'you', 'see', 'his', 'pruning', 'saw', 'rip', 'into', 'a', 'neck', 'but', 'all', 'other', 'deaths', 'are', 'hardly', 'interesting', 'but', 'the', 'lack', 'of', 'onscreen', 'graphic', 'violence', 'doesnt', 'mean', 'this', 'isnt', 'a', 'slasher', 'film', 'just', 'a', 'bad', 'onebr', 'br', 'the', 'film', 'was', 'obviously', 'intended', 'not', 'to', 'be', 'taken', 'too', 'seriously', 'the', 'film', 'came', 'in', 'at', 'the', 'end', 'of', 'the', 'second', 'slasher', 'cycle', 'so', 'it', 'certainly', 'was', 'a', 'reflection', 'on', 'traditional', 'slasher', 'elements', 'done', 'in', 'a', 'tongue', 'in', 'cheek', 'way', 'for', 'example', 'after', 'a', 'kill', 'charlie', 'goes', 'to', 'the', 'towns', 'welcome', 'sign', 'and', 'marks', 'the', 'population', 'down', 'one', 'less', 'this', 'is', 'something', 'that', 'can', 'only', 'get', 'a', 'laughbr', 'br', 'if', 'youre', 'into', 'slasher', 'films', 'definitely', 'give', 'this', 'film', 'a', 'watch', 'it', 'is', 'slightly', 'different', 'than', 'your', 'usual', 'slasher', 'film', 'with', 'possibility', 'of', 'two', 'killers', 'but', 'not', 'by', 'much', 'the', 'comedy', 'of', 'the', 'movie', 'is', 'pretty', 'much', 'telling', 'the', 'audience', 'to', 'relax', 'and', 'not', 'take', 'the', 'movie', 'so', 'god', 'darn', 'serious', 'you', 'may', 'forget', 'the', 'movie', 'you', 'may', 'remember', 'it', 'ill', 'remember', 'it', 'because', 'i', 'love', 'the', 'name']

0

继续查看词典信息

# 查看词典信息

print(len(TEXT.vocab))

#itos: index to string

print(TEXT.vocab.itos[0])

print(TEXT.vocab.itos[1])

#stoi: string to index

print(TEXT.vocab.stoi['<unk>']) #unknown 未知词

print(TEXT.vocab.stoi['<pad>']) #padding 填充

#freqs: 词频

print(TEXT.vocab.freqs['<unk>'])

print(TEXT.vocab.freqs['a'])

print(TEXT.vocab.freqs['good'])

输出结果为:

108197

<unk>

<pad>

0

1

0

129453

11457

再查看:

# 查看数据管道信息

# 注意有坑:text第0维是句子长度

for batch in train_iter:

features = batch.text

labels = batch.label

print(features)

print(features.shape)

print(labels)

break

打印结果:

tensor([[ 17, 31, 148, ..., 54, 11, 201],

[ 2, 2, 904, ..., 335, 7, 109],

[1371, 1737, 44, ..., 806, 2, 11],

...,

[ 6, 5, 62, ..., 1, 1, 1],

[ 170, 0, 27, ..., 1, 1, 1],

[ 15, 0, 45, ..., 1, 1, 1]])

torch.Size([200, 20])

tensor([0, 1, 0, 1, 0, 1, 1, 0, 1, 0, 1, 0, 1, 0, 1, 1, 0, 0, 0, 0])

# 将数据管道组织成torch.utils.data.DataLoader相似的features,label输出形式

class DataLoader:

def __init__(self,data_iter):

self.data_iter = data_iter

self.length = len(data_iter)

def __len__(self):

return self.length

def __iter__(self):

# 注意:此处调整features为 batch first,并调整label的shape和dtype

for batch in self.data_iter:

yield(torch.transpose(batch.text,0,1),

torch.unsqueeze(batch.label.float(),dim = 1))

dl_train = DataLoader(train_iter)

dl_valid = DataLoader(valid_iter)

上面的问题还没解决,下面就不做过多的解释了,基本思路都差不多,如果上面问题有解决的,留言说一下哈~

二、🎉定义模型

使用Pytorch通常有三种方式构建模型:使用nn.Sequential按层顺序构建模型,继承nn.Module基类构建自定义模型,继承nn.Module基类构建模型并辅助应用模型容器(nn.Sequential,nn.ModuleList,nn.ModuleDict)进行封装。

此处选择使用第三种方式进行构建。

和图片还有Day01结构化一致,后面应该殴打his这么定义模型了,就不解释了,只是对于不同的对象建模有区别,大致都是标准化模型(调包嘛,不寒颤)

- 导入库

import torch

from torch import nn

from torchkeras import LightModel,summary

- 定义模型

torch.random.seed()

import torch

from torch import nn

class Net(nn.Module):

def __init__(self):

super(Net, self).__init__()

#设置padding_idx参数后将在训练过程中将填充的token始终赋值为0向量

self.embedding = nn.Embedding(num_embeddings = MAX_WORDS,embedding_dim = 3,padding_idx = 1)

self.conv = nn.Sequential()

self.conv.add_module("conv_1",nn.Conv1d(in_channels = 3,out_channels = 16,kernel_size = 5))

self.conv.add_module("pool_1",nn.MaxPool1d(kernel_size = 2))

self.conv.add_module("relu_1",nn.ReLU())

self.conv.add_module("conv_2",nn.Conv1d(in_channels = 16,out_channels = 128,kernel_size = 2))

self.conv.add_module("pool_2",nn.MaxPool1d(kernel_size = 2))

self.conv.add_module("relu_2",nn.ReLU())

self.dense = nn.Sequential()

self.dense.add_module("flatten",nn.Flatten())

self.dense.add_module("linear",nn.Linear(6144,1))

self.dense.add_module("sigmoid",nn.Sigmoid())

def forward(self,x):

x = self.embedding(x).transpose(1,2)

x = self.conv(x)

y = self.dense(x)

return y

net = Net()

pr以上是关于2022.11.06配置pytorch纪实的主要内容,如果未能解决你的问题,请参考以下文章

进阶篇全流程学习《20天掌握Pytorch实战》纪实 | Day03 | 文本数据建模流程范例