K-近邻算法交叉验证,网格搜索

Posted ZSYL

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了K-近邻算法交叉验证,网格搜索相关的知识,希望对你有一定的参考价值。

交叉验证,网格搜索

1. 什么是交叉验证(cross validation)

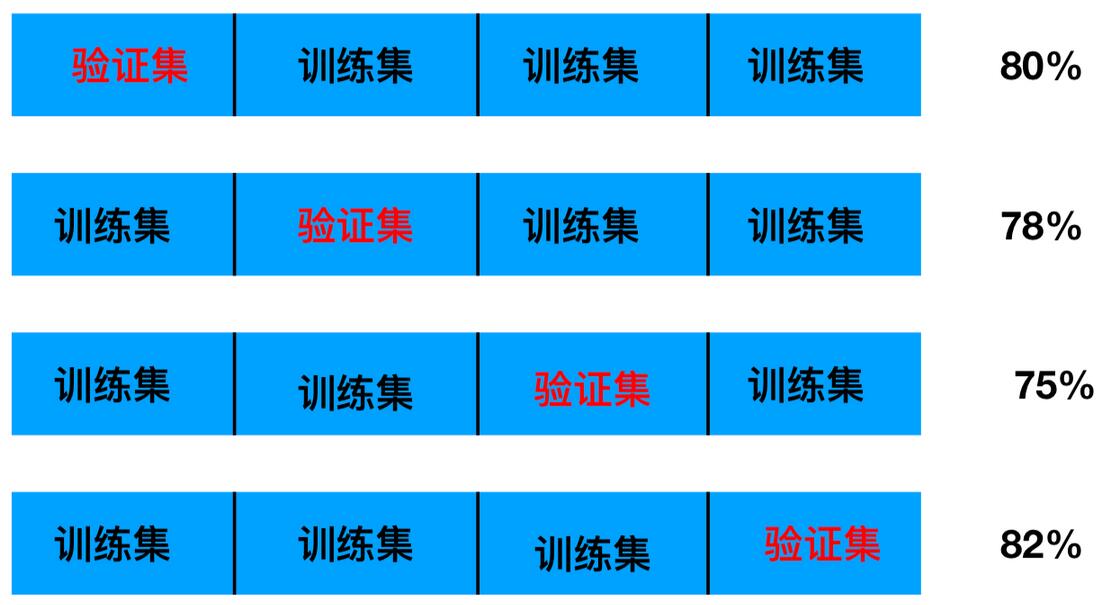

交叉验证:将拿到的训练数据,分为训练和验证集。以下图为例:将数据分成4份,其中一份作为验证集。然后经过4次(组)的测试,每次都更换不同的验证集。即得到4组模型的结果,取平均值作为最终结果。又称4折交叉验证。

1.1 分析

我们之前知道数据分为训练集和测试集,但是为了让从训练得到模型结果更加准确。做以下处理

- 训练集:训练集+验证集

- 测试集:测试集

1.2 为什么需要交叉验证

交叉验证目的:为了让被评估的模型更加准确可信

问题:这个只是让被评估的模型更加准确可信,那么怎么选择或者调优参数呢?

2. 什么是网格搜索(Grid Search)

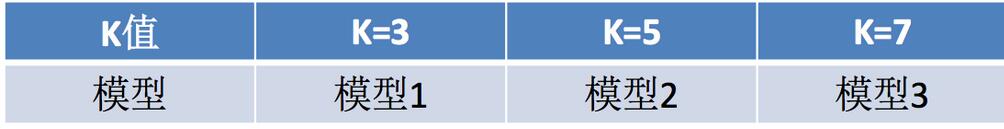

通常情况下,有很多参数是需要手动指定的(如k-近邻算法中的K值),这种叫超参数。但是手动过程繁杂,所以需要对模型预设几种超参数组合。每组超参数都采用交叉验证来进行评估。最后选出最优参数组合建立模型。

3. 交叉验证,网格搜索(模型选择与调优)API

-

sklearn.model_selection.GridSearchCV(estimator, param_grid=None,cv=None)

- 对估计器的指定参数值进行详尽搜索

- estimator:估计器对象

- param_grid:估计器参数(dict){“n_neighbors”:[1,3,5]}

- cv:指定几折交叉验证

- fit:输入训练数据

- score:准确率

- 结果分析:

- bestscore__:在交叉验证中验证的最好结果

- bestestimator:最好的参数模型

- cvresults:每次交叉验证后的验证集准确率结果和训练集准确率结果

4. 鸢尾花案例增加K值调优

- 使用GridSearchCV构建估计器

# 交叉验证,网格搜索

from sklearn.datasets import load_iris # 加载数据

from sklearn.model_selection import train_test_split, GridSearchCV # 数据基本处理:分割训练集与测试集

from sklearn.preprocessing import StandardScaler # 特征工程:特征预处理

from sklearn.neighbors import KNeighborsClassifier # 机器学习中需要的KNN算法

# 1.获取数据

iris = load_iris()

# 2.数据基本处理,(random_state训练的随机数种子不同,训练的模型不同)

x_train, x_test, y_train, y_test = train_test_split(iris.data, iris.target, test_size=0.2, random_state=22) # 特征值,目标值

# 3.特征工程 - 特征预处理

transfer = StandardScaler() # 实例化一个标准化对象

# 传入特征值,test值,进行标准化处理,数据满足 0,1标准正态分布

x_train = transfer.fit_transform(x_train) # 计算当前的均值和标准差

x_test = transfer.transform(x_test)

# 4.机器学习-KNN

# 4.1 实例化一个估计器

estimator = KNeighborsClassifier()

# 4.2 模型调优--交叉验证,网格搜索

param_grid = {"n_neighbors": [1, 3, 5, 7]} # 让它试4次

estimator = GridSearchCV(estimator, param_grid=param_grid, cv=5) # cv=5 5折交叉验证

# 4.3 模型训练

estimator.fit(x_train, y_train)

# 5.模型评估

# 5.1 获取预测值,结果输出

y_pre = estimator.predict(x_test) # 使用测试值进行预测目标值

print('预测值是:\\n', y_pre)

print('真实值:\\n', y_test)

print('预测值和真实值的对比是:\\n', y_pre == y_test)

# 5.2 准确率计算

score = estimator.score(x_test, y_test)

print('准确率:\\n', score)

- 然后进行评估查看最终选择的结果和交叉验证的结果

print("在交叉验证中验证的最好结果:\\n", estimator.best_score_)

print("最好的参数模型:\\n", estimator.best_estimator_)

print("每次交叉验证后的准确率结果:\\n", estimator.cv_results_)

- 最终结果

比对预测结果和真实值:

[ True True True True True True True False True True True True

True True True True True True False True True True True True

True True True True True True True True True True True True

True True]

直接计算准确率:

0.947368421053

在交叉验证中验证的最好结果:

0.973214285714

最好的参数模型:

KNeighborsClassifier(algorithm='auto', leaf_size=30, metric='minkowski',

metric_params=None, n_jobs=1, n_neighbors=5, p=2,

weights='uniform')

每次交叉验证后的准确率结果:

{'mean_fit_time': array([ 0.00114751, 0.00027037, 0.00024462]), 'std_fit_time': array([ 1.13901511e-03, 1.25300249e-05, 1.11011951e-05]), 'mean_score_time': array([ 0.00085751, 0.00048693, 0.00045625]), 'std_score_time': array([ 3.52785082e-04, 2.87650037e-05, 5.29673344e-06]), 'param_n_neighbors': masked_array(data = [1 3 5],

mask = [False False False],

fill_value = ?)

, 'params': [{'n_neighbors': 1}, {'n_neighbors': 3}, {'n_neighbors': 5}], 'split0_test_score': array([ 0.97368421, 0.97368421, 0.97368421]), 'split1_test_score': array([ 0.97297297, 0.97297297, 0.97297297]), 'split2_test_score': array([ 0.94594595, 0.89189189, 0.97297297]), 'mean_test_score': array([ 0.96428571, 0.94642857, 0.97321429]), 'std_test_score': array([ 0.01288472, 0.03830641, 0.00033675]), 'rank_test_score': array([2, 3, 1], dtype=int32), 'split0_train_score': array([ 1. , 0.95945946, 0.97297297]), 'split1_train_score': array([ 1. , 0.96 , 0.97333333]), 'split2_train_score': array([ 1. , 0.96, 0.96]), 'mean_train_score': array([ 1. , 0.95981982, 0.96876877]), 'std_train_score': array([ 0. , 0.00025481, 0.0062022 ])}

5. 总结

- 交叉验证

- 定义:

- 将拿到的训练数据,分为训练和验证集

- *折交叉验证

-分割方式: - 训练集:训练集+验证集

- 测试集:测试集

- 为什么需要交叉验证

- 为了让被评估的模型更加准确可信

- 注意:交叉验证不能提高模型的准确率

- 定义:

- 网格搜索

- 超参数:

- sklearn中,需要手动指定的参数,叫做超参数

- 网格搜索就是把这些超参数的值,通过字典的形式传递进去,然后进行选择最优值

- 超参数:

- api

- sklearn.model_selection.GridSearchCV(estimator, param_grid=None,cv=None)

- estimator – 选择了哪个训练模型

- param_grid – 需要传递的超参数

- cv – 几折交叉验证

- sklearn.model_selection.GridSearchCV(estimator, param_grid=None,cv=None)

加油!

感谢!

努力!

以上是关于K-近邻算法交叉验证,网格搜索的主要内容,如果未能解决你的问题,请参考以下文章

『cs231n』作业1问题1选讲_通过代码理解K近邻算法&交叉验证选择超参数参数