历史最全最新中文自然语言处理预训练模型汇总分享-内含免费下载地

Posted python遇见NLP

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了历史最全最新中文自然语言处理预训练模型汇总分享-内含免费下载地相关的知识,希望对你有一定的参考价值。

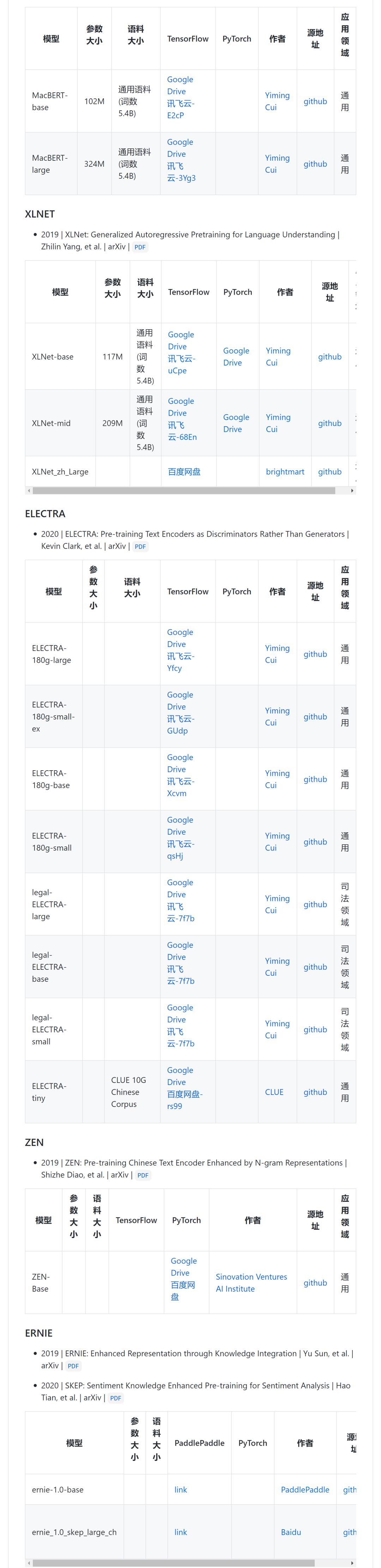

在自然语言处理领域中,预训练语言模型(Pretrained Language Models)已成为非常重要的基础技术,本仓库主要收集目前网上公开的一些高质量中文预训练模型,并将持续更新。包含自然语言理解系列模型,如BERT、RoBERTa、ALBERT、NEZHA、XLNET、MacBERT、ELECTRA、ZEN、ERNIE。自然语言生产系列模型,如GPT、NEZHA-GEN、UniLM

https://github.com/lonePatient/awesome-pretrained-chinese-nlp-models

- END -

欢迎各位NLPer加入(医疗)自然语言处理技术交流群

欢迎各位NLPer加入(医疗)自然语言处理技术交流群

进群请备注:研究方向+昵称,PS等广告勿扰,谢谢

长按识别添加,即可进群

长按识别添加,即可进群

长按二维码识别关注

以上是关于历史最全最新中文自然语言处理预训练模型汇总分享-内含免费下载地的主要内容,如果未能解决你的问题,请参考以下文章