SVM为什么采用间隔最大化?SVM为什么将原始问题转换为其对偶问题?

Posted Data+Science+Insight

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了SVM为什么采用间隔最大化?SVM为什么将原始问题转换为其对偶问题?相关的知识,希望对你有一定的参考价值。

SVM为什么采用间隔最大化?SVM为什么将原始问题转换为其对偶问题?

SVM为什么采用间隔最大化?

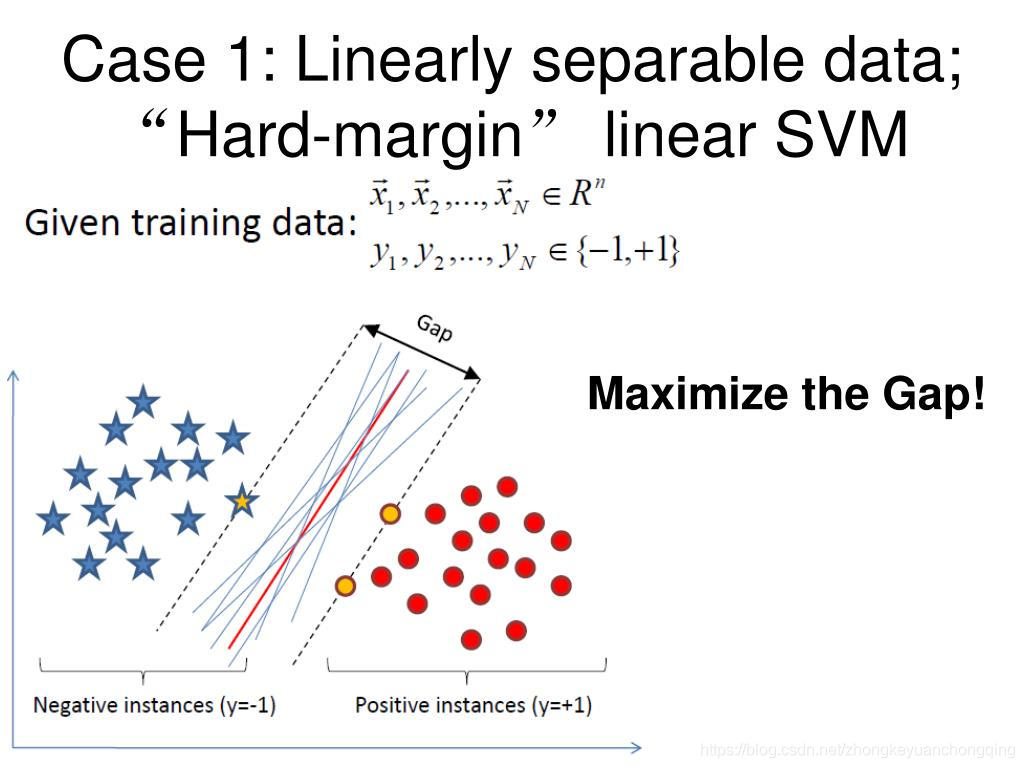

SVM的基本思想就是求解能够正确划分训练数据集并且几何间隔最大的分离超平面,这里的间隔最大化又叫做硬间隔最大化,比较直观的解释是不仅将正负实例点分开,而且对最难分的实例点(离超平面最近的点)也有足够大的确信度将它们分开。

当训练数据线性可分时,通过硬间隔最大化(hard margin maximization)学习一个线性的分类器,即线性可分支持向量机,又成为硬间隔支持向量机;

当训练数据近似线性可分时,通过软间隔最大化(soft margin maximization)也学习一个线性的分类器,即线性支持向量机,又称为软间隔支持向量机;

当训练数据不可分时,通过核技巧(kernel trick)及软间隔最大化,学习非线性支持向量机。

当训练数据线性可分时,存在无穷个分离超平面可以将两类数据正确分开。

感知机利用误分类最小策略,求得分离超平面,不过此时的解有无穷多个。

以上是关于SVM为什么采用间隔最大化?SVM为什么将原始问题转换为其对偶问题?的主要内容,如果未能解决你的问题,请参考以下文章