GBDT 和 AdaBoost区别?

Posted Data+Science+Insight

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了GBDT 和 AdaBoost区别?相关的知识,希望对你有一定的参考价值。

GBDT 和 AdaBoost区别?

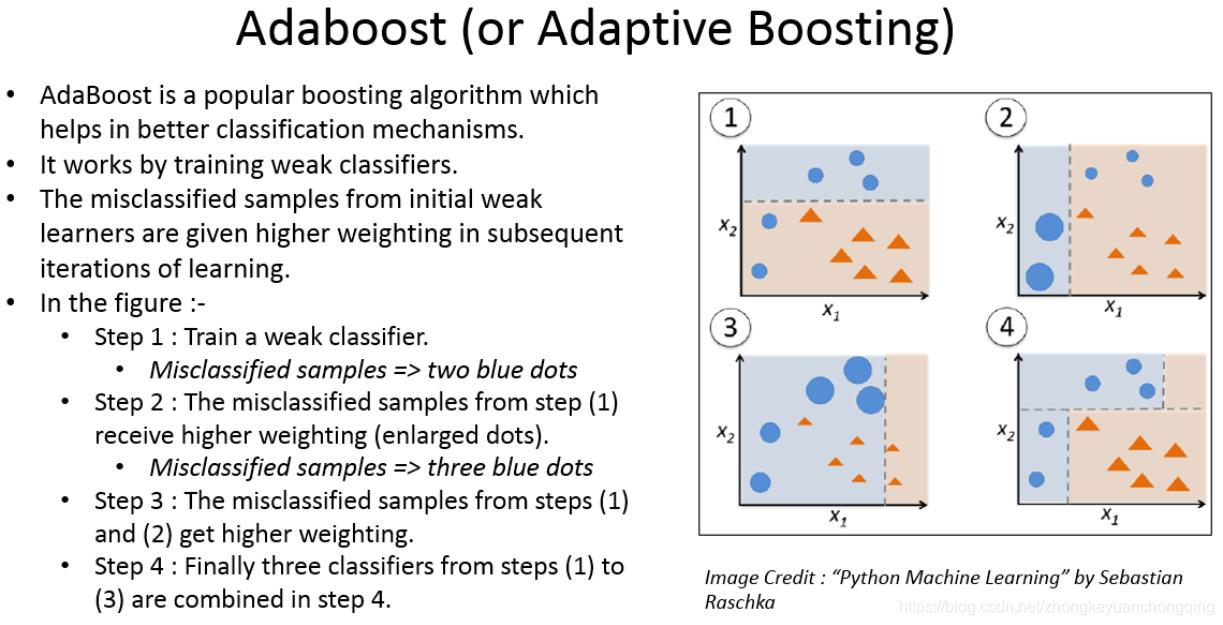

Adaboost算法是一种提升方法,将多个弱分类器,组合成强分类器。

AdaBoost,是英文”Adaptive Boosting“(自适应增强)的缩写,由Yoav Freund和Robert Schapire在1995年提出。

它的自适应在于:前一个弱分类器分错的样本的权值(样本对应的权值)会得到加强,权值更新后的样本再次被用来训练下一个新的弱分类器。在每轮训练中,用总体(样本总体)训练新的弱分类器,产生新的样本权值、该弱分类器的话语权,一直迭代直到达到预定的错误率或达到指定的最大迭代次数。

GBDT(Gradient Boosting Decision Tree)(梯度提升决策树)

定义:是为了解决一般损失函数的优化问题,方法是用损失函数的负梯度在当前模型的值来模拟回归问题中残差的近似值。

GBDT是把所有树的结论累加起来做最终结论的。

GBDT的核心就在于,每一棵树学的是之前所有树结论和的残差(负梯度),

这个残差就是一个加预测值后能得到真实值的累加量。

比如A的真实年龄是18岁,但第一

以上是关于GBDT 和 AdaBoost区别?的主要内容,如果未能解决你的问题,请参考以下文章