数据中心太耗电,送你一个节能神器

Posted 华为云

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了数据中心太耗电,送你一个节能神器相关的知识,希望对你有一定的参考价值。

摘要:其实对于节能,传统技术也是做了“十二分”的努力。但是在技术不断演进的情况下,传统节能技术还是存在问题,如何破?

本文分享自华为云社区《数据中心节能?来试试华为NAIE数据中心节能技术!》,原文作者:启明 。

一、3 年电费消耗,可再建造一个数据中心!

1.1 科技驱动,推动数据中心市场持续高速发展

国际惯例,先介(bai)绍(du)一(bai)下(ke)“数据中心”:数据中心是全球协作的特定设备网络,用来在 internet 网络基础设施上传递、加速、展示、计算、存储数据信息。一个数据中心的主要目的是运行应用来处理商业和运作的组织的数据。

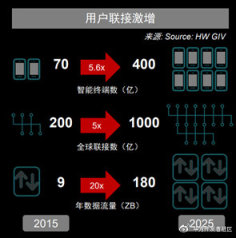

现如今,我们已经处在一个全联接的世界。从 2015 年到 2025 年,根据华为 GIV 的数据预测,全球智能终端联接数将从 70 亿激增到 400 亿,全球联接数也将从 200 亿激增到 1000 亿。而在硬件数和联接数激增的背后,是数据流量的爆发式增长:年数据流量将从 9ZB 以 20 倍的速度涌至 180ZB(见图 1)。

图 1:数据来源于 HW GIV

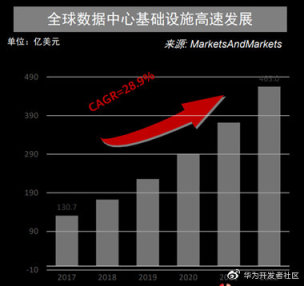

数据流量的极速增长,加上政府对各新兴产业的大力扶持,数据中心的发展建设将迎来高速发展时期,根据 MarketsAndMarkets 的数据统计预估,全球数据中心的价值将从 2017 年的 130.7 亿美元增长到 2022 年 465.0 亿美元(见图 2),这其中的 CAGR(Compound Annual GrowthRate,复合年均增长率)高达 28.9%。其市场规模及市场价值,不言而喻。

图 2:数据来源于 MarketsAndMarkets

1.2 高电力消耗,数据中心产业“背后的阴影”

“阳光背后总有阴影”。高产业价值的背后,是高电力消耗。作为“数据中心”,可以想象:一个大型机房,里面密密麻麻地布满了各式各样的机柜、服务器等。数据中心的前期基础建设和投资,将会是一笔巨额数字。而一旦启动使用,这其中的电费,又将是一个天文数字。我们可以用一个大型数据中心 10 年的运营成本情况来看看这其中的电力使用情况:

从上面的表格可以看到,该数据中心每年电费将近 3600 万,其中有 70%都用于电费,而 70%的电费中,又有 19%用于制冷上。且据 2017 年统计,全球数据中心用电量占全球用电量的 3%,年增长率超过 6%,相当于 30 个核电站;仅中国的数据中心用电量每年就有 1200 亿千瓦时,超过三峡电站 2017 年全年发电量(1000 亿千瓦时)。计算下来,数据中心 3 年的电费可以再造一个数据中心!

1.3 外部政策+运营挑战,数据中心产业节能成必然趋势

数据中心背后的电费数据如此触目惊心,以至于在国家层面都有相关的政策对能效指标提出了严格的要求:如,工业和信息化部在《绿色数据中心指导意见》中要求新建的数据中心的 PUE 要小于 1.4;对于北京、上海、深圳等地也对 PUE 有规划的要求,特别是深圳市发改委鼓励新建的数据中心的 PUE 要小于 1.25,这其实是一个很有挑战的数字。当然,欧盟和美国对 PUE 也有相应的自己的规范。毕竟,节能,就意味着降低成本,进而增加利润。

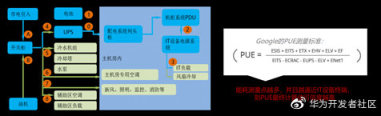

要解决能耗问题,我们需要先把能耗问题列成一个公式,进而通过降低或增加公式的某个值来达到降低能耗的目的。这个公式就是我们前面说的 PUE 的计算方法。

PUE,即 Power UsageEffectiveness,电能使用效率。PUE=数据中心总能耗/IT 设备能耗,其中数据中心总能耗包括 IT 设备能耗和制冷、配电等系统的能耗。PUE 的值,必然是大于 1 的。举个例子,如果 PUE=2,那就意味着,IT 设备每消耗 1 瓦特的电量,就需要额外再消耗 1 瓦特的电量对它进行配电和冷却。当然,如果在理想情况下,如果所有的电力全都消耗在 IT 设备上,也就是说所有的电力全用于生产,那么这时候的 PUE 就是等于 1。

下图为一个数据中心的能耗单元详情:

可以看到,一个数据中心的能耗单元包括冷水机组,水泵,IT 设备,风扇,新风照明等等,这些单元的能耗处于分子的位置。PUE 越接近 1,则使用效能越高,越省电,越省钱。那么要节电,很自然的,我们会从分子入手,即非 IT 能耗(主要为制冷功能)。

1.4 找到原理,数据中心如何制冷

在想解决办法之前,我们先看看数据中心的制冷原理(下图为制冷简图)。

整个系统可以分为冷冻站和末端机房两部分,这边虚线的左侧是冷冻站,它包括冷却塔,制冷机组,各种功能的水泵以及储存冷水使用的蓄冷罐;虚线右侧则是我们的 IT 设备机房,里面除了服务器机柜外,还要用来吹出冷风的空调。空调的冷源即来自于左侧的冷冻站。

简单来说,整个系统制冷系统就是把 IT 设备里服务器散发出来的热量给搬移到室外去,制冷系统的耗电单元也很直观,就是图上的冷却塔,冷却泵,冷机以及空调等。

当然,上图只是一个简单的原理图,实际中的制冷图会远比上图复杂的多。那么复杂的系统我们该如何节能呢?

1.5 技术演进下,传统节能技术的局限

其实对于节能,传统技术也是做了“十二分”的努力。但是在技术不断演进的情况下,传统节能技术还是存在以下问题:

- 产品级节能技术应用已接近天花板;

- 系统复杂、设备多、各设备间能耗影响关系错综复杂,难以用传统工程学公式模拟,传统控制方式各自为政,专家经验作用已达极限;

- 每个数据中心都是独特的环境和架构,虽然许多工程实践和经验法则可以全面应用,但一个系统运行的定制模型并不能保证另一个系统的成功。

二、NAIE 数据中心节能技术如何助力节能

2.1 业界共识,AI 助力数据中心节能

如前面所说,传统节能技术已经无法满足数据中心节能的需求。大家开始寻求新的方式。

现如今,业界的共识是使用 AI 来调节整个制冷系统,让各个设备运行状态相互匹配,从而达到最佳状态。根据 Gartner 的用户调研显示,截止 2020 年,30%未做好人工智能准备的数据中心,其业务将不再具有经济性。同时,调研还列举了人工智能改善数据中心日常运营的三种方式:

- 利用预测分析优化工作负载分配,实施优化存储和计算负载平衡;

- 机器学习算法以最佳方式处理事务,用人工智能来优化数据中心能耗;

- 人工智能可缓解人员短缺,自动执行系统更新、安全补丁。

“使用 AI 来调节制冷系统”,最有名的是 Jim Gao 和 DeepMind 团队的合作。他们使用神经网络分别预测了 PUE、数据中心的温度、负载压力,来控制大概 120 个数据中心的变量,从而实现 PUE 的降低。

业界对于 AI 技术进行数据中心节能已经有非常成功的应用,接下来,我们看看 NAIE 数据中心是如何助力节能的吧!

2.2 华为 NAIE 数据中心节能技术

就“节能”而言,其实是一个非常大的话题,而 NAIE 数据中心节能,也是包含了很多方面,我们今天的介绍,以“制冷系统节能”为主。针对“制冷系统节能”,NAIE 数据中心节能有以下 4 个“手段”:

2.2.1 原始数据特征工程

对于数据中心的制冷系统,一般都有着复杂的管路布局、安装的制冷机组(水泵,水塔等设备),并且除了这些设备之外,还有数不清的传感器。同时,不同的数据中心,根据选址的不同也会有各方面的差异,最终导致管路和设备都是不一样的。

针对这些数据差异,我们可以通过 AI 算法屏蔽:通过特征工程去处理一些复杂的结构,比如说单管、母管、环管等;根据不同的管制,我们想办法提取统一的特征,然后针对不同的设备,如冷塔、冷机、热交换机、水泵、空调等,综合提取比较接近的特征;最后,对数据进行校验,对缺失的数据给予补齐,对错误的数据机进行纠正,对异常的样本进行删除。

因此,通过特征工程,我们可以将局点采集到的数据加工成一个比较统一的形式,提供给后面的 AI 算法。

2.2.2 能耗预测和安全保障模型

要节能,首先需要有一个能耗预测模型。建立一个好的模型,是预测如何调节制冷系统节能的一个良好开端。但面向工业控制领域的预测模型,与预测股票走势,或者是地铁人流量的模型有一个比较大的区别:对安全的控制。毕竟安全生产是第一位的,省电省钱才是第二位的。

所以 NAIE 数据中心节能预测模型不是一个简单的、独立的模型,而是一套模型:不仅要预测在调节之后的能耗,还要预测各个智能系统的状态。要保证在所有系统状态正常的基础上,再去节能。

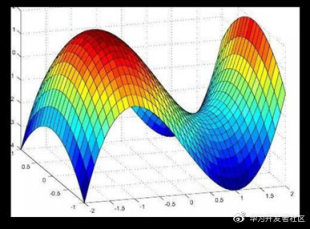

2.2.3 控制参数寻优

前面两个“手段”的介绍,已经为节能算法打下了良好的基础。到了第三个“手段”,就要出“成绩”了。我们搜索到的控制参数是不是“优秀”,完全是由第三个“手段”的质量来决定的。“能耗预测和安全保证模型”提供了一个很好的能耗和状态预测的模型,可以把这个模型想象成一个超曲面图形(如下图)。当然,它的形状是画不出来也很难想象的,因为我们解决的是一个高维空间的问题,并且在这个超曲面上还有很多的空洞,这些空洞表示不安全的控制参数。那么我们第三个“手段”的目的就是为了又快又好的找到其中更优或者最优的控制参数,下发给设备来执行。

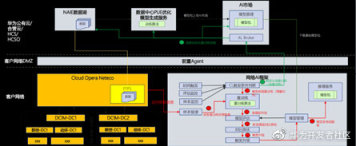

2.2.4 NAIE 云地协同

云地协同,即是打通了云端和地端,实现数据采集上云,模型日常评估,重(chóng)训练,模型更新全流程的自动化的服务。

简单说明一下:数据采集,即新的样本;模型的日常评估,即决定什么时候更新;重训练,即重新训练的流程,最后达到模型更新全自动化的目的。(具体框架图见下)

NAIE 的云地协同,在云上有 NAIE 的数据湖、数据中心 PUE 优化模型生成服务,以及 AI 市场(AI 市场用来管理生成的模型包);在客户网络的地端,有网络 AI 框架(运行模型生成服务生成的模型的平台)。地端的网络 AI 框架负责样本采集及管理,同时还负责运用新的样本不断地对生成的模型进行评估。如果发现采集的样本的分布发生了明显的变化,或者说是模型精度老是不达标的时候,就会触发去重建模型。

同时,网络 AI 框架通过华为的 Cloud Opera Neteco 系统与数据中心的实际控制系统进行了对接。如此一来,由模型生成的控制参数可以直接下发到实际的群控系统里面。

2.3NAIE 助力数据中心节能,所向披靡

华为的某数据中心,在 NAIE 的加持下,全年的 PUE 经过优化之后,对比使用 AI 前,PUE 降低了 0.12,换算成电力,也就是每个采样周期可以降低 328.6 千瓦的耗电。这样算下来,一年可以省掉 580 万元的电费,一个相当可观的数字。

- NAIE 模型生成服务

不同的数据中心,在制冷模式(水冷、风冷、AHU 等)、管路类型(母管、单管、混合管)等方面很可能存在差异,我们该如何入手呢?

这里就要用到我们前面说的“特征工程”。如我们前面所说,“特征工程”的用处就是能够屏蔽 AI 算法的诸多差异,能够尽量形成统一的特征。

普通的建模(如下图),针对开发人员:从节能建模到模型应用,需要开发人员 4 个,历时 6 个月。

而 NAIE 在“特征工程”与“老专家”的技术加持下,已经为大家准备好了前序条件,我们来看看 NAIE 的几大亮点与优势:

1. 零编码高效建模:基于华为的数据中心拓扑模板、AI 模型训练平台和 PUE 特征/算法库,能源工程师只需提供基础设施运行数据和制冷设备工艺参数,无需任何编码,即可在线得到匹配其数据中心的 AI 模型,模型开发时间从 8 人*6 月降低到 1 人*1 月,整个模型的开发投入降低 95%以上;

2. 参数配置灵活可视:基于华为在数据中心领域可视化的参数配置,通过调整参数,即可生成不同拓扑模板下数据中心的 PUE 模型;

3. 控制策略全面:通过导入数据中心基础设施 PUE 相关全量参数,模型能推理出全套制冷设备的控制策略,如冷水机组、冷却泵、冷却塔、冷冻泵、板换等,帮助能源工程师灵活精准地调控制冷系统,以达到最佳能耗状态;

4. 优化效果好:通过专业的特征识别及处理,模型拟合效果好。 在数量质量保证前提下,PUE 预测准确率达到 95%。

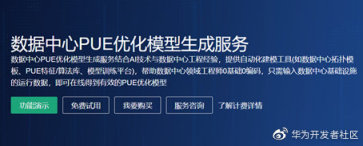

通过数据中心 PUE 优化模型生成服务官网(https://console.huaweicloud.com/naie/products/dpo),可以快速体验服务:点击“功能演示”:

进入服务介绍页面,根据指导一步步往下走,即快速便捷体验数据中心 PUE 优化模型生成服务。

数据中心 PUE 优化模型生成服务结合 AI 技术与数据中心工程经验,提供自动化建模工具(如数据中心拓扑模板、PUE 特征/算法库、模型训练平台),帮助数据中心领域工程师 0 基础 0 编码,只需输入数据中心基础设施的运行数据,即可在线得到有效的 PUE 优化模型,一起来试试?

以上是关于数据中心太耗电,送你一个节能神器的主要内容,如果未能解决你的问题,请参考以下文章