何恺明大神ICCV2017最佳论文Mask R-CNN的Keras/TensorFlow/Pytorch 代码实现

Posted 现代服务产业技术创新战略联盟

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了何恺明大神ICCV2017最佳论文Mask R-CNN的Keras/TensorFlow/Pytorch 代码实现相关的知识,希望对你有一定的参考价值。

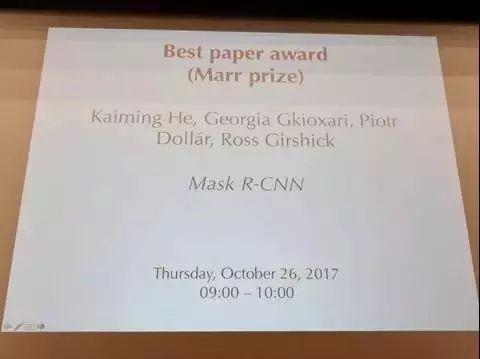

何恺明大神的论文Mask R-CNN 获得ICCV最佳论文 ,而关于这篇论文的TensorFlow\Pytorch\Keras实现相继开源出来,让我们来看下。

摘要

我们提出了一个概念上简单、灵活和通用的用于目标实例分割(object instance segmentation)的框架。我们的方法能够有效地检测图像中的目标,同时还能为每个实例生成一个高质量的分割掩码(segmentation mask)。这个方面被称为 Mask R-CNN,是在 Faster R-CNN 上的扩展——在其已有的用于边界框识别的分支上添加了一个并行的用于预测目标掩码的分支。Mask R-CNN 的训练很简单,仅比 Faster R-CNN 多一点计算开销,运行速度为 5 fps。此外,Mask R-CNN 可以很容易泛化到其它任务,比如,让我们可以在同一个框架中估计人类的姿态。我们在 COCO 难题套件的所有 3 种任务(track)上都得到了最佳结果,其中包括实例分割、边界框目标检测和人物关键点检测(person keypoint detection)。没有使用其它的技巧,Mask R-CNN 的表现超越了在每个任务上所有已有的单个模型,包括 COCO 2016 挑战赛的获胜模型。我们希望我们的简单又有效的方法能成为一个坚实的基础,能帮助简化实例层面识别的未来研究。我们将会公开相关代码。

这是一个在Python 3,Keras和TensorFlow基础上的对Mask R-CNN的实现。这个模型为图像中的每个对象实例生成边界框和分割掩码。它是在 Feature Pyramid Network (FPN) 和 ResNet101基础上实现的。

这个项目包括包括: - 在FPN和ResNet101基础上构建的Mask R-CNN的源代码。 - MS COCO的训练代码 - 预训练的MS COCO 权重 - 使用Jupyter notebooks 来可视化检测过程的每一个步骤 - 用于多GPU训练的ParallelModel类 - MS COCO指标评估(AP) - 用于训练你自己数据集的例子

代码被整理和设计得很容易被扩展。 如果在你的研究中使用了这份代码,请考虑引用此项目。 如果您从事3D视觉的相关研究,你可能会发现我们最近发布的Matterport3D数据集同样很有用

demo.ipynb 最简单的事从这里开始. 这里演示了怎么用一个MS COCO预训练的模型来分割你的图片。里面包含了对任意图片进行目标检测和实体分割的代码。

train_shapes.ipynb 演示怎么在你自己的数据集上训练Mask R-CNN。这个notebook通过一个简单的模拟数据来展示怎么用在新的数据集上。

(model.py, utils.py, config.py): 这几个文件是Mask RCNN 的主要实现部分

inspect_data.ipynb. 这个notebook对几个不同的数据处理步棸进行可视化。

inspect_model.ipynb 这个notebook深入代码演示物体检测和分割过程,还提供了对每一步的可视化。

inspect_weights.ipynb 这个notebook用来观察训练模型的权重以及检查一些特例。

为了方便理解和调试模型,我们提供了三个notebook (inspect_data.ipynb, inspect_model.ipynb, inspect_weights.ipynb),包含实验的可视化过程,还可以让你一步一步的观察每个点的输出过程。下面是一些例子。

1. 锚点排序和过滤

第一步候选区域(Region Proposal)网络的可视化以及沿着anchor box refinement 的正锚点和负锚点。

2. boundingbox 精简

这是一个最终的检测区域(虚线)以及改善后的结果(实线)例子。

3. 掩码生成

生成的掩码例子。这些掩码随后会被缩放放置在图片的合适区域。

4. 每一层激活值的可视化

通常观察不同层激活对于解决检测中遇到的一些问题很有帮助。(全零值,或者随机噪声)

5. 权重直方图

另外一个调试技巧就是观察权重的直方图。这里是inspect_weights.ipynb notebook.给出的演示效果。

6.TensorBoard 可视化

还有一个非常重要的调试和可视化工具是TensorBoard. 这个模型被配置为记录loss值的变化,并在每个epoch后保存权值。

7. 组合得到最终结果

我们提供预训练的权值让你更简单的上手。 你还可以用这些权重为七点训练自己的模型。训练和验证的代码在coco.py中。你可以在notebook中引入这个模块或者直接从命令行运行。

Train a new model starting from pre-trained COCO weights python3 coco.py train --dataset=/path/to/coco/ --model=coco

Train a new model starting from ImageNet weights python3 coco.py train --dataset=/path/to/coco/ --model=imagenet

Continue training a model that you had trained earlier python3 coco.py train --dataset=/path/to/coco/ --model=/path/to/weights.h5

Continue training the last model you trained. This will find the last trained weights in the model directory. python3 coco.py train --dataset=/path/to/coco/ --model=last

你也可以像这样运行COCO的验证代码:

训练优化方法,学习率以及其他参数都是在coco.py 中设置。

Python安装依赖包

• Python 3.4+ • TensorFlow 1.3+ • Keras 2.0.8+ • Jupyter Notebook • Numpy, skimage, scipy, Pillow

MS COCO 要求:

为了训练MS COCO,你需要以下:

pycocotools (installation instructions below)

MS COCO Dataset

Download the 5K minival and the 35K validation-minus-minival subsets. More details in the original Faster R-CNN implementation. 如果你使用Docker,代码已经在 Docker container中验证通过。

安装

Clone this repository

Download pre-trained COCO weights (mask_rcnn_coco.h5) from the releases page.

(可选) To train or test on MS COCO install pycocotools from one of these repos. They are forks of the original pycocotools with fixes for Python3 and Windows (the official repo doesn't seem to be active anymore).

Linux: https://github.com/waleedka/coco

Windows: https://github.com/philferriere/cocoapi. You must have the Visual C++ 2015 build tools on your path (see the repo for additional details)

更多例子

Keras [https://github.com/matterport/Mask_RCNN\]

TensorFlow [https://github.com/CharlesShang/FastMaskRCNN]

Pytorch [https://github.com/felixgwu/mask_rcnn_pytorch\]

caffe [https://github.com/jasjeetIM/Mask-RCNN]

MXNet [https://github.com/TuSimple/mx-maskrcnn]

免责申明:本站所有内容均来自网络,我们对文中观点保持中立,对所包含内容的准确性,可靠性或者完整性不提供任何明示或暗示的保证,请仅作参考。若有侵权,请联系删除。

文章来源:新智元

以上是关于何恺明大神ICCV2017最佳论文Mask R-CNN的Keras/TensorFlow/Pytorch 代码实现的主要内容,如果未能解决你的问题,请参考以下文章

《Video MAE》何恺明团队提出视频版本的MAE,进行高效视频预训练!Mask Ratio高达90%时效果很好!...

CVPR 2021大奖公布!何恺明获最佳论文提名,代码已开源!

CVPR 2021大奖公布!何恺明获最佳论文提名,代码已开源!

何恺明上榜CVPR 2021获奖名单,4篇「最佳」是华人一作