风起乌兰察布,中国自动驾驶迎来170倍提速

Posted QbitAl

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了风起乌兰察布,中国自动驾驶迎来170倍提速相关的知识,希望对你有一定的参考价值。

贾浩楠 发自 凹非寺

量子位 | 公众号 QbitAI

内蒙古中部城市乌兰察布,西承阴山东段,南接内蒙古高原。

天然具有凉爽的气候、充足的风电等等资源,隶属于国家“东数西算”内蒙古枢纽节点。

2022年的今日今时,国内十余家叫得上名号的一线车企、自动驾驶公司齐聚于此。

它们来这里只办三件事:

算力、算力、还是算力!

而把自动驾驶行业渴求的算力带给它们的,是阿里云。

乌兰察布,正在发生什么?

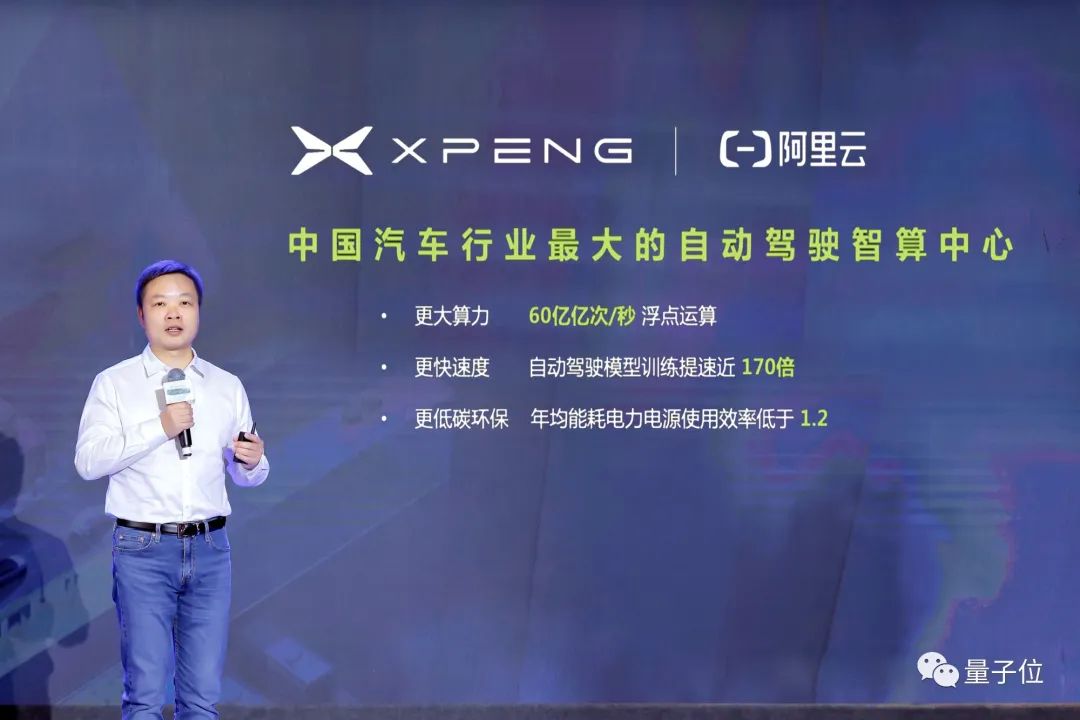

第一个在乌兰察布解锁超大算力的,是小鹏汽车。

其实也是阿里云和小鹏汽车一起为智能汽车行业的未来计算需求和发展趋势打了个样。

阿里云和小鹏合作打造的智算中心,既是全国最大的,也是国内第一个投入实际运营的,专为自动驾驶服务的超大智能算力集群。

所谓“智算中心”,并不是传统意义上的超级计算机。

自动驾驶、或者说智能汽车上的核心功能,其实都是AI。具体说,是大规模的深度学习算法。

而无论是训练,还是测试这样的模型,扮演主角的不再是传统CPU的逻辑推理能力,而是以AI加速器为主的浮点计算能力,GPU则是当前AI加速器的主流。

所以,智算中心的第一个特征,就是以大规模GPU算力作为AI模型迭代的基础。

第二个特征,是与汽车业务深度结合,为智算中心提供了针对自动驾驶应用特征的算力集群、性能加速工具和AI大数据平台,使得模型训练性能、GPU资源利用率和算法研发效能都大大提升。

小鹏汽车和阿里云打造的智算中心,名叫“扶摇”。“扶摇”之意,当然是阿里云提供的超大算力和针对性工具,能让小鹏汽车的自动驾驶系统能力“直上九天”。

那么,实际果真如此吗?

已经建成交付的扶摇智算中心,总算力达到600PFLOPS。

这是个啥概念?

每秒进行6*1017次浮点运算,即60亿亿次。

整体计算效率上,扶摇实现了算力的线性扩展。存储吞吐比业界20GB/s的普遍水准提升了40倍,数据传输能力相当于从送快递的微型面包车,换成了20多米长的40吨集装箱重卡。

小鹏汽车一个典型核心自动驾驶模型,以前完整训练一遍需要7天,而如今在扶摇上,只需要一个小时。

自动驾驶模型训练提速近170倍,会大力推动自动驾驶技术的发展速度,让小鹏汽车的智能化程度和安全性都迈入新的阶段。

迭代速度对于以智能化、自动驾驶立身的企业来说意味着什么,无需赘述。

大算力给自动驾驶带来的意义,何小鹏除了眼前的,也站在行业未来发展的角度给出另一番解读:

未来5年,小鹏汽车可能还有百倍的算力需求增长。

希望大家都看到这个趋势。如果现在不以这样的方式提前储备算力,那么今后5年内,企业算力成本会从亿级,加到数十亿级。

何小鹏为什么这么说——

自动驾驶,没它不行吗?

对于真正把智能化作为核心竞争力和未来发展方向的企业来说,没智算中心,未来的竞争中就没有底层根基。

行业有共识的普遍规律是:自动驾驶每提升一个等级,所需车端的算力会以一个数量级的速度增长。

比如一家公司研发的L2级辅助驾驶需要20TOPS的话,那L3则需要200TOPS,L4需要2000TOPS….

背后是核心AI模型的参数、规模以同样大规模速度增长。

而企业后台开发端的算力需求,业内人士估算:

车端算力增长一个数量级,相应的模型在后端训练、验证,并形成常态化的迭代,所需要的算力会以两个数量级倍增。

所以智算中心对自动驾驶来说,最直接的意义在于提供更高的算力,训练更大规模模型。

相应的,自动驾驶能力上限也就越高,直接决定未来行业竞争力高低。

但是,算力这个东西,可以通过自行购买GPU搭建集群的方式获取,事实上,之前几年行业内也是一直这么干的。

为什么到了2022年,大家不约而同开始渴望智算中心了呢?

核心原因,在于今年头部自动驾驶玩家的竞速,已经到了抢先落地城市领航辅助驾驶的阶段。

复杂路况下的复杂决策能力,包括识别红绿灯、路口、行车车辆等等,其实已经进入L3-L4级范围。

按照这样的迭代速度,未来3-5年,自动驾驶研发很快会进入较为成熟的L4级甚至是L5级,迭代所需算力也会快速上升到“智算中心”级别。

如果自建数据中心的话,时间是最大的敌人。

需求算力的指数级膨胀,造成目前自动驾驶玩家的“算力”焦虑越来越严重。

当下自动驾驶对于智算中心的需求,其实是为未来的竞争力做储备。

那么,实现智算中心,现在行业里有哪些方式?

成熟的例子,是特斯拉。

去年特斯拉宣布自建智算中心Dojo,算力规模达1.8EPFLOPS,引起业内广泛关注。

Dojo项目细节和进展透露不多,但外界肉眼可见的是,特斯拉将超大规模模型快速迭代,以及数据闭环能力修炼的炉火纯青,背后肯定少不了超大算力的支持。

这也从实际效果上证明了类似智算中心这样的能力,对自动驾驶的必要性。

小鹏与阿里云合作共建智算中心,又是一次重要证明。

“阿里云+”模式,如何评价?

可以说,这是一种更加贴合国内自动驾驶行业现状的模式。

为什么?

阿里云资深专家曹政给出了详细的解答:

自建算力中心,且不说数十亿的前期投入是不是创业公司能轻松承担的,未来随着GPU的迭代、超算架构的升级、自身需求的调整…每一次变更,几乎都是从零开始的重新投入,伴随着巨大的时间和资金成本。

建设算力中心,涉及的冗余、升级、规划等等都需要丰富的经验。但这些经验,却不是现在自动驾驶公司的核心KPI,它们的任务应该是快速提高自动驾驶的能力。

业界有种把智算中心建设等同于堆砌硬件的错误认知,忽略了智算中心的上层软件和平台。而恰恰上层软件平台,是高效释放算力并加工为生产力的核心,也是云厂商数年巨大研发投入的沉淀,可以帮助自动驾驶公司站在云厂商的肩膀上,快速聚焦自动驾驶算法的研发。

何小鹏“现在不做就晚了”的忧虑,看似是成本,其实是时间。

所以第二个问题,为什么是阿里云?

自动驾驶需要的算力,阿里云能给,其他云也能给。

但阿里云不可替代之处在于10年的技术积累,既有云的,也有AI的。

表现之一在成本。智算中心的方案规划、性能参数、功能模块、未来扩展性等等,阿里云都有着丰富的经验,既保证交付时的先进性,又兼顾未来的拓展灵活性。

节省大量企业试错的金钱和时间成本。

表现之二,在于阿里云给小鹏这样的智能车相关企业提供的不只是通用的云服务,而是为AI相关业务量身订制的算力产品。

比如在扶摇智算中心项目中,阿里云提供的,除了600PFLOPS算力,还有超大规模高性能网络RDMA。

因为阿里云在以往电商任务经验中已经认识到,AI是一个带宽敏感业务,需要几百G甚至上T的一个带宽才能满足计算需求。

而以CPU为主的通用超算,由于单数据流的处理模式,对带宽要求并不高。

RDMA高性能网络,单链路可以把带宽提升到实现100G或200G的带宽。另外在单个服务器上并行扩展多张网卡,最高可到1.6PB带宽。

表现之三,阿里云认为,他们的产品与自动驾驶、汽车工业深度契合。

自动驾驶耦合了HPC(高性能计算)、AI、大数据一体化等等需求,不仅仅是需要AI的算力,还需要大数据的算力、HPC的算力。

这种复合性的算力需求,加上大数据、AI和HPC一体的数据业务管理的流程平台,才能达到自动驾驶企业要求。

而阿里给小鹏汽车订制的,就是这样一套完整的智能汽车智算中心方案。

所以,对于中国智能汽车、自动驾驶行业来说,“阿里云+”的合作智算中心模式,首先是一剂巨大的助力,大大节约成本的同时,又大大提升了迭代进步的速度。

从行业竞速角度讲,则终结了企业独自建超算的单打独斗,节约资源使其聚焦核心业务。

而最大的意义,可能是让已经被特斯拉证明的自动驾驶黄金之路,在国内可以低成本实现。

这一点,没有人比第一个吃螃蟹的何小鹏说得更明白:

智算中心让小鹏拥有体系化能力、竞争力。2025年,充分利用云端算力的中国头部玩家,有希望率先把“辅助自动驾驶”的“辅助”二字去掉。

— 完 —

点这里👇关注我,记得标星哦~

以上是关于风起乌兰察布,中国自动驾驶迎来170倍提速的主要内容,如果未能解决你的问题,请参考以下文章

中国北斗系统今天开始提供全球服务,自动驾驶将迎来更精准定位 智车科技 2018-12-28 09:35:15