卷积神经网络算啥方向

Posted

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了卷积神经网络算啥方向相关的知识,希望对你有一定的参考价值。

计算机专业,卷积神经网络(Convolutional Neural Networks, CNN)是一类包含卷积计算且具有深度结构的前馈神经网络(Feedforward Neural Networks),是深度学习(deep learning)的代表算法之一[1][2]。卷积神经网络具有表征学习(representation learning)能力,能够按其阶层结构对输入信息进行平移不变分类(shift-invariant classification),因此也被称为“平移不变人工神经网络(Shift-Invariant Artificial Neural Networks, SIANN)”[3]。对卷积神经网络的研究始于二十世纪80至90年代,时间延迟网络和LeNet-5是最早出现的卷积神经网络[4];在二十一世纪后,随着深度学习理论的提出和数值计算设备的改进,卷积神经网络得到了快速发展,并被应用于计算机视觉、自然语言处理等领域[2]。卷积神经网络仿造生物的视知觉(visual perception)机制构建,可以进行监督学习和非监督学习,其隐含层内的卷积核参数共享和层间连接的稀疏性使得卷积神经网络能够以较小的计算量对格点化(grid-like topology)特征,例如像素和音频进行学习、有稳定的效果且对数据没有额外的特征工程(feature engineering)要求[1][2]。定义:采用监督方式训练的一种面向两维形状不变性识别的特定多层感知机[136] 参考技术A 卷积神经网络有以下几种应用可供研究:

1、基于卷积网络的形状识别

物体的形状是人的视觉系统分析和识别物体的基础,几何形状是物体的本质特征的表现,并具有平移、缩放和旋转不变等特点,所以在模式识别领域,对于形状的分析和识别具有十分重要的意义,而二维图像作为三维图像的特例以及组成部分,因此二维图像的识别是三维图像识别的基础。

2、基于卷积网络的人脸检测

卷积神经网络与传统的人脸检测方法不同,它是通过直接作用于输入样本,用样本来训练网络并最终实现检测任务的。它是非参数型的人脸检测方法,可以省去传统方法中建模、参数估计以及参数检验、重建模型等的一系列复杂过程。本文针对图像中任意大小、位置、姿势、方向、肤色、面部表情和光照条件的人脸。

3、文字识别系统

在经典的模式识别中,一般是事先提取特征。提取诸多特征后,要对这些特征进行相关性分析,找到最能代表字符的特征,去掉对分类无关和自相关的特征。然而,这些特征的提取太过依赖人的经验和主观意识,提取到的特征的不同对分类性能影响很大,甚至提取的特征的顺序也会影响最后的分类性能。同时,图像预处理的好坏也会影响到提取的特征。 参考技术B 卷积是数学分析中的一种积分变换的方法,在图像处理中采用的是卷积的离散形式。这里需要说明的是,在卷积神经网络中,卷积层的实现方式实际上是数学中定义的互相关 (cross-correlation)运算,与数学分析中的卷积定义有所不同,使用互相关运算作为卷积的定义。

互相关(Cross-Correlation)是一个衡量两个序列相关性的函数,通常是用滑动窗口的点积计算来实现。

用于图像识别的方向卷积网络

重磅干货,第一时间送达

小黑导读

论文是学术研究的精华和未来发展的明灯。小黑决心每天为大家带来经典或者最新论文的解读和分享,旨在帮助各位读者快速了解论文内容。个人能力有限,理解难免出现偏差,建议对文章内容感兴趣的读者,一定要下载原文,了解具体内容。

摘要

深度卷积神经网络(Deep Convolutional Neural network, DCNNs)具有强大的图像表示能力,在图像识别领域引起了广泛关注。然而,由于其内在机制的限制,它们在建模取向转换方面受到了限制。在本文中,作者开发了基于地标Gabor滤波器(LGFs)的图像识别方向卷积网络(OCNs),从而增强了学习到的表示对方向变化的鲁棒性。通过利用LGFs对卷积滤波器进行调制,OCNs可以兼容任何现有的深度学习网络。LGFs作为一个Gabor滤波器组,选择p (?n)代表的Gabor滤波器为andmarks,将原始的Gabor滤波器表示为这些地标的稀疏线性组合。具体而言,基于矩阵分解框架,利用稀疏性和低秩约束对原始Gabor滤波器的局部和全局结构进行灵活集成。随着低秩结构的传播,原始Gabor滤波器组表示的相应稀疏性可以显著提高。在多个基准上的实验结果表明,与现有的最先进的方法相比,作者的方法对定位不太敏感,在精度和成本方面都有更高的性能。此外,作者的OCNs需要学习的参数较少,可以显著降低训练网络的复杂性。

本文的主要贡献如下:

1)在矩阵分解框架中定义了LGFs及其相关系数。为了实现有效的LGFs,作者通过传播低秩结构来提高系数的稀疏性。

2)将所提出的LGFs问题表述为一个具有明确目标函数的优化问题。然后设计了一种有效的迭代算法来求解约束优化问题。

3)利用现有的深度学习结构,对基于LGFs的dnns的基本元素进行调制,提出了OCNs。该结构同时考虑了LGFs和深度神经网络,增强了网络的紧凑性,同时在方向变化的情况下仍能获得满意的特征表示能力。

框架结构

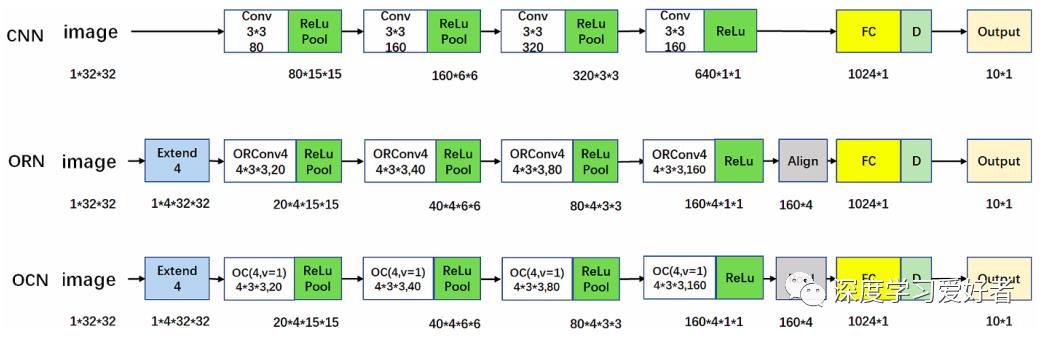

为了将方向和尺度信息整合到OCNs中,作者使用LGFs对标准CNNs中的卷积滤波器进行调制。然后,可以增强OCNs中相应的卷积特征。与标准DCNNs表示每层权重的尺寸为Cout× Cin×W ×W不同,OCNs表示为Cout×Cin×N ×W ×W,其中W ×W为过滤器的尺寸,N 为通道,Cout和Cinrefer为对应特征映射的通道。

实验结果

有网络结构在卷积层之后都使用了Max-pooling和ReLu。同时,为了避免过拟合,使用了dropout layer。为了与其他cnn进行比较,像在ORNs一样,通过减小卷积核[33]的宽度来保证相似模型的大小。作者首先测试了几种不同OCNs层的尺度,即V = 1, V = 4。由表I-II可以看出,V = 4的性能在错误率上优于V = 1。在V = 4时,表III中也对OCNs的朝向数进行了评估,这表明OCNs在使用3 - 7个朝向时可以获得满意的性能。可以发现,需要足够的定向通道来捕获定向信息。

作者还在MNIST和MNIST-rot数据集上比较了提出的OCNs与基线方法。如表IV所示,最后两列是错误率方面的性能比较。与基准常规CNNs相比,3 × 3核大小的OCNs在使用较少的CNNs参数的情况下表现出更好的性能。此外,可以看到,5 × 5和7 × 7核大小的OCNs在MNIST-rot上的测试误差为0.55%,在MNIST数据集上的测试误差为0.40%。这是因为更大的内核大小有更多的面向信息。此外,作者列出了比较方法的相应计算时间,这表明OCNs比其他最先进的基线模型更有效。较大的ocn确实可以产生更好的性能,这验证了作者方法近似的定向滤波器有助于实现对旋转变化的鲁棒性。

结论

结论

本文研究了有效定向滤波器(LGFs)的获取问题,并将LGFs与dnns相结合,提出了一种新的深度学习模型以增强表示。主要贡献是设计LGFs,以及改进最先进的dnns架构对方向和尺度变化的泛化能力。LGFs在现有体系结构上易于实现,整个设计过程具有灵活性和可扩展性,使其能够更好地调制DCNNs中的标准滤波器。实验上,ocn显著优于基线,获得了最先进的性能超过基准。

论文链接:https://arxiv.org/pdf/2102.01523.pdf

每日坚持论文分享不易,如果喜欢我们的内容,希望可以推荐或者转发给周围的同学。

- END -

#投 稿 通 道#

让你的论文被更多人看到

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢?答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。深度学习爱好者 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

深度学习爱好者 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学习心得或技术干货。我们的目的只有一个,让知识真正流动起来。

以上是关于卷积神经网络算啥方向的主要内容,如果未能解决你的问题,请参考以下文章