写Python爬虫又被屏蔽了,你现在需要一个稳定的代理IP

Posted 梦想橡皮擦

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了写Python爬虫又被屏蔽了,你现在需要一个稳定的代理IP相关的知识,希望对你有一定的参考价值。

头铁的爬虫工程师

如果一个爬虫工程师,手里拿不出来一些可用代理 IP,多少有些说不出去,毕竟我们每天面对各种反爬场景,没有代理,工作还真不好展开,因此橡皮擦每周都有一个“小任务”,找一个稳定的代理源。

今天在畅游互联网,找代理 IP 的时候,发现了一个新代理站点,那必须试一把,而且这个站点认证就送流量,站点名字叫做 IPIDEA,是一个专门做海外代理的站点。

注册之后,立刻就有客服人员电话送流量了,这服务没得说。

下面你可以一边注册,一边学习下面的一些概念,该知识点和中级爬虫工程师息息相关!如果你还在学习阶段,本篇博客就可以让你提前接触中级的知识点啦。

什么是住宅代理 IP

住宅 IP 地址是与物理设备绑定的 IP 地址,与动态 IP 不同,服务器会将住宅 IP 识别为真实的人,安全性和稳定性更高,也由于该原因,我们可以将自己的位置变为世界各个国家地区的家庭地址,从而实现从指定位置访问目标站点,避免地理限制。

如果你用了住宅代理 IP,玩游戏都能解除锁区限制。

为什么要用住宅代理

必然是因为某些原因,你想要隐藏 IP 地址,作为一个爬虫工程师,你一定会用到,例如网络抓取,广告验证,网络营销……,如果你正在学习 Python 爬虫,对住宅代理 IP 的使用场景不熟悉,正好也可以去该代理 IP 站点学习一下,提供解决方案的产品站点上,一定有市场上最需要的技术。

代理实战

目标站点已经有了,下面就需要去采集代理数据了,毕竟作为程序员不能每次都手动获取 IP,打开菜单栏中的【代理服务】,结果直接发现 API Demo,好家伙,真便利。

实战中橡皮擦测试了多种代理类型,例如 API 链接形式、账密认证形式、IP 端口形式。而且作为一款代理平台,ipidea 支持的协议类型有,http/https/socks5,满足了常用场景的实战需求。

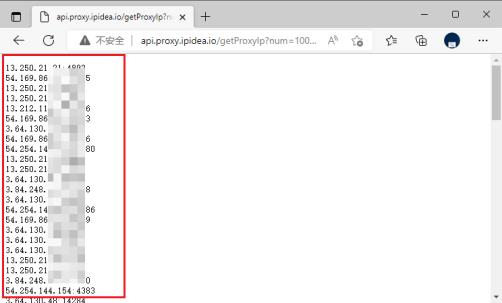

点击 API 获取之后(需要实名注册一下),获取 API 链接

复制上述地址,填写到下文图片后的代码中,即可实现代理 IP 提取器。

测试代码如下所示:

# coding=utf-8

# !/usr/bin/env python

import json

import threading

import time

import requests as rq

headers =

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64; rv:85.0) Gecko/20100101 Firefox/85.0",

"Accept": "text/html,application/xhtml+xml,application/xml;q=0.9,image/webp,*/*;q=0.8",

"Accept-Language": "zh-CN,zh;q=0.8,zh-TW;q=0.7,zh-HK;q=0.5,en-US;q=0.3,en;q=0.2",

"Accept-Encoding": "gzip, deflate, br"

testUrl = 'https://api.myip.la/en?json'

# 核心业务

def testPost(host, port):

proxies =

'http': 'http://:'.format(host, port),

'https': 'http://:'.format(host, port),

res = ""

while True:

try:

res = rq.get(testUrl, proxies=proxies, timeout=5)

# print(res.status_code)

print(res.status_code, "***", res.text)

break

except Exception as e:

print(e)

break

return

class ThreadFactory(threading.Thread):

def __init__(self, host, port):

threading.Thread.__init__(self)

self.host = host

self.port = port

def run(self):

testPost(self.host, self.port)

# 提取代理的链接 json类型的返回值

tiqu = 'http://api.proxy.ipidea.io/getProxyIp...刚刚复制的地址'

while 1 == 1:

# 每次提取10个,放入线程中

resp = rq.get(url=tiqu, timeout=5)

try:

if resp.status_code == 200:

dataBean = json.loads(resp.text)

else:

print("获取失败")

time.sleep(1)

continue

except ValueError:

print("获取失败")

time.sleep(1)

continue

else:

# 解析json数组

print("code=", dataBean["code"])

code = dataBean["code"]

if code == 0:

threads = []

for proxy in dataBean["data"]:

threads.append(ThreadFactory(proxy["ip"], proxy["port"]))

for t in threads: # 开启线程

t.start()

time.sleep(0.01)

for t in threads: # 阻塞线程

t.join()

# break

time.sleep(1)

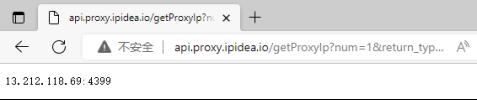

实战中,可以每次获取一个 IP,只需要按照 API 参数说明,修改请求地址即可。

运行代码,得到下述输出,这里需要看你向接口传递的数据返回类型。

"code":0,"success":true,"msg":"请求成功","request_ip":"124.236.251.177","data":["ip":"3.64.130.48","port":17704]

Python 使用代理

在获取了代理 IP 之后,就可以配合 requests 模块完成代理请求操作。

测试代码如下所示:

import requests

import json

url = 'https://httpbin.org/get'

headers =

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64; rv:85.0) Gecko/20100101 Firefox/85.0",

api_url = 'http://api.proxy.ipidea.io/getProxyIp?num=1&return_type=json&lb=1&sb=0&flow=1®ions=&protocol=http'

res = requests.post(api_url, verify=False)

ip_port = res.json()

proxie = "http://%s:%d" % (ip_port["data"][0]["ip"], ip_port["data"][0]["port"])

proxies = 'http': proxie, 'https': proxie

print(proxies)

html = requests.get(url=url, headers=headers, proxies=proxies, verify=False).text

print(html)

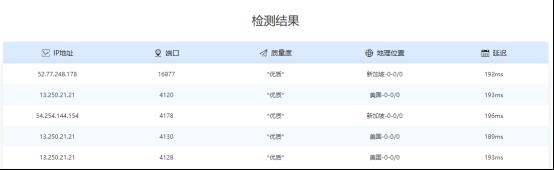

在正式使用代理时,还需要测试一下代理是否可用,这里橡皮擦用到了 IP 检测工具,发现 ipidea 提供的 IP 都是优质 IP,延迟很低,非常不错~

浏览器使用代理

如果你不是 Python 爬虫工程师,仅仅是选择一款代理工具,或者希望将代理应用到浏览器中,在这个代理服务平台上,也找到了相关教程,而且写的非常详细。

可以点击这里进行学习~

重点来了

在这个站点上发现了一个独有的产品:【IPIDEA 网页解锁器】,官网的描述是:

IPIDEA 专业技术研发“网页解锁工具”,实现网页爬虫技术可用率大于 99.99%。无需任何经验,只需轻点发送请求,就可获得准确的可用数据。

不说了,这么好用的功能,我先行一步,一起来吗?点击蓝色字体,收获一个稳定,高质量,高可用,可免费试用的代理 IP 平台!

以上是关于写Python爬虫又被屏蔽了,你现在需要一个稳定的代理IP的主要内容,如果未能解决你的问题,请参考以下文章