UbuntuTensorflow对训练后的模型做8位(uint8)量化转换

Posted 走召大爷

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了UbuntuTensorflow对训练后的模型做8位(uint8)量化转换相关的知识,希望对你有一定的参考价值。

最近看到一个巨牛的人工智能教程,分享一下给大家。教程不仅是零基础,通俗易懂,而且非常风趣幽默,像看小说一样!觉得太牛了,所以分享给大家。平时碎片时间可以当小说看,【点这里可以去膜拜一下大神的“小说”】。

1 量化为PB格式模型

从官方提供的tensorflow版本与编译工具版本中选择bazel版本下载,各个版本的Tensorflow与各个编译环境映射表如下。

| 版本 | Python 版本 | 编译器 | 编译工具 | cuDNN | CUDA |

|---|---|---|---|---|---|

| tensorflow_gpu-1.13.1 | 2.7 、3.3-3.6 | GCC 4.8 | Bazel 0.19.2 | 7.4 | 10.0 |

| tensorflow_gpu-1.12.0 | 2.7、3.3-3.6 | GCC 4.8 | Bazel 0.15.0 | 7 | 9 |

| tensorflow_gpu-1.11.0 | 2.7、3.3-3.6 | GCC 4.8 | Bazel 0.15.0 | 7 | 9 |

| tensorflow_gpu-1.10.0 | 2.7、3.3-3.6 | GCC 4.8 | Bazel 0.15.0 | 7 | 9 |

| tensorflow_gpu-1.9.0 | 2.7、3.3-3.6 | GCC 4.8 | Bazel 0.11.0 | 7 | 9 |

| tensorflow_gpu-1.8.0 | 2.7、3.3-3.6 | GCC 4.8 | Bazel 0.10.0 | 7 | 9 |

| tensorflow_gpu-1.7.0 | 2.7、3.3-3.6 | GCC 4.8 | Bazel 0.9.0 | 7 | 9 |

| tensorflow_gpu-1.6.0 | 2.7、3.3-3.6 | GCC 4.8 | Bazel 0.9.0 | 7 | 9 |

| tensorflow_gpu-1.5.0 | 2.7、3.3-3.6 | GCC 4.8 | Bazel 0.8.0 | 7 | 9 |

| tensorflow_gpu-1.4.0 | 2.7、3.3-3.6 | GCC 4.8 | Bazel 0.5.4 | 6 | 8 |

| tensorflow_gpu-1.3.0 | 2.7、3.3-3.6 | GCC 4.8 | Bazel 0.4.5 | 6 | 8 |

| tensorflow_gpu-1.2.0 | 2.7、3.3-3.6 | GCC 4.8 | Bazel 0.4.5 | 5.1 | 8 |

| tensorflow_gpu-1.1.0 | 2.7、3.3-3.6 | GCC 4.8 | Bazel 0.4.2 | 5.1 | 8 |

| tensorflow_gpu-1.0.0 | 2.7、3.3-3.6 | GCC 4.8 | Bazel 0.4.2 | 5.1 | 8 |

1.1 安装bazel

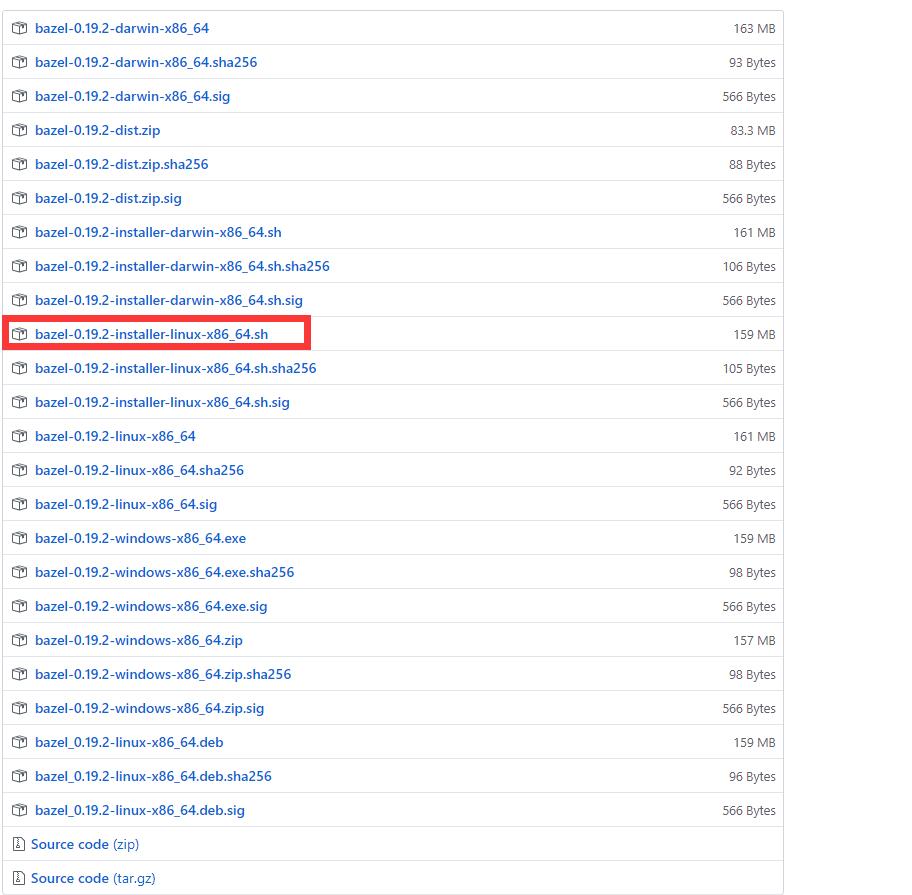

打开地址:【Bazel官网】阅读详细的安装步骤,从https://github.com/bazelbuild/bazel/releases/tag/0.19.2 下载0.19版本的bazel,这里我们在linux平台下安装,因此选择bazel-0.19.2-installer-linux-x86_64.sh 如下图所示

安装bazel:

# Step 1: Install required packages

sudo apt-get install pkg-config zip g++ zlib1g-dev unzip python3

# Step 2: Run the installer

chmod +x bazel-<version>-installer-linux-x86_64.sh

./bazel-0.19-installer-linux-x86_64.sh --user

# Step 3: Set up your environment

export PATH="$PATH:$HOME/bin"

# Step 4: Install the JDK

sudo apt-get install openjdk-8-jdk

安装过程中如果有以下异常:

bazel depends on google-jdk | java8-jdk | java8-sdk | oracle-java8-installer; however:

Package google-jdk is not installed.

Package java8-jdk is not installed.

Package java8-sdk is not installed.

Package oracle-java8-installer is not installed.

先输入java -version看java是否安装成功,如果没安装成功则重新安装java

如果java正常,则输入:sudo apt-get install -f

再安装bazel

1.2 下载Tensorflow源码

下载1.13版本Tensorflow源码:https://github.com/tensorflow/tensorflow/tree/v1.13.2

使用bazel编译tensorflow量化工具

bazel build tensorflow/tools/graph_transforms:transform_graph

1.3 执行转换量化命令

将导出的pb模型执行模型量化转换,以tensorflow_inception_graph.pb模型为例,命令如下:

bazel-bin/tensorflow/tools/graph_transforms/transform_graph \\

--in_graph=tensorflow_inception_graph.pb \\

--out_graph=optimized_inception_graph.pb \\

--inputs='Mul:0' \\

--outputs='softmax:0' \\

--transforms='

strip_unused_nodes(type=float, shape="1,299,299,3")

remove_nodes(op=Identity, op=CheckNumerics)

fold_old_batch_norms

'

2 量化为TFLite格式模型

除了使用transform_graph工具对pb模型进行量化转换外,还可以使用TFLite对模型进行量化处理,但是需要注意的是,使用TFLite转换得到的量化模型是tflite结构,意味着只能在tflite中运行(大部分场景为移动端),可以参考官网详细使用步骤:【https://www.tensorflow.org/lite/performance/post_training_quantization】

一个简单的示例如下:

import tensorflow as tf

converter = tf.lite.TFLiteConverter.from_saved_model(saved_model_dir)

converter.optimizations = [tf.lite.Optimize.OPTIMIZE_FOR_SIZE]

tflite_quant_model = converter.convert()

以上是关于UbuntuTensorflow对训练后的模型做8位(uint8)量化转换的主要内容,如果未能解决你的问题,请参考以下文章