都要2023年了,造机器人还能搞出什么新花活?

Posted QbitAl

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了都要2023年了,造机器人还能搞出什么新花活?相关的知识,希望对你有一定的参考价值。

衡宇 杨净 发自 凹非寺

量子位 | 公众号 QbitAI

机器狗、机器人领域,又多了一个新玩家。

以AI知名的科技公司科大讯飞,2022全球1024开发者节上官宣最新技术成果和进展。

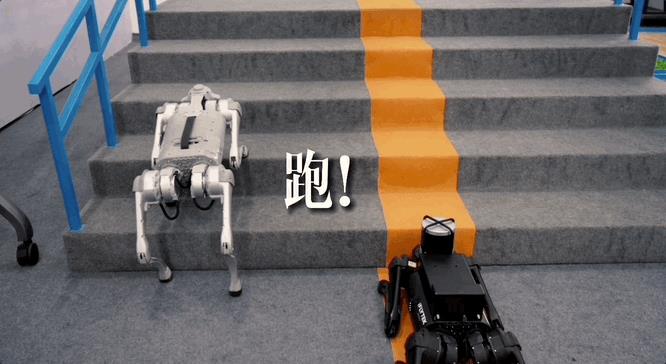

其中之一,就是“AI+四足机器人”项目,机器狗:小黑。

没错,科大讯飞也决定拥有一只机器狗,还是很新的那种:能沿着台阶进行上坡和下坡动作。

(现在的大多数机器狗还在“模仿动作”的初级仿生阶段,只具备基础的平地行走功能。)

决定养“狗”的互联网、AI公司越来越多了,现在认识一只机器狗,需要从厂牌开始分辨。

小黑的新,不仅在能力上,还在科大讯飞养它的方式上——

别人造机器狗,更多是在做硬件,训练它走路、陪伴。

科大讯飞造机器狗,更吸睛的故事,聚焦在训练“超脑”上。

机器人超脑平台

科大讯飞如何训?怎么训?现场小黑就来打了个样。

别看外表平平无奇,但一上阵就懂了。

常规操作自然就不多说了,自主导航上下坡,各种复杂地形也能穿梭自如,比如草地沙石玻璃路。

还可立即上岗上位,深入多个场景一线,完成检查乱堆乱放、车牌人脸识别、工厂故障巡检(化工、电力、工业)等任务。

通常而言,机器狗技术无非感知、控制决策两个方面,小黑也同样如此:

运动控制:AI+运动、自主导航、视频分析、自适应步态等算法。据官方介绍,他们率先打通了从仿真训练到真机部署的AI+运动智能的全链条开发。

感知:多模态多传感器融合。麦克风、喇叭、摄像、气体传感器等多传感器,通过混合式架构和中央决策平台 、多传感器底层核心算法,赋予机器狗识别听声辨味的感知能力。

这一切的一切,都是科大讯飞机器人超脑平台AIBOT所赋予的。于是当机器狗有了“脑”,从已曝光的能力提升中就可见一斑。

比如,实时地形自适应能力、全局定位搜索能力、地图构建能力以及AI运动控制能力。

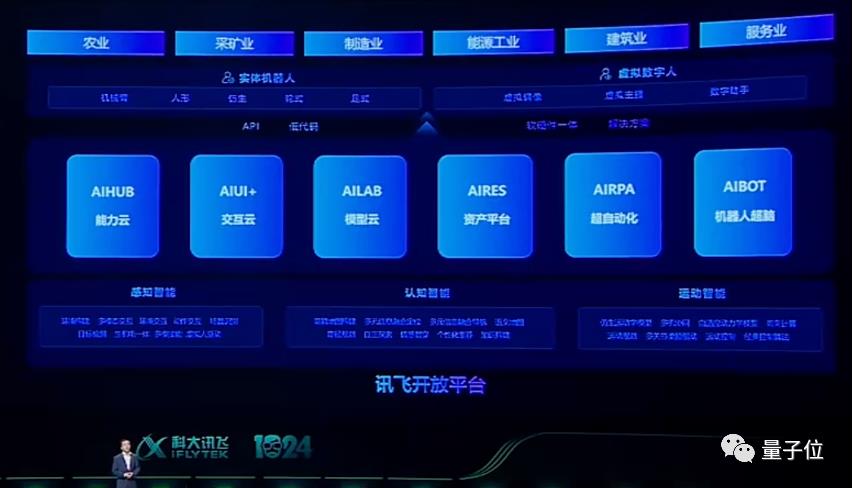

不过这也并不是机器人超脑平台AIBOT的全部用处。超脑平台也并非只是为了驯狗,而是由点及面,既有实体机器人又有数字机器人,在多个场景和行业下的软硬件一体解决方案。

目前,它已部署在了全新的讯飞开放平台上。从这张架构图中可以看到,现在讯飞开放平台核心能力主要包括:

能力云AIHUB、交互云AIUI+、模型云AILAB、资产平台AIRES、超自动化AIRPA、机器人超脑平台AIBOT。

小黑,正是讯飞机器人超脑平台AIBOT其中一个案例。通过交互大脑、运动控制、硬件模组来快速构建机器人的运动能力。机械臂、人形机器人、仿生、特种等各种机器人都可以适配。主要有三大特点:高性能、高效率、高精度。

高性能:8核CPU,NPU算力高达6TOPS;

高效率:一次建图覆盖率90%;

高精度:5cm的定位和建模精度。

在现场,科大讯飞消费者BG总裁于继栋还列举了柔性机械臂的例子,在赋予机器人超脑平台AIBOT之后,新增了AI+深度视觉、AI+运动控制等能力,从而能快速应用工业质检、商业服务、远程超声、柔性生产等场景当中去。

能力云AIHUB自然不必多说,AI公司立身之本,再联合生态AI能力,持续保证稳定输出,今年更是给出了全系列的离线版本。

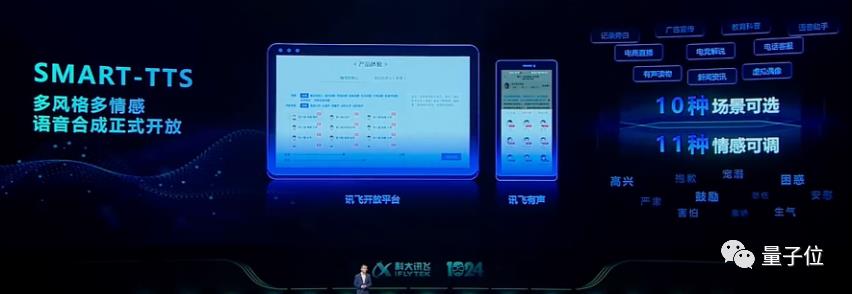

在今年更新的513项开放能力中,以SMART-TTS ,多风格多功能语音合成最为典型。

以往语音合成主要用于语音助理和新闻播报这些场景,但这次在风格、场景以及情感上有了新拓展,共有10个场景可选、11种情感可调。

交互云AIUI+。不管是虚实哪一种机器人,在与人交互时都面临着公共场景下的干扰问题。典型的难题场景包括同向人声干扰,而本身以语音见长的科大讯飞,提出了远近场多模语音增强技术,在同向人声干扰环境下,识别准确率从60.2%到现在提升到了86%以上。

模型云AILAB ,具体场景具体定制。像格式多样、数据稀缺还是价格敏感的情况,都能为其提供小样本训练平台。5张图片训练出OCR定制模型,半小时音频生成商用发音人、零成本搭建唤醒词,了解一下~

而聚焦于数字世界的生态上。资产平台AIRES,顾名思义就是与内容伙伴共建数字资产,比如虚拟人形象、数字藏品等。超自动化AIRPA则是在解决企业的数字化转型,包括智能化员工助手、柔性人机协同、跨组织无边界协作……

最终,这些能力都透过实体机器人、数字虚拟人两种形式逐步深入到各个行业与家庭当中。

这也正是科大讯飞对AI新趋势的理解。

当下随着元宇宙兴起,融合AI与5G,虚拟世界与现实世界实现了深层次融合,人机协同逐渐人机共生的阶段。

机器人,就是其中关键的载体。

基于这样的逻辑,机器人超脑平台AIBOT,依托混合式架构、中央决策平台、多传感器融合,构建端侧超脑,让机器人产品在感知智能、认知智能和运动智能得到多维度的提升,也就成为了科大讯飞交出的第一份答卷。

确切的来说,是科大讯飞整个超脑2030计划的第一步:

更快实现让“懂知识、善学习、能进化”的机器人走进每个家庭。基于超脑2030计划,以API、低代码、软硬件一体、解决方案等方式,面向实体机器人和数字机器人建设N种场景化机器人,赋能工业、农业、服务业、特种行业,连接产业生态,共建行业场景。

“超脑2030计划 ”第一步,跨出多大步子?

早在今年1月,这个计划就已经启动,核心是利用AI解决未来社会的刚需问题,如教育、人口老龄化等。

其第一阶段目标,就是在2023年前,推出可养成的机器宠物、仿生运动机器狗等软硬件一体的机器人,同期推出专业数字虚拟人家族,担当老师、医生等角色。

该计划的最终目标,是推出懂知识、会学习的陪伴机器人和自主学习虚拟人家族,全面进入家庭。

而现在,AI技术推动四足机器狗小黑从异宠向工具狗迈了一步。

值得注意的是,机器人超脑平台的背后支撑,不仅让更多企业在工业级运用中可以无粮养狗,更多的室内和户外场景中,实体机器人都在拓展人的能力边界。

高精度的细活、繁重枯燥的累活、危险易受伤的险活……

机器人、机械臂,上!

人机协同之外,在人机交互阶段,AI已经在发挥日益重要的作用。

科大讯飞在背后提供技术与生态来支撑,率先证明了这一点。

实现超脑2030计划需要哪些关键技术突破?科大讯飞AI研究院副院长高建清公开了相关信息。

第一,需要以深度学习(Deep Learning)为代表的AI基础算法的突破。

在诸多AI基础算法中,无监督学习和知识推理是两个亟待突破的关键算法。

1024开发者节当天,科大讯飞发布了两个轻量级预训练模型:语音及多模态预训练模型。这两个模型的参数量远小于业界公开的模型,但效果却达到了业界最优,推广性也很好。

整个2022年,科大讯飞有三项知识推理任务取得不错的成绩,尤其在面向特定领域的知识推理方面,机器水平已经在今年7月首次超过人类水平。

此外,知识推理的另一个重要研究方向,也就是如何实现推理过程的可解释性,科大讯飞将传统符号推理系统与深度强化学习相结合,得出一套在类人答题领域正确率显著优于传统推理系统的框架。

第二,是引领人机交互发展方向的多模态感知技术、多维表达技术、认知智能技术。

拿多模态感知技术举个具体例子来说,通常,语音识别的高准确率,不代表识别出的文字合理、流畅。

科大讯飞基于多元语义评价的语音识别一体化框架,使用语义纠错任务与语音识别联合优化,让语音识别保持高准确率的同时,提高识别后文字的可读性。

第三,需要研究软硬一体的机器人关键技术,加大AI算法与运动控制的结合,让机器人具备精细的运动控制能力。

具体的技术展示,已经体现在小黑爬坡上坎的功夫中了。

除此之外,科大讯飞还整合工程能力,形成虚拟人交互平台、机器人超脑平台,探索数字虚拟人、机器人等方面的应用。

现场,高建清展示了科大讯飞打造的一个裸眼3D场景下的高沉浸式人机交互。

而关于生态支撑这一点,在今年的开发者节上,科大讯飞董事长刘庆峰拿数据说话。

首先,是讯飞开放平台在过去一年的发展情况——

讯飞开放平台开放的AI产品及能力,从去年441项增长至今年513项;

生态伙伴数从400万快速增长到超500万,年增长率超30%;

AI服务调用年增长率达到36%;

输入法语音调用量同比增长45%,Z世代群体平均语音输入次数达到61次,是整体语音用户的2倍。

接下来,看看刘庆峰披露出的过去一年内,讯飞生态的其它数据。

其一,是虚拟人交互平台资产增加。

一方面,科大讯飞基于AI虚拟人交互平台,开放平台合作伙伴生态。

发布一年后,虚拟人设计队伍共468支,建设了700项虚拟人资产。

其次,刚刚结束的双11“混战”,带来了最新消费者数据:科大讯飞销售额同比增长32%。

最受追捧的当属本就是“老夺冠人”的AI办公产品,智能办公本、智能录音笔和翻译机产品,拿下京东和天猫所在品类销售额冠军。

一些办公硬件,比如办公本、会议耳机、翻译机,年增长率均近或超100%。

综合多个数据,不难看出AI生态已经渗入各行各业,为生活和工业场景所熟用。

给出这一份综合答卷,刘庆峰表示,随着发展深入,AI在感知能力、理解能力、表达能力、运动能力方方面面,都需要承担更大的任务。

一个属于未来的时代正在快速开启。

当数字经济更深层次赋能实体经济时,人工智能承担了更大的任务。

这需要一个更强大的“头号玩家”。

科大讯飞如何理解人机协同

2020年,科大讯飞发布了AI科技树,强调“以基础算法为主干,以技术体系为生长方向,以场景理解为发展动力”。

2022年,在超脑2030计划的牵引下,科大讯飞的AI科技树不断壮大。

既有以基础算法为代表的主干发展,也有各技术体系的不断外拓延伸。

作为AI技术落地的一种表现形式,人机协同已然崛起。

人机协同的目的是改善工作流程,途径是让人和机器进行工作和经验的交流。

机器可以根据人类提供的信息,按步骤和流程执行作业;人类再在机器产出的成果上,锦上添花。

二者各做彼此的擅长事,实现人类和机器的价值最大化。

而整场大会听下来,从整合多项技术的机器人超脑平台窥见一隅,不难梳理出科大讯飞对人机协同的理解。

共分三个维度:

在物理世界,实体机器人拓展人的能力边界。

具体而言,轮足机器人应用于餐饮服务、物资运输等场景;弈棋机器人可以满足围棋教学、训练和娱乐领域的多种需求。

在数字世界,数字工作助手助力工作提效;

据悉,2022年,讯飞AI虚拟人已在医疗、金融、媒体、文旅等多个行业上岗,亮相两会、北京冬奥会、世界人工智能大会等多个场合。

在元宇宙,虚拟人成为人的交互载体。

通过这三个维度,技术将和个人与企业深度联结,多模感知、深度理解、多维表达都将个性化展开。

在这个过程中,科大讯飞带给生活的技术支撑和生态积累,是看得见、摸得着、用得上的。

“人机关系,已经在从单点技术的浅层人机协同,向更深层次、更为复杂的人机发展。”刘庆峰如是说。

而且这种人机关系,即将进入可见、可感、可触碰的人机关系。这也是另一个维度上,AI和智能,正在如何影响和参与实体经济。

— 完 —

点这里👇关注我,记得标星哦~

以上是关于都要2023年了,造机器人还能搞出什么新花活?的主要内容,如果未能解决你的问题,请参考以下文章