MIT健身神器:穿上就能“透视”肌肉,发力情况看得一清二楚,动作标准度提升15%...

Posted QbitAl

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了MIT健身神器:穿上就能“透视”肌肉,发力情况看得一清二楚,动作标准度提升15%...相关的知识,希望对你有一定的参考价值。

Alex 发自 凹非寺

量子位 | 公众号 QbitAI

各位健身发烧友们!是否曾为自己动作做得不够标准而苦恼?

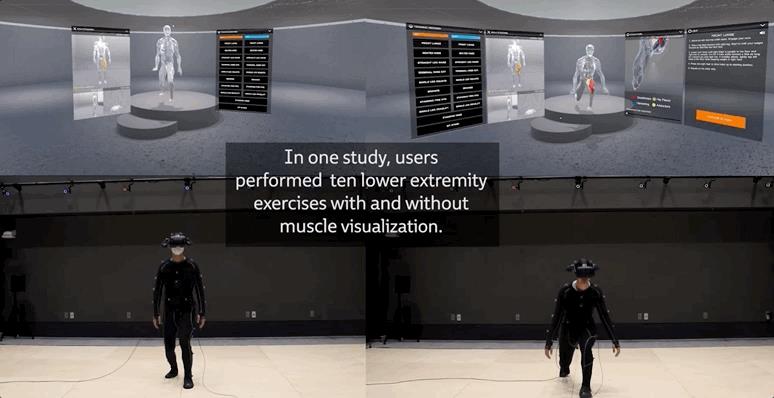

这不,麻省理工大学的技术人员们搞出了一套“VR头显+忍者式跟踪服”装备:

穿上这套炫酷的装备后再运动,你不仅能像照镜子一样看到自己动作,甚至能一清二楚地看到自己肌肉的发力情况。

另外,这个系统里还有虚拟教练,可以给出专业的建议来帮你调整姿势。

MIT的研究者称,穿上这套装备后,大伙儿做动作的整体准确性提高了15%。(还是很明显了)

而且这些可视化数据除了可以给穿戴者本人看之外,还能传给专业治疗师,来帮助患者更规范地运动恢复。

相关论文已被美国计算机学会的顶级论坛UIST(用户界面软件与技术研讨会)收录。

精确追踪三维运动数据

其实运动传感技术已经不是最新鲜的事儿了,不过现有技术主要侧重于跟踪行为和心率。

一般来说,肌电图(EMG)只能捕捉到皮肤下的肌肉活动;但MIT的研究者们认为,还有更好的方法来全方位追踪人体三维运动情况。

于是他们最终搞出了这套看起来很炫酷的无监督运动装备系统:MuscleRehab。

该系统主要由三部分构成:

VR头显和追踪服

高精度光学运动捕捉系统

EIT(电阻抗断层扫描)传感技术

首先来说说该系统的“大脑”:EIT。

通过EIT技术,可以比较精确地追踪肌肉的伸缩情况,并将其可视化。

其原理是将电极固定在人皮肤的表面,用电极注入电流并测量产生的电压,重新构建身体的内部电导率图像。

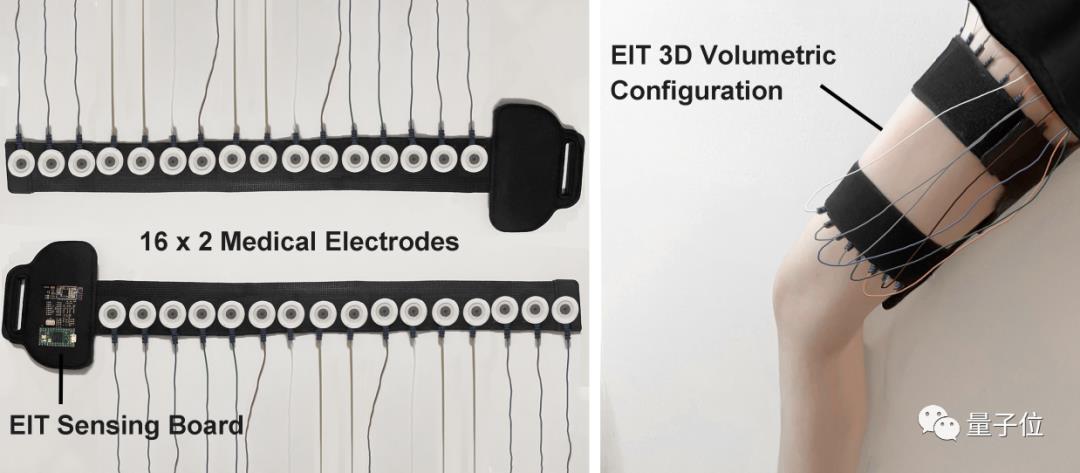

在本项目中,为了构建出足够清晰的大腿部的EIT图像,研究人员设计了2个电极阵列,每个阵列有16个医疗电极。

这些电极被贴到人的大腿上,再通过电缆将其连接到EIT传感器。

EIT就先说到这儿。这里再来讲讲该系统中的另外一个重要角色:光学动捕系统。

该系统采用了OptiTrack(一家动捕技术供应商)的29台摄像机,每秒能感知到超高的帧率(250帧/秒)。

而且研究者们还在追踪衣上安排了39个光学跟踪标记,使得设备能够更精确地追踪人体运动。

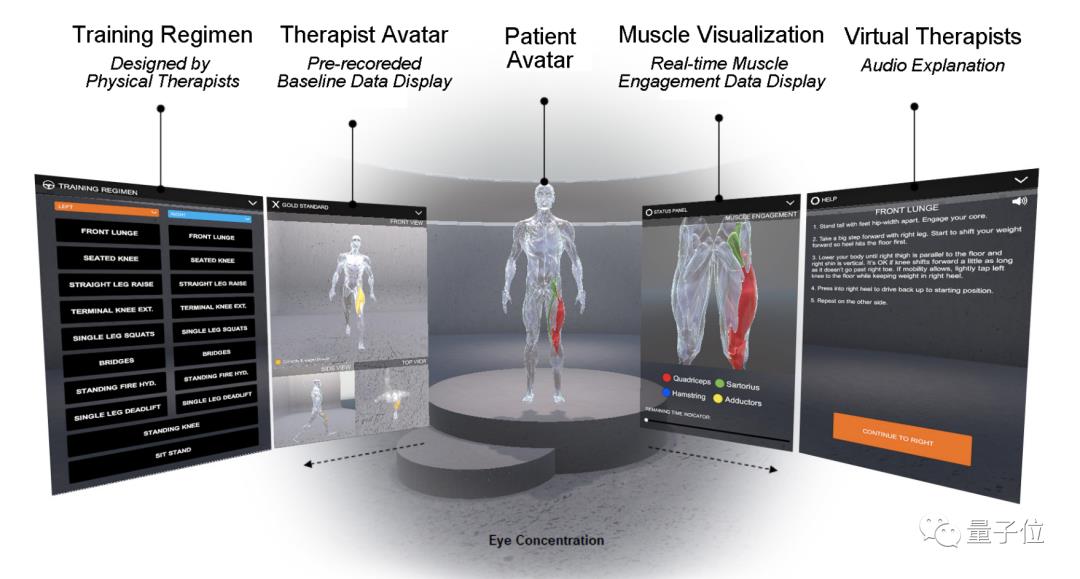

现在,把这套高精度的光学动捕系统和EIT技术结合起来,再加上VR头显,用户就能看到自己运动时肌肉的紧张和松弛情况了。

而且还是有特写图的那种!

△用户界面:红黄蓝绿四种颜色分别代表不同的肌肉群,颜色越深表示肌肉参与程度越高。

值得一提的是,这里并没使用传统的VR手柄,而是通过VR头显上的传感器来捕获并追踪用户的眼球和头部的活动,从而实现交互。

结果表明,在人们眼前展示肌肉紧绷和舒展的情况,确实可以提高其运动准确程度:

穿上这套装备志愿者们,做动作准确性整体提高了15%。

研究团队简介

这套装备是由MIT的人工智能实验室CSAIL、美国东北大学和马萨储塞州总医院的科研人员共同设计开发出来的。

论文一作朱均逸,本科毕业于华盛顿大学电子和计算机工程系,现为麻省理工学院CSAIL的计算机科学博士研究生。

他目前的主要研究方向为人机交互、个人制造工具和新型传感技术。

对了,关于本研究量子位之前做了个有趣的视频:

论文地址:

https://dl.acm.org/doi/abs/10.1145/3526113.3545705

参考链接:

https://news.mit.edu/2022/mit-system-sees-inner-structure-body-during-physical-rehab-1011

— 完 —

「AIGC系列直播 - 应用落地与商业化」直播报名

技术热潮之外,AIGC如何实际落地?又如何长期商业变现?

11月3-4日晚7点到8点,量子位智库联手国内头部AIGC企业及投资机构,为你解答,扫码预约~

点这里关注我 👇 记得标星噢 ~

以上是关于MIT健身神器:穿上就能“透视”肌肉,发力情况看得一清二楚,动作标准度提升15%...的主要内容,如果未能解决你的问题,请参考以下文章

自动驾驶频频「现身」国际盛会,是“定点发力”还是“纯秀肌肉”?