知识索引李宏毅机器学习

Posted BkbK-

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了知识索引李宏毅机器学习相关的知识,希望对你有一定的参考价值。

李宏毅机器学习知识索引

本文为【李宏毅机器学习】知识索引

文章目录

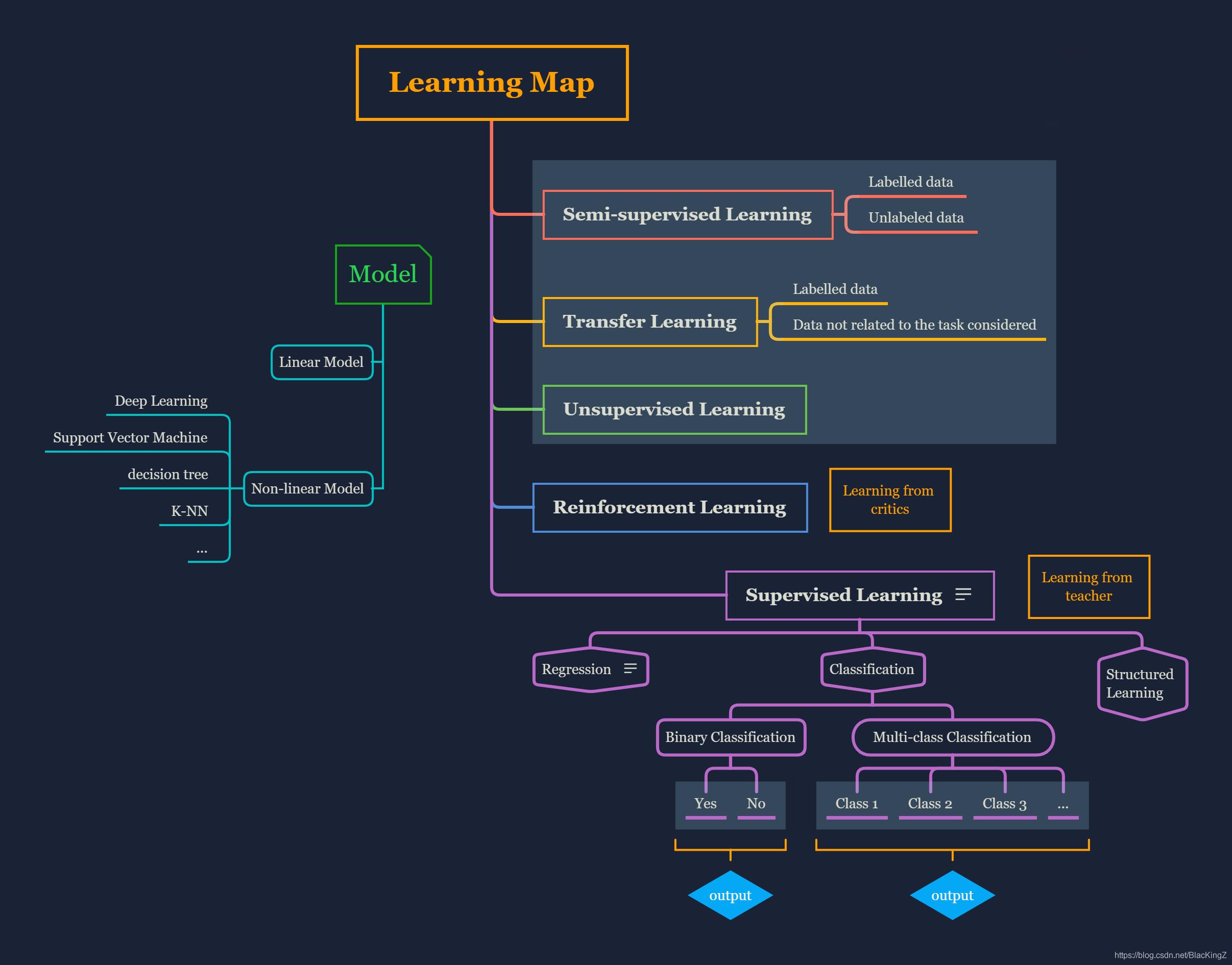

1.【李宏毅机器学习】01:机器学习介绍 Introduction

【李宏毅机器学习】01:机器学习介绍 Introduction

- 一、机器学习步骤

- 二、机器学习框架

- 三、机器学习学习地图

- 四、总结

2.【李宏毅机器学习】02:回归Regression

- 一、回归(Regression)的定义

- 1.Regression: Output a scalar

- 2.Example of Regression

- 二、回归的实现(机器学习的步骤)

- Step 1: define a set of function - Linear Model

- Step 2: goodness of function - Loss Function

- Step 3: pick the best function - Gradient Descent

- 三、回归的优化

- 1.Select another model 选择另一个模型

- 2.Consider the hidden factors 考虑其他隐藏因素

- 3.Regularization 正则化

3.【李宏毅机器学习】03:误差Error

-

一、Bias & Variance 偏差和方差

- 1.误差的来源

- 2.偏差和方差的理解

- 3.偏差和方差出现的原因

- 4.模型的偏差和方差

-

二、What to do with error 误差的处理

- Bias v.s. Variance 偏差和方差对比

- 1.Large bias - underfitting偏差大 - 欠拟合

- 2.Large variance - Overfitting 方差大 - 过拟合

-

三、Model Selection模型的选择

- 1.Cross Validation 交叉验证

- 2.K-fold Cross Validation k折交叉验证

4.【李宏毅机器学习】04:梯度下降Gradient Descent

李宏毅机器学习04:梯度下降Gradient Descent

- 一、梯度下降方法

- 二、梯度下降的改进方法

- Tip 1: Tuning your learning rates 调整学习率

- Tip 2: Stochastic Gradient Descent 随机梯度下降

- Tip 3: Feature Scaling 特征缩放

- 三、Gradient Descent Theory梯度下降的数学理论

- 四、梯度下降的限制

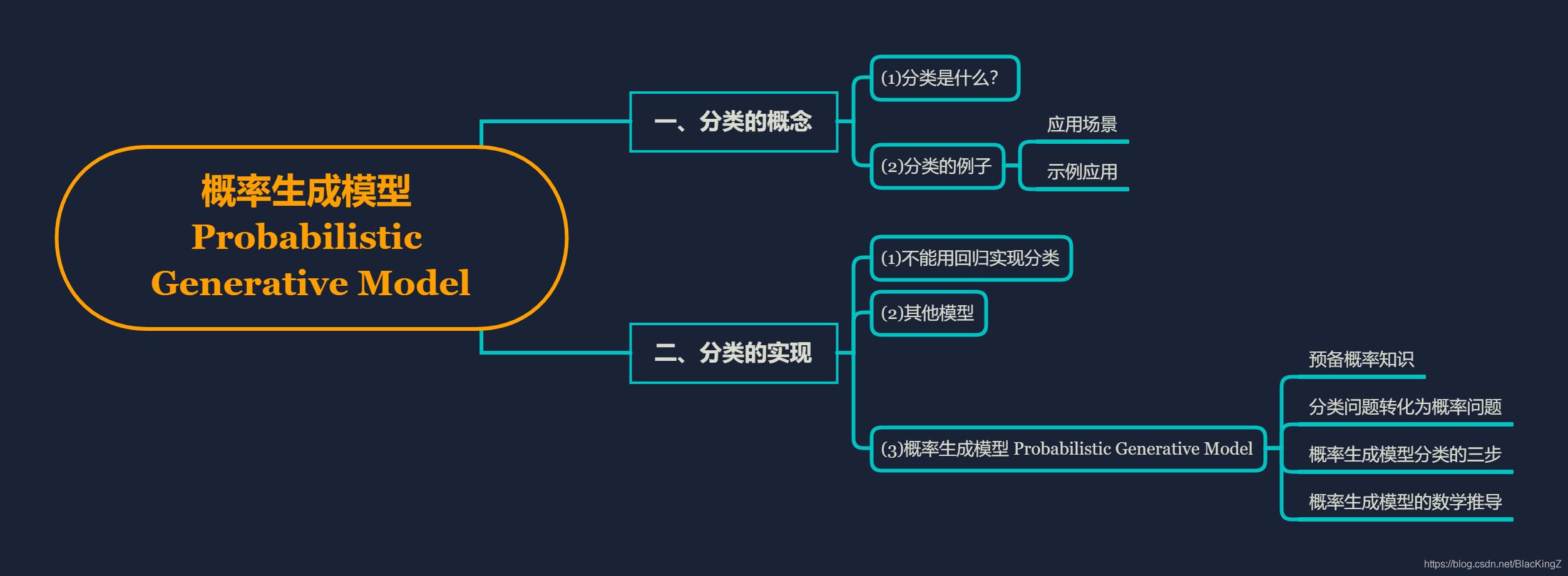

5.【李宏毅机器学习】05:概率生成模型Probabilistic Generative Model

【李宏毅机器学习】05:概率生成模型Probabilistic Generative Model

- 一、分类

Classification的概念 - 二、分类

Classification的实现- (1)不能用回归实现分类

- (2)其他模型

- (3)概率生成模型 Probabilistic Generative Model

- 1.预备概率知识

- 2.分类问题转化为概率问题

- 3.总结概率生成模型的三步

- 4.概率生成模型的数学推导

(未完待续…)

与50位技术专家面对面

与50位技术专家面对面

20年技术见证,附赠技术全景图

20年技术见证,附赠技术全景图

以上是关于知识索引李宏毅机器学习的主要内容,如果未能解决你的问题,请参考以下文章