多模态 Generalized Visual Language Models

Posted Charmve

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了多模态 Generalized Visual Language Models相关的知识,希望对你有一定的参考价值。

点击上方“迈微AI研习社”,选择“星标★”公众号

重磅干货,第一时间送达

多年来,人们一直在研究处理图像以生成文本,例如图像字幕和视觉问答。传统上,此类系统依赖对象检测网络作为视觉编码器来捕获视觉特征,然后通过文本解码器生成文本。鉴于现有的大量文献,在这篇文章中,我想只关注解决视觉语言任务的一种方法,即扩展预训练的通用语言模型以能够消费视觉信号。

我将此类视觉语言模型 (VLM) 大致分为四个类别:

将图像转换为可以与令牌嵌入联合训练的嵌入特征。

学习可以作为冻结的、预先训练的语言模型的前缀的良好图像嵌入。

使用专门设计的交叉注意机制将视觉信息融合到语言模型的各个层中。

无需任何培训即可结合视觉和语言模型。

图文联合训练

将视觉信息融合到语言模型中的一种直接方法是将图像视为普通文本标记,并在文本和图像的一系列联合表示上训练模型。准确地说,图像被分成多个较小的块,每个块在输入序列中被视为一个“标记”。

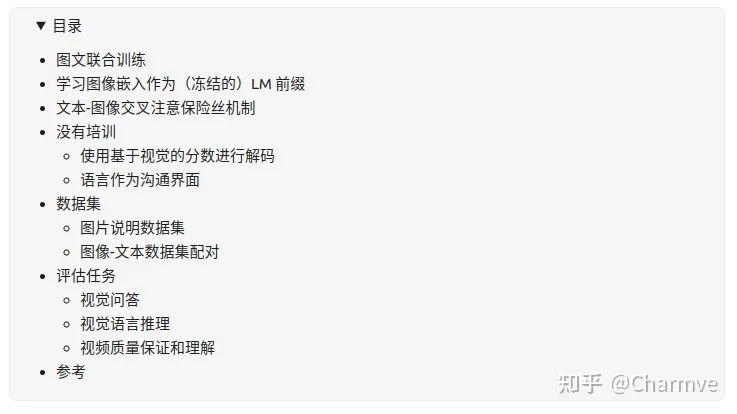

VisualBERT ( Li et al. 2019 ) 将文本输入和图像区域都输入到BERT中,以便能够通过自注意机制发现图像和文本之间的内部对齐。

与BERT 中的文本嵌入类似,VisualBERT 中的每个视觉嵌入也总结了三种嵌入,标记化特征Fo, 分割嵌入FsFs和位置嵌入Fp,准确地说:

Fo是由卷积神经网络为图像的边界区域计算的视觉特征向量;

Fs是一个段嵌入,用于指示嵌入是否用于视觉而不是文本;

Fp是用于对齐边界区域顺序的位置嵌入。

该模型在 MS COCO 图像标题数据集上进行训练,文本和图像作为输入来预测文本标题,使用两个基于视觉的语言模型目标:

传销与图像。该模型需要预测被屏蔽的文本标记,而图像嵌入总是不被屏蔽。

句子图像预测。当提供一张图片和两个相关的标题时,两个标题中的一个可能是一个随机不相关的标题,概率为 50%。要求模型区分这两种情况。

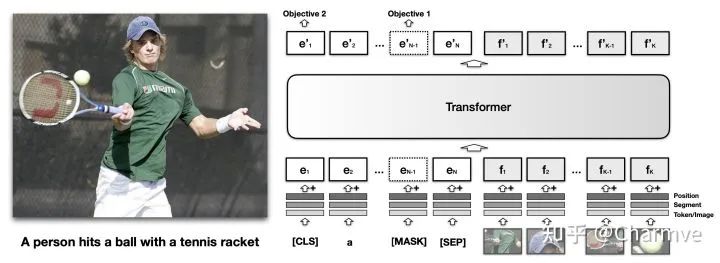

根据消融实验,最重要的配置是在早期将视觉信息融合到转换器层中,并在 COCO 字幕数据集上预训练模型。从预训练的 BERT 初始化和采用句子图像预测训练目标的影响相对较小。

VisualBERT 当时在 NLVR 和 Flickr30K 上的表现优于 SoTA,但在 VQA 上与 SoTA 仍有一些性能差距。

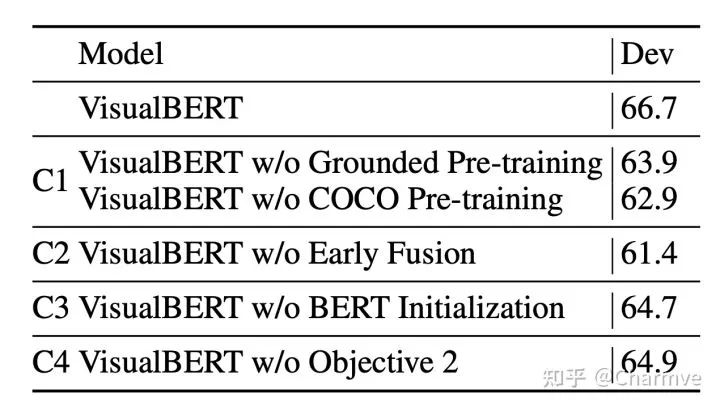

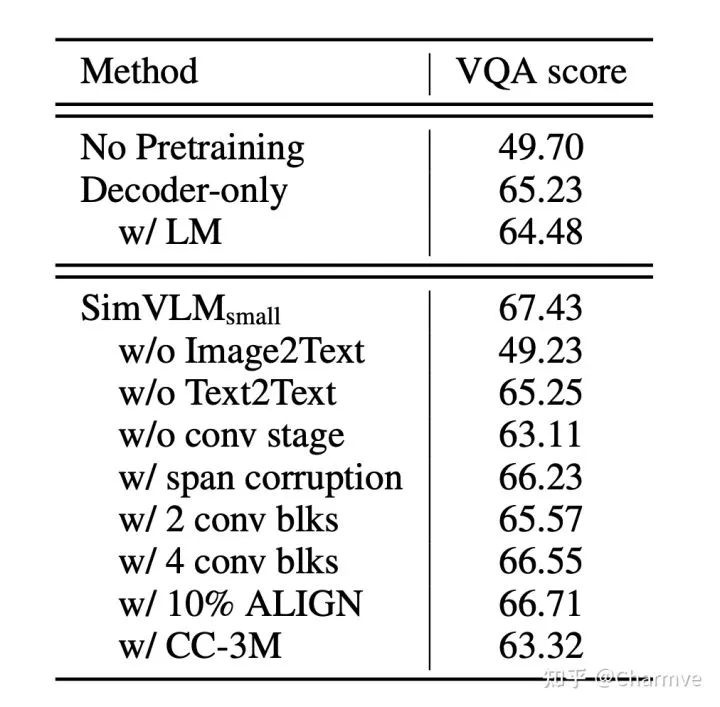

SimVLM (Simple Visual Language Model; Wang et al. 2022 ) 是一个简单的前缀语言模型,其中前缀序列像 BERT 一样使用双向注意力进行处理,但主输入序列像GPT一样只有因果注意力。图像被编码为前缀标记,这样模型就可以充分利用视觉信息,然后以自回归方式生成相关文本。

受ViT和CoAtNet的启发,SimVLM 将图像分割成更小的块,形成扁平的 1D 块序列。他们使用由 ResNet 的前 3 个块组成的卷积阶段来提取上下文补丁,并且发现这种设置比简单的线性投影效果更好。

SimVLM 的训练数据由来自 ALIGN ( Jia et al. 2021 )的大量图像-文本对和来自 C4 数据集的纯文本数据 ( Raffel et al. 2019 ) 组成。他们在每批中混合了两个预训练数据集,包含 4,096 个图像-文本对 (ALIGN) 和 512 个纯文本文档 (C4)。

根据消融研究,重要的是同时拥有图像文本和纯文本数据进行训练。PrefixLM 目标优于跨度损坏和幼稚 LM。

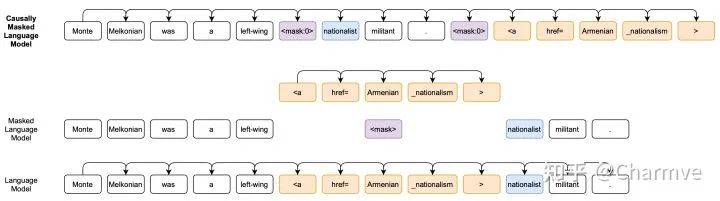

CM3 (Causally-Masked Multimodal Modeling; Aghajanyan, et al. 2022 ) 是一种超文本语言模型,学习生成 CC-NEWS 和维基百科文章的大型 html 网页的内容(超文本标记、超链接和图像)。生成的 CM3 模型可以生成丰富的结构化、多模态输出,同时以任意掩码文档上下文为条件。

在架构方面,CM3 是一个自回归模型。然而,为了结合因果和屏蔽语言建模,CM3 还屏蔽了少量长标记跨度,并尝试在序列末尾生成它们。

CM3 的训练数据集包含接近 1T 的 Web 数据。在预处理过程中,首先下载图像src并将其大小调整为 256 x 256,并进行随机裁剪。然后它们由VQVAE-GAN进行标记,每张图像产生 256 个标记。这些用空格连接的标记被插入回src属性中。

CM3 可用于通过提示工程完成多种类型的任务:

图像填充:

Infilling Prompt: <img src="prefix<mask:0>postfix"><mask:0>条件图像填充:

Conditional Infilling Prompt:

<img alt="Photo: text" src="prefix<mask:0>postfix"><mask:0>条件图像生成:

Conditional Generation Prompt: <img alt="prompt图片说明:

Captioning Masked Prompt #1:

<img alt="Photo: A photo taken of<mask:0>" src="image">

Captioning Causal Prompt #1:

<img src="image" title="Photo: A photo taken of实体消歧

Original: Manetho writes that these kings ruled from <a title="Memphis, Egypt">Memphis</a>

Prompt: Manetho writes that these kings ruled from <a title="<mask:0>">Memphis</a>...<mask:0>

Target: Manetho writes that these kings ruled from <a title="<mask:0>">Memphis</a>...<mask:0> Memphis, Egypt学习图像嵌入作为(冻结的)LM 前缀

如果我们不想在调整语言模型参数来处理视觉信号时改变它怎么办?相反,我们学习了一个与语言模型兼容的图像嵌入空间。

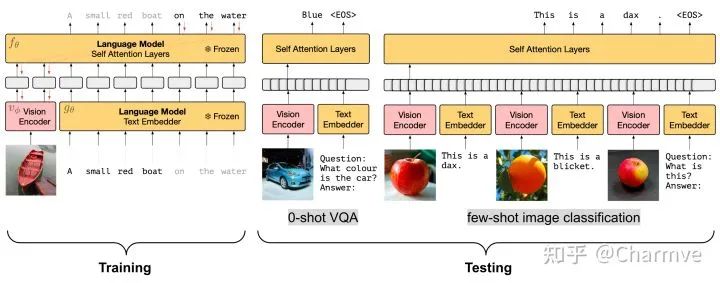

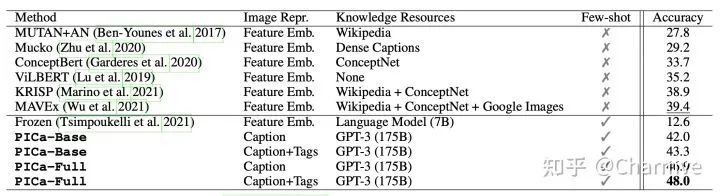

受前缀或提示 调整的启发,Frozen ( Tsimpoukelli et al. 2021 ) 和ClipCap ( Mokady, Hertz & Hertz, 2021 ) 都只在训练期间更新视觉模块的参数,以生成可以使用预训练的冻结语言的图像嵌入模型。两者都使用对齐的图像标题数据集进行训练根据图像和先前的文本标记生成标题中的下一个文本标记。通过冻结 LM 参数保留了强大的语言能力。此外,即使这样的设置是用有限的图像字幕数据训练的,它们也可以在测试时依赖语言模型的百科全书知识。

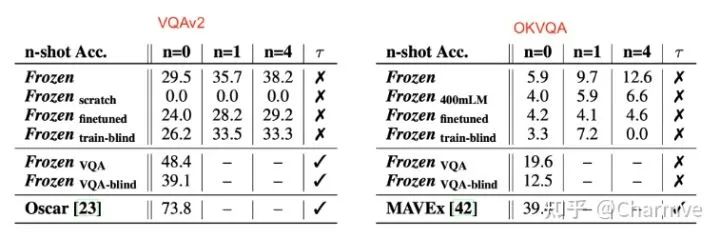

Frozen 的视觉编码器基于 NF-ResNet-50,使用全局池化层后 NF-Resnet 的最终输出向量。Frozen VLM 可用作多模型少样本学习器,以适应测试时的新任务,以使用一系列交错的图像和文本进行零样本或少样本传输。

实验表明,有趣地微调预训练的 LM 会导致 VQA 任务的性能更差。从预训练版本初始化语言模型很重要,因为从头开始训练(Frozen_scratch) 没有显示任何有意义的进展。基线Frozen_scratch使图像变黑,但由于预先训练的 LM 的先天力量,仍然可以获得不错的性能。

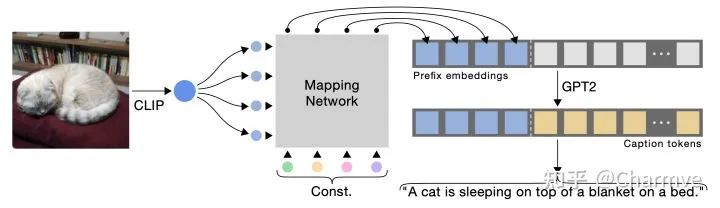

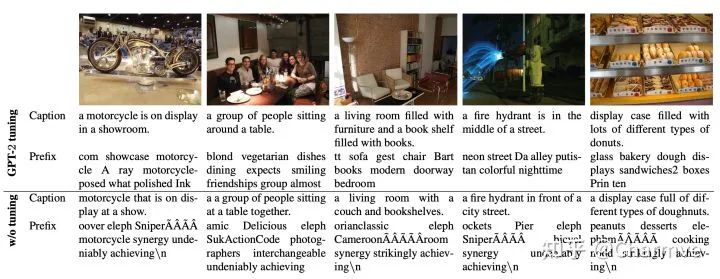

ClipCap 依赖CLIP ( Radford et al. 2021 ) 进行视觉编码,但需要通过光照映射网络进行处理F这样图像嵌入向量就被翻译成与预训练的 LM 相同的语义空间。网络FF将 CLIP 嵌入映射到一系列ķķ嵌入向量,每个向量与 GPT2 中的词嵌入具有相同的维度。增加前缀大小ķķ有助于提高性能。CLIP 视觉编码器和 LM在训练期间都被冻结,只有映射网络FF是学习的。他们发现当LM被冷冻时,F应该是一个transformer,有8个multi-head self-attention层,每个有8个head,但是当LM可以微调的时候,一个MLP就足够了。

尽管 ClipCap 只训练了这么少的参数集,但它在图像字幕任务上仍然取得了不错的性能,与当时的 SoTA 相当(例如Oscar、VLP、BUTD)。因此,他们假设“CLIP 空间已经封装了所需的信息,并且将其调整为特定的样式并不能提高灵活性。”

有趣的事实是——因为 ClipCap 将 CLIP 图像嵌入转换为 LM 空间,处理后的前缀甚至可以解释为单词。

文本-图像交叉注意保险丝机制

为了更有效地将视觉信息融合到语言模型的不同层中,我们可以考虑专门设计的交叉注意力融合机制来平衡文本生成能力和视觉信息的混合。

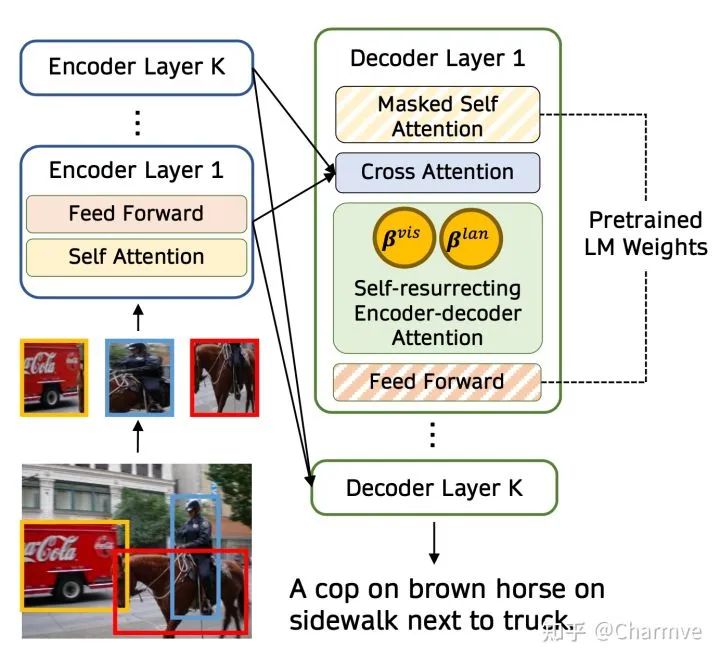

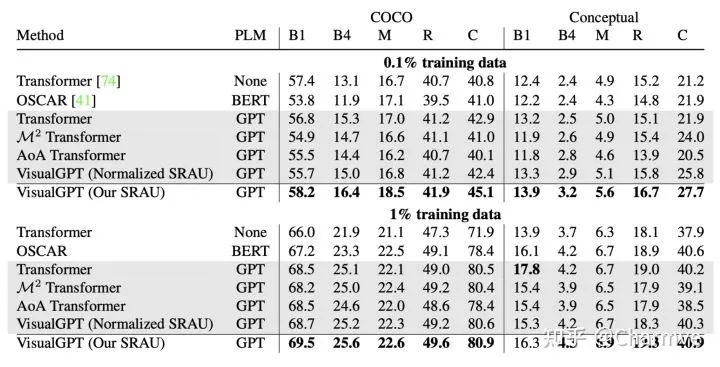

VisualGPT ( Chen et al. 2021 ) 采用自我复活的编码器-解码器注意机制,以使用少量域内图像文本数据快速适应预训练的 LM。

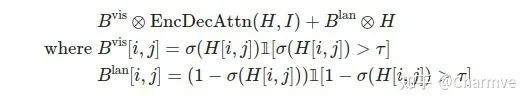

让I是视觉编码器的输出,并且HH是LM解码器的隐藏状态。VisualGPT 引入了一个自我复活激活单元 (SRAU) 来控制预训练语言信息的混合之间的权衡HH和视觉组件,EncDecAttn(H,I)通过两个互补门Bvis 和 Blan:

其中,⊗是逐元素乘法和[i,j]表示矩阵中的一个元素。t是一个预定义的阈值超参数。

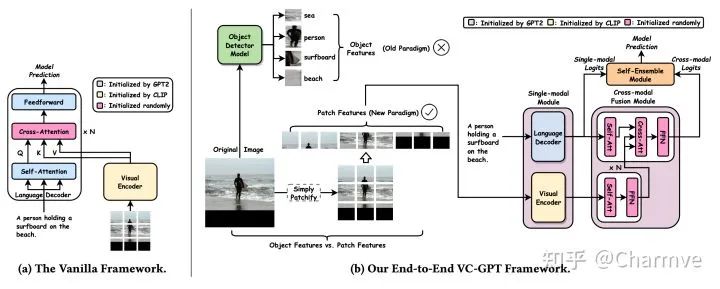

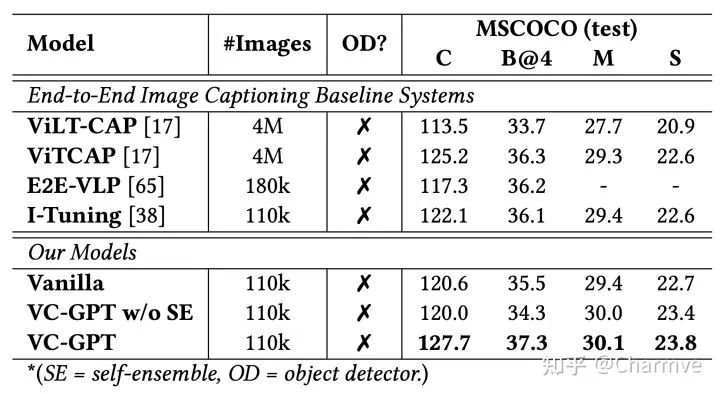

VC-GPT (Visual Conditioned GPT; Luo et al. 2022 ) 结合了一个预训练的视觉转换器 (CLIP-ViT) 作为视觉编码器和一个预训练的 LM 作为语言解码器。

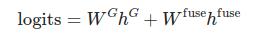

CLIP-ViT 将一系列图像补丁作为每个补丁的输入和输出表示。为了避免灾难性的遗忘,VC-GPT 没有将视觉信息直接注入 GPT2,而是在视觉编码器和语言解码器的输出之上引入了额外的交叉注意力层。然后一个自集成模块线性组合单个模型语言解码器 logitsH_G和跨模型视觉语言融合模块 logitsH_fuse. 自集成模块(参见图 13 中的“VC-GPT w/o SE”)对性能很重要。

其中,WG是语言解码器的线性投影,由 GPT2 的词嵌入矩阵初始化,W保险丝W保险丝是融合模块的线性投影,随机初始化。

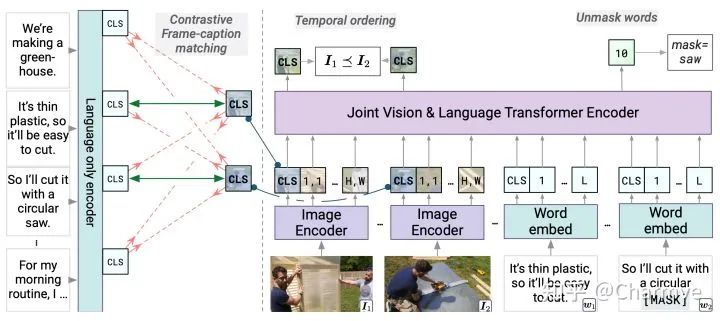

MERLOT ( Zellers, et al. 2021 ) 使用 600 万个带有转录语音 ( YT-Temporal-180M ) 的 YouTube 视频进行训练,以学习空间(帧级)和时间(视频级)目标,并在 VQA 上表现出强大的性能微调后的视觉推理任务。

每个视频V被分成多个段s_t, 每个段s_t包含图像帧It从中间时间步中提取和L=32相关单词的标记。图像由学习的图像编码器编码,单词使用学习的嵌入编码。然后两者都在一个联合的视觉语言转换器中一起编码。

MERLOT有3个学习目标:

掩码语言建模(MLM) 非常有用,尤其是因为在视频中,人们往往会漫无目的,从而导致许多重复的关键字或填充词。

对比帧字幕匹配使用来自联合视觉语言转换器的仅语言部分。每帧的匹配表示I_t和标题w_t被视为正例,而负例来自小批量中的所有其他帧-字幕对。

时间重新排序学习时间推理:随机打乱一世一世帧并用随机且唯一的位置嵌入替换段级位置嵌入。学习了随机位置嵌入,允许模型以正确排序的帧为条件对这些“'shuffled'”帧进行打乱。损失是预测是否t_i<t_j或者t_j<t_i对于每个帧帧对。

消融研究表明,(1)在视频而不是图像上进行训练,(2)扩大训练数据集的大小和多样性以及(3)使用不同的目标来鼓励全栈多模态推理是很重要的。

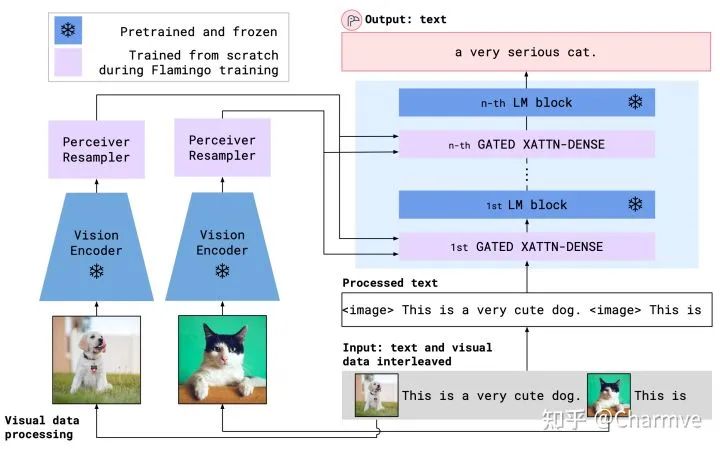

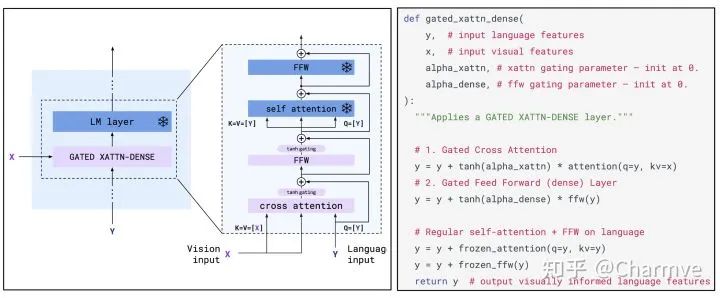

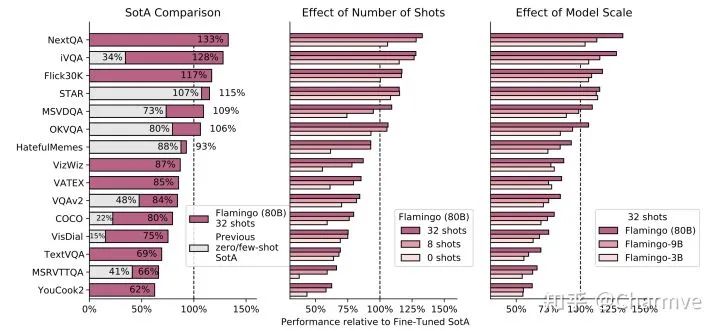

Flamingo ( Alayrac et al. 2022 ) 是一种视觉语言模型,它接受与图像/视频交错的文本并输出自由格式的文本。Flamingo 通过基于转换器的映射器连接预训练的 LM 和预训练的视觉编码器(即 CLIP 图像编码器)。为了更有效地整合视觉信号,Flamingo 采用基于Perceiver的架构,从大量视觉输入特征中生成数百个标记,然后使用与 LM 层交错的交叉注意力层将视觉信息融合到语言解码中过程。训练目标是自回归的 NLL 损失。

感知器重采样器从图像/视频输入的视觉编码器接收时空特征,以产生固定大小的视觉标记。

冻结的 LM 配备了新初始化的交叉注意力层,交错在预训练的 LM 层之间。因此,LM 可以生成以上述视觉标记为条件的文本。

与 ClipCap 类似,两个预训练模型在训练期间都被冻结,因此 Flamingo 只被训练为将现有的、强大的语言和视觉模型和谐地连接在一起。ClipCap 和 Flamingo 的主要区别在于前者将图像嵌入视为 LM 的简单前缀,而后者使用门控交叉注意力密集层来融合图像信息。此外,Flamingo 比 ClipCap 包含更多的训练数据。

为了轻松处理带有交错图像的文本,Flamingo 中的遮罩设计使得文本标记只交叉参与对应于前一个图像的视觉标记,从而大大减少了某个文本标记可以看到的视觉标记的数量。他们发现这比允许文本标记直接处理所有先前的图像效果更好。文本仍然可以关注所有先前的图像,因为文本编码器中存在因果自注意依赖性。这种设计可以处理上下文中任意数量的图像。

他们从 Internet 上抓取了 4300 万个网页,名为 MultiModal MassiveWeb (M3W) 数据集,其中包含带有交错图像的文本。此外,Flamingo 还在成对的图像/文本和视频/文本数据集上进行训练,包括ALIGN、LTIP 和 VTP。

互联网数据集的数据处理包括:

输入网页文本通过

<image>在视觉输入位置插入标记以及特殊标记<BOS>(句子开头)和<EOC>(块结尾;始终位于文档末尾,在任何图像标记之前)来处理。从每个文档中,他们抽取一个随机子序列L=256代币并占用ñ=5采样序列中包含的图像(仅使用第一个ñ如果有更多,或者填充到该采样子序列中ñ如果更少)

一个函数φ:[1,L]→[0,ñ]计算以跟踪文本和图像的交错顺序,该顺序为每个文本位置分配出现在该位置之前的最后一个图像/视频的索引;如果没有先前的视觉数据,则为 0。

由于 Flamingo 是在三个不同数据集的混合上进行训练的,因此它针对特定于数据集的 NLL 损失的加权和进行了优化。调整数据集权重对于最终性能非常重要。在实践中,他们实际上不是在数据集之间进行循环,而是从每个数据集中采样一批,并在每次更新中应用这些梯度的加权和。跨不同异构数据集的梯度累积可以被视为稳定训练的一种手段,因为它减少了每次更新之间的梯度方差。

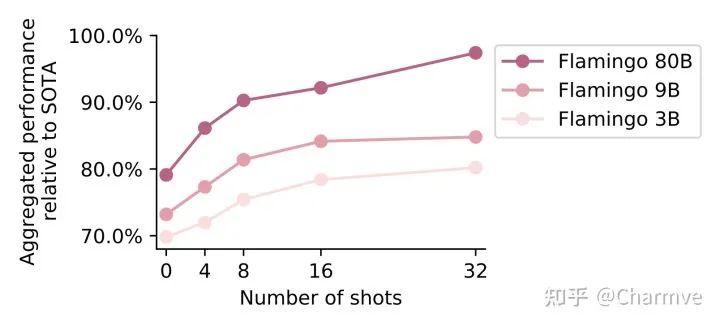

在测试时,Flamingo 自然支持小样本学习,因为它可以处理任何交错的文本和图像序列。上下文中的更多示例有助于提高性能。

Flamingo 在 16 项任务中有 6 项的性能优于 SoTA 微调模型,即使没有使用任何微调但仅使用少量提示。微调 Flamingo 的成本很高,而且很难进行超参数调优,但它确实会带来更好的结果。

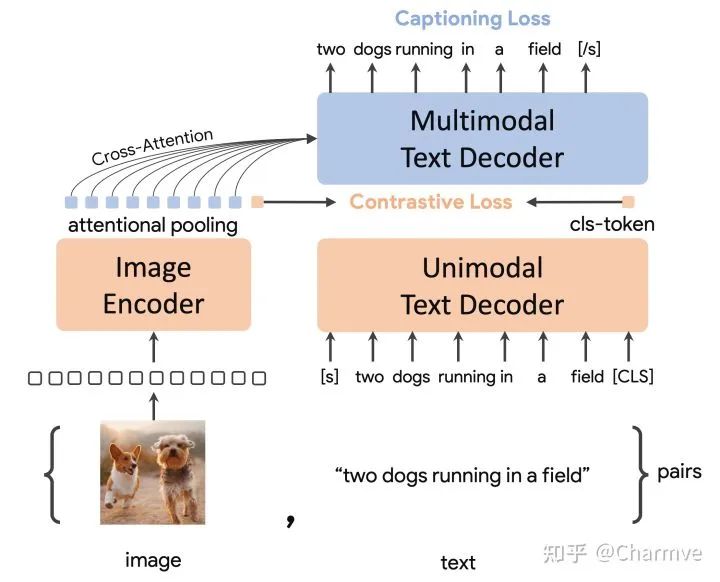

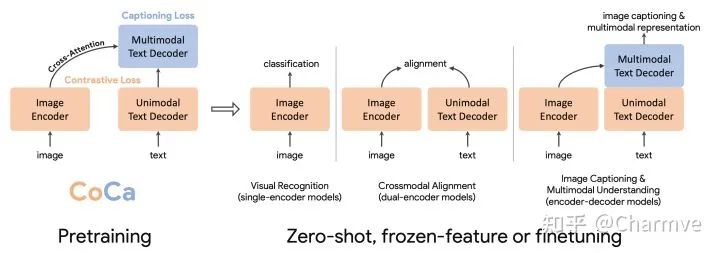

CoCa (Contrastive Captioner; Yu & Wang et al., 2022 ) 捕捉了对比学习和图像到字幕生成的优点。它是一个联合训练的模型,在 CLIP 样式表示上具有对比损失,在图像字幕上具有生成损失,在各种多模态评估任务上实现了 SoTA 零样本迁移。

CoCa 是从头开始预训练的,使用网络规模的替代文本数据对齐和注释图像,将所有标签视为JTB-3B中的文本。

CoCa 中有两个主要的培训内容。最终损失是以下两个损失的加权和,权重标量lcap=2.0,lcon=1.0

.:

Lcon- 双编码器对比学习优化对称对比学习损失,类似于 CLIP。

Lcap编码器-解码器字幕使解码器通过优化自回归损失,根据来自图像编码器的潜在编码特征预测字幕。文本解码器被解耦为两个组件,单模态和多模态;一个很好的平衡是将这两个组件的解码器分成两半:

底部的单峰组件使用因果屏蔽的自我注意对输入文本进行编码。

顶部的多模态组件将因果屏蔽的自我注意和交叉注意应用于视觉编码器的输出。

CoCa 的性能优于仅对比模型,并且与 VQA 上的仅字幕模型相当。发现字幕损失也有利于零样本分类能力。

他们使用特定于任务的注意力池或注意力池作为自然的任务适配器,因为他们发现单个池化图像嵌入有助于视觉识别任务(例如 ImageNet 分类),而更细粒度的嵌入有助于多模态理解任务(例如VQA)。池化器是一个单一的多头注意力层,具有n询问 可学习的查询(注意X∈RL×d,Wq∈Rd×dq, 和dķ=dq),编码器输出作为键和值。CoCa 在生成性损失的预训练中使用注意力池n_query=256和对比损失n_query=1. 这使模型能够作为冻结编码器获得强大的性能,我们只学习一个新的池化器来聚合特征。

没有培训

最后,可以通过将预训练的语言和视觉模型拼接在一起来解决视觉语言任务,而无需训练任何额外的参数。

使用基于视觉的分数进行解码

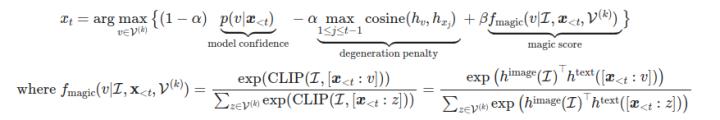

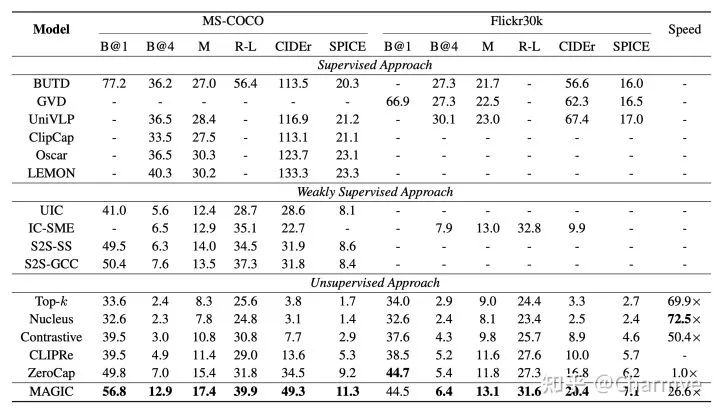

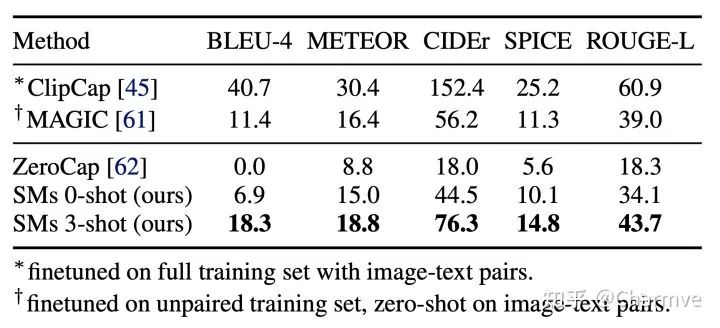

MAGiC (iMAge-Guided text generation with CLIP; Su et al. 2022 )根据名为魔术分数的基于 CLIP 的分数进行指导解码,以对下一个令牌进行采样,无需微调。鼓励生成的文本与给定的图像相关,同时仍与先前生成的文本保持一致。

下一个令牌Xt在一个时间步吨吨根据以下等式选择。添加了模型置信度和退化惩罚 ( Su et al. 2022 ) 以避免来自 LM 的损坏生成。

其中,I是输入图像;V(ķ)包含顶部-ķ语言模型预测的可能标记p;X<t指时间步之前过去生成的令牌t;Hv是令牌的表示v由 LM 计算,条件是X<t和v;H_image(.)和H_text(.)分别是由 CLIP 图像和文本编码器生成的嵌入。

与其他无监督方法相比,MAGiC 具有不错的性能,但与有监督方法仍有很大差距。

语言作为沟通界面

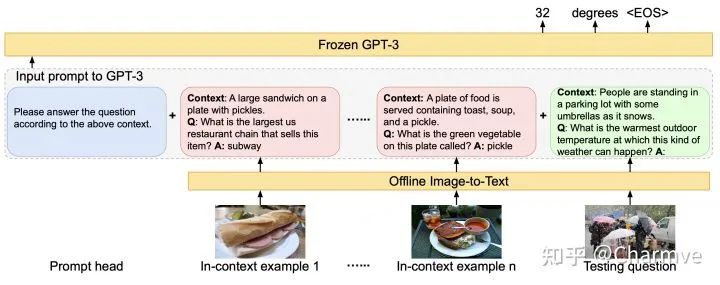

对于基于知识的 VQA 任务,PICa(通过使用 Image Captions 提示 GPT-3;Yang et al. 2021)首先将图像转换为标题或标签,然后使用少样本示例提示 GPT3 提供答案。图片说明或标签由一些现有模型(例如VinVL)或 Azure Tagging API 提取。GPT3 被认为是一个非结构化的、隐含的知识库。

PICa 探索了两种方法来改进少样本示例以获得更好的结果:

上下文示例是根据它们与使用 CLIP 嵌入的问题的相似程度来选择的。

Multi-query ensembling就是多次提示模型得到多个答案,选择logprob最高的那个。

这种只有 16 个示例的简单方法将 OK-VQA 上的 SoTA 提高了 +8.6 分,并在 VQAv2 上获得了不错的性能。

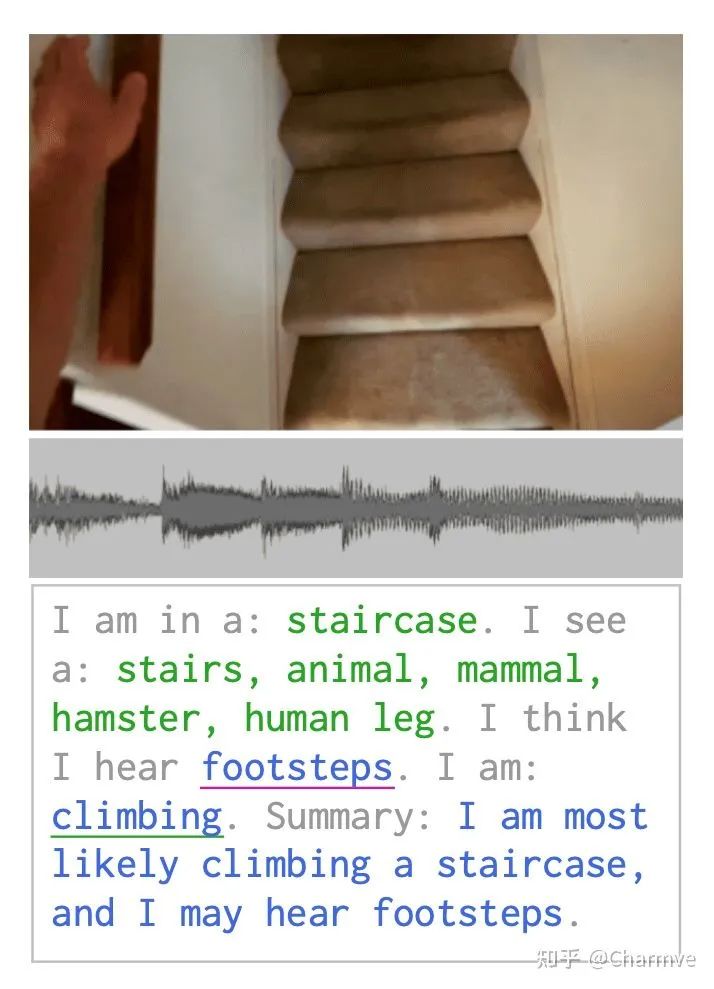

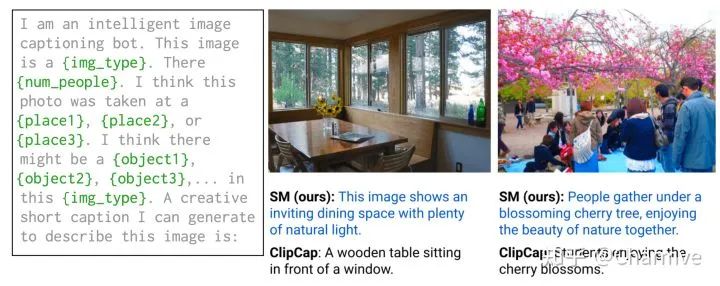

苏格拉底模型(SM) ( Zeng et al. 2022 ) 是一种框架,可通过语言(提示)将不同模态的多个预训练模型组合成一个模型,而无需进一步训练。在这里,语言被认为是不同模型可以交换信息的中间表示。关键思想是使用多模型多模态提示,将非语言模型的输出插入到语言提示中,然后用于 LM 进行推理。

让我们看一个具体的例子。给定一个以自我为中心的视频(图像 + 音频),SM 可以使用文本到文本 LM、图像到文本 VLM和语音到文本 ALM生成个人活动的摘要。它们的链接如下:

VLM 检测视觉实体;

LM 表示可以听到的声音;

ALM 选择最可能的声音;

LM 建议可能的活动;

VLM 对最有可能的活动进行排名;

LM 生成苏格拉底互动的摘要。

SM 可以通过首先使用 VLM 对不同的地点类别、物体类别、图像类型和人数进行零样本预测来生成图像说明;然后将 VLM 填充的语言提示输入因果 LM 以生成候选字幕。Socratic 方法在图像字幕上与 ClipCap 仍有性能差距,但由于它不涉及任何训练,因此相当不错。

SM 框架非常灵活,可以用于除图像说明之外的更复杂的任务。例如,以自我为中心的感知(用户输入 + VLM + LM + ALM)任务是以自我为中心的视频作为输入,以(1)总结内容;(2) 回答自由形式的推理问题;(3) 并进行预测。

数据集

图片说明数据集

MS COCO ( Chen et al. 2015 ):包含 328K 图像,每张图像与 5 个独立的标题配对。

NoCaps ( Agrawal et al., 2019 ) 旨在衡量对看不见的类和概念的泛化,其中域内包含仅描绘 COCO 类的图像,近域包含 COCO 和新类,域外仅包含小说类。

概念字幕( Sharma et al. 2018 ) 包含 300 万对图像和字幕,从网络上挖掘并经过后处理。为了专注于概念,此数据集中的特定实体被替换为一般概念(例如,政治家的名字被替换为“政治家”)

交叉字幕 (CxC) ( Parekh et al. 2021 ) 包含 247,315 个人工标记的注释,包括图像对、字幕对和图像-字幕对之间的正负关联。

Concadia ( Kreiss et al. 2021 ) 是一个基于 Wikipedia 的数据集,包含 96,918 张图像以及相应的英语描述、标题和周围环境。

图像-文本数据集配对

(*) 不是公共数据集。

ALIGN ( Jia et al., 2021 ) 包含 18 亿张带有 alt-text 的图像。数据集很大但噪声很大,只有基于频率的过滤最少。

(*) LTIP(长文本和图像对;Alayrac 等人,2022 年):3.12 亿张图像,搭配描述性标题。

(*) VTP(视频和文本对;Alayrac 等人,2022 年):2700 万个短视频(平均约 22 秒),搭配描述性字幕。

(*) JFT-300M / JFT-3B是 Google 内部数据集,包含 300M / 3B 图像,通过半自动管道用大约 30k 个标签的类层次结构进行注释。因此,数据和相关标签是嘈杂的。

评估任务

视觉问答

给定一个图像和一个问题,任务是正确回答问题。

VQAv2 ( Goyal et al., 2017 ) 包含 1+ 百万个关于来自 COCO 的 200K 图像的问题。

OK-VQA ( Marino et al. 2019 ) 包含 14K 需要外部知识的开放式问题(例如来自维基百科)。

A-OKVQA:OK-VQA 的扩展后继者,没有与 OK-VAQ 重叠的问题。

TextVQA ( Singh, et al. 2019 ) 包含 45,336 个问题,涉及 28,408 张图像,需要对文本进行推理才能回答。

VizWiz ( Gurari, et al. 2018 ) 包含来自盲人的 31,000 多个视觉问题,每个盲人都使用手机拍照并记录一个关于它的口头问题,以及每个视觉问题的 10 个众包答案。

视觉语言推理

VCR(Visual Commonsense Reasoning;Zellers et al. 2018)包含来自 110k 电影场景的 290k 多项选择 QA 问题,重点是视觉常识。

NLVR2 (Natural Language for Visual Reasoning; Suhr et al. 2019 ) 包含 100k+ 个与网络图像配对的句子示例,任务是确定自然语言标题是否适用于一对图像,重点是语义多样性。

Flickr30K ( Jia et al. 2015 ) 包含从 Flickr 收集的 30k 图像和 250k 注释,任务是选择给定句子跨度的边界区域。

SNLI-VE (Visual Entailment; Xie et al. 2019 ) 建立在 SNLI 和 Flickr30K 之上,任务是推理图像前提和文本假设之间的关系。

视频质量保证和理解

MSR-VTT(MSR Video to Text;Xu et al. 2016)包含 10K 网络视频剪辑,总共 41.2 小时和 200K 剪辑-句子对;任务是将视频翻译成文本。

ActivityNet-QA ( Yu et al. 2019 ) 在来自流行的ActivityNet数据集的 5,800 个视频中包含 58,000 个人工注释的 QA 对。

TGIF (Tumblr GIF; Li et al. .2016 ) 包含 100K 动画 GIF 和 120K 描述动画 GIF 视觉内容的句子,随机选择的帖子于 2015 年 5 月至 6 月在 Tumblr 上发布。

TGIF-QA包含来自 TGIF 数据集的动画 GIF 的 165K QA 对。

LSMDC (Large Scale Movie Description Challenge; Rohrbach et al. 2015 ) 包含从 202 部电影中提取的 118,081 个短视频片段。每个视频都有一个字幕,可以从电影剧本中提取,也可以从为视障人士转录的 DVS(描述性视频服务)中提取。

TVQA ( Lei et al. 2018 ) / TVQA+ ( Lei et al. 2019 ) 是基于 6 个热门电视节目(老友记、生活大爆炸、老爸老妈的浪漫史、House MD、实习医生格蕾)的大规模视频 QA 数据集,城堡)。它包含来自 21.8K 视频剪辑的 152.5K QA 对,跨越超过 460 小时的视频。

DramaQA ( Choi et al. 2020 ) 是基于韩国热门电视节目“Another Miss Oh”的大规模视频 QA 数据集。该数据集包含四个级别的 QA 难度和多级以角色为中心的故事描述。

VLEP(视频和语言事件预测;Lei 等人,2020 年)包含来自 10,234 个不同的电视节目和 YouTube Lifestyle Vlog 视频剪辑的 28,726 个未来事件预测示例(及其基本原理)。

参考

[1] Li et al. “VisualBERT: A Simple and Performant Baseline for Vision and Language." arXiv preprint:1908.03557 (2019).

[2] Wang et al. “SimVLM: Simple Visual Language Model Pretraining with Weak Supervision." ICLR 2022.

[3] Aghajanyan, et al. “CM3: A Causal Masked Multimodal Model of the Internet." arXiv preprint arXiv: 2201.07520 (2022).

[4] Tsimpoukelli et al. “Multimodal Few-Shot Learning with Frozen Language Models." NeuriPS 2021.

[5] Mokady, Hertz & Hertz. “ClipCap: CLIP Prefix for Image Captioning." 2021.

[6] Chen et al. “VisualGPT: Data-efficient Adaptation of Pretrained Language Models for Image Captioning." arXiv preprint arXiv:2111.09734 (2021).

[7] Luo et al. “A Frustratingly Simple Approach for End-to-End Image Captioning." arXiv preprint arXiv:2201.12723 (2022).

[8] Zellers et al. “MERLOT: Multimodal neural script knowledge models." NeuriPS 2021.

[9] Alayrac et al. “Flamingo: a Visual Language Model for Few-Shot Learning." arXiv preprint arXiv:2204.14198 (2022).

[10] Yu & Wang et al. “CoCa: Contrastive Captioners are Image-Text Foundation Models." arXiv preprint arXiv:2205.01917 (2022).

[11] Yang et al. “An Empirical Study of GPT-3 for Few-Shot Knowledge-Based VQA." arXiv preprint arXiv:2109.05014 (2021).

[12] Su et al. “Language models can see: Plugging visual controls in text generation." arXiv preprint arXiv:2205.02655 (2022).

[13] Zeng et al. “Socratic Models: Composing Zero-Shot Multimodal Reasoning with Language." arXiv preprint arXiv:2204.00598 (2022).

--- END ---

后台回复“电子书”、“PyTorch” 获取资料包 加群 —> CV 微信技术交流群

绘图神器下载

后台回复:绘图神器,即可下载绘制神经网络结构的神器!

PyTorch 学习资料下载

后台回复:PyTorch资料,即可下载访问最全的PyTorch入门和实战资料!

我的专栏

专栏订阅:https://blog.csdn.net/charmve/category_10595130.html迈微AI学术交流群(知识星球)来了!想要了解最新最快最好的CV/DL/ML论文

速递、优质开源项目、学习教程和实战训练等资料,

欢迎扫描下方二维码,加入CVer学术交流群,已汇集数千人!

▲扫码进群

迈微AI研习社

微信号: MaiweiE_com

GitHub: @Charmve

CSDN、知乎: @Charmve

投稿: yidazhang1@gmail.com

主页: github.com/Charmve

整理不易,请点赞和在看

以上是关于多模态 Generalized Visual Language Models的主要内容,如果未能解决你的问题,请参考以下文章

多模态最强综述,浅显易懂娓娓道来 Generalized Visual Language Models