中文词频统计

Posted 202帅哥天团

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了中文词频统计相关的知识,希望对你有一定的参考价值。

下载一长篇中文文章。

从文件读取待分析文本。

news = open(\'gzccnews.txt\',\'r\',encoding = \'utf-8\')

安装与使用jieba进行中文分词。

pip install jieba

import jieba

list(jieba.lcut(news))

生成词频统计

排序

排除语法型词汇,代词、冠词、连词

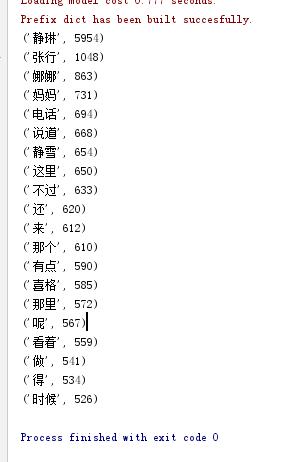

输出词频最大TOP20

import jieba

f=open(\'好吗.txt\',\'r\')

notes=f.read()

notelist=list(jieba.lcut(notes))

NoteDic={}

for i in set(notelist): #计算次数

NoteDic[i]=notelist.count(i)

delete_word={\'的\',\' \',\'你\',\';\', \'\\u3000\', \'这\', \'就\', \'说\', \'皆\', \'没有\', \'自己\', \'走\',\',\',\'。\',\':\',\'“\',\'”\',\'看到\',\'\',\'?\',\'着\',\'想\',\\

\'操\',\'遂\',\'与\',\'不\',\'是\',\'、\',\'这个\',\'和\',\'!\', \'\\n\',\'…\',\'?\',\'什么\',\'吗\',\'好\',\'现在\',\'知道\',\'知道\',\'一个\',\'吧\',\'看\',\'想着\',\'真的\',\\

\'很\',\'了\',\'我\',\'在\',\'也\',\'有\',\'人\',\'去\',\'.\',\'他\',\'都\',\'把\',\'样子\',\'上\',\'事\',\'给\',\'她\',\'要\',\'不是\',\'就是\',\'会\'}

for i in delete_word: #删除非法词汇

if i in NoteDic:

del NoteDic[i]

sort_word = sorted(NoteDic.items(), key= lambda d:d[1], reverse = True) # 由大到小排序

for i in range(20): #输出词频Top20

print(sort_word[i])

以上是关于中文词频统计的主要内容,如果未能解决你的问题,请参考以下文章