吴恩达机器学习学习笔记——代价函数

Posted JJJanepp

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了吴恩达机器学习学习笔记——代价函数相关的知识,希望对你有一定的参考价值。

单变量线性回归函数 hθ(x) = θ0 + θ1x

为了使线性回归函数对数据有较好的预测性,即y(i)到hθ(x(i)) 的距离都很小。

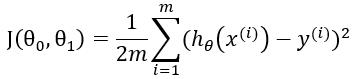

故构造代价函数,也称平均误差公式:

上式中m为训练集样本数量,用平方代替绝对值,再将所有样本点求和再求平均

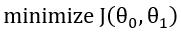

最佳θ0,θ1满足下式:

以上是关于吴恩达机器学习学习笔记——代价函数的主要内容,如果未能解决你的问题,请参考以下文章