《Image Generation with PixelCNN Decoders》论文笔记

Posted punkcure

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了《Image Generation with PixelCNN Decoders》论文笔记相关的知识,希望对你有一定的参考价值。

论文背景:Google Deepmind团队于2016发表在NIPS上的文章

motivation:提出新的image generation model based on pixelCNN[1]架构。可以为任意输入vector结合标签生成图片,在先验信息的前提下加入条件分布信息

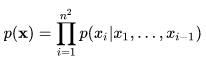

模型关键:根据链式条件概率,逐行生成,逐像素点生成

相对于GAN的优势:

- GAN只善于处理连续数据,pixelCNN对连续数据和非连续数据都能很好perform

- 链式likelihood表达

可以比GAN更好的提供生成目标的评价系统,虽然也不尽完美

可以比GAN更好的提供生成目标的评价系统,虽然也不尽完美

相对于GAN的劣势:

2. sample quality明显不如GAN。

1.Aaron van den Oord, Nal Kalchbrenner, and Koray Kavukcuoglu. Pixel recurrent neural networks. arXiv

preprint arXiv:1601.06759, 2016.

以上是关于《Image Generation with PixelCNN Decoders》论文笔记的主要内容,如果未能解决你的问题,请参考以下文章

GLIDE: Towards Photorealistic Image Generation and Editing with Text-Guided Diffusion Models

论文阅读-Hierarchical Cross-Modal Talking Face Generation with Dynamic Pixel-Wise Loss

从Image Caption Generation理解深度学习

论文阅读 | Adversarial Example Generation with Syntactically Controlled Paraphrase Networks

使用-MM生成include指令和依赖生成(make include directive and dependency generation with -MM)

深入理解Conditional Diffusion Models:解读《On Conditioning the Input Noise for Controlled Image Generation》