什么是激励函数 (Activation Function)

Posted cathy_mu

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了什么是激励函数 (Activation Function)相关的知识,希望对你有一定的参考价值。

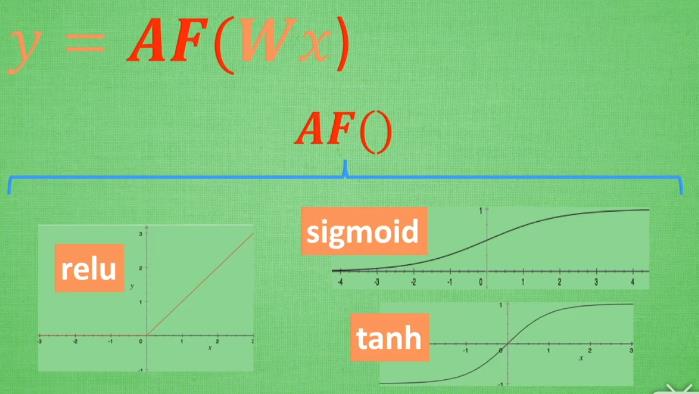

relu

sigmoid

tanh

激励函数。

可以创立自己的激励函数解决自己的问题,只要保证这些激励函数是可以微分的。

只有两三层的神经网络,随便使用哪个激励函数都可以。

多层的不能随便选择,涉及梯度爆炸,梯度消失的问题。

卷积神经网络推荐relu

循环神经网络推荐tanh或者relu

以上是关于什么是激励函数 (Activation Function)的主要内容,如果未能解决你的问题,请参考以下文章