一键部署 spark

Posted

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了一键部署 spark相关的知识,希望对你有一定的参考价值。

前言

Spark简介

Spark是整个BDAS的核心组件,是一个大数据分布式编程框架,不仅实现了MapReduce的算子map 函数和reduce函数及计算模型,还提供更为丰富的算子,如filter、join、groupByKey等。是一个用来实现快速而同用的集群计算的平台。

Spark将分布式数据抽象为弹性分布式数据集(RDD),实现了应用任务调度、RPC、序列化和压缩,并为运行在其上的上层组件提供API。其底层采用Scala这种函数式语言书写而成,并且所提供的API深度借鉴Scala函数式的编程思想,提供与Scala类似的编程接口

scala-2.9.3:一种编程语言 Scala下载地址:http://www.scala-lang.org/download/

spark-1.4.0:必须是编译好的Spark,如果下载的是Source,则需要自己根据环境使用SBT或者MAVEN重新编译才能使用。 Spark下载地址:http://spark.apache.org/downloads.html。

如图所示:

2、安装scala-2.9.3

3、安装spark-1.4.0

4、修改Spark配置文件

在spark-env.sh末端添加如下几行:

spark-defaults.conf中还有如下配置参数:

5、测试spark安装是否成功

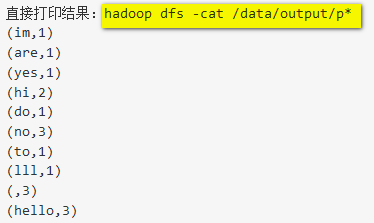

6、使用wordcount例子测试,启动spark-shell之前先上传一份文件到hdfs

7、代码:

val file = sc.textFile("hdfs://hadoop.master:9000/data/intput/wordcount.data")

val count = file.flatMap(line=>(line.split(" "))).map(word=>(word,1)).reduceByKey(_+_)

count.collect()

count.textAsFile("hdfs://hadoop.master:9000/data/output")

理解上面的代码你需要学习scala语言。本文出自 “李世龙” 博客,谢绝转载!

以上是关于一键部署 spark的主要内容,如果未能解决你的问题,请参考以下文章

spark关于join后有重复列的问题(org.apache.spark.sql.AnalysisException: Reference '*' is ambiguous)(代码片段

spark dataframe reducebykey(具有非唯一键值)和自定义值操作