(CS229) 第二课 梯度下降及标准方程推导笔记

Posted

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了(CS229) 第二课 梯度下降及标准方程推导笔记相关的知识,希望对你有一定的参考价值。

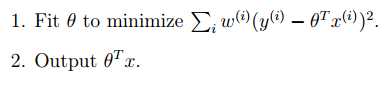

1 Locally weighted linear regression

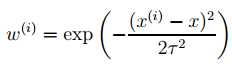

Here the w are non-nagative valued weights. 是一个contribute, A fairly standard choice for the weights is:

(不要与高斯混为一谈,这个函数积分不要求为1,可以是正无穷; 这个函数不是唯一地;最大值1,最小值0)

tau is bandwidth which controls how quickly the weight of a training example falls off with distance of the middle(x^(i))

Locally weighted linear regression is the first example we’re seeing of a non-parametric algorithm

2 未完待续...

以上是关于(CS229) 第二课 梯度下降及标准方程推导笔记的主要内容,如果未能解决你的问题,请参考以下文章