贝叶斯分类器

Posted ttzz

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了贝叶斯分类器相关的知识,希望对你有一定的参考价值。

先验概率:基于已有知识对司机事件进行概率预估,但不考虑任何相关因素。

后验概率:基于已有知识对随机事件进行概率预估,并考虑相关因素P(c|X)。

7.1 贝叶斯决策论

贝叶斯决策论是概率框架下实施决策的基本方法。贝叶斯决策论考虑如何基于这些概率和误判损失来选择最优的类别标记。

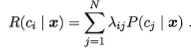

在样本x上的“条件风险”:

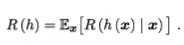

我们的任务是寻找一个判定准则h:以最小化总体风险

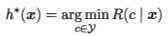

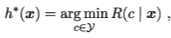

贝叶斯判定准则:为最小化总体风险,只需在每个样本上选择哪个能使条件风险R(c|x)最小的类别标记。

h*称为贝叶斯最优分类器,与之对应的总体风险R(h*)称为贝叶斯风险。1-R(h*)反映了分类器所能达到的最好性能。

最小化分类错误率的贝叶斯最优分类器为  即对每个样本x,选择能使后验概率P(c|x)最大的类别标记。

即对每个样本x,选择能使后验概率P(c|x)最大的类别标记。

机器学习所要实现的是基于有限的训练样本尽可能准确地估计出后验概率P(c|x).大体来说,主要有两种策略:给定x,可通过直接建模P(c|x)来预测c,这样的得到的是“判别式模型”;也可以先对联合概率分布P(x,c)建模,然后再由此获得P(c|x),这样的得到的是“生成式模型”。决策树、BP神经网络、支持向量机等为判别式模型。

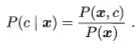

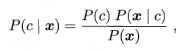

对生成式模型有 ,基于贝叶斯定理,P(c|x)可写为

,基于贝叶斯定理,P(c|x)可写为 ;

;

类先验概率P(c)表达了样本空间中各类样本所占的比例,根据大数定律,当训练机包含足够多的独立同分布样本是,P(c)可通过各类样本出现的频率来进行估计。

7.2 极大似然估计

估计类条件概率:先假定其具有某种确定的概率分布形式,再基于训练样本对概率分布的参数进行估计。概率模型的训练过程就是参数估计过程。

统计学里的两个学派:频率学派和贝叶斯学派

频率学派:强调概率的“客观性”,概率为客观随机性。模型参数固定,样本随机。认为观察者获得的信息是一样的。认为应该将事件在重复试验中发生的频率作为其发生的概率的估计。认为参数虽然未知,但却是客观存在的确定值,可通过优化似然函数等准则来确定参数值;

贝叶斯学派:强调概率的主观性,即条件概率。样本固定,模型参数视为关键。认为不同的观察者获得的信息是不一样的。认为事情发生概率的客观性仅仅是因为观察者不知道事件的结果。随机性的根源不在于事件,而在于观察者对事件的知识状态。而频率学派则认为随机性的根源就是事件,跟观察者无关。认为参数是未观察到的随机变量,其本身也可以有分布,因此可假定参数服从一个先验分布,然后基于观测到的数据来计算参数的后验分布。

极大似然估计---------频率主义学派

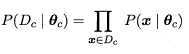

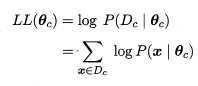

Dc----训练集D中第c类样本组成的集合,假设这些样本独立同分布,则参数θc对数据集Dc的似然是: ,对数似然:

,对数似然:

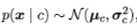

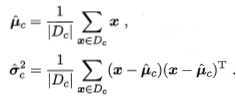

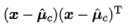

例如在连续情形下,假设概率密度函数 则参数的极大似然估计为:

则参数的极大似然估计为:

也就是说,通过极大似然得到的正态分布均值就是样本均值,方差就是 的均值。

的均值。

7.3 朴素贝叶斯分类器

朴素:属性条件独立

类条件概率P(c|x)是所有属性上的联合概率,难以从有限的训练样本中直接估计而得。

以上是关于贝叶斯分类器的主要内容,如果未能解决你的问题,请参考以下文章