吴恩达《机器学习》课程总结_logistic回归

Posted henuliulei

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了吴恩达《机器学习》课程总结_logistic回归相关的知识,希望对你有一定的参考价值。

Q1分类问题

回归问题的输出可能是很大的数,而在分类问题中,比如二分类,希望输出的值是0或1,如何将回归输出的值转换成分类的输出0,1成为关键。注意logistics回归又称

逻辑回归,但他是分类问题,而不是回归问题。

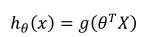

Q2假说表示

其中:

sigmoid函数

hθ(x)的作用是,对于给定的输入变量,根据选择的参数计算输出变量=1的可能性即hθ(x)=P(y=1|x;θ)。

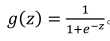

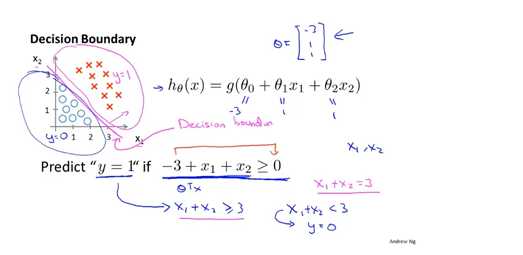

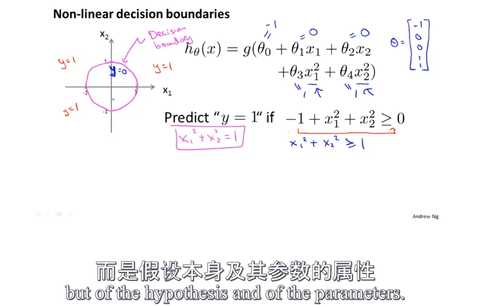

Q3判定边界

g(z)中的z即为判定边界,如下

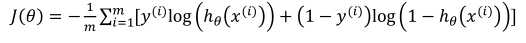

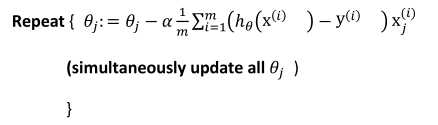

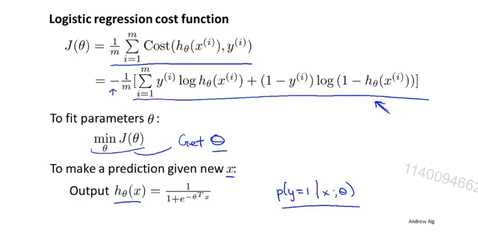

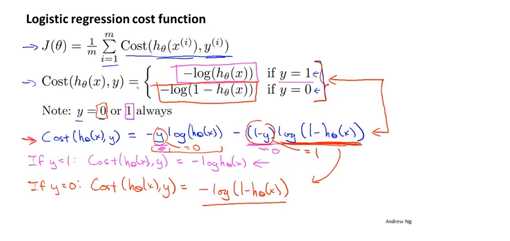

Q4代价函数

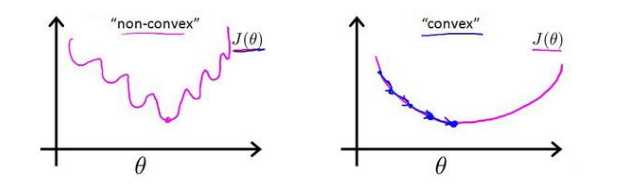

如果用之前回归时用的平方损失函数,代价函数将是非凸函数,会收敛到局部最优,而不是全局最优。

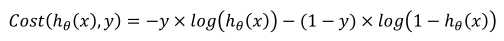

定义新的代价函数:

求导结果:

虽然式子看上去与回归的相同,但是hθ(x)实际定义不一样,所以二者是两回事。

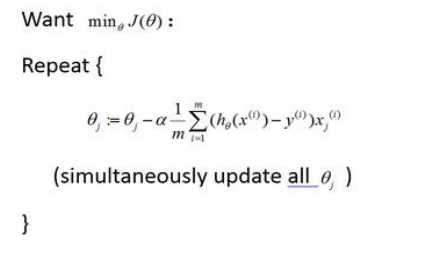

Q5简化的成本函数和梯度下降

Q6高级优化

共轭梯度法、变尺度法、限制变尺度法。

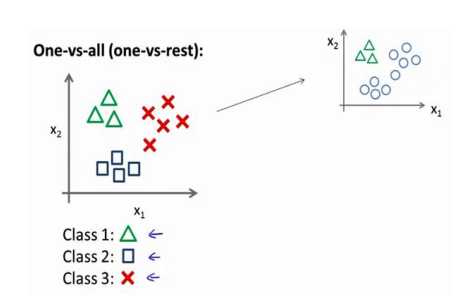

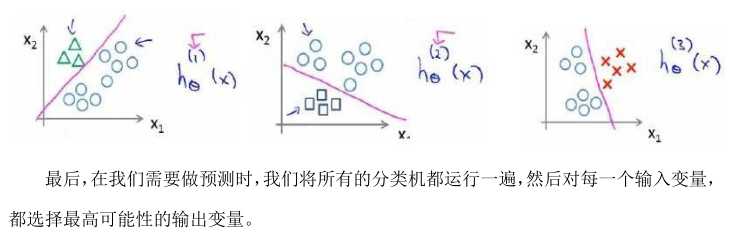

Q7多类别分类:一对多

将某一类分为一类,剩余的其他类分为另一类,如下所示:

得到多个分类器,取分值最高的分类器作为判别:

吴恩达视频里面关于整个公式推导的过程并不详细,也没有完整的代码,下面是网上找到的两个链接,可以作为学习该节内容的一个补充:

词汇补充

classification ---分类 hypothesis representation ---假设陈述 decision boundary ---判定边界 cost function ---代价函数 convex optimization ---凸优化函数 advanced optimization ---高级优化

以上是关于吴恩达《机器学习》课程总结_logistic回归的主要内容,如果未能解决你的问题,请参考以下文章