01b无约束优化(准备知识)

Posted duyiexplorer

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了01b无约束优化(准备知识)相关的知识,希望对你有一定的参考价值。

1、解方程转化为优化问题

$n\\left\\ \\beginaligned& P_1(x)=0 \\\\ & P_2(x)=0 \\\\ & \\text \\vdots \\\\& P_n(x)=0 \\\\\\endaligned \\right.\\text x=\\left[ \\beginaligned & x_1 \\\\& x_2 \\\\& \\vdots \\\\& x_n \\\\\\endaligned \\right]\\text (n个自变量\\text)$

这个方程组里面的每一个函数$P_i(x)$都是光滑 (一般指至少存在一阶和二阶导数)的,其函数可能是线性的,也可能是非线性的。

把上述解方程的问题转化为,优化问题:

$\\text x=\\left[ \\beginaligned& x_1 \\\\& x_2 \\\\& \\vdots \\\\& x_n \\\\\\endaligned \\right]\\text \\left\\ \\beginaligned& P_1(x)=0\\text \\leftrightarrow \\\\& P_2(x)=0\\text \\leftrightarrow \\text \\\\& \\text \\vdots \\\\& P_n(x)=0\\text\\leftrightarrow \\\\\\endaligned \\right.\\left. \\beginaligned& P_1^2(x)=0 \\\\& P_2^2(x)=0 \\\\& \\vdots \\\\& P_n^2(x)=0 \\\\\\endaligned \\right\\\\text \\leftrightarrow \\sum\\limits_i=1^nP_i^2(x)=0$

这解法的好处:

- 即便方程没有解,也可以通过$\\operatornameminimize\\text f(x)=\\sum\\limits_i=1^nP_i^2(x)$求得近似解;

- 在这里不要求方程组里面的函数$P_i(x)$是多项式,可以是三角函数、指数函数等;

- 当方程组里面某个方程$P_i(x)=0$比较重要时,可以通过加权值$w_i$:(局部加权回归)

$\\operatornameminimize\\text f(x)=\\sum\\limits_i=1^nw_iP_i^2(x)\\text \\textw_i>0$

- 可以通过调整权值系数,让误差平分到每个方程上面。

2、在讨论无约束优化(Unconstrained Optimization)之前,先介绍几个基本符号:

- 梯度:gradient (vector)

$\\nabla f=\\left[ \\beginaligned& \\frac\\partial f\\partial x_1 \\\\& \\frac\\partial f\\partial x_2 \\\\& \\vdots \\\\& \\frac\\partial f\\partial x_n \\\\\\endaligned \\right]$

- 海森矩阵: Hessian (matrix)

\\[H(x)=\\nabla ^2f(x)=\\nabla (\\nabla ^Tf(x))=\\left[ \\beginmatrix\\frac\\partial ^2f\\partial x_1^2 & \\frac\\partial ^2f\\partial x_1\\partial x_2 & \\cdots & \\frac\\partial ^2f\\partial x_1\\partial x_n \\\\\\frac\\partial ^2f\\partialx_2\\partial x_1 & \\frac\\partial ^2f\\partial x_2^2 & \\cdots & \\frac\\partial ^2f\\partial x_2\\partial x_n \\\\\\vdots & \\vdots & \\ddots & \\vdots \\\\\\frac\\partial ^2f\\partial x_n\\partial x_1 & \\frac\\partial ^2f\\partialx_n\\partial x_2 & \\cdots & \\frac\\partial ^2f\\partial x_n^2 \\\\\\endmatrix \\right]\\]

对于多元函数的极值问题,按照前面讲的,有如下步骤:

1.找出一阶偏导数等于0的点——驻点(极大值点、极小值点、拐点),即:

$\\nabla f=0\\text \\leftrightarrow \\text \\left\\ \\beginaligned& \\frac\\partial f\\partial x_1=0 \\\\& \\frac\\partial f\\partial x_2=0 \\\\& \\vdots \\\\& \\frac\\partial f\\partial x_n=0 \\\\\\endaligned \\right.\\text $

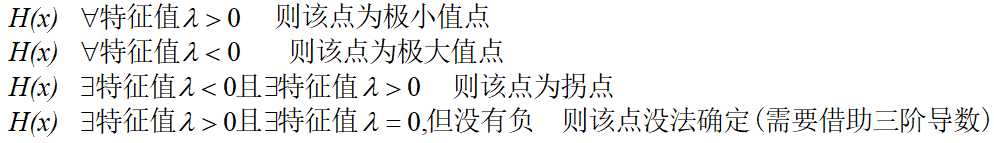

2.接着通过二阶偏导数判断其是否为极值点,是极大值还是极小值点;多元函数的二阶偏导数用Hessian matrix表示,将stepa中得到的驻点代入,Hessian matrix中与极值有如下关系:

数学基础知识补充:

- 实对称阵:的所有特征值都是实的;

- 正定阵:所有特征值都大于0的方阵;

- 半正定阵:所有特征值大于或等于0的方阵;

这里差一个证明,为什么Hessian矩阵的特征值大于0,该点为极小值?(下一部分中有说明)

以上是关于01b无约束优化(准备知识)的主要内容,如果未能解决你的问题,请参考以下文章