softmax

Posted hiyuri

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了softmax相关的知识,希望对你有一定的参考价值。

softmax

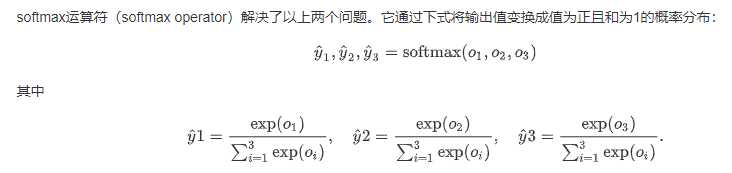

使用softmax的原因

以概率占比得到预测标签

标签值为离散值,离散值与输出值之间的误差无法界定

softmax的实现(指数实现)

分类的时候以概率值最高的序号(argmax)作为y_hat

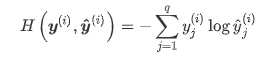

损失函数(交叉熵损失函数)

交叉熵应用于分类的解析:

假设有q类,标签label为离散值k,表示该样本属于第k类,每个样本有一个数组y,每个样本只在y【k】上的值为1,其他为0

训练时对该样本经过softmax有q个概率预测输出值,但损失只采用第k个输出值计算损失

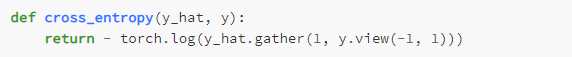

交叉熵的具体实现:

此处gather函数表示取每个样本y_hat数组索引为标签值y的概率值进行loss计算

》》具体gather函数请看 https://www.cnblogs.com/HongjianChen/p/9451526.html

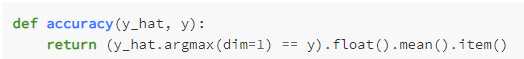

分类准确率计算

注:此处的y值指的是标签值

以上是关于softmax的主要内容,如果未能解决你的问题,请参考以下文章