2019/11/21 Residual Learning论文学习

Posted research-xiaoemo

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了2019/11/21 Residual Learning论文学习相关的知识,希望对你有一定的参考价值。

原始residual论文 Deep Residual Learning for Image Recognition

- 训练深度神经网络的难处:

- 梯度爆炸/梯度消失

batchnorm等一系列方法较好的解决了这个问题 - 加深网络,模型退化(degradation)

residual着重要解决网络加深带来的模型退化问题(degradation)。

思路很简单,浅层的网络性能比深层网络性能好,这样如果我仅仅是用 等变映射(Identity Mapping)去加深网络,那么网络的性能肯定不会比浅层的差。

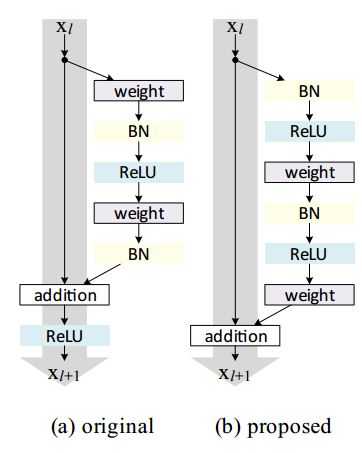

改进1::Identity Mappings in Deep Residual Networks.)

- 提出pre-activation方法的模块。

这个模块能够保证反向传播过程中,不管weight多小,在网络的各个层都能有梯度!!

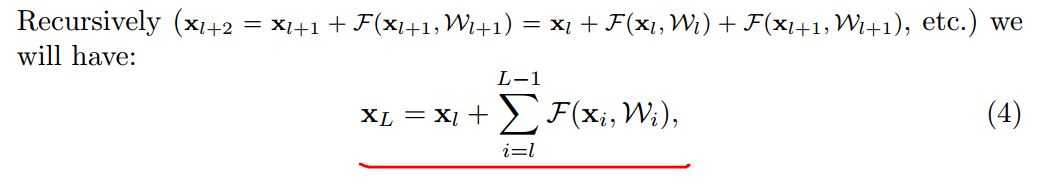

前向传播公式:

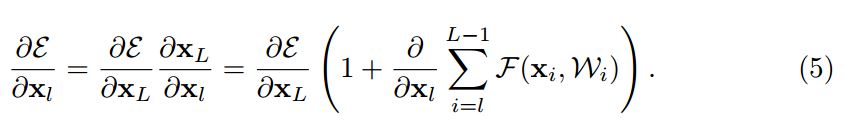

反向传播公式:

)

在反向传播中,只要(frac {partial sum_{i=1}^{L-1}F} {partial X_{L}}) 不是都一直等于-1,就能保证网络中一定存在梯度。

以上是关于2019/11/21 Residual Learning论文学习的主要内容,如果未能解决你的问题,请参考以下文章