极大似然估计的原理是啥?

Posted

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了极大似然估计的原理是啥?相关的知识,希望对你有一定的参考价值。

原理如下:

它的原理是:极大似然估计是建立在极大似然原理的基础上的一个统计方法,是概率论在统计学中的应用。极大似然估计提供了一种给定观察数据来评估模型参数的方法,即:“模型已定,参数未知”。通过若干次试验,观察其结果,利用试验结果得到某个参数值能够使样本出现的概率为最大,则称为极大似然估计。

特征分析:

总结起来,最大似然估计的目的就是:利用已知的样本结果,反推最有可能(最大概率)导致这样结果的参数值。

极大似然估计是建立在极大似然基础上的一个统计方法,极大似然原理的直观想法是,一个随机试验如若有若干个可能的结果。若在一次试验中,A出现了,那么可以认为试验条件对A的出现有利,也即出现的概率P(A)较大。

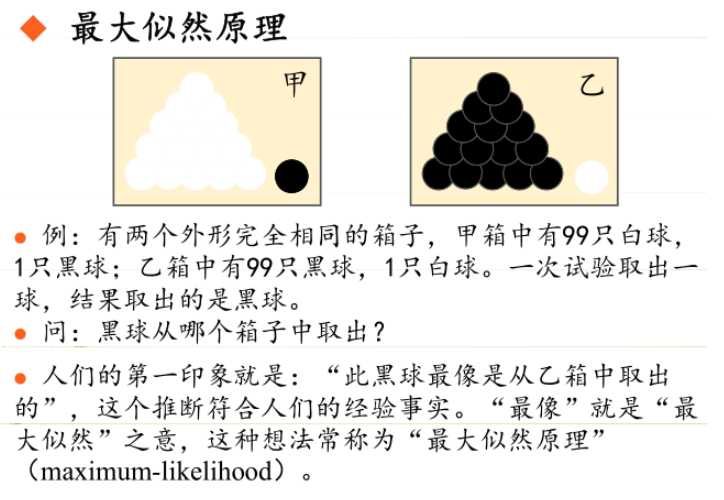

极大似然原理的直观想法我们用下面的例子说明。设甲箱中有99个白球,1个黑球;乙箱中有1个白球,99个黑球。现在随机取出一箱,再从抽取的一箱中随机取出一球,结果是黑球,这黑球从乙箱抽取的概率比从甲箱抽取的概率大得多,这是我们自然可以认为这个黑球是乙箱的。

参考技术A 我认为最大似然估计和矩估计的区别在于,最大似然估计的思想是存在即合理(就是有一个概率控制着它,而不是偶然),同样是抽若干样本,最大似然估计把抽这些样本的每一次抽取看成一个个独立的事件,然后将它们的概率密度乘起来视为一个整体事件A,然后反推“参数为什么值的时候,事件A最有可能发生”,而事件A发生就意味着上述所有抽取事件的发生,这就是最大似然估计的简单理解极大似然估计

极大似然估计的原理,先用一张图片来说明

总结起来,极大似然估计的目的:就是利用已知的样本结果,反推最有可能(最大概率)导致这样结果的参数值。

通过若干次试验,观察其结果,利用试验结果的某个参数值能够使样本出现的概率最大,称为极大似然估计。

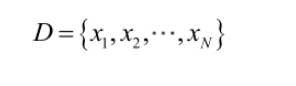

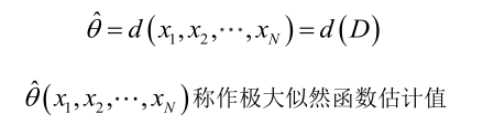

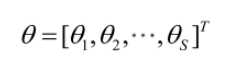

由于样本集中的样本都是独立同分布,可以只考虑一类样本集D,来估计参数向量θ,记已知样本集为:

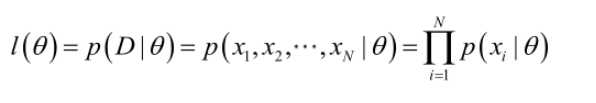

似然函数(linkehood function):联合概率密度函数p(D|θ)称为相对于样本集D={x1,x2,x3,...,xn} 的θ的似然函数

若 使参数空间中,能使似然函数

使参数空间中,能使似然函数 最大的θ值,那

最大的θ值,那 应该使最可能值,

应该使最可能值, 就是θ的极大似然估计量,它是样本集函数

就是θ的极大似然估计量,它是样本集函数

记作:

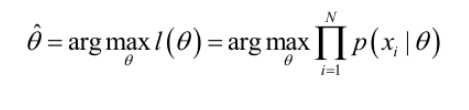

求解极大似然函数

ML估计:求使得改组样本的概率最大的θ值

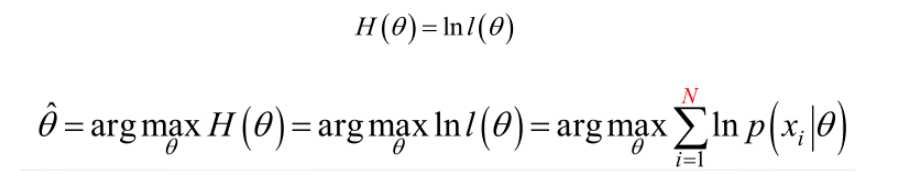

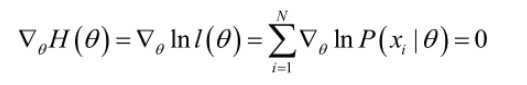

连乘不便于分析,故定义了对数似然函数:

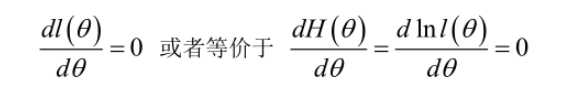

1.未知参数只有一个时(θ为标量),似然函数满足连续可微,极大似然估计量是下面微分方程的解

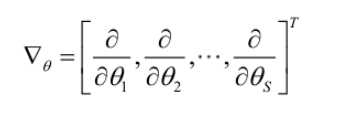

2.未知参数有多个(θ为向量)

记梯度算子:

似然函数满足连续可导,最大似然估计量就是如下方程的解。

总结

求解极大似然估计量步骤:

1.写出似然函数

2.对似然函数取对数,整理

3.求导数

4.解似然方程

最大似然估计特点:

1.比其他估计方法简单

2.收敛性,样本数量增加时,收敛性质更好

3.如果假设的类条件概率模型正确,通常能获得比较好的结果,但如果模型假设有偏差,导致非常差的结果。

以上是关于极大似然估计的原理是啥?的主要内容,如果未能解决你的问题,请参考以下文章