L2 Regularization for Neural Nerworks

Posted rhyswang

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了L2 Regularization for Neural Nerworks相关的知识,希望对你有一定的参考价值。

L2 Regularization是解决Variance(Overfitting)问题的方案之一,在Neural Network领域里通常还有Drop Out, L1 Regularization等。无论哪种方法,其Core Idea是让模型变得更简单,从而平衡对training set完美拟合、以及获得最大的Generalization即归纳能力,从而对未见的数据有最准确的预测。

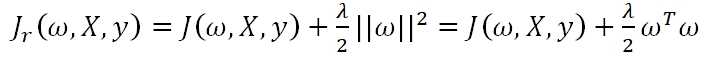

L2 Regularization改变了Cost function,如果在正则化之前的Cost function为J(ω,X,y),则正则化之后,变为:

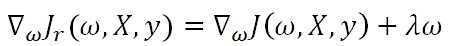

对其求梯度,得到:

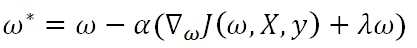

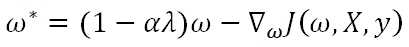

再做Gradient Descent,ω的更新公式为:

其中α是learning rate,λ是Regularization Parameter,一般二者都取正值,所以可以看到参数矩阵ω是呈减小的趋势。并且,在参数矩阵ω中取值较大的参数,减小得会更快。

以上是关于L2 Regularization for Neural Nerworks的主要内容,如果未能解决你的问题,请参考以下文章