机器学习-7.决策树与随机森林

Posted wyply115

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了机器学习-7.决策树与随机森林相关的知识,希望对你有一定的参考价值。

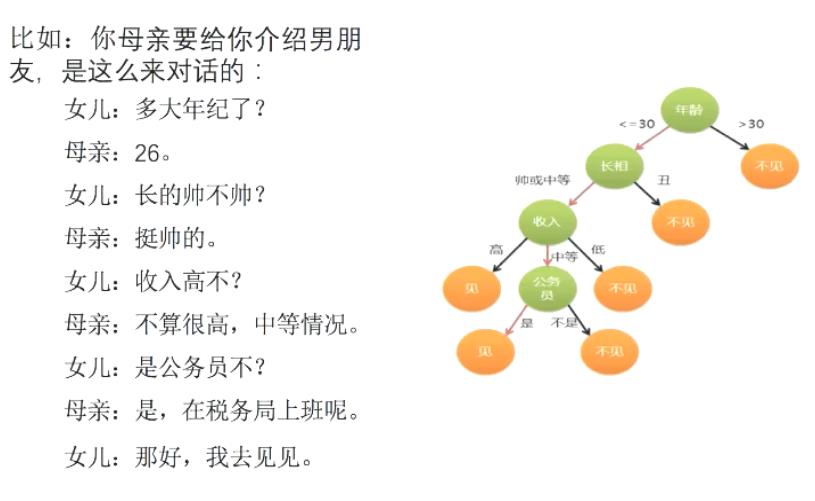

1. 认识决策树

如上图所示,这就是一棵决策树。

2. 信息论基础

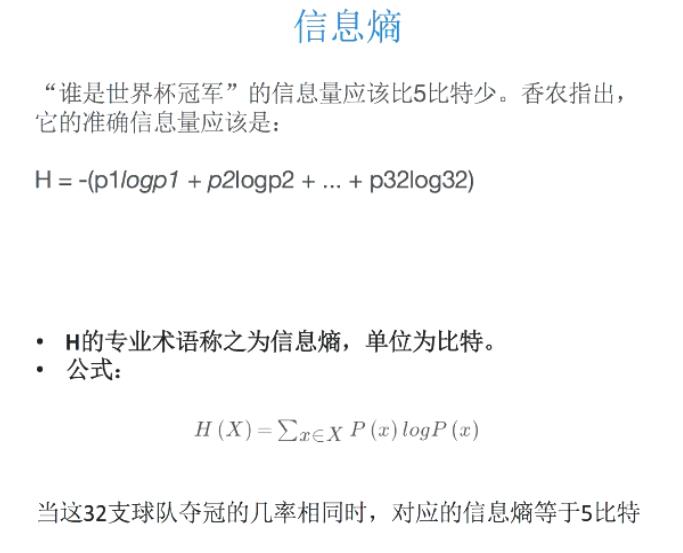

- 假设有32个球队比赛去猜冠军,在对球队没有任何了解时,需要猜几次肯定能猜到?,这个大家应该都知道,采用二分法的话最多5次就能猜到,用数学知识解答就是log32(以2为底)=5。

- 那么在信息论中,32个球队,log32=5比特;64个球队,log64=6比特。

- 比特来源:

- 那么思考个问题,假设32个球队,你知道了很多球队的信息,并且对他们的历史比赛数据都有了解,那么理论上来说,猜冠军的概率应该比不知道这些信息要高,因此,在有数据时猜中的代价应该小于5比特。因此,信息和消除不确定性是相联系的。

- 引出信息熵概念(非重点,理解即可)

信息熵越小,不确定性越小。H(有信息时) < H(无信息时) - 考虑上面介绍男朋友的问题判断,为什么把年龄作为第一个问题,长相作为第二个问题等等,这个首先是这个问题在提问人的心中重要性占比要大,然后根据重要性占比进行依次提问,这样可以最快的得出结论,减少不确定性。

- 用信息论中的术语来说就是,第一个问题能够减少最多的不确定性,即信息熵最小,然后第二、三…个问题的信息熵依次递增。

3. 决策树划分依据

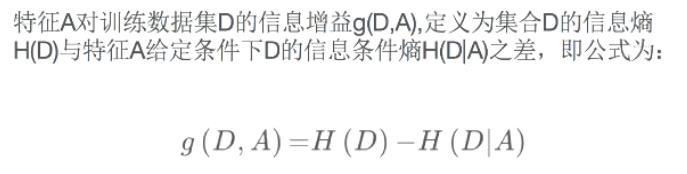

-决策树的划分依据-信息增益

信息增益表示,得知特征x的信息而使得类Y的信息的不确定性减少的程度。信息熵越小,信息增益越大,减少的不确定性越大。

公式如下(理解即可):

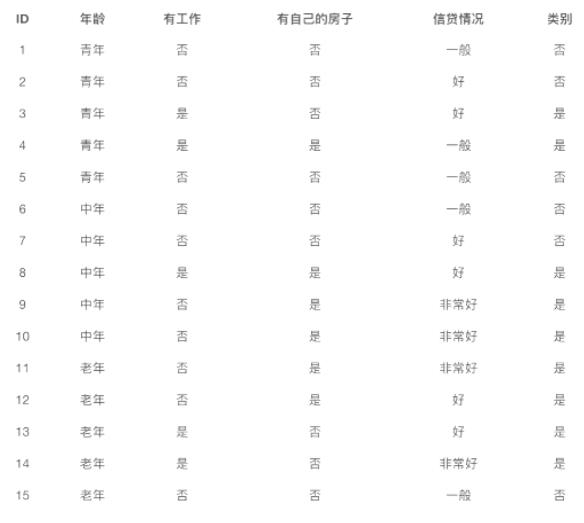

通过一个例子计算一下,如下图一些特征(年龄、有工作、房子、信贷),目标(类别即是否放贷):

H(D)为总的经验熵(根据目标值计算):

- 其他据测依据:

- ID3:这个就是信息增益 最大的准则

- C4.5:信息增益比 最大的准则

- CART:回归数(平方误差最小);分类数:基尼系数(最小的准则,在sklearn是默认依据)

4. 决策树

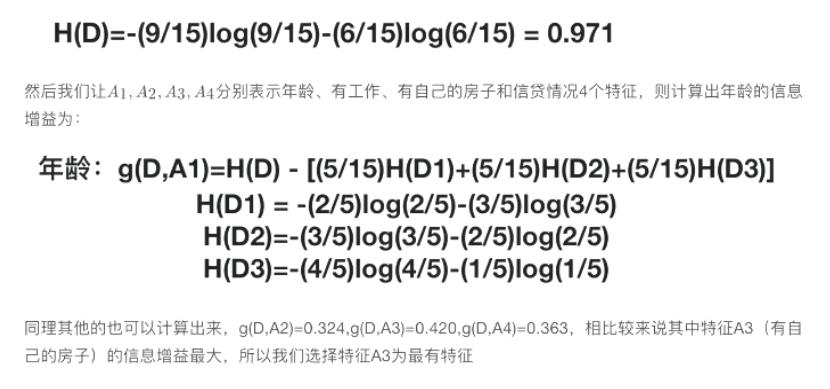

- API :sklearn.tree.DecisionTreeClassifier

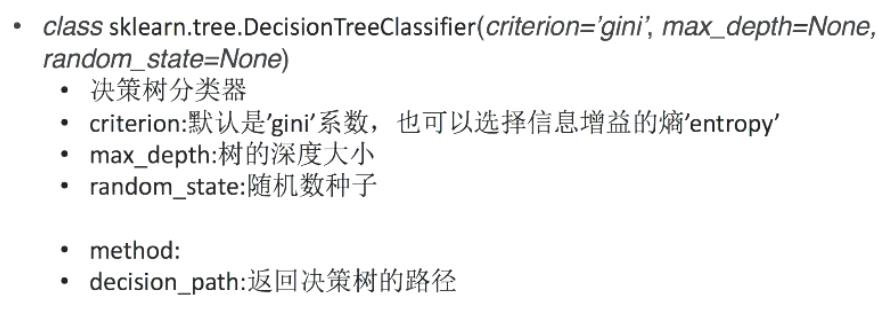

- 案例:

- 数据来源:http://biostat.mc.vanderbilt.edu/wiki/pub/Main/DataSets//titanic.txt

- pd读取数据

- 选择有影响的特征,处理缺失值

- 进行特征工程,pd转换字典,特征抽取

- 决策树估计器流程

import pandas as pd

from sklearn.tree import DecisionTreeClassifier

from sklearn.model_selection import train_test_split

from sklearn.feature_extraction import DictVectorizer

def decision():

'''

决策树对泰坦尼克号进行预测生死

:return:None

'''

# 获取数据

titan = pd.read_csv("http://biostat.mc.vanderbilt.edu/wiki/pub/Main/DataSets//titanic.txt")

# 处理数据,找出特征值和目标值

x = titan[['pclass','age','sex']]

y = titan['survived']

# 缺失值处理

x['age'].fillna(x['age'].mean(),inplace=True)

#分割数据集

x_train, x_test, y_train, y_test = train_test_split(x, y, test_size=0.25)

# 进行处理(特征工程)

dict = DictVectorizer(sparse=False)

x_train = dict.fit_transform(x_train.to_dict(orient="records")) # 转换字典,orient参数是制定一个样本转为一个字典

x_test = dict.transform(x_test.to_dict(orient="records"))

# 决策树进行预测

dec = DecisionTreeClassifier()

dec.fit(x_train, y_train)

print("准确率:", dec.score(x_test, y_test))

return None

if __name__ == '__main__':

decision()

- 输出,准确率: 0.8024316109422492

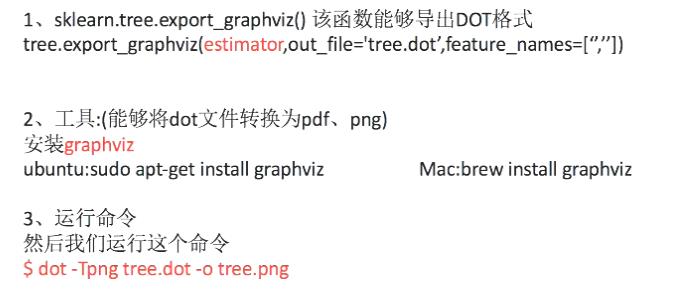

- 决策树的结构,本地保存:

- 决策树的优点:

- 简单的理解和解释,树木可视化。

- 需要很少的数据准备,其它技术通常需要进行归一化。

- 决策树的缺点:决策树学习者可以创建不能很好的推广数据的过于复杂的树,被称为过拟合。

- 改进:1. 减枝cart算法(决策树api中已实现);2. 随机森林。

5. 随机森林

- 我们把随机森林这种统称为集成学习方法

- 集成学习方法:通过建立几个模型组合来解决单一预测问题。它的工作原理是生成多个分类器/模型,各自独立的学习和作出预测,这些预测最后结合成单预测,因此优于任何一个单分类做出的预测。

- 随机森林定义:在机器学习中,随机森林是一个包含多个决策树的分类器,并且其输出的类别是由个别树输出的类别的众数而定。

- 随机森林建立过程(假设N个样本,M个特征):

- 单个树建立过程:

1). 随机在N个样本中选择一个样本,重复N次(样本有可能重复)

2). 随机在M个特征当中选出m(小于M)个特征 - 建立n个决策树,这些树的样本和特征大都不一样。

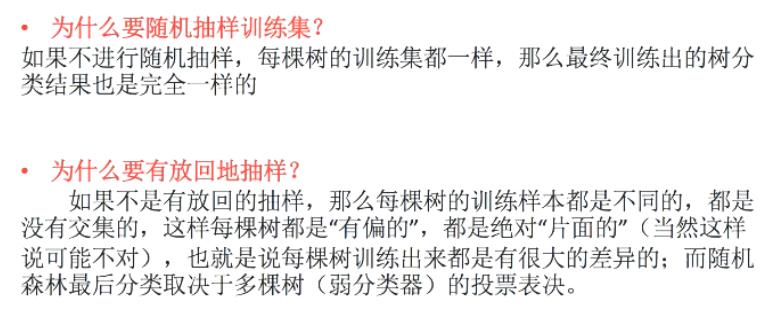

- 采用bootstrap抽样(随机又放回的抽样)

- 单个树建立过程:

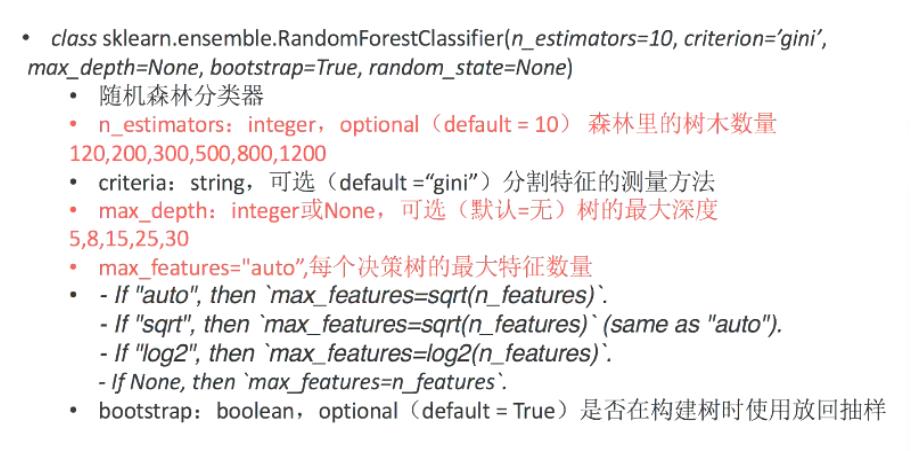

- API:sklearn.ensemble.RandomForestClassifier

- 把决策树中的泰坦尼克号的案例改为随机森林并进行超参数调优。

import pandas as pd

from sklearn.tree import DecisionTreeClassifier

from sklearn.model_selection import train_test_split

from sklearn.feature_extraction import DictVectorizer

from sklearn.ensemble import RandomForestClassifier

from sklearn.model_selection import GridSearchCV

def decision():

'''

决策树对泰坦尼克号进行预测生死

:return:None

'''

# 获取数据

titan = pd.read_csv("http://biostat.mc.vanderbilt.edu/wiki/pub/Main/DataSets//titanic.txt")

# 处理数据,找出特征值和目标值

x = titan[['pclass','age','sex']]

y = titan['survived']

# 缺失值处理

x['age'].fillna(x['age'].mean(),inplace=True)

#分割数据集

x_train, x_test, y_train, y_test = train_test_split(x, y, test_size=0.25)

# 进行处理(特征工程)

dict = DictVectorizer(sparse=False)

x_train = dict.fit_transform(x_train.to_dict(orient="records")) # 转换字典,orient参数是制定一个样本转为一个字典

x_test = dict.transform(x_test.to_dict(orient="records"))

# 决策树进行预测

# dec = DecisionTreeClassifier()

# dec.fit(x_train, y_train)

# print("准确率:", dec.score(x_test, y_test))

# 随机森林进行预测(超参数调优)

rf = RandomForestClassifier()

param = "n_estimators":[120,200,300,500],"max_depth":[5,8,15]

# 网格搜索与交叉验证

gc = GridSearchCV(rf, param_grid=param, cv=2) #此处演示为了节约时间cv取2组了

gc.fit(x_train, y_train)

print("准确率:", gc.score(x_test, y_test))

print("选择的参数模型:", gc.best_params_)

return None

if __name__ == '__main__':

decision()

输出:

准确率: 0.8601823708206687

选择的参数模型: ‘max_depth’: 5, ‘n_estimators’: 200

- 随机森林的优点(几乎没有缺点):

- 在当前所有算法中,具有极好的准确率。

- 能够有效的运行在大数据集上。

- 能够处理具有高纬特征的输入样本,而且不需要降维。

- 能够评估各个特征在分类问题上的重要性。

以上是关于机器学习-7.决策树与随机森林的主要内容,如果未能解决你的问题,请参考以下文章