PyTorch:模型训练-分布式训练

Posted -柚子皮-

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了PyTorch:模型训练-分布式训练相关的知识,希望对你有一定的参考价值。

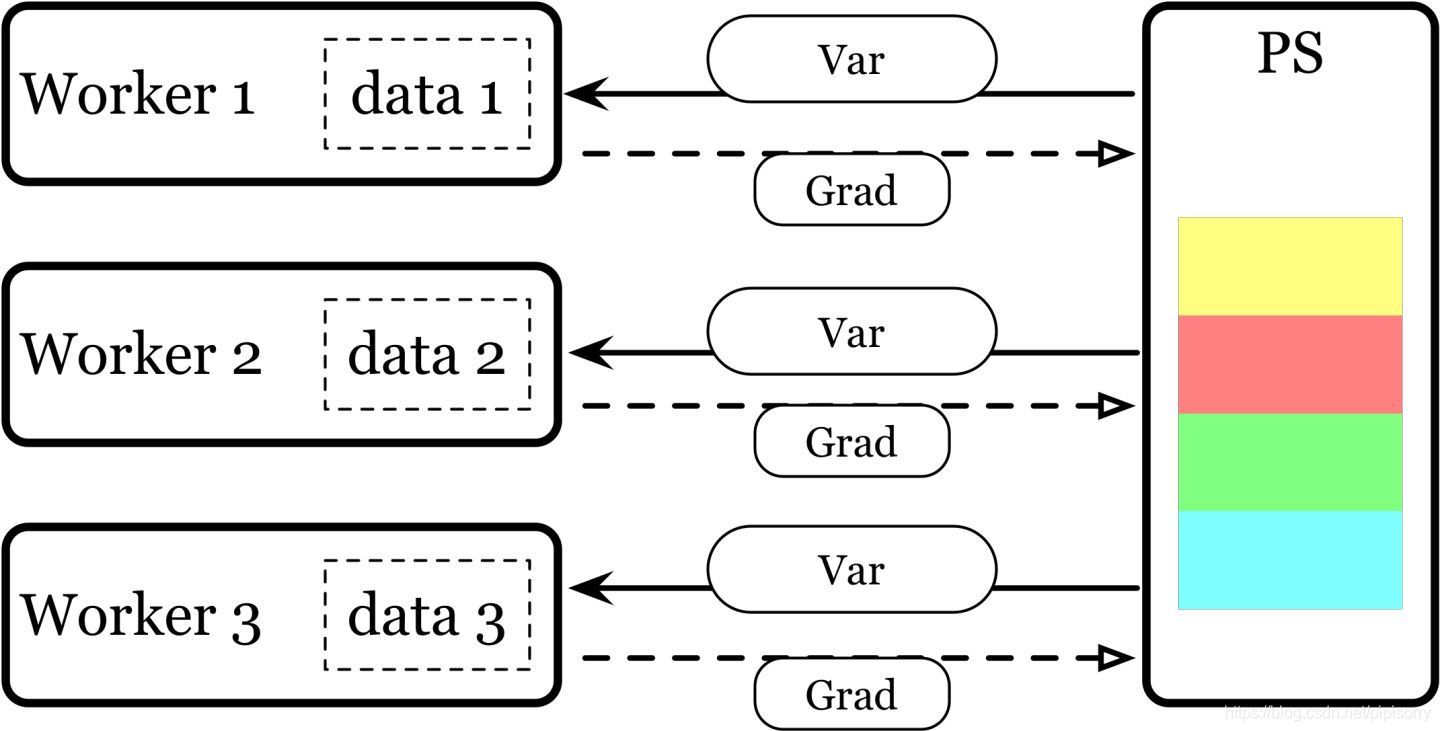

不同数据并行方案(parameter server 模式和 allreduce 模式,同步更新和异步更新)的详细介绍。

分布式算法原理

Parameter server 模式

以参数

以上是关于PyTorch:模型训练-分布式训练的主要内容,如果未能解决你的问题,请参考以下文章