什么是爬虫?

Posted

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了什么是爬虫?相关的知识,希望对你有一定的参考价值。

网络爬虫(又被称为网页蜘蛛,网络机器人)就是模拟浏览器发送网络请求,接收请求响应,一种按照一定的规则,自动地抓取互联网信息的程序。

原则上,只要是浏览器(客户端)能做的事情,爬虫都能够做。

为什么我们要使用爬虫?

互联网大数据时代,给予我们的是生活的便利以及海量数据爆炸式地出现在网络中。

过去,我们通过书籍、报纸、电视、广播或许信息,这些信息数量有限,且是经过一定的筛选,信息相对而言比较有效,但是缺点则是信息面太过于狭窄了。不对称的信息传导,以至于我们视野受限,无法了解到更多的信息和知识。

互联网大数据时代,我们突然间,信息获取自由了,我们得到了海量的信息,但是大多数都是无效的垃圾信息。

例如新浪微博,一天产生数亿条的状态更新,而在百度搜索引擎中,随意搜一条——减肥100.000.000条信息。

通过某项技术将相关的内容收集起来,在分析删选才能得到我们真正需要的信息。

这个信息收集分析整合的工作,可应用的范畴非常的广泛,无论是生活服务、出行旅行、金融投资、各类制造业的产品市场需求等等……都能够借助这个技术获取更精准有效的信息加以利用。

网络爬虫技术,虽说有个诡异的名字,让能第一反应是那种软软的蠕动的生物,但它却是一个可以在虚拟世界里,无往不前的利器。

参考技术A爬虫通俗来说就是抓取网页数据,比如说大家都喜欢的图片呀、小视频呀,还有电子书、文字评论、商品详情等等。

只要网页上有的,都可以通过爬虫爬取下来。

一般而言,python爬虫需要以下几步:

找到需要爬取内容的网页URL

打开该网页的检查页面(即查看HTML代码,按F12快捷键即可进入)

在HTML代码中找到你要提取的数据

写python代码进行网页请求、解析

存储数据

当然会python是前提,对于小白来说自学也不是件容易的事,需要花相当的时间去适应python的语法逻辑,而且要坚持亲手敲代码,不断练习。

如果对自己没有自信,也可以考虑看编程课程,跟着老师的节奏去学习,能比较快地掌握python语法体系,也能得到充分的案例练习。

参考技术B python是一种计算机的编程语言,是这么多计算机编程语言中比较容易学的一种,而且应用也广,这python爬虫是什么意思呢?和IPIDEA全球http去了解一下python爬虫的一些基础知识。一、python爬虫是什么意思

爬虫:是一种按照一定的规则,自动地抓取万维网信息的程序或者脚本。另外一些不常使用的名字还有蚂蚁、自动索引、模拟程序或者蠕虫。

即:打开一个网页,有个工具,可以把网页上的内容获取下来,存到你想要的地方,这个工具就是爬虫。

Python爬虫架构组成:

1.网页解析器,将一个网页字符串进行解析,可以按照我们的要求来提取出我们有用的信息,也可以根据DOM树的解析方式来解析。

2.URL管理器:包括待爬取的URL地址和已爬取的URL地址,防止重复抓取URL和循环抓取URL,实现URL管理器主要用三种方式,通过内存、数据库、缓存数据库来实现。

3.网页下载器:通过传入一个URL地址来下载网页,将网页转换成一个字符串,网页下载器有urllib2(Python官方基础模块)包括需要登录、代理、和cookie,requests(第三方包)

4.调度器:相当于一台电脑的CPU,主要负责调度URL管理器、下载器、解析器之间的协调工作。

5.应用程序:就是从网页中提取的有用数据组成的一个应用。

二、爬虫怎么抓取数据

1.抓取网页

抓取网页有时候需要模拟浏览器的行为,很多网站对于生硬的爬虫抓取都是封杀的。这是我们需要模拟user agent的行为构造合适的请求,比如模拟用户登陆、模拟session/cookie的存储和设置。

2.抓取后处理

抓取的网页通常需要处理,比如过滤html标签,提取文本等。python的beautifulsoap提供了简洁的文档处理功能,能用极短的代码完成大部分文档的处理。

其实以上功能很多语言和工具都能做,但是用python能够干得最快,最干净。上文介绍了python爬虫的一些基础知识,相信大家对于“python爬虫是什么意思”与“爬虫怎么抓取数据”有一定的的认识了。现在大数据时代,很多学python的时候都是以爬虫入手,学习网络爬虫的人越来越多。通常使用爬虫抓取数据都会遇到IP限制问题,使用高匿代理,可以突破IP限制,帮助爬虫突破网站限制次数。 参考技术C 不是长着腿,就是爬行的那种虫就叫爬虫。爬虫应该是可分为会飞的,还有不会飞的,反正种类极多,就是爬行的,真的有很多从数都数不尽。如果是没有会爬的那种虫,他们应该就不叫爬虫。 参考技术D 爬虫就是爬行的虫子,一般形体较小

什么是爬虫|Python爬虫的原理是什么

前言

简单来说互联网是由一个个站点和网络设备组成的大网,我们通过浏览器访问站点,站点把HTML、JS、CSS代码返回给浏览器,这些代码经过浏览器解析、渲染,将丰富多彩的网页呈现我们眼前;

一、爬虫是什么?

如果我们把互联网比作一张大的蜘蛛网,数据便是存放于蜘蛛网的各个节点,而爬虫就是一只小蜘蛛,

沿着网络抓取自己的猎物(数据)爬虫指的是:向网站发起请求,获取资源后分析并提取有用数据的程序;

从技术层面来说就是 通过程序模拟浏览器请求站点的行为,把站点返回的HTML代码/JSON数据/二进制数据(图片、视频) 爬到本地,进而提取自己需要的数据,存放起来使用;

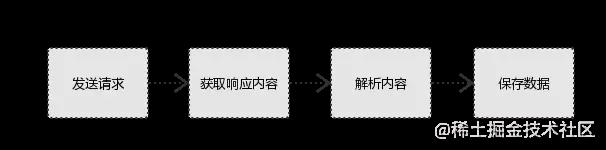

二、爬虫的基本流程:

用户获取网络数据的方式:

方式1:浏览器提交请求—>下载网页代码—>解析成页面

方式2:模拟浏览器发送请求(获取网页代码)->提取有用的数据->存放于数据库或文件中

爬虫要做的就是方式2;

1、发起请求

使用http库向目标站点发起请求,即发送一个Request

Request包含:请求头、请求体等

Request模块缺陷:不能执行JS 和CSS 代码

2、获取响应内容

如果服务器能正常响应,则会得到一个Response

Response包含:html,json,图片,视频等

3、解析内容

解析html数据:正则表达式(RE模块),第三方解析库如Beautifulsoup,pyquery等

解析json数据:json模块

解析二进制数据:以wb的方式写入文件

4、保存数据

数据库(MySQL,Mongdb、Redis)

文件

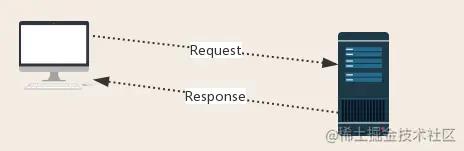

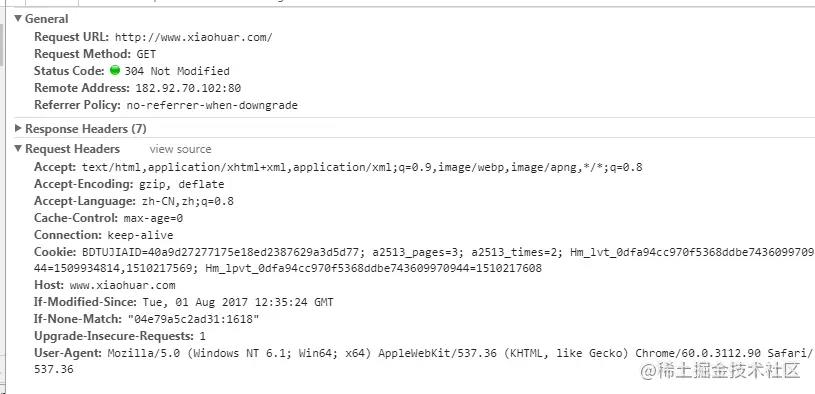

三、http协议 请求与响应

Request:用户将自己的信息通过浏览器(socket client)发送给服务器(socket server)

Response:服务器接收请求,分析用户发来的请求信息,然后返回数据(返回的数据中可能包含其他链接,如:图片,js,css等)

ps:浏览器在接收Response后,会解析其内容来显示给用户,而爬虫程序在模拟浏览器发送请求然后接收Response后,是要提取其中的有用数据。

四、 request

1、请求方式:

常见的请求方式:GET / POST

2、请求的URL

url全球统一资源定位符,用来定义互联网上一个唯一的资源 例如:一张图片、一个文件、一段视频都可以用url唯一确定

url编码

图片会被编码(看示例代码)

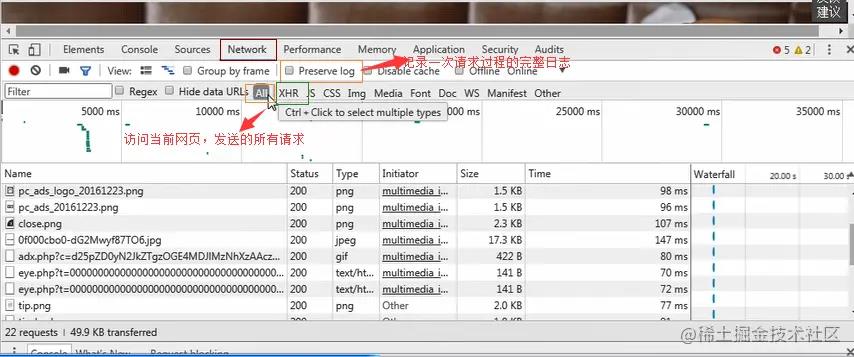

网页的加载过程是:

加载一个网页,通常都是先加载document文档,

在解析document文档的时候,遇到链接,则针对超链接发起下载图片的请求

3、请求头

User-agent:请求头中如果没有user-agent客户端配置,服务端可能将你当做一个非法用户host;

cookies:cookie用来保存登录信息

注意: 一般做爬虫都会加上请求头

请求头需要注意的参数:

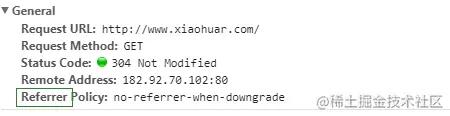

(1)Referrer:访问源至哪里来(一些大型网站,会通过Referrer 做防盗链策略;所有爬虫也要注意模拟)

(2)User-Agent:访问的浏览器(要加上否则会被当成爬虫程序)

(3)cookie:请求头注意携带

4、请求体

请求体

如果是get方式,请求体没有内容 (get请求的请求体放在 url后面参数中,直接能看到)

如果是post方式,请求体是format data

ps:

1、登录窗口,文件上传等,信息都会被附加到请求体内

2、登录,输入错误的用户名密码,然后提交,就可以看到post,正确登录后页面通常会跳转,无法捕捉到post

复制代码

五、 响应Response

1、响应状态码

200:代表成功

301:代表跳转

404:文件不存在

403:无权限访问

502:服务器错误

2、respone header

响应头需要注意的参数:

(1)Set-Cookie:BDSVRTM=0; path=/:可能有多个,是来告诉浏览器,把cookie保存下来

(2)Content-Location:服务端响应头中包含Location返回浏览器之后,浏览器就会重新访问另一个页面

3、preview就是网页源代码

JSO数据

如网页html,图片

二进制数据等

六、总结

1、总结爬虫流程:

爬取—>解析—>存储

2、爬虫所需工具:

请求库:requests,selenium(可以驱动浏览器解析渲染CSS和JS,但有性能劣势(有用没用的网页都会加载);)

解析库:正则,beautifulsoup,pyquery

存储库:文件,MySQL,Mongodb,Redis

3、爬获校花网

最后送给大家点福利吧

基础版:

import re

import requests

respose\\=requests.get('http://www.xiaohuar.com/v/')

# print(respose.status\\_code)# 响应的状态码

# print(respose.content) #返回字节信息

# print(respose.text) #返回文本内容

urls=re.findall(r'class="items".\\*?href="(.\\*?)"',respose.text,re.S) #re.S 把文本信息转换成1行匹配

url=urls\\[5\\]

result\\=requests.get(url)

mp4\\_url\\=re.findall(r'id="media".\\*?src="(.\\*?)"',result.text,re.S)\\[0\\]

video\\=requests.get(mp4\\_url)

with open('D:\\\\\\\\a.mp4','wb') as f:

f.write(video.content)

复制代码

View Code

函数封装版

import re

import requests

import hashlib

import time

# respose=requests.get('http://www.xiaohuar.com/v/')

# # print(respose.status\\_code)# 响应的状态码

# # print(respose.content) #返回字节信息

# # print(respose.text) #返回文本内容

# urls=re.findall(r'class="items".\\*?href="(.\\*?)"',respose.text,re.S) #re.S 把文本信息转换成1行匹配

# url=urls\\[5\\]

# result=requests.get(url)

# mp4\\_url=re.findall(r'id="media".\\*?src="(.\\*?)"',result.text,re.S)\\[0\\]

#

# video=requests.get(mp4\\_url)

#

# with open('D:\\\\\\\\a.mp4','wb') as f:

# f.write(video.content)

#

def get\\_index(url):

respose \\= requests.get(url)

if respose.status\\_code==200:

return respose.text

def parse\\_index(res):

urls \\= re.findall(r'class="items".\\*?href="(.\\*?)"', res,re.S) # re.S 把文本信息转换成1行匹配

return urls

def get\\_detail(urls):

for url in urls:

if not url.startswith('http'):

url\\='http://www.xiaohuar.com%s' %url

result \\= requests.get(url)

if result.status\\_code==200 :

mp4\\_url\\_list \\= re.findall(r'id="media".\\*?src="(.\\*?)"', result.text, re.S)

if mp4\\_url\\_list:

mp4\\_url\\=mp4\\_url\\_list\\[0\\]

print(mp4\\_url)

# save(mp4\\_url)

def save(url):

video \\= requests.get(url)

if video.status\\_code==200:

m\\=hashlib.md5()

m.updata(url.encode('utf-8'))

m.updata(str(time.time()).encode('utf-8'))

filename\\=r'%s.mp4'% m.hexdigest()

filepath\\=r'D:\\\\\\\\%s'%filename

with open(filepath, 'wb') as f:

f.write(video.content)

def main():

for i in range(5):

res1 \\= get\\_index('http://www.xiaohuar.com/list-3-%s.html'% i )

res2 \\= parse\\_index(res1)

get\\_detail(res2)

if \\_\\_name\\_\\_ == '\\_\\_main\\_\\_':

main()

复制代码

View Code

并发版(如果一共需要爬30个视频,开30个线程去做,花的时间就是 其中最慢那份的耗时时间)

import re

import requests

import hashlib

import time

from concurrent.futures import ThreadPoolExecutor

p\\=ThreadPoolExecutor(30) #创建1个程池中,容纳线程个数为30个;

def get\\_index(url):

respose \\= requests.get(url)

if respose.status\\_code==200:

return respose.text

def parse\\_index(res):

res\\=res.result() #进程执行完毕后,得到1个对象

urls = re.findall(r'class="items".\\*?href="(.\\*?)"', res,re.S) # re.S 把文本信息转换成1行匹配

for url in urls:

p.submit(get\\_detail(url)) #获取详情页 提交到线程池

def get\\_detail(url): #只下载1个视频

if not url.startswith('http'):

url\\='http://www.xiaohuar.com%s' %url

result \\= requests.get(url)

if result.status\\_code==200 :

mp4\\_url\\_list \\= re.findall(r'id="media".\\*?src="(.\\*?)"', result.text, re.S)

if mp4\\_url\\_list:

mp4\\_url\\=mp4\\_url\\_list\\[0\\]

print(mp4\\_url)

# save(mp4\\_url)

def save(url):

video \\= requests.get(url)

if video.status\\_code==200:

m\\=hashlib.md5()

m.updata(url.encode('utf-8'))

m.updata(str(time.time()).encode('utf-8'))

filename\\=r'%s.mp4'% m.hexdigest()

filepath\\=r'D:\\\\\\\\%s'%filename

with open(filepath, 'wb') as f:

f.write(video.content)

def main():

for i in range(5):

p.submit(get\\_index,'http://www.xiaohuar.com/list-3-%s.html'% i ).add\\_done\\_callback(parse\\_index)

#1、先把爬主页的任务(get\\_index)异步提交到线程池

#2、get\\_index任务执行完后,会通过回调函add\\_done\\_callback()数通知主线程,任务完成;

#2、把get\\_index执行结果(注意线程执行结果是对象,调用res=res.result()方法,才能获取真正执行结果),当做参数传给parse\\_index

#3、parse\\_index任务执行完毕后,

#4、通过循环,再次把获取详情页 get\\_detail()任务提交到线程池执行

if \\_\\_name\\_\\_ == '\\_\\_main\\_\\_':

main()

复制代码

View Code

涉及知识:多线程多进程

计算密集型任务:使用多进程,因为能Python有GIL,多进程可以利用上CPU多核优势;

IO密集型任务:使用多线程,做IO切换节省任务执行时间(并发)

线程池

以上是关于什么是爬虫?的主要内容,如果未能解决你的问题,请参考以下文章