深入解读Scones:会话式草图生成

Posted 沉迷单车的追风少年

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了深入解读Scones:会话式草图生成相关的知识,希望对你有一定的参考价值。

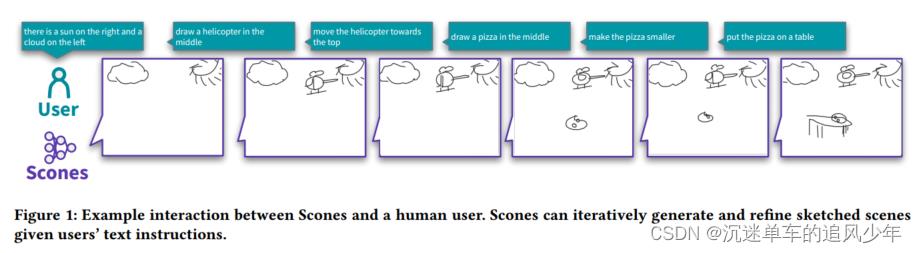

前言:今天是1024程序员节,先祝各位程序员节日快乐,bug少少money多多!会话式sketch生成类似于“小爱同学”,可以实现说一句话就生成一张sketch,逐步完善整张图片的生成。是一个非常有意思的、能落地的、有商业化前景的方向。

目录

贡献概述

scone建立在Sketch-RNN模型和Sketchforme的生成过程之上,以支持从自然语言中手绘场景的渐进、迭代生成和条件修改,这是一种新的机器学习驱动的用户交互。scone使用Transformer网络具有共享的自然语言和场景信息嵌入,并在CoDraw数据集上进行训练,以学习场景中对象和文本指令之间的高级关系。

- 提出了用文本指令迭代生成和细化草图的新型交互,并提出了一种可web部署的scone实现来支持这种交互。

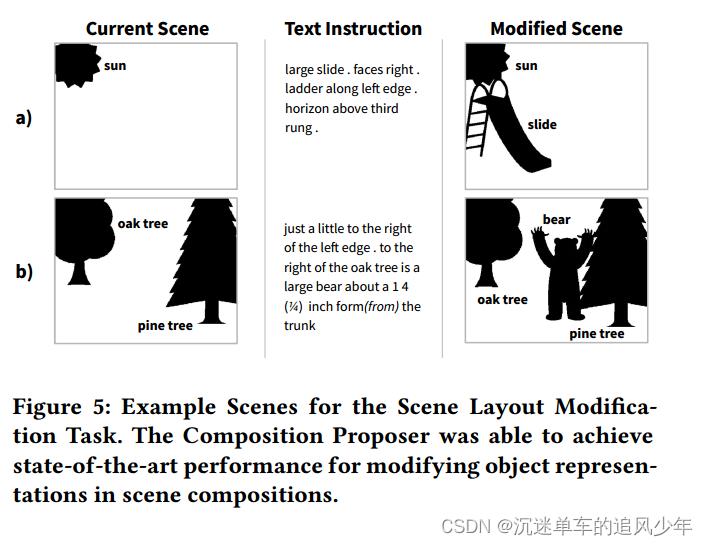

- 提出了一个场景合成proposer,该系统的一个组件,采用一种新颖的方法,使用自然语言创建和编辑物体场景。它采用了一种最新的神经网络架构,并提高了场景修改任务的最先进性能。

- 提出一种新方法,通过用目标草图的掩模轮廓调节草图生成,在单个物体草图中指定高级场景语义。系统需要将生成草图笔画和自然语言修改指令的低级机制知识与对场景中的构图和对象关系的高级理解结合起来

方法详解

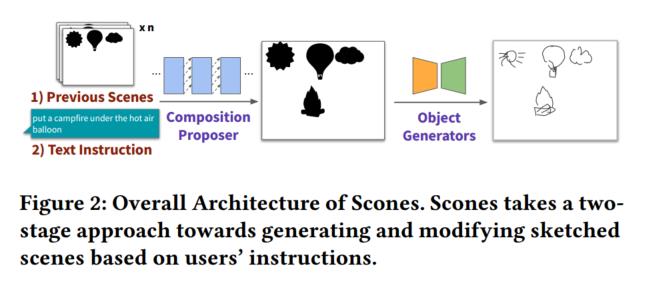

scone采用了一种分层的工作流程,首先使用其构图提议器提出物体的场景级构图布局,然后使用其对象生成器以场景级信息为条件生成单个物体草图。所以也是一个两段式的生成过程,在第二阶段的object generator阶段有很多方法可以解决,关键在于composition proposer怎样设计。

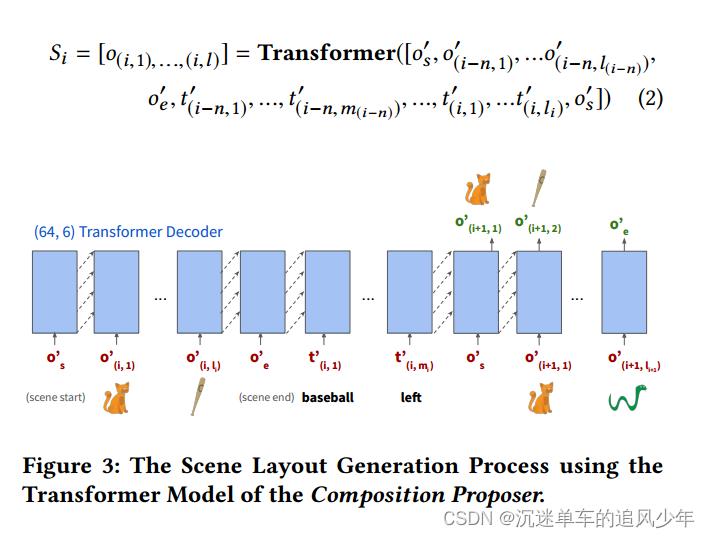

Composition Proposer

使用文本指令在场景中放置和配置对象,由于文本指令和草图组件按时间顺序发生,每个指令和草图组件分别具有可变长度的标记和对象,将构图建议制定为一个序列建模任务。作者使用了一个仅解码器的Transformer模型架构,类似于GPT-2。

Object Generators

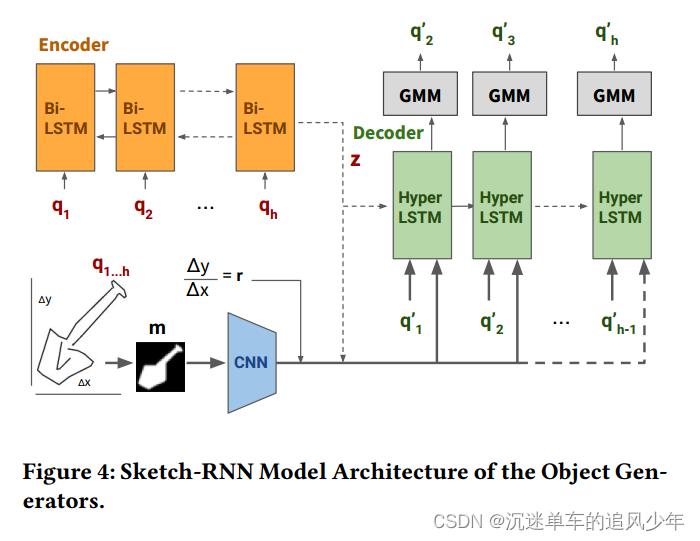

在每个部分的生成当中,作者采用了sketch-rnn,使用的是quickdraw数据集。这也是一个非常经典的结构,后人在这个基础上改进了非常非常多的版本RNN,主要是改进encoder,这个发展故事非常有意思,我后面再展开讲讲,这里不再赘述。

论文和代码

代码链接暂无

个人感悟

1、总结来说就是transformer+sketchrnn,先定位置在定具体形状。

2、代码没有,无法复现,在方法部分我的解读就非常简略了。感兴趣的朋友去看原文吧。

3、为什么没有做生成质量和生成多样性方面的评估?例如计算一下FID、GS之类的指标。

4、GMM计算layout的方法后来也变得非常流行,后来在doodlfomer中得到了引用,值得借鉴。

5、分阶段生成的方法的缺点非常明显,会造成整张画面的割裂感。但是对于场景式生成,直接一口气生活的难度确实非常大!

以上是关于深入解读Scones:会话式草图生成的主要内容,如果未能解决你的问题,请参考以下文章