论文笔记 TransUNet: Transformers Make Strong Encoders for Medical Image Segmentation

Posted UQI-LIUWJ

tags:

篇首语:本文由小常识网(cha138.com)小编为大家整理,主要介绍了论文笔记 TransUNet: Transformers Make Strong Encoders for Medical Image Segmentation相关的知识,希望对你有一定的参考价值。

1 介绍

- 尽管CNN在图像领域取得了颇丰的成就,但是基于CNN的模型很难建模长范围的关系

- 因为CNN卷积核的感受野有限,要想看到特别远的像素点,就需要垒很多层

- ——>为了解决这个问题,有模型考虑将自注意力机制、Transformer融入CNN之中

- Transformer对于全局信息的建模有很强的能力

- 但是Transformer对于局部信息的建模还是有些力不从心的

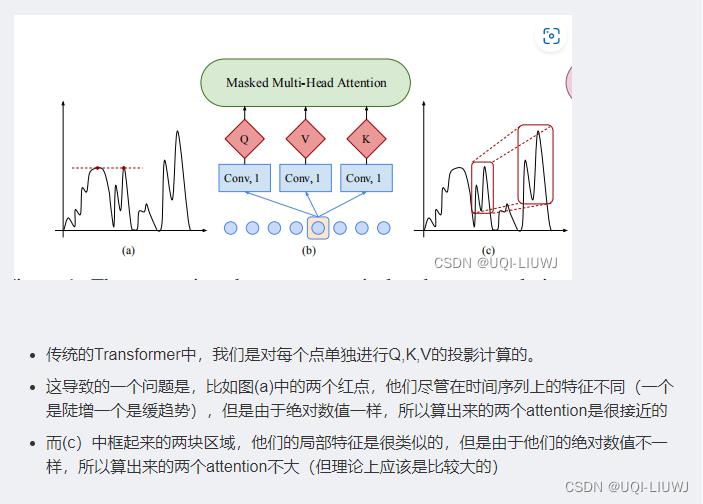

- 用LogSparse Transformer中的图来说明,就是

- 虽然上图说的是时间序列,但是对于图像来说也是如此(后面的实验也说明了,如果仅仅使用transformer作为encoder,将transformer得到的hidden state直接进行上采样还原,得到的分割结果不是很理想)

- 用LogSparse Transformer中的图来说明,就是

- ——>于是,这篇论文提出了TransUnet,第一个将自注意力机制融入医疗图像分割任务中的模型

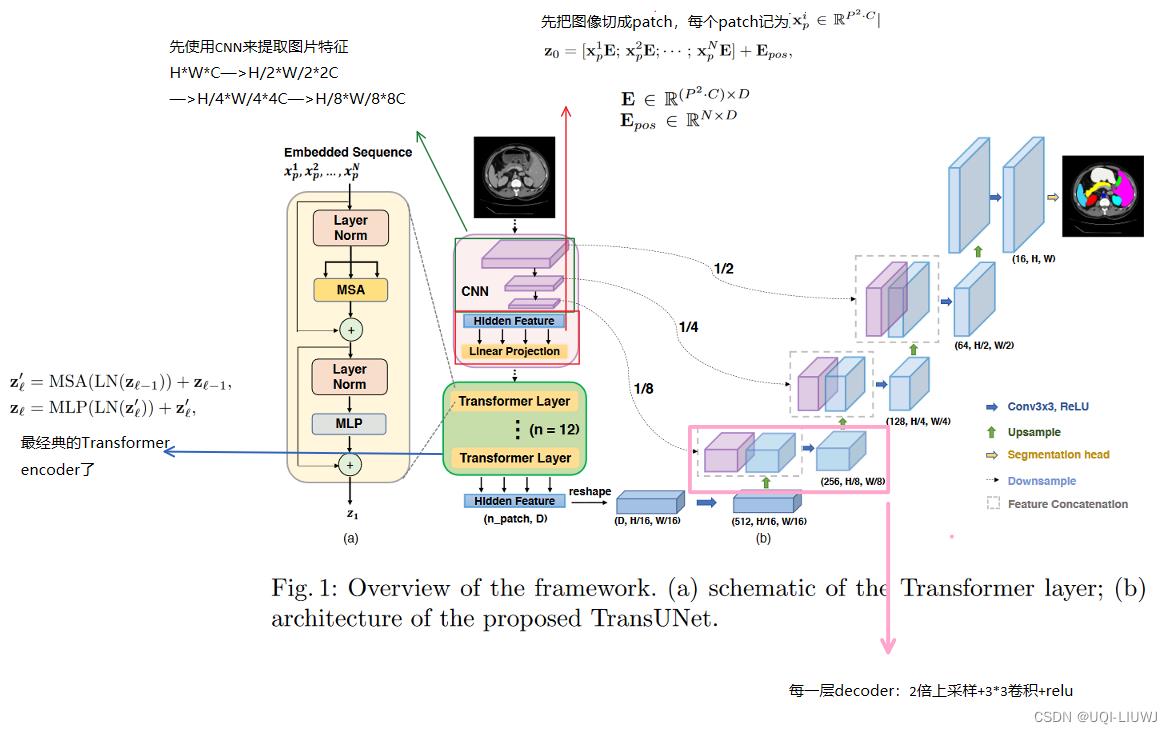

- encoder部分采用的CNN和Transformer融合的架构

- CNN用于提取高分辨率(像素别/其他高分辨率级别)的空间特征

- Transformer用于编码全局信息

- 同样使用图像分割领域比较流行的U-net结构

- encoder部分采用的CNN和Transformer融合的架构

2 方法

3 实验

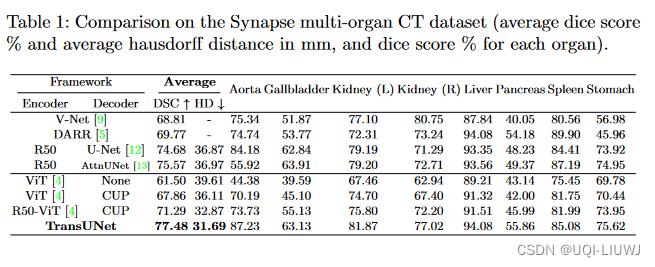

3.1 分割效果

3.2 ablation study

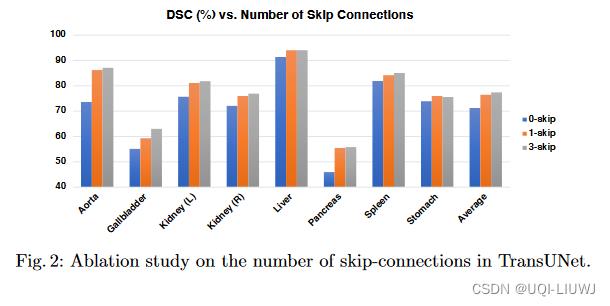

3.2.1 skip connections的数量

这是实验了0个(全没有) 、1个(只链接最中间,1/4处的encoder和decoder)、3个(全连)的情况

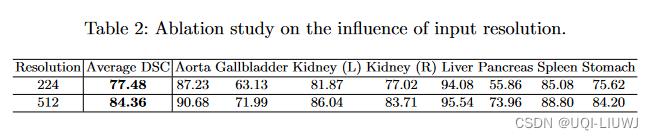

3.2.2 输入分辨率的影响

保持相同的patch size,那么输入分辨率越大,喂给Transformer的sequence length越长。那么效果也更好(每个patch=里面的内容更精细,那么不同像素之间的attention关系更准确)【当然这样的话虽然效果更好了,sequence length 更长,导致计算复杂度也上升了】

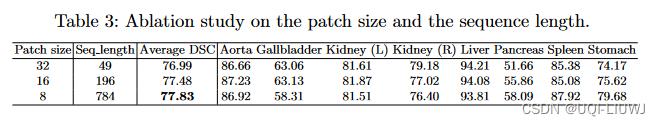

3.2.3 patch size的影响

patch size和sequence length 是成反比的(如果输入分辨率一样的话)

patch 越小,sequence length 越长,每个patch里面的内容更精细,不同像素之间的attention关系更准确,分割效果更好【计算复杂度越高】

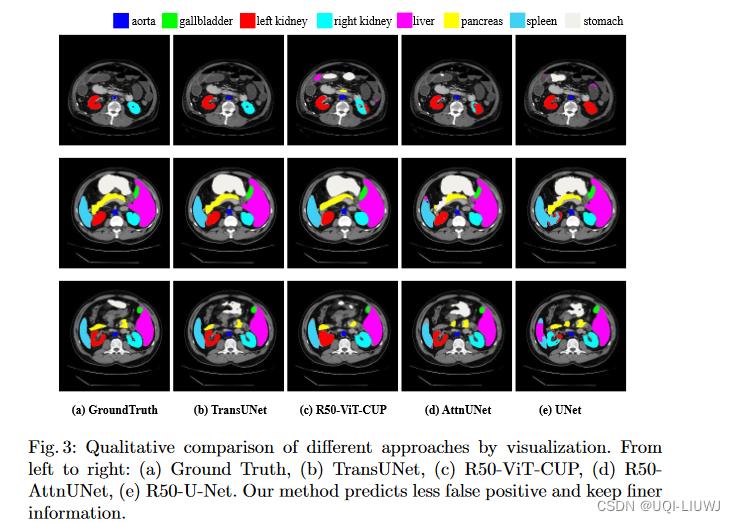

3.3 分割效果可视化

以上是关于论文笔记 TransUNet: Transformers Make Strong Encoders for Medical Image Segmentation的主要内容,如果未能解决你的问题,请参考以下文章